Pretrained Reversible Generation as Unsupervised Visual Representation Learning

作者: Rongkun Xue, Jinouwen Zhang, Yazhe Niu, Dazhong Shen, Bingqi Ma, Yu Liu, Jing Yang

分类: cs.CV, cs.AI, cs.LG

发布日期: 2024-11-29 (更新: 2025-08-13)

备注: Accepted by ICCV 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出预训练可逆生成(PRG)用于无监督视觉表征学习,提升下游任务性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 无监督学习 视觉表征学习 生成模型 可逆生成 特征提取

📋 核心要点

- 现有生成模型在判别任务中的潜力未被充分挖掘,之前的生成分类器设计复杂,未能完全利用生成模型的能力。

- PRG通过反转预训练生成模型的生成过程来提取无监督表征,将生成模型的高容量转化为鲁棒的特征提取器。

- 实验表明,PRG在多个基准测试中超越现有方法,在ImageNet(64*64)上实现了78%的top-1准确率,并具有良好的泛化能力。

📝 摘要(中文)

本文提出预训练可逆生成(PRG),通过反转预训练连续生成模型的生成过程来提取无监督表征,从而探索生成模型在判别任务中的潜力。PRG有效地复用无监督生成模型,利用其高容量作为下游任务的鲁棒且泛化的特征提取器。该框架能够灵活选择针对特定下游任务的特征层级。在多个基准测试中,该方法始终优于现有方法,在基于生成模型的方法中实现了最先进的性能,包括在64*64分辨率的ImageNet上达到78%的top-1准确率。包括分布外评估在内的大量消融研究进一步验证了该方法的有效性。PRG已开源。

🔬 方法详解

问题定义:现有基于生成模型的判别任务方法,如生成分类器,设计复杂,未能充分利用生成模型强大的表征能力。如何更有效地利用预训练的生成模型,提取高质量的无监督视觉表征,以提升下游判别任务的性能,是本文要解决的问题。

核心思路:本文的核心思路是利用预训练的连续生成模型,通过反转其生成过程来提取特征。预训练的生成模型已经学习了数据的内在结构,因此反转生成过程可以有效地提取具有判别性的特征。这种方法避免了从头开始训练判别模型,从而节省了计算资源,并能够利用生成模型强大的表征能力。

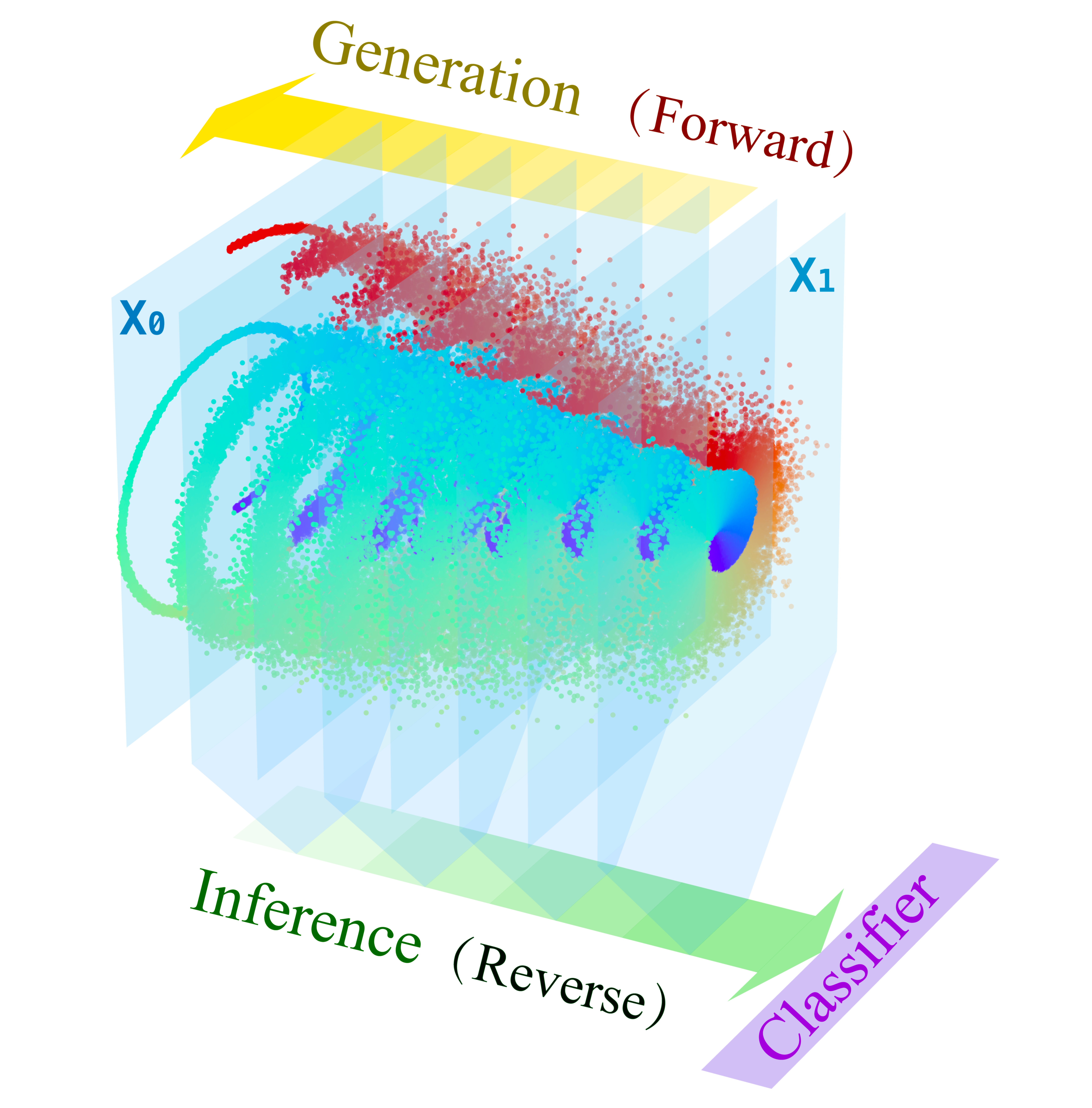

技术框架:PRG框架主要包含两个阶段:预训练生成模型和特征提取。首先,使用连续生成模型(如基于score matching或flow matching的模型)在无标签数据上进行预训练。然后,对于给定的输入图像,通过反转生成过程,逐步将其映射到隐空间。在反转过程中,可以提取不同层级的特征,并根据下游任务的需求选择合适的特征层级。

关键创新:PRG的关键创新在于将预训练生成模型的生成过程反转,用于提取无监督视觉表征。与传统的生成分类器不同,PRG直接利用生成模型的内部表征,避免了复杂的分类器设计。此外,PRG能够灵活选择不同层级的特征,从而适应不同的下游任务。

关键设计:PRG的关键设计包括:1) 选择合适的连续生成模型,如基于score matching或flow matching的模型。2) 设计有效的反转过程,将输入图像映射到隐空间。3) 选择合适的特征层级,以适应不同的下游任务。具体的参数设置和网络结构取决于所选择的生成模型。

🖼️ 关键图片

📊 实验亮点

PRG在多个基准测试中取得了最先进的性能。例如,在64*64分辨率的ImageNet上,PRG达到了78%的top-1准确率,显著优于其他基于生成模型的方法。消融实验表明,PRG的性能提升主要归功于其反转生成过程和灵活的特征选择机制。此外,PRG在分布外评估中也表现出良好的泛化能力。

🎯 应用场景

PRG可应用于各种计算机视觉任务,如图像分类、目标检测、图像分割等。其无监督的特性使其能够利用大量的无标签数据进行预训练,从而提升在标注数据有限情况下的性能。此外,PRG还可以应用于领域自适应和迁移学习等场景,将从一个领域学习到的知识迁移到另一个领域。

📄 摘要(原文)

Recent generative models based on score matching and flow matching have significantly advanced generation tasks, but their potential in discriminative tasks remains underexplored. Previous approaches, such as generative classifiers, have not fully leveraged the capabilities of these models for discriminative tasks due to their intricate designs. We propose Pretrained Reversible Generation (PRG), which extracts unsupervised representations by reversing the generative process of a pretrained continuous generation model. PRG effectively reuses unsupervised generative models, leveraging their high capacity to serve as robust and generalizable feature extractors for downstream tasks. This framework enables the flexible selection of feature hierarchies tailored to specific downstream tasks. Our method consistently outperforms prior approaches across multiple benchmarks, achieving state-of-the-art performance among generative model based methods, including 78% top-1 accuracy on ImageNet at a resolution of 64*64. Extensive ablation studies, including out-of-distribution evaluations, further validate the effectiveness of our approach.PRG is available at https://github.com/opendilab/PRG.