SURE-VQA: Systematic Understanding of Robustness Evaluation in Medical VQA Tasks

作者: Kim-Celine Kahl, Selen Erkan, Jeremias Traub, Carsten T. Lüth, Klaus Maier-Hein, Lena Maier-Hein, Paul F. Jaeger

分类: cs.CV, cs.LG

发布日期: 2024-11-29 (更新: 2025-07-03)

备注: TMLR 07/2025

🔗 代码/项目: GITHUB

💡 一句话要点

SURE-VQA框架:系统评估医学VQA任务中视觉-语言模型的鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学视觉问答 鲁棒性评估 数据分布偏移 大型语言模型 健全性基线

📋 核心要点

- 现有医学VQA模型在真实世界数据分布偏移下的鲁棒性评估不足,缺乏系统性和可解释性。

- 提出SURE-VQA框架,强调在真实世界偏移上评估、使用LLM进行语义评估和提供健全性基线。

- 实验表明,没有微调方法在鲁棒性上始终最优,且LoRA在分布内数据上表现最佳,健全性基线表现出乎意料。

📝 摘要(中文)

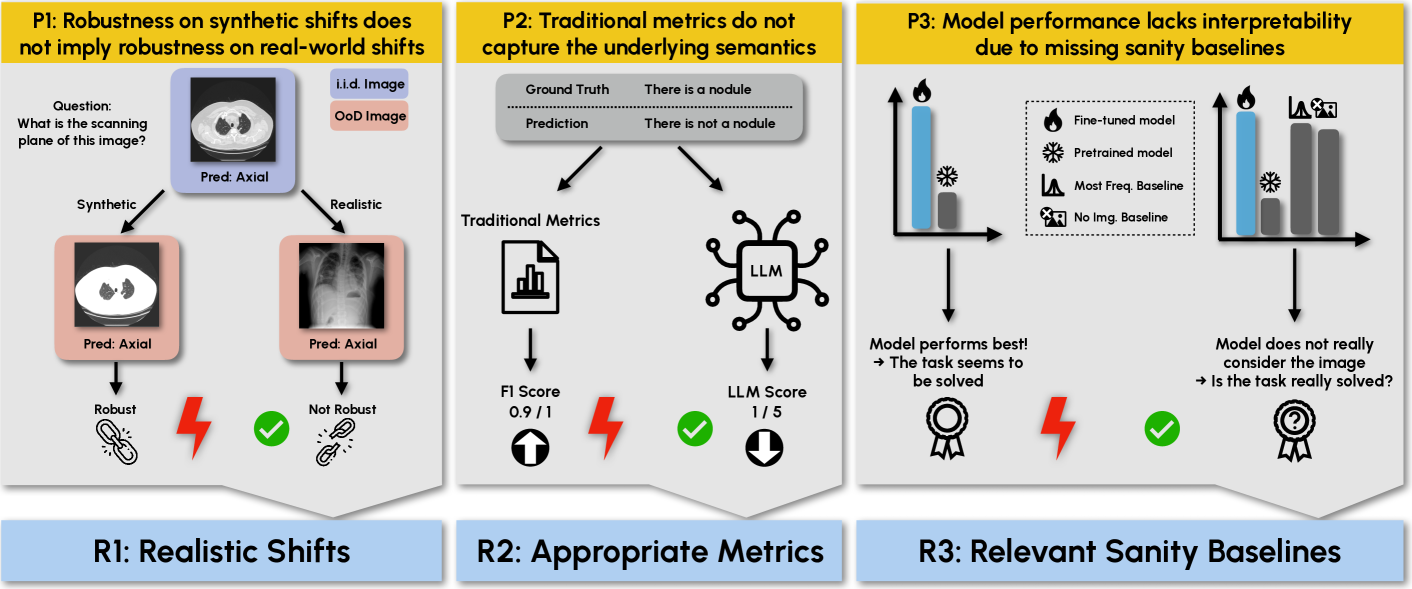

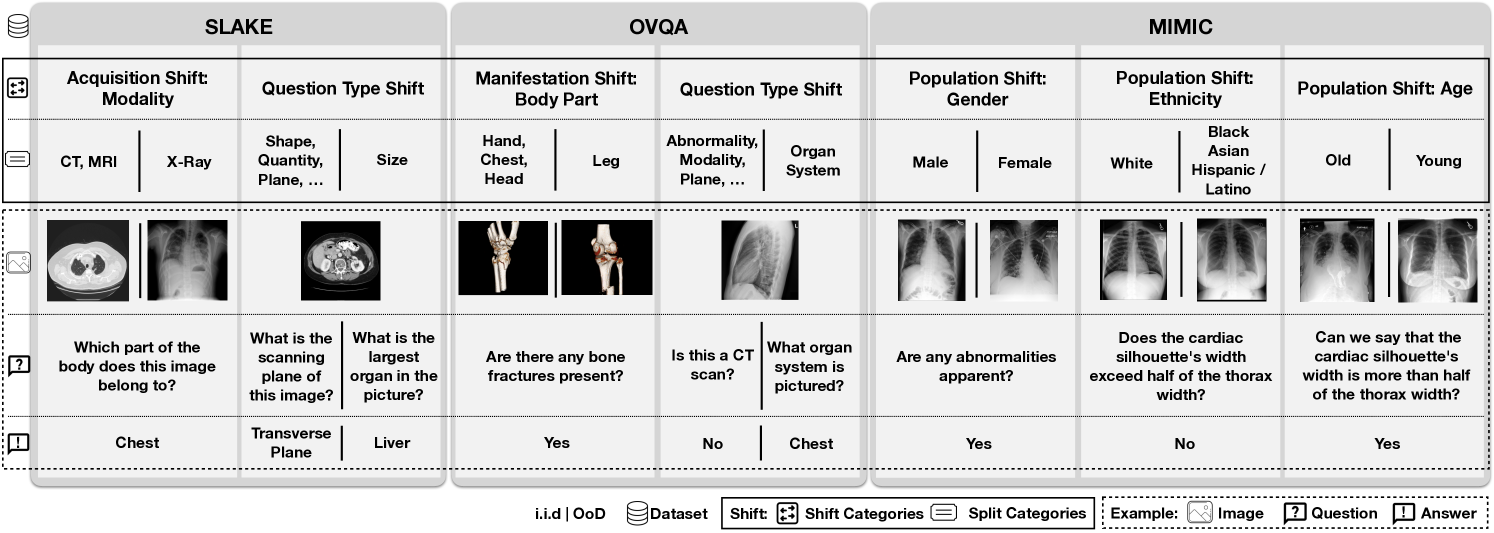

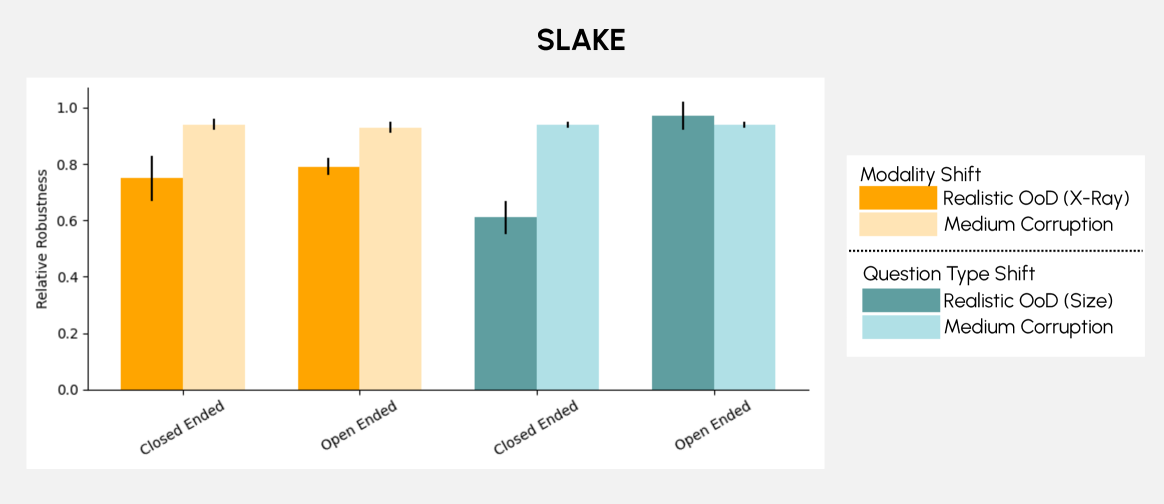

视觉-语言模型(VLMs)在医学任务中具有巨大潜力,例如视觉问答(VQA),它们可以作为患者和临床医生的交互式助手。然而,对于未见数据的分布偏移的鲁棒性仍然是安全部署的关键问题。评估这种鲁棒性需要一个受控的实验设置,以便系统地了解模型的行为。我们证明了当前的设置未能提供充分彻底的评估。为了解决这个差距,我们引入了一个名为SURE-VQA的新框架,该框架围绕三个关键要求,以克服当前的缺陷并系统地分析VLM的鲁棒性:1)由于合成偏移的鲁棒性不一定转化为真实世界的偏移,因此应该在VQA数据固有的真实世界偏移上进行测量;2)传统的token匹配指标通常无法捕捉潜在的语义,因此需要使用大型语言模型(LLMs)进行更准确的语义评估;3)由于缺少健全性基线,模型性能通常缺乏可解释性,因此应报告有意义的基线,以便评估多模态对VLM的影响。为了证明该框架的相关性,我们对各种微调(FT)方法在三个医学数据集和四种类型的分布偏移上的鲁棒性进行了研究。我们的研究突出了对鲁棒性的关键见解:1)没有FT方法在鲁棒性方面始终优于其他方法;2)鲁棒性趋势在FT方法之间比在分布偏移之间更稳定。此外,我们发现不使用图像数据的简单健全性基线可以表现得非常好,并证实LoRA是在分布内数据上表现最佳的FT方法。

🔬 方法详解

问题定义:论文旨在解决医学视觉问答(VQA)模型在实际应用中,由于数据分布偏移导致的鲁棒性问题。现有评估方法主要存在三个痛点:一是依赖合成数据偏移,与真实场景不符;二是使用简单的token匹配指标,无法准确评估语义;三是缺乏健全性基线,难以解释模型性能。

核心思路:论文的核心思路是构建一个更系统、更贴近实际的评估框架SURE-VQA,通过在真实世界数据偏移上进行评估、引入大型语言模型(LLM)进行语义评估以及提供健全性基线,从而更全面地分析VLM的鲁棒性。这样设计的目的是为了更准确地反映模型在真实医疗场景中的表现。

技术框架:SURE-VQA框架主要包含三个关键组成部分: 1. 真实世界数据偏移评估:使用医学VQA数据集中固有的真实世界偏移进行评估,例如不同机构、不同设备等产生的数据差异。 2. LLM语义评估:使用大型语言模型(LLM)作为评估指标,替代传统的token匹配方法,从而更准确地捕捉答案的语义信息。 3. 健全性基线:引入不使用图像数据的简单基线模型,用于评估多模态信息对VQA模型性能的影响。

关键创新:SURE-VQA框架的关键创新在于其评估体系的全面性和实用性。它不再局限于合成数据偏移,而是关注真实世界的数据差异;它使用LLM进行语义评估,克服了传统指标的局限性;它引入健全性基线,增强了模型性能的可解释性。这些创新使得评估结果更具参考价值,有助于指导VQA模型在医疗领域的实际应用。

关键设计:论文中,关键设计包括: 1. 数据偏移选择:选取了三种医学数据集,并针对每种数据集定义了四种类型的分布偏移,以覆盖不同的真实世界场景。 2. LLM评估指标:具体使用的LLM评估指标未知,但强调了其在语义理解上的优势。 3. 健全性基线模型:使用了不依赖图像数据的简单模型作为基线,例如仅使用问题进行回答的模型。 4. 微调方法:研究了多种微调(FT)方法,包括LoRA等,并比较了它们在不同数据偏移下的鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,没有一种微调方法在所有分布偏移下都表现出最佳的鲁棒性。鲁棒性趋势在不同的微调方法之间比在不同的分布偏移之间更稳定。此外,简单的、不使用图像数据的健全性基线模型表现出乎意料地好。LoRA是在分布内数据上表现最佳的微调方法。

🎯 应用场景

该研究成果可应用于医学影像辅助诊断、智能问诊等领域。通过更准确地评估和提升医学VQA模型的鲁棒性,可以提高模型在真实医疗场景中的可靠性和实用性,从而辅助医生进行诊断,减轻工作负担,并为患者提供更准确的医疗信息。

📄 摘要(原文)

Vision-Language Models (VLMs) have great potential in medical tasks, like Visual Question Answering (VQA), where they could act as interactive assistants for both patients and clinicians. Yet their robustness to distribution shifts on unseen data remains a key concern for safe deployment. Evaluating such robustness requires a controlled experimental setup that allows for systematic insights into the model's behavior. However, we demonstrate that current setups fail to offer sufficiently thorough evaluations. To address this gap, we introduce a novel framework, called SURE-VQA, centered around three key requirements to overcome current pitfalls and systematically analyze VLM robustness: 1) Since robustness on synthetic shifts does not necessarily translate to real-world shifts, it should be measured on real-world shifts that are inherent to the VQA data; 2) Traditional token-matching metrics often fail to capture underlying semantics, necessitating the use of large language models (LLMs) for more accurate semantic evaluation; 3) Model performance often lacks interpretability due to missing sanity baselines, thus meaningful baselines should be reported that allow assessing the multimodal impact on the VLM. To demonstrate the relevance of this framework, we conduct a study on the robustness of various Fine-Tuning (FT) methods across three medical datasets with four types of distribution shifts. Our study highlights key insights into robustness: 1) No FT method consistently outperforms others in robustness, and 2) robustness trends are more stable across FT methods than across distribution shifts. Additionally, we find that simple sanity baselines that do not use the image data can perform surprisingly well and confirm LoRA as the best-performing FT method on in-distribution data. Code is provided at https://github.com/IML-DKFZ/sure-vqa.