Libra: Leveraging Temporal Images for Biomedical Radiology Analysis

作者: Xi Zhang, Zaiqiao Meng, Jake Lever, Edmond S. L. Ho

分类: cs.CV, cs.AI, cs.CL, cs.LG

发布日期: 2024-11-28 (更新: 2025-02-16)

备注: 30 pages, 5 figures, Adding Appendix

期刊: Association for Computational Linguistics, 2025

💡 一句话要点

Libra:利用时序影像进行生物医学放射学分析,提升报告生成质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 放射学报告生成 时序影像分析 多模态学习 医学图像处理 大型语言模型

📋 核心要点

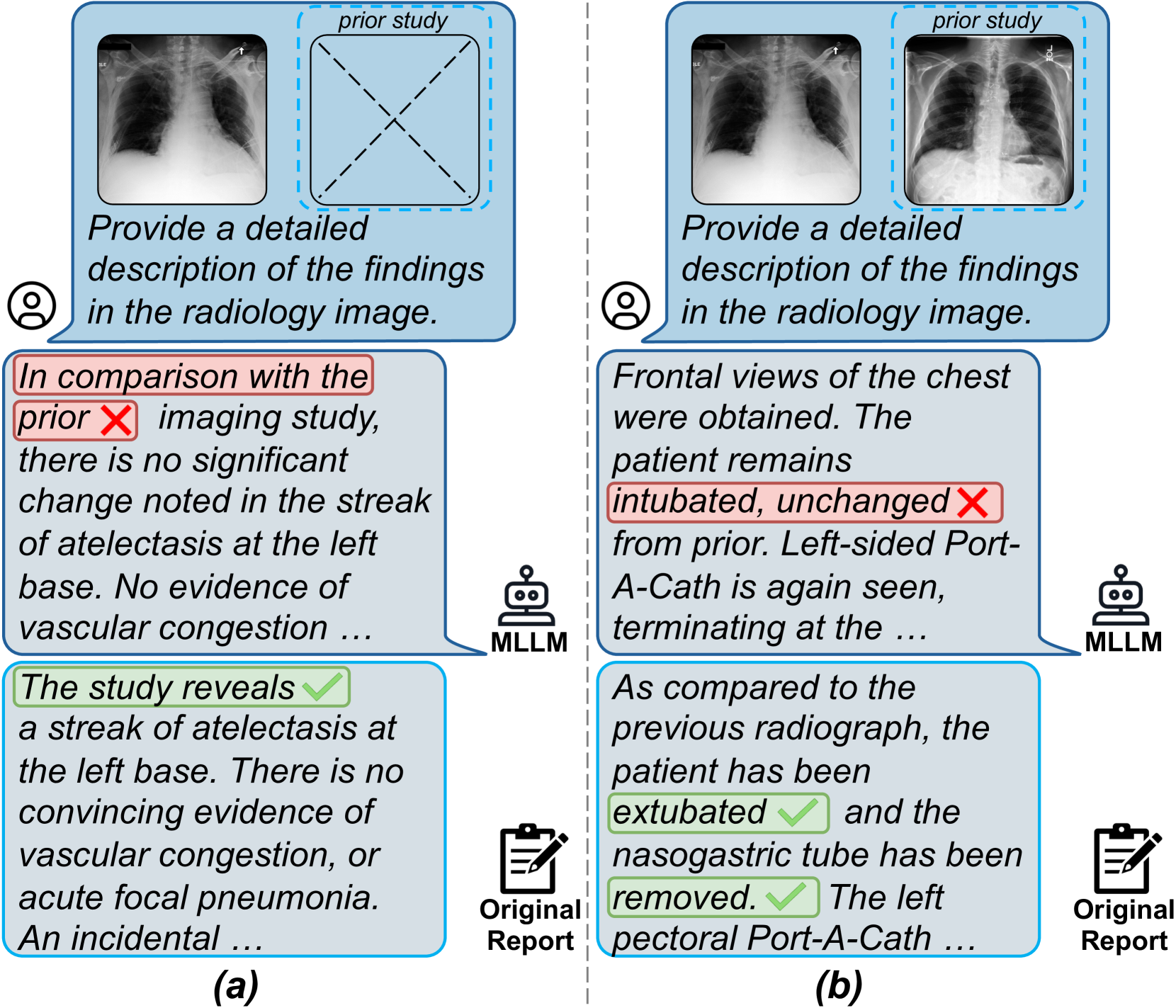

- 现有放射学报告生成方法难以有效利用多张影像的时序信息,限制了诊断的准确性。

- Libra提出一种时序感知的多模态大型语言模型,通过时序对齐连接器(TAC)整合当前和先前影像的时序差异。

- 在MIMIC-CXR数据集上的实验表明,Libra在临床相关性和词汇准确性方面均达到了新的SOTA水平。

📝 摘要(中文)

放射学报告生成(RRG)需要先进的医学图像分析、有效的时序推理和准确的文本生成。虽然多模态大型语言模型(MLLM)与预训练的视觉编码器相结合可以增强视觉-语言理解,但现有方法大多依赖于单图像分析或基于规则的启发式方法来处理多张图像,未能充分利用多模态医学数据集中的时序信息。本文介绍了一种时序感知MLLM——Libra,专门为胸部X光报告生成而设计。Libra将放射学专用图像编码器与一种新颖的时序对齐连接器(TAC)相结合,旨在准确捕获和整合配对的当前和先前图像之间的时序差异。在MIMIC-CXR数据集上的大量实验表明,Libra在同等规模的MLLM中建立了一个新的最先进的基准,并在临床相关性和词汇准确性方面都设定了新的标准。

🔬 方法详解

问题定义:放射学报告生成任务需要从一系列医学影像中提取关键信息,并生成准确、全面的报告。现有方法,尤其是基于多模态大型语言模型的方法,在处理多张时序影像时,通常采用单张图像分析或简单的规则方法,无法充分利用影像之间蕴含的时序信息,导致报告质量受限。

核心思路:Libra的核心思路是设计一个能够有效捕捉和整合时序影像差异的框架。通过引入时序对齐连接器(TAC),模型能够学习到当前影像与先前影像之间的变化,从而更好地理解病灶的发展趋势,生成更具临床价值的报告。

技术框架:Libra主要由三个模块组成:放射学专用图像编码器、时序对齐连接器(TAC)和多模态大型语言模型(MLLM)。首先,图像编码器提取当前和先前影像的视觉特征。然后,TAC模块对齐并融合这些特征,捕捉时序差异。最后,MLLM利用融合后的特征生成放射学报告。

关键创新:Libra的关键创新在于时序对齐连接器(TAC)的设计。TAC能够自适应地对齐当前和先前影像的特征,并学习它们之间的时序关系。这种设计使得模型能够更准确地捕捉到影像之间的细微变化,从而提高报告的准确性和临床相关性。

关键设计:TAC的具体实现细节未知,但根据论文描述,其核心目标是对齐和融合当前和先前影像的特征。可能的实现方式包括注意力机制、Transformer结构或其他时序建模方法。损失函数的设计也至关重要,需要考虑临床相关性和词汇准确性,例如使用BLEU、ROUGE等指标,并结合医学领域的专业知识进行调整。

🖼️ 关键图片

📊 实验亮点

Libra在MIMIC-CXR数据集上取得了显著的性能提升,在临床相关性和词汇准确性方面均达到了新的SOTA水平。具体性能数据未知,但论文强调Libra在同等规模的MLLM中表现突出,表明其在利用时序信息方面的优势。

🎯 应用场景

Libra在放射学报告生成领域具有广泛的应用前景,可以辅助医生进行诊断,提高诊断效率和准确性。此外,该方法还可以应用于其他医学影像分析任务,例如疾病进展监测、治疗效果评估等。未来,Libra有望成为临床决策支持系统的重要组成部分,为患者提供更好的医疗服务。

📄 摘要(原文)

Radiology report generation (RRG) requires advanced medical image analysis, effective temporal reasoning, and accurate text generation. While multimodal large language models (MLLMs) align with pre-trained vision encoders to enhance visual-language understanding, most existing methods rely on single-image analysis or rule-based heuristics to process multiple images, failing to fully leverage temporal information in multi-modal medical datasets. In this paper, we introduce Libra, a temporal-aware MLLM tailored for chest X-ray report generation. Libra combines a radiology-specific image encoder with a novel Temporal Alignment Connector (TAC), designed to accurately capture and integrate temporal differences between paired current and prior images. Extensive experiments on the MIMIC-CXR dataset demonstrate that Libra establishes a new state-of-the-art benchmark among similarly scaled MLLMs, setting new standards in both clinical relevance and lexical accuracy.