SuperGaussians: Enhancing Gaussian Splatting Using Primitives with Spatially Varying Colors

作者: Rui Xu, Wenyue Chen, Jiepeng Wang, Yuan Liu, Peng Wang, Lin Gao, Shiqing Xin, Taku Komura, Xin Li, Wenping Wang

分类: cs.CV, cs.GR, cs.MM

发布日期: 2024-11-28

💡 一句话要点

SuperGaussians:利用空间变化颜色基元增强高斯溅射

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 新视角合成 三维重建 空间变化颜色 可移动核

📋 核心要点

- 现有高斯溅射方法使用单一颜色和不透明度表示场景,导致表示不够紧凑,限制了表达能力。

- SuperGaussians方法在单个高斯基元中引入空间变化的颜色和不透明度,以增强其表示能力。

- 实验结果表明,该方法优于基线,特别是可移动核实现了更好的新视角合成性能。

📝 摘要(中文)

高斯溅射在基于高斯显式表示的多视角重建中表现出令人印象深刻的结果。然而,当前的高斯基元仅具有单一的视角相关的颜色和不透明度来表示场景的外观和几何形状,导致表示不够紧凑。本文提出了一种名为SuperGaussians的新方法,该方法在单个高斯基元中利用空间变化的颜色和不透明度来提高其表示能力。我们实现了双线性插值、可移动核甚至微型神经网络作为空间变化函数。定量和定性的实验结果表明,所有三种函数都优于基线,其中最佳的可移动核在多个数据集上实现了卓越的新视角合成性能,突出了空间变化函数的强大潜力。

🔬 方法详解

问题定义:现有高斯溅射方法使用单一颜色和不透明度来表示场景,这限制了其表达能力,导致需要更多的高斯基元来重建复杂的场景,从而使得表示不够紧凑。因此,如何提高单个高斯基元的表达能力,减少所需基元的数量,是本文要解决的核心问题。

核心思路:本文的核心思路是在单个高斯基元内部引入空间变化的颜色和不透明度。通过允许颜色和不透明度在基元内部变化,可以更精细地表示场景的细节,从而提高单个基元的表达能力。这样,就可以使用更少的基元来重建相同的场景,从而实现更紧凑的表示。

技术框架:SuperGaussians方法的核心在于将空间变化的函数集成到高斯基元中。具体来说,每个高斯基元不仅包含位置、缩放、旋转和不透明度等参数,还包含一个空间变化函数,用于确定基元内部每个点的颜色和不透明度。在渲染过程中,首先根据高斯基元的参数确定其在图像上的投影,然后使用空间变化函数计算投影区域内每个像素的颜色和不透明度,最后将这些颜色和不透明度进行混合,得到最终的渲染结果。

关键创新:最重要的技术创新点是在高斯基元中引入了空间变化的颜色和不透明度。与现有方法相比,SuperGaussians方法不再使用单一的颜色和不透明度来表示整个基元,而是允许这些属性在基元内部变化,从而可以更精细地表示场景的细节。这种空间变化的表示方式可以显著提高单个基元的表达能力,从而减少所需基元的数量。

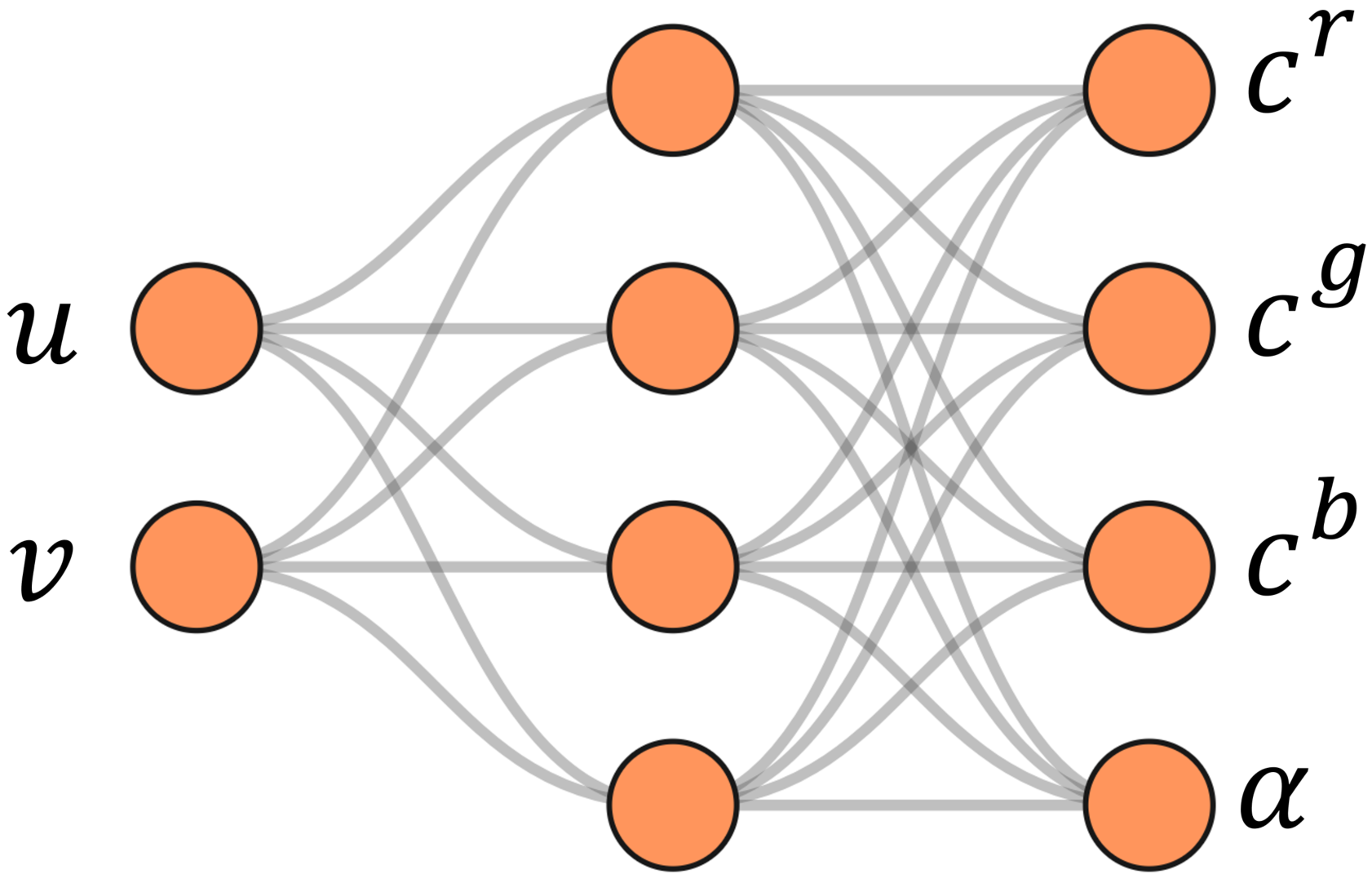

关键设计:论文实现了三种不同的空间变化函数:双线性插值、可移动核和微型神经网络。双线性插值使用四个角点的颜色和不透明度进行插值,简单高效。可移动核使用一组可学习的核函数来计算每个点的颜色和不透明度,具有更强的表达能力。微型神经网络使用一个小型神经网络来学习空间变化函数,可以表示更复杂的颜色和不透明度分布。损失函数包括渲染损失和正则化损失,用于优化高斯基元的参数和空间变化函数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SuperGaussians方法在多个数据集上优于基线方法。特别是,使用可移动核作为空间变化函数时,在合成新视角图像的PSNR和SSIM指标上均取得了显著提升。例如,在某个数据集上,使用可移动核的SuperGaussians方法比基线方法提高了超过1dB的PSNR。

🎯 应用场景

SuperGaussians方法可应用于各种需要高质量三维重建和新视角合成的场景,例如虚拟现实、增强现实、游戏开发、机器人导航和自动驾驶等。通过提高高斯溅射的表示效率,该方法可以减少存储空间和计算资源的需求,从而使得这些应用可以在资源受限的设备上运行,并实现更流畅的用户体验。未来,该方法还可以扩展到动态场景的重建和渲染。

📄 摘要(原文)

Gaussian Splattings demonstrate impressive results in multi-view reconstruction based on Gaussian explicit representations. However, the current Gaussian primitives only have a single view-dependent color and an opacity to represent the appearance and geometry of the scene, resulting in a non-compact representation. In this paper, we introduce a new method called SuperGaussians that utilizes spatially varying colors and opacity in a single Gaussian primitive to improve its representation ability. We have implemented bilinear interpolation, movable kernels, and even tiny neural networks as spatially varying functions. Quantitative and qualitative experimental results demonstrate that all three functions outperform the baseline, with the best movable kernels achieving superior novel view synthesis performance on multiple datasets, highlighting the strong potential of spatially varying functions.