Graph Canvas for Controllable 3D Scene Generation

作者: Libin Liu, Shen Chen, Sen Jia, Jingzhe Shi, Zhongyu Jiang, Can Jin, Wu Zongkai, Jenq-Neng Hwang, Lei Li

分类: cs.CV, cs.AI, cs.GR

发布日期: 2024-11-27 (更新: 2024-12-06)

🔗 代码/项目: GITHUB

💡 一句话要点

提出GraphCanvas3D框架,实现可控的、动态适应的3D场景生成。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 3D场景生成 图神经网络 上下文学习 可控生成 动态适应 4D场景 空间关系 人工智能

📋 核心要点

- 现有3D场景生成方法依赖预定义数据集,难以适应动态变化的空间关系,限制了其在复杂环境中的应用。

- GraphCanvas3D通过图结构表示场景,利用上下文学习实现动态适应,无需重新训练即可灵活调整场景。

- 实验结果表明,GraphCanvas3D在可用性、灵活性和适应性方面优于现有方法,并支持4D场景生成。

📝 摘要(中文)

本文提出了一种可编程、可扩展且适应性强的3D场景生成框架GraphCanvas3D,旨在解决现有方法依赖预定义数据集、难以动态适应空间关系变化的问题。GraphCanvas3D利用上下文学习实现动态适应,无需重新训练,支持灵活和可定制的场景创建。该框架采用分层的、图驱动的场景描述,将空间元素表示为图节点,并在3D环境中建立对象之间的一致关系。与传统方法不同,GraphCanvas3D允许即时进行无缝的对象操作和场景调整,无需预定义的输入掩码或重新训练。此外,GraphCanvas3D还支持4D场景生成,将时间动态性纳入考量以模拟随时间的变化。实验结果和用户研究表明,GraphCanvas3D增强了场景生成过程中的可用性、灵活性和适应性。

🔬 方法详解

问题定义:现有3D场景生成方法主要依赖于预定义的数据集,并且在适应动态空间关系变化方面存在困难。当需要修改场景或添加新的对象时,传统方法往往需要重新训练模型或者依赖于预定义的输入掩码,这限制了其灵活性和适应性。因此,如何实现一个可控的、能够动态适应变化的3D场景生成框架是一个重要的挑战。

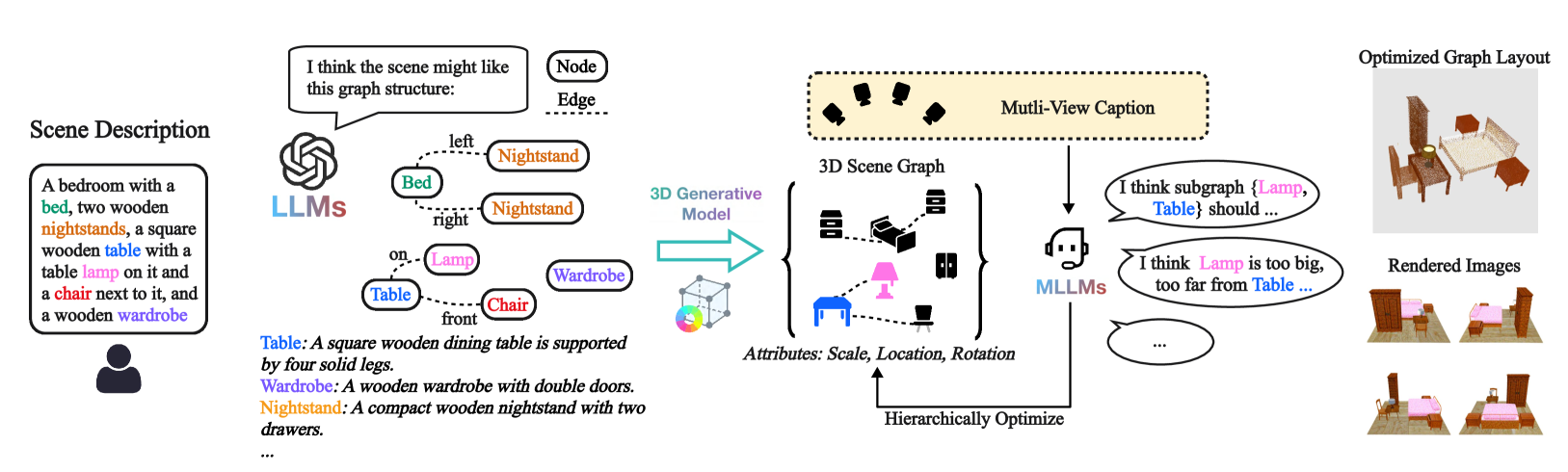

核心思路:GraphCanvas3D的核心思路是将3D场景表示为一个图结构,其中图的节点代表场景中的对象,边代表对象之间的空间关系。通过这种图结构的表示,可以方便地对场景进行编辑和修改。此外,GraphCanvas3D利用上下文学习,使得模型能够根据当前的场景上下文动态地调整生成策略,从而实现对场景的灵活控制和适应。

技术框架:GraphCanvas3D框架主要包含以下几个模块:1) 图构建模块:负责将3D场景解析为图结构,并建立对象之间的空间关系。2) 上下文学习模块:利用Transformer等模型学习场景的上下文信息,并根据上下文信息调整生成策略。3) 场景生成模块:根据图结构和上下文信息生成3D场景。4) 4D场景扩展模块:通过引入时间维度,支持4D场景的生成和编辑。

关键创新:GraphCanvas3D的关键创新在于其图驱动的场景表示和上下文学习机制。与传统的基于体素或点云的场景表示方法相比,图结构能够更好地表达对象之间的关系,并且更易于编辑和修改。上下文学习机制使得模型能够根据场景的上下文信息动态地调整生成策略,从而实现对场景的灵活控制和适应。

关键设计:GraphCanvas3D使用Transformer模型作为上下文学习模块的核心组件。图构建模块使用预训练的3D目标检测模型来识别场景中的对象,并使用空间关系推理模块来建立对象之间的关系。损失函数包括场景重建损失和关系一致性损失,用于保证生成场景的质量和关系的一致性。在4D场景扩展中,使用时间序列模型来建模对象随时间的变化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GraphCanvas3D在场景生成质量、用户可控性和动态适应性方面均优于现有方法。用户研究表明,用户能够使用GraphCanvas3D更方便地创建和编辑3D场景。此外,GraphCanvas3D在4D场景生成方面也取得了初步成果,能够模拟对象随时间的变化。

🎯 应用场景

GraphCanvas3D在虚拟现实、增强现实、游戏开发、机器人导航等领域具有广泛的应用前景。它可以用于创建逼真的虚拟环境,支持用户进行交互式场景编辑,并为机器人提供更丰富的环境感知信息。未来,该技术有望应用于自动驾驶、智能家居等领域,实现更智能化的场景理解和交互。

📄 摘要(原文)

Spatial intelligence is foundational to AI systems that interact with the physical world, particularly in 3D scene generation and spatial comprehension. Current methodologies for 3D scene generation often rely heavily on predefined datasets, and struggle to adapt dynamically to changing spatial relationships. In this paper, we introduce GraphCanvas3D, a programmable, extensible, and adaptable framework for controllable 3D scene generation. Leveraging in-context learning, GraphCanvas3D enables dynamic adaptability without the need for retraining, supporting flexible and customizable scene creation. Our framework employs hierarchical, graph-driven scene descriptions, representing spatial elements as graph nodes and establishing coherent relationships among objects in 3D environments. Unlike conventional approaches, which are constrained in adaptability and often require predefined input masks or retraining for modifications, GraphCanvas3D allows for seamless object manipulation and scene adjustments on the fly. Additionally, GraphCanvas3D supports 4D scene generation, incorporating temporal dynamics to model changes over time. Experimental results and user studies demonstrate that GraphCanvas3D enhances usability, flexibility, and adaptability for scene generation. Our code and models are available on the project website: https://github.com/ILGLJ/Graph-Canvas.