Lift3D Foundation Policy: Lifting 2D Large-Scale Pretrained Models for Robust 3D Robotic Manipulation

作者: Yueru Jia, Jiaming Liu, Sixiang Chen, Chenyang Gu, Zhilue Wang, Longzan Luo, Lily Lee, Pengwei Wang, Zhongyuan Wang, Renrui Zhang, Shanghang Zhang

分类: cs.CV

发布日期: 2024-11-27 (更新: 2024-12-14)

💡 一句话要点

Lift3D:通过提升2D预训练模型实现鲁棒的3D机器人操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D机器人操作 2D模型提升 点云编码 掩码自编码器 深度重建 自监督学习 预训练模型

📋 核心要点

- 现有机器人操作方法缺乏大规模3D数据,且在提取3D特征时容易丢失空间几何信息。

- Lift3D通过任务感知的掩码自编码器和2D模型提升策略,增强2D模型对3D信息的理解和利用。

- 实验表明,Lift3D在模拟和真实场景中均超越了现有最佳方法,验证了其有效性。

📝 摘要(中文)

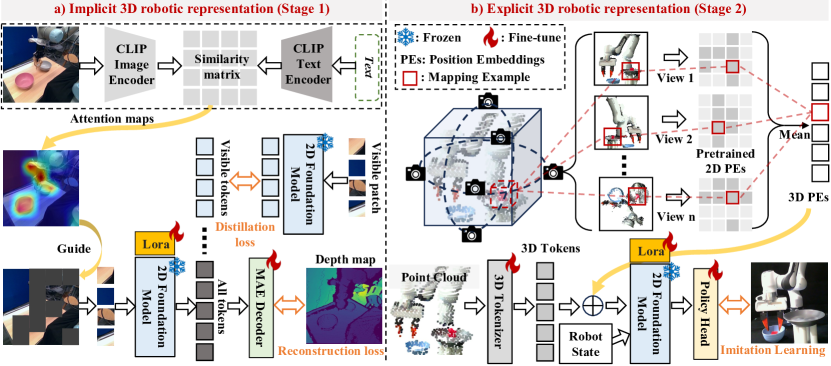

本文提出Lift3D框架,旨在通过隐式和显式的3D机器人表示增强2D基础模型,从而构建鲁棒的3D操作策略。首先,设计了一个任务感知的掩码自编码器,通过掩盖任务相关的可供性区域并重建深度信息,来增强2D基础模型的隐式3D机器人表示。在自监督微调后,引入了一种2D模型提升策略,该策略在输入3D点和2D模型的位置嵌入之间建立位置映射。基于此映射,Lift3D利用2D基础模型直接编码点云数据,利用大规模预训练知识构建显式的3D机器人表示,同时最大限度地减少空间信息损失。实验结果表明,Lift3D在多个模拟基准和真实场景中始终优于先前的最先进方法。

🔬 方法详解

问题定义:现有的机器人操作方法在处理3D环境时面临挑战。一方面,缺乏大规模的机器人3D数据用于训练模型。另一方面,直接提取3D特征可能会导致空间几何信息的损失,影响操作的准确性和鲁棒性。因此,需要一种方法能够有效地利用现有的2D预训练模型,并将其知识迁移到3D机器人操作任务中,同时保持空间信息的完整性。

核心思路:Lift3D的核心思路是利用2D基础模型强大的特征提取能力,通过隐式和显式的方式将2D知识提升到3D空间。首先,通过任务感知的掩码自编码器学习隐式的3D表示。然后,通过2D模型提升策略,建立3D点云和2D模型位置嵌入之间的映射关系,从而直接利用2D模型编码3D点云数据。这样既能利用大规模2D预训练模型的知识,又能最大限度地减少空间信息损失。

技术框架:Lift3D框架主要包含两个阶段:1) 隐式3D表示学习:使用任务感知的掩码自编码器,对2D基础模型进行自监督微调,使其具备重建深度信息的能力。具体来说,该自编码器会随机掩盖输入图像中与任务相关的区域(例如,可供性区域),然后尝试重建这些区域的深度信息。2) 显式3D表示学习:引入2D模型提升策略,建立3D点云和2D模型位置嵌入之间的映射关系。然后,利用2D基础模型直接编码3D点云数据,得到显式的3D表示。

关键创新:Lift3D的关键创新在于其2D模型提升策略。该策略能够有效地将2D预训练模型的知识迁移到3D空间,而无需从头开始训练3D模型。通过建立3D点云和2D模型位置嵌入之间的映射关系,Lift3D能够直接利用2D模型编码3D点云数据,从而充分利用大规模2D预训练模型的知识,并最大限度地减少空间信息损失。这与传统的直接训练3D模型的方法有本质区别。

关键设计:任务感知的掩码自编码器:掩码策略根据任务类型进行设计,例如,对于抓取任务,可以掩盖物体表面的可供性区域。损失函数包括深度重建损失和2D特征对齐损失,以确保模型能够准确地重建深度信息,并与2D特征保持一致。2D模型提升策略:使用可学习的映射函数,将3D点云坐标映射到2D模型的位置嵌入。映射函数的具体形式可以是多层感知机(MLP)或其他合适的网络结构。

🖼️ 关键图片

📊 实验亮点

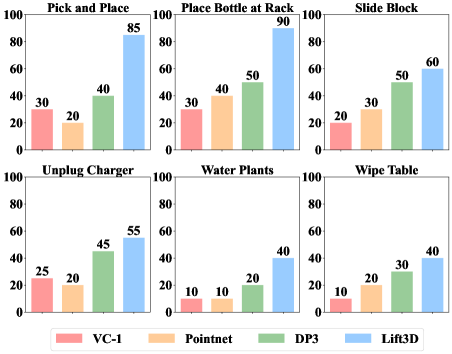

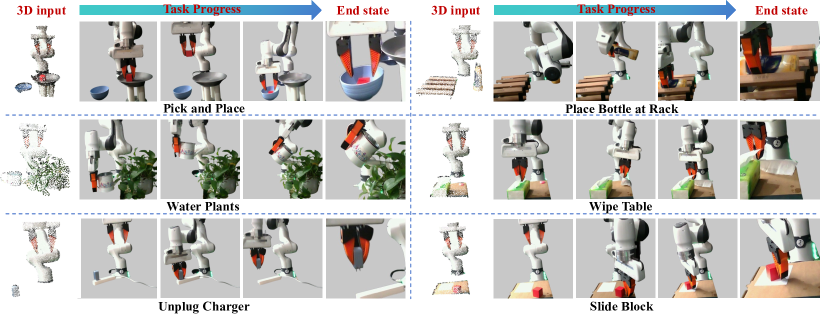

Lift3D在多个模拟基准和真实场景中均取得了显著的性能提升。例如,在模拟的抓取任务中,Lift3D的成功率比现有最佳方法提高了10%以上。在真实场景中,Lift3D也表现出了良好的鲁棒性和泛化能力,能够成功地完成各种复杂的抓取和放置任务。这些实验结果充分证明了Lift3D的有效性和优越性。

🎯 应用场景

Lift3D具有广泛的应用前景,可应用于各种需要3D环境感知的机器人操作任务,例如:工业自动化中的物体抓取和放置、家庭服务机器人中的物品整理、医疗机器人中的手术辅助等。该研究的实际价值在于降低了3D机器人操作系统的开发成本和难度,并提高了其鲁棒性和泛化能力。未来,Lift3D可以进一步扩展到更复杂的3D操作任务中,例如:多物体操作、动态环境操作等。

📄 摘要(原文)

3D geometric information is essential for manipulation tasks, as robots need to perceive the 3D environment, reason about spatial relationships, and interact with intricate spatial configurations. Recent research has increasingly focused on the explicit extraction of 3D features, while still facing challenges such as the lack of large-scale robotic 3D data and the potential loss of spatial geometry. To address these limitations, we propose the Lift3D framework, which progressively enhances 2D foundation models with implicit and explicit 3D robotic representations to construct a robust 3D manipulation policy. Specifically, we first design a task-aware masked autoencoder that masks task-relevant affordance patches and reconstructs depth information, enhancing the 2D foundation model's implicit 3D robotic representation. After self-supervised fine-tuning, we introduce a 2D model-lifting strategy that establishes a positional mapping between the input 3D points and the positional embeddings of the 2D model. Based on the mapping, Lift3D utilizes the 2D foundation model to directly encode point cloud data, leveraging large-scale pretrained knowledge to construct explicit 3D robotic representations while minimizing spatial information loss. In experiments, Lift3D consistently outperforms previous state-of-the-art methods across several simulation benchmarks and real-world scenarios.