XR-MBT: Multi-modal Full Body Tracking for XR through Self-Supervision with Learned Depth Point Cloud Registration

作者: Denys Rozumnyi, Nadine Bertsch, Othman Sbai, Filippo Arcadu, Yuhua Chen, Artsiom Sanakoyeu, Manoj Kumar, Catherine Herold, Robin Kips

分类: cs.CV, cs.LG

发布日期: 2024-11-27

备注: Accepted to WACV 2025

💡 一句话要点

提出XR-MBT,利用自监督学习和深度点云配准实现XR设备中的多模态全身追踪。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱六:视频提取与匹配 (Video Extraction)

关键词: XR身体追踪 多模态融合 自监督学习 深度点云配准 姿态估计

📋 核心要点

- 现有XR身体追踪方法依赖头部和控制器信号合成全身运动,缺乏腿部追踪能力,且无法有效利用XR设备提供的深度信息。

- XR-MBT利用自监督学习,结合深度点云配准,训练多模态姿态估计模型,实现XR设备中的全身运动追踪。

- 实验表明,XR-MBT能够准确追踪各种身体运动,首次在XR中实现腿部追踪,优于传统合成方法。

📝 摘要(中文)

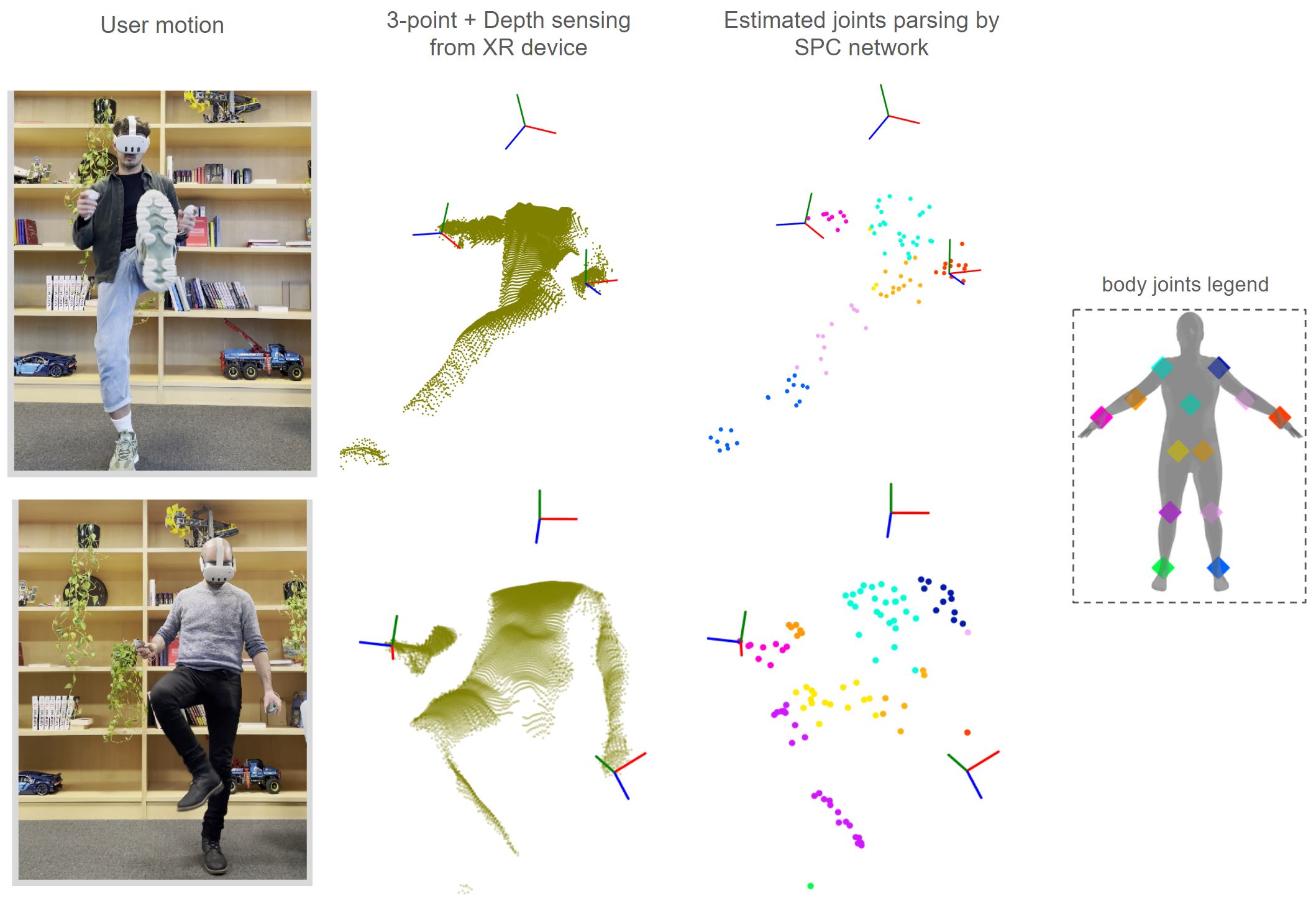

在XR(AR/VR)设备中追踪用户的全身运动是实现真实社交存在感的关键挑战。由于缺乏专用的腿部传感器,现有的身体追踪方法通常采用合成方法,根据头部和控制器的3点信号生成合理的运动。为了实现混合现实功能,现代XR设备能够利用传感器和机器学习模型估计头显周围的深度信息。然而,这种以自我为中心的深度感知无法直接驱动身体,因为它没有经过配准,并且由于有限的视野和身体自遮挡而不完整。本文首次提出利用可用的深度感知信号结合自监督学习,训练一个多模态姿态估计模型,能够在XR设备上实时追踪全身运动。本文展示了如何使用语义点云编码器网络和残差网络将当前的3点运动合成模型扩展到点云模态,这些模块以自监督的方式联合训练,利用真实未配准的点云和从运动捕捉获得的模拟数据。本文将提出的方法与几种最先进的XR身体追踪系统进行了比较,结果表明该方法能够准确地追踪各种身体运动。XR-MBT首次在XR中追踪腿部,而传统的基于部分身体追踪的合成方法无法做到这一点。

🔬 方法详解

问题定义:现有XR身体追踪方法主要依赖头部和控制器的3点信号进行运动合成,无法直接感知和追踪腿部运动。同时,XR设备提供的深度信息由于未配准和不完整,难以直接用于驱动身体运动。因此,如何有效利用XR设备的深度感知能力,实现准确的全身运动追踪,特别是腿部追踪,是本文要解决的问题。

核心思路:本文的核心思路是利用自监督学习,将XR设备提供的深度点云信息与3点运动信号相结合,训练一个多模态姿态估计模型。通过自监督的方式,模型可以学习到深度点云与身体姿态之间的对应关系,从而实现从深度信息中推断全身运动。

技术框架:XR-MBT的技术框架主要包含以下几个模块:1) 语义点云编码器:用于提取深度点云的语义特征。2) 残差网络:用于融合3点运动信号和点云特征,进行多模态姿态估计。3) 自监督训练框架:利用真实未配准的点云和模拟数据,联合训练上述模块。整体流程是,首先利用语义点云编码器提取深度点云的特征,然后将该特征与3点运动信号一起输入到残差网络中,得到全身姿态估计结果。最后,利用自监督损失函数优化整个模型。

关键创新:本文最重要的技术创新点在于将深度点云信息引入到XR身体追踪中,并利用自监督学习的方式训练多模态姿态估计模型。与传统的基于3点信号的运动合成方法相比,XR-MBT能够直接感知环境中的深度信息,从而实现更准确的全身运动追踪,特别是腿部追踪。

关键设计:在网络结构方面,语义点云编码器可以采用PointNet++等经典的点云处理网络。残差网络的设计需要考虑如何有效地融合3点运动信号和点云特征。在损失函数方面,可以采用运动学约束、穿透惩罚等方法来提高姿态估计的准确性。自监督训练数据的生成也是一个关键的设计,需要考虑如何生成具有真实感的模拟数据,并保证模拟数据与真实数据之间的一致性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,XR-MBT能够准确追踪各种身体运动,包括腿部运动,这是传统方法无法实现的。与最先进的XR身体追踪系统相比,XR-MBT在姿态估计的准确性和鲁棒性方面均有显著提升。具体性能数据未知,但论文强调了其在腿部追踪方面的突破性进展。

🎯 应用场景

XR-MBT可广泛应用于AR/VR社交、游戏、运动康复等领域。通过提供更准确的全身追踪,可以增强用户的沉浸感和社交体验。在运动康复领域,可以用于评估和指导患者的运动,提高康复效果。未来,该技术有望与更多传感器融合,实现更鲁棒和精确的全身追踪。

📄 摘要(原文)

Tracking the full body motions of users in XR (AR/VR) devices is a fundamental challenge to bring a sense of authentic social presence. Due to the absence of dedicated leg sensors, currently available body tracking methods adopt a synthesis approach to generate plausible motions given a 3-point signal from the head and controller tracking. In order to enable mixed reality features, modern XR devices are capable of estimating depth information of the headset surroundings using available sensors combined with dedicated machine learning models. Such egocentric depth sensing cannot drive the body directly, as it is not registered and is incomplete due to limited field-of-view and body self-occlusions. For the first time, we propose to leverage the available depth sensing signal combined with self-supervision to learn a multi-modal pose estimation model capable of tracking full body motions in real time on XR devices. We demonstrate how current 3-point motion synthesis models can be extended to point cloud modalities using a semantic point cloud encoder network combined with a residual network for multi-modal pose estimation. These modules are trained jointly in a self-supervised way, leveraging a combination of real unregistered point clouds and simulated data obtained from motion capture. We compare our approach against several state-of-the-art systems for XR body tracking and show that our method accurately tracks a diverse range of body motions. XR-MBT tracks legs in XR for the first time, whereas traditional synthesis approaches based on partial body tracking are blind.