From Open Vocabulary to Open World: Teaching Vision Language Models to Detect Novel Objects

作者: Zizhao Li, Zhengkang Xiang, Joseph West, Kourosh Khoshelham

分类: cs.CV, cs.AI

发布日期: 2024-11-27 (更新: 2025-03-21)

💡 一句话要点

提出OWEL和MSCAL,使开放词汇物体检测模型具备开放世界物体检测能力

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 开放世界物体检测 开放词汇物体检测 伪未知嵌入 多尺度对比学习 增量学习 分布外检测 自动驾驶

📋 核心要点

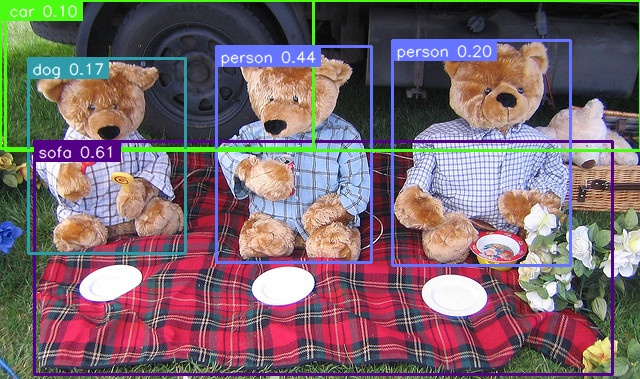

- 现有开放词汇物体检测(OVD)依赖精确提示,易错分近分布外(NOOD)和忽略远分布外(FOOD)物体。

- 提出开放世界嵌入学习(OWEL)和多尺度对比锚学习(MSCAL),实现对未知物体的识别和增量学习。

- 在开放世界物体检测和自动驾驶基准测试中,该方法取得了领先性能,并保持了原有的开放词汇检测能力。

📝 摘要(中文)

传统的物体检测方法基于闭集假设,只能检测训练集中预定义的固定数量的物体。最近的开放词汇物体检测(OVD)工作能够检测原则上由无限词汇表定义的物体,从而降低了特定任务训练模型的成本。然而,OVD严重依赖于“oracle”提供的准确提示,这限制了它们在驾驶场景感知等关键应用中的使用。OVD模型倾向于错误分类与已知类别具有相似特征的近分布外(NOOD)物体,并忽略远分布外(FOOD)物体。为了解决这些限制,我们提出了一个框架,通过识别和增量学习先前未见过的物体,使OVD模型能够在开放世界环境中运行。为了检测FOOD物体,我们提出了开放世界嵌入学习(OWEL),并引入了伪未知嵌入的概念,该概念基于已知类别的信息推断连续语义空间中未知类别的位置。我们还提出了多尺度对比锚学习(MSCAL),它通过提高不同尺度下物体嵌入的类内一致性,从而能够识别被错误分类的未知物体。所提出的方法在标准开放世界物体检测和自动驾驶基准上实现了最先进的性能,同时保持了其开放词汇物体检测能力。

🔬 方法详解

问题定义:论文旨在解决开放词汇物体检测(OVD)在开放世界场景下的局限性。现有的OVD方法依赖于精确的文本提示,无法有效处理未见过的物体,尤其是在分布之外(Out-of-Distribution, OOD)的物体上表现不佳。具体来说,近分布外(NOOD)物体容易被错误分类,而远分布外(FOOD)物体则会被直接忽略。这种局限性阻碍了OVD在自动驾驶等实际场景中的应用。

核心思路:论文的核心思路是通过学习已知类别的语义空间信息,推断未知类别在语义空间中的位置,从而实现对未知物体的检测和识别。具体而言,通过引入“伪未知嵌入”的概念,将未知类别嵌入到已知的语义空间中,并利用多尺度对比学习来提高物体嵌入的类内一致性,从而区分已知和未知物体。

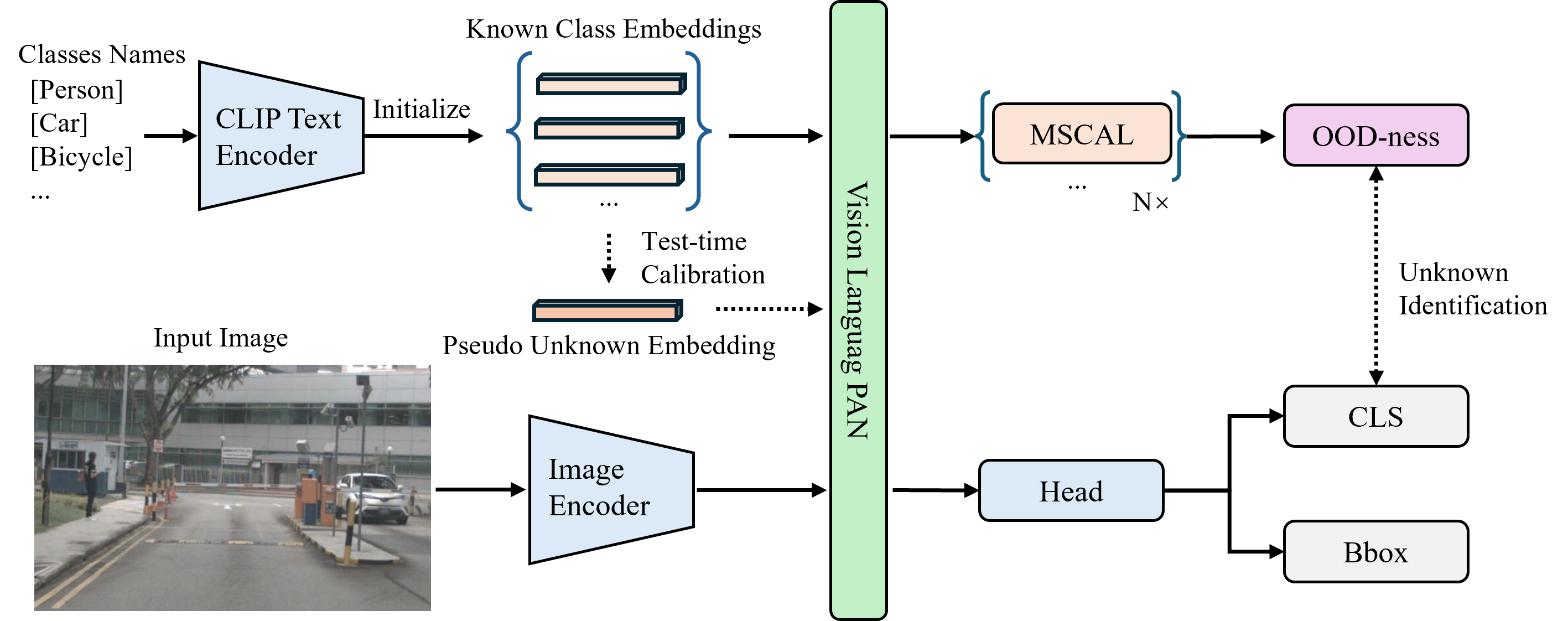

技术框架:该框架主要包含两个核心模块:开放世界嵌入学习(OWEL)和多尺度对比锚学习(MSCAL)。OWEL负责学习已知类别的嵌入表示,并生成伪未知嵌入,用于表示未知类别。MSCAL则通过在不同尺度上进行对比学习,提高物体嵌入的类内一致性,从而区分已知和未知物体。整体流程是,首先使用OWEL生成伪未知嵌入,然后利用MSCAL对物体进行分类和识别,最后对识别出的未知物体进行增量学习。

关键创新:该论文的关键创新在于提出了开放世界嵌入学习(OWEL)和多尺度对比锚学习(MSCAL)。OWEL通过引入伪未知嵌入,解决了OVD无法检测未知物体的问题。MSCAL通过多尺度对比学习,提高了物体嵌入的鲁棒性和区分性,从而有效区分已知和未知物体。与现有方法相比,该方法无需预先定义所有可能的物体类别,能够适应开放世界场景下的物体检测任务。

关键设计:OWEL的关键设计在于伪未知嵌入的生成方式,它基于已知类别的语义信息,推断未知类别在语义空间中的位置。MSCAL的关键设计在于多尺度对比学习的实现方式,它通过在不同尺度上进行对比学习,提高了物体嵌入的类内一致性。具体的损失函数包括对比损失和分类损失,用于优化物体嵌入的表示和分类器的性能。网络结构方面,采用了标准的物体检测网络,并在此基础上添加了OWEL和MSCAL模块。

🖼️ 关键图片

📊 实验亮点

该方法在开放世界物体检测和自动驾驶基准测试中取得了最先进的性能。具体而言,在标准数据集上,该方法相比现有方法在未知物体检测的准确率上提升了显著幅度,同时保持了对已知物体的检测精度。实验结果表明,该方法能够有效识别和检测未知物体,并具有良好的泛化能力。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、智能监控等领域。在自动驾驶中,该方法能够检测并识别道路上未知的障碍物,提高驾驶安全性。在机器人导航中,该方法能够帮助机器人识别新的环境物体,提高导航的准确性和鲁棒性。在智能监控中,该方法能够检测异常事件和未知物体,提高监控系统的智能化水平。

📄 摘要(原文)

Traditional object detection methods operate under the closed-set assumption, where models can only detect a fixed number of objects predefined in the training set. Recent works on open vocabulary object detection (OVD) enable the detection of objects defined by an in-principle unbounded vocabulary, which reduces the cost of training models for specific tasks. However, OVD heavily relies on accurate prompts provided by an ``oracle'', which limits their use in critical applications such as driving scene perception. OVD models tend to misclassify near-out-of-distribution (NOOD) objects that have similar features to known classes, and ignore far-out-of-distribution (FOOD) objects. To address these limitations, we propose a framework that enables OVD models to operate in open world settings, by identifying and incrementally learning previously unseen objects. To detect FOOD objects, we propose Open World Embedding Learning (OWEL) and introduce the concept of Pseudo Unknown Embedding which infers the location of unknown classes in a continuous semantic space based on the information of known classes. We also propose Multi-Scale Contrastive Anchor Learning (MSCAL), which enables the identification of misclassified unknown objects by promoting the intra-class consistency of object embeddings at different scales. The proposed method achieves state-of-the-art performance on standard open world object detection and autonomous driving benchmarks while maintaining its open vocabulary object detection capability.