PersonaCraft: Personalized and Controllable Full-Body Multi-Human Scene Generation Using Occlusion-Aware 3D-Conditioned Diffusion

作者: Gwanghyun Kim, Suh Yoon Jeon, Seunggyu Lee, Se Young Chun

分类: cs.CV, cs.AI

发布日期: 2024-11-27 (更新: 2025-03-14)

备注: Project page: https://gwang-kim.github.io/persona_craft

💡 一句话要点

PersonaCraft:基于遮挡感知3D条件扩散的多人全身个性化场景生成

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 图像生成 扩散模型 3D人体建模 个性化定制 遮挡处理 SMPLx ControlNet

📋 核心要点

- 现有方法在处理多人场景中严重的遮挡问题时,以及实现全身的个性化定制方面存在局限性,主要原因是缺乏对3D几何信息的有效利用。

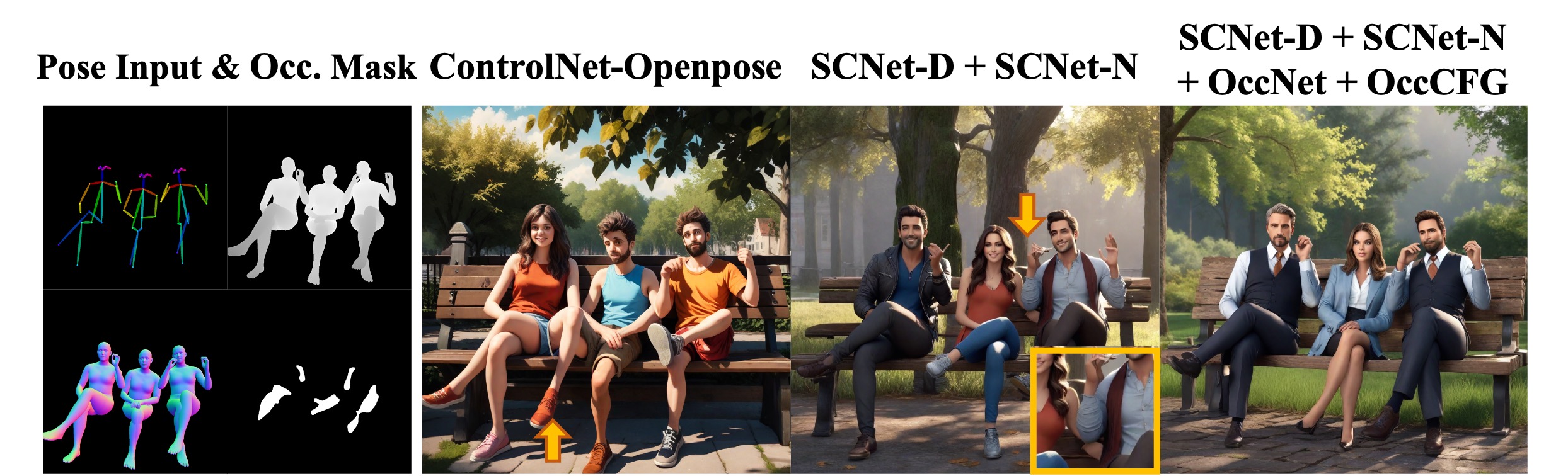

- PersonaCraft的核心思想是将扩散模型与3D人体建模相结合,利用SMPLx-ControlNet,通过深度和法线等3D信息实现更鲁棒的姿态控制和解剖结构一致性。

- 实验结果表明,PersonaCraft在生成高质量、多人图像方面显著优于现有方法,尤其是在个性化定制和遮挡处理方面表现出色。

📝 摘要(中文)

本文提出PersonaCraft,一个可控且对遮挡鲁棒的框架,用于在复杂场景中生成多个个体的全身个性化图像。现有方法难以处理严重遮挡和全身个性化,因为2D姿态条件缺乏3D几何信息,导致模糊的遮挡和解剖结构扭曲,并且许多方法只关注面部身份。相比之下,PersonaCraft将扩散模型与3D人体建模相结合,采用SMPLx-ControlNet,利用深度和法线贴图等3D几何信息进行鲁棒的3D感知姿态条件和增强的解剖结构一致性。为了处理细粒度的遮挡,我们提出了遮挡边界增强网络,该网络利用深度边缘信号进行以遮挡为中心的训练,以及遮挡感知无分类器引导策略,该策略选择性地加强遮挡区域的条件作用,而不影响未遮挡区域。PersonaCraft可以与Face Identity ControlNet无缝结合,实现全身多人个性化,从而超越了先前仅关注面部身份的方法。我们基于SMPLx形状参数和文本细化的双路径身体形状表示,能够实现精确的全身个性化和灵活的用户自定义身体形状调整。大量的定量实验和用户研究表明,PersonaCraft在生成高质量、多人图像方面明显优于现有方法,具有准确的个性化和强大的遮挡处理能力。

🔬 方法详解

问题定义:现有方法在多人场景图像生成中,难以同时实现全身个性化和对复杂遮挡的鲁棒处理。2D姿态作为条件输入缺乏3D几何信息,导致生成的图像在遮挡区域出现解剖结构错误和不一致性。此外,许多方法仅关注面部个性化,忽略了全身的个性化需求。

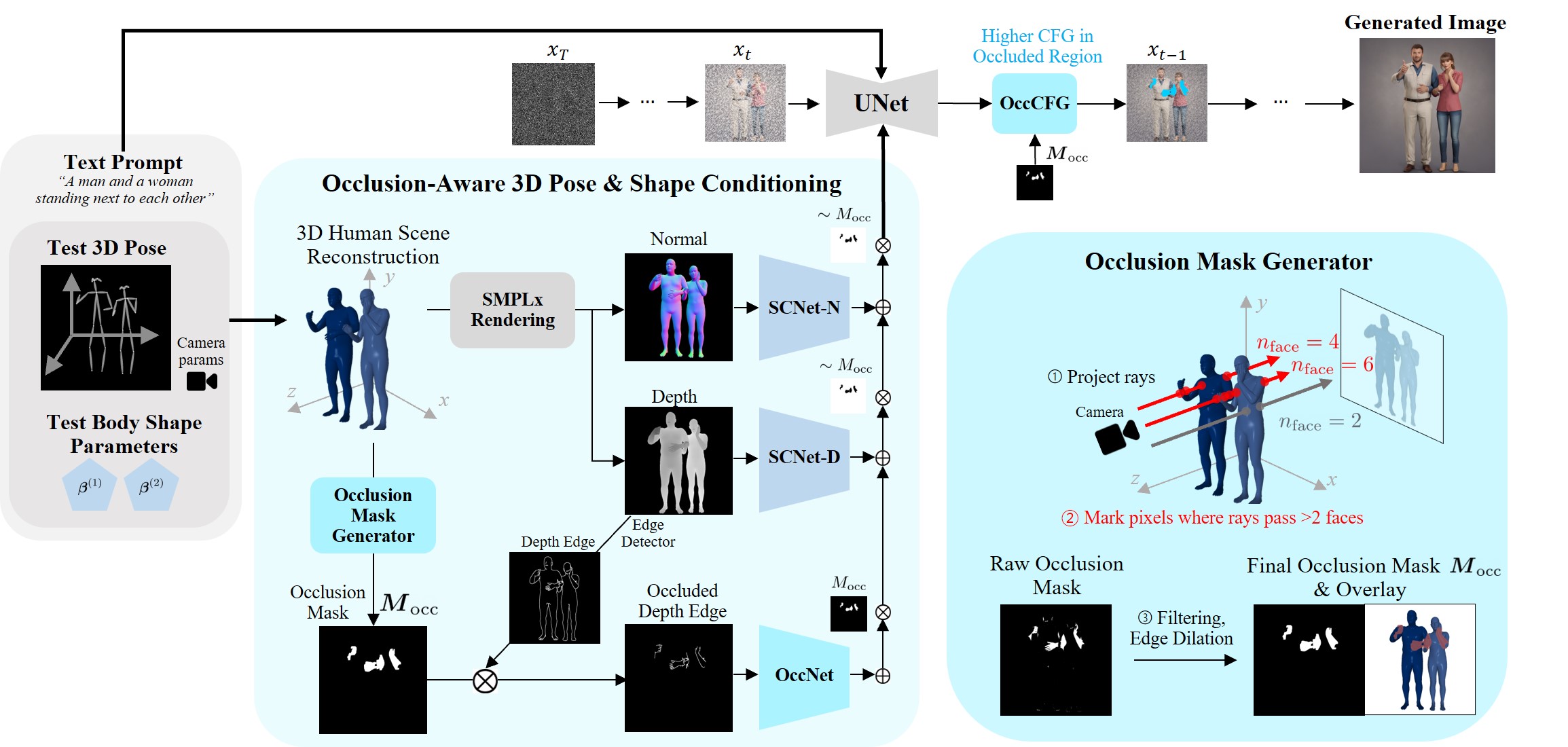

核心思路:PersonaCraft的核心思路是利用3D人体模型(SMPLx)提供的几何信息,结合扩散模型,实现对人体姿态和形状的精确控制。通过引入深度和法线贴图作为额外的条件输入,增强模型对3D结构的理解,从而更好地处理遮挡问题,并实现全身的个性化定制。

技术框架:PersonaCraft的整体框架包含以下几个主要模块:1) SMPLx-ControlNet:利用SMPLx模型生成3D人体姿态和形状参数,并将其转化为深度和法线贴图,作为ControlNet的条件输入。2) 遮挡边界增强网络:用于增强深度图中的遮挡边界信息,提高模型对遮挡区域的感知能力。3) 遮挡感知无分类器引导:一种新的引导策略,选择性地加强遮挡区域的条件作用,从而在不影响未遮挡区域的情况下,更好地处理遮挡问题。4) Face Identity ControlNet:用于控制生成人脸的身份信息,实现全身的个性化定制。

关键创新:PersonaCraft的关键创新在于:1) 提出了基于3D几何信息的姿态控制方法,有效解决了2D姿态控制在遮挡场景下的不足。2) 提出了遮挡边界增强网络和遮挡感知无分类器引导策略,显著提高了模型对遮挡的处理能力。3) 实现了全身的个性化定制,超越了以往仅关注面部个性化的方法。

关键设计:1) SMPLx-ControlNet:使用预训练的SMPLx模型生成人体姿态和形状参数,并将其转化为深度和法线贴图。2) 遮挡边界增强网络:采用U-Net结构,以深度图作为输入,输出增强后的遮挡边界信息。3) 遮挡感知无分类器引导:根据遮挡区域的概率图,动态调整条件作用的强度。4) 损失函数:采用L1损失和感知损失,优化生成图像的质量和真实感。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PersonaCraft在多人图像生成任务中,显著优于现有的方法。在个性化定制方面,PersonaCraft能够生成具有高度个性化外观的图像,并且能够精确控制人体的姿态和形状。在遮挡处理方面,PersonaCraft能够有效地处理复杂的遮挡情况,生成具有真实感的图像。用户研究也表明,PersonaCraft生成的图像在视觉质量和真实感方面都优于现有方法。

🎯 应用场景

PersonaCraft具有广泛的应用前景,例如虚拟现实/增强现实内容创作、游戏角色定制、虚拟服装试穿、以及电影和动画制作等领域。该技术能够帮助用户轻松创建具有个性化外观和姿态的虚拟角色,并将其放置在复杂的场景中,极大地提升了内容创作的效率和质量。未来,该技术有望应用于更广泛的领域,例如社交媒体、在线教育和远程协作等。

📄 摘要(原文)

We present PersonaCraft, a framework for controllable and occlusion-robust full-body personalized image synthesis of multiple individuals in complex scenes. Current methods struggle with occlusion-heavy scenarios and complete body personalization, as 2D pose conditioning lacks 3D geometry, often leading to ambiguous occlusions and anatomical distortions, and many approaches focus solely on facial identity. In contrast, our PersonaCraft integrates diffusion models with 3D human modeling, employing SMPLx-ControlNet, to utilize 3D geometry like depth and normal maps for robust 3D-aware pose conditioning and enhanced anatomical coherence. To handle fine-grained occlusions, we propose Occlusion Boundary Enhancer Network that exploits depth edge signals with occlusion-focused training, and Occlusion-Aware Classifier-Free Guidance strategy that selectively reinforces conditioning in occluded regions without affecting unoccluded areas. PersonaCraft can seamlessly be combined with Face Identity ControlNet, achieving full-body multi-human personalization and thus marking a significant advancement beyond prior approaches that concentrate only on facial identity. Our dual-pathway body shape representation with SMPLx-based shape parameters and textual refinement, enables precise full-body personalization and flexible user-defined body shape adjustments. Extensive quantitative experiments and user studies demonstrate that PersonaCraft significantly outperforms existing methods in generating high-quality, multi-person images with accurate personalization and robust occlusion handling.