Multimodal Outer Arithmetic Block Dual Fusion of Whole Slide Images and Omics Data for Precision Oncology

作者: Omnia Alwazzan, Amaya Gallagher-Syed, Thomas O. Millner, Sebastian Brandner, Ioannis Patras, Silvia Marino, Gregory Slabaugh

分类: cs.CV

发布日期: 2024-11-26 (更新: 2024-12-11)

备注: Revised to 10 pages, with corrected typos, updated references (some added, others removed), improved figure quality, modified text for better method validation, added one more co-author, and identified the IEEE member

💡 一句话要点

提出基于双重融合的多模态外积算术块方法,提升WSI与基因组学数据融合的肿瘤亚型诊断精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 全切片图像 基因组学数据 肿瘤亚型分类 生存预测

📋 核心要点

- 现有方法在融合WSI和基因组学数据时,通常只采用早期或晚期融合,忽略了双重融合的潜力。

- 该论文提出一种双重融合策略,在早期融合阶段将基因组学信息嵌入WSI patch,晚期融合阶段使用MOAB重新引入基因组学数据。

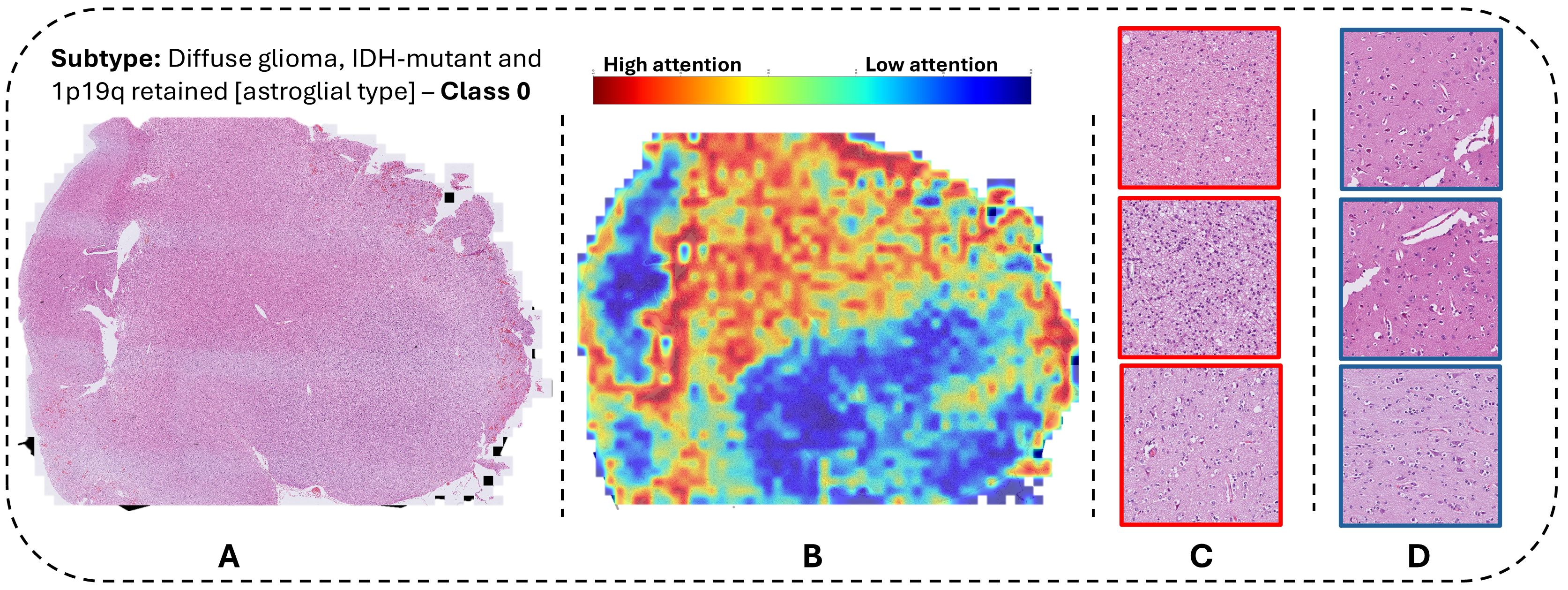

- 实验结果表明,该方法在CNS肿瘤亚型分类和生存预测方面均优于或达到当前最优水平,并提升了模型的可解释性。

📝 摘要(中文)

本研究探索了DNA甲基化数据与全切片图像(WSI)融合在提高中枢神经系统(CNS)肿瘤分类诊断精度方面的潜力。现有方法通常在早期或晚期融合阶段整合编码后的基因组学数据与组织学信息,而本研究探索了通过双重融合重新引入基因组学数据的潜力。论文提出了一种在早期和晚期融合阶段使用基因组学嵌入的方法,以捕获从局部(patch级别)到全局(slide级别)交互的互补信息,并通过多模态整合提高性能。在早期融合阶段,基因组学嵌入被投影到WSI patch的潜在空间中,生成包含每个patch分子和形态学信息的嵌入,从而有效地将基因组学信息整合到WSI的空间表示中。然后,使用多示例学习门控注意力机制细化这些嵌入,该机制关注诊断性patch。在晚期融合阶段,通过使用多模态外积算术块(MOAB)将基因组学数据与slide级别的基因组学-WSI嵌入融合,从而重新引入基因组学数据,MOAB丰富地混合了来自两种模态的特征,捕捉它们的关联性和互补性。在20个细粒度亚型的CNS肿瘤亚型分类中验证了该方法的准确性,并在基准数据集上验证了该方法,在TCGA-BLCA上实现了改进的生存预测,并在TCGA-BRCA上实现了与最先进方法相比具有竞争力的性能。这种双重融合策略增强了解释性和分类性能,突出了其在临床诊断中的潜力。

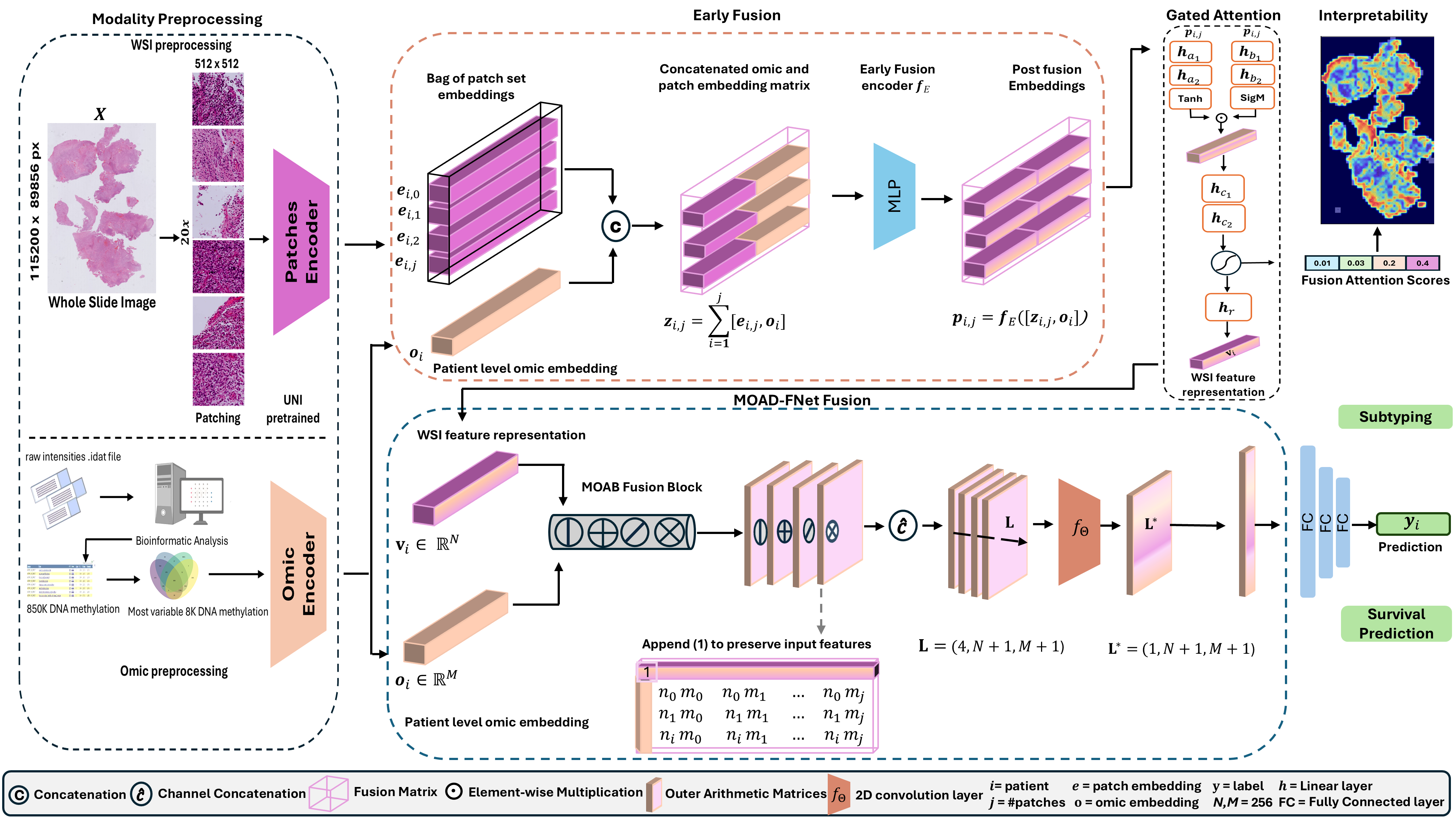

🔬 方法详解

问题定义:论文旨在解决如何更有效地融合全切片图像(WSI)和基因组学数据,以提高中枢神经系统(CNS)肿瘤亚型分类的准确性和生存预测能力。现有方法的痛点在于,要么只在早期融合,要么只在晚期融合,无法充分利用两种模态数据的互补信息。

核心思路:论文的核心思路是采用双重融合策略,即在早期融合阶段将基因组学信息嵌入到WSI的patch级别特征中,然后在晚期融合阶段再次将基因组学信息与slide级别的WSI特征进行融合。这种双重融合的设计旨在捕获从局部到全局的模态间交互信息,从而更全面地利用两种模态数据的优势。

技术框架:整体框架包含以下几个主要阶段:1) 早期融合:将基因组学嵌入投影到WSI patch的潜在空间,生成包含分子和形态学信息的patch嵌入;2) 多示例学习:使用门控注意力机制选择具有诊断意义的patch;3) 晚期融合:使用MOAB将slide级别的WSI特征和基因组学数据进行融合;4) 分类/预测:基于融合后的特征进行肿瘤亚型分类或生存预测。

关键创新:最重要的技术创新点在于双重融合策略和MOAB的使用。双重融合能够更全面地利用WSI和基因组学数据的互补信息,而MOAB则能够有效地混合两种模态的特征,捕捉它们之间的关联性和互补性。与现有方法相比,该方法能够更好地整合局部和全局的模态间信息。

关键设计:早期融合阶段,基因组学嵌入通过线性投影或其他非线性变换映射到WSI patch的特征空间。多示例学习中,注意力机制的权重由门控网络学习得到,用于选择重要的patch。MOAB的具体结构未知,但其核心思想是通过外积运算和算术运算来混合两种模态的特征。损失函数包括分类损失(如交叉熵损失)和生存预测损失(如Cox比例风险损失)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在20个细粒度亚型的CNS肿瘤亚型分类中取得了优异的准确性。在TCGA-BLCA数据集上,该方法实现了改进的生存预测。在TCGA-BRCA数据集上,该方法取得了与当前最优方法相比具有竞争力的性能。这些结果验证了双重融合策略和MOAB的有效性。

🎯 应用场景

该研究成果可应用于精准肿瘤学领域,辅助病理医生进行更准确的CNS肿瘤亚型诊断和预后评估。通过整合WSI和基因组学数据,可以为患者提供更个性化的治疗方案,提高治疗效果。未来,该方法有望推广到其他类型的癌症诊断和预测中。

📄 摘要(原文)

The integration of DNA methylation data with a Whole Slide Image (WSI) offers significant potential for enhancing the diagnostic precision of central nervous system (CNS) tumor classification in neuropathology. While existing approaches typically integrate encoded omic data with histology at either an early or late fusion stage, the potential of reintroducing omic data through dual fusion remains unexplored. In this paper, we propose the use of omic embeddings during early and late fusion to capture complementary information from local (patch-level) to global (slide-level) interactions, boosting performance through multimodal integration. In the early fusion stage, omic embeddings are projected onto WSI patches in latent-space, which generates embeddings that encapsulate per-patch molecular and morphological insights. This effectively incorporates omic information into the spatial representation of the WSI. These embeddings are then refined with a Multiple Instance Learning gated attention mechanism which attends to diagnostic patches. In the late fusion stage, we reintroduce the omic data by fusing it with slide-level omic-WSI embeddings using a Multimodal Outer Arithmetic Block (MOAB), which richly intermingles features from both modalities, capturing their correlations and complementarity. We demonstrate accurate CNS tumor subtyping across 20 fine-grained subtypes and validate our approach on benchmark datasets, achieving improved survival prediction on TCGA-BLCA and competitive performance on TCGA-BRCA compared to state-of-the-art methods. This dual fusion strategy enhances interpretability and classification performance, highlighting its potential for clinical diagnostics.