HEIE: MLLM-Based Hierarchical Explainable AIGC Image Implausibility Evaluator

作者: Fan Yang, Ru Zhen, Jianing Wang, Yanhao Zhang, Haoxiang Chen, Haonan Lu, Sicheng Zhao, Guiguang Ding

分类: cs.CV, cs.AI

发布日期: 2024-11-26 (更新: 2025-05-30)

备注: Accepted by CVPR 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出HEIE:基于MLLM的分层可解释AIGC图像不合理性评估器

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AIGC图像质量评估 多模态大语言模型 可解释性 缺陷定位 分层热图预测

📋 核心要点

- 现有AIGC图像质量评估方法缺乏可解释性,难以解释细微缺陷,且泛化能力不足。

- HEIE利用MLLM,通过CoT驱动的三位一体评估器和自适应分层不合理性映射器,实现可解释的缺陷定位。

- 实验结果表明,HEIE在AIGC图像不合理性评估任务上取得了state-of-the-art的性能。

📝 摘要(中文)

AIGC图像在各个领域广泛应用,但常存在伪影和不自然纹理等质量问题。现有模型旨在预测缺陷区域热图,但面临两个主要挑战:(1)缺乏可解释性,无法提供细微缺陷的原因和分析;(2)无法利用常识和逻辑推理,导致泛化能力差。多模态大语言模型(MLLM)有望提供更好的理解和推理能力,但也面临挑战:(1)由于捕获细节能力有限,难以进行细粒度缺陷定位;(2)难以提供精确热图所需的像素级输出。为了解决这些挑战,我们提出HEIE:一种新的基于MLLM的分层可解释图像不合理性评估器。我们引入了CoT驱动的可解释三位一体评估器,集成了热图、分数和解释输出,使用CoT将复杂任务分解为难度递增的子任务,并增强可解释性。我们的自适应分层不合理性映射器将低级图像特征与来自LLM的高级映射器token协同作用,通过基于不确定性的自适应token方法实现精确的局部到全局分层热图预测。此外,我们提出了一个新的数据集:Expl-AIGI-Eval,旨在促进AIGC图像的可解释不合理性评估。大量实验表明,我们的方法表现出最先进的性能。

🔬 方法详解

问题定义:论文旨在解决AIGC图像质量评估中,现有方法缺乏可解释性,无法提供细粒度缺陷分析,且泛化能力不足的问题。现有方法主要依赖于缺陷区域热图预测,但难以解释缺陷产生的原因,也无法有效利用常识和逻辑推理来提升评估的准确性。

核心思路:论文的核心思路是利用多模态大语言模型(MLLM)的强大理解和推理能力,结合图像特征,实现可解释的AIGC图像不合理性评估。通过将复杂任务分解为多个子任务,并结合热图、分数和解释输出,提升评估的可解释性和准确性。

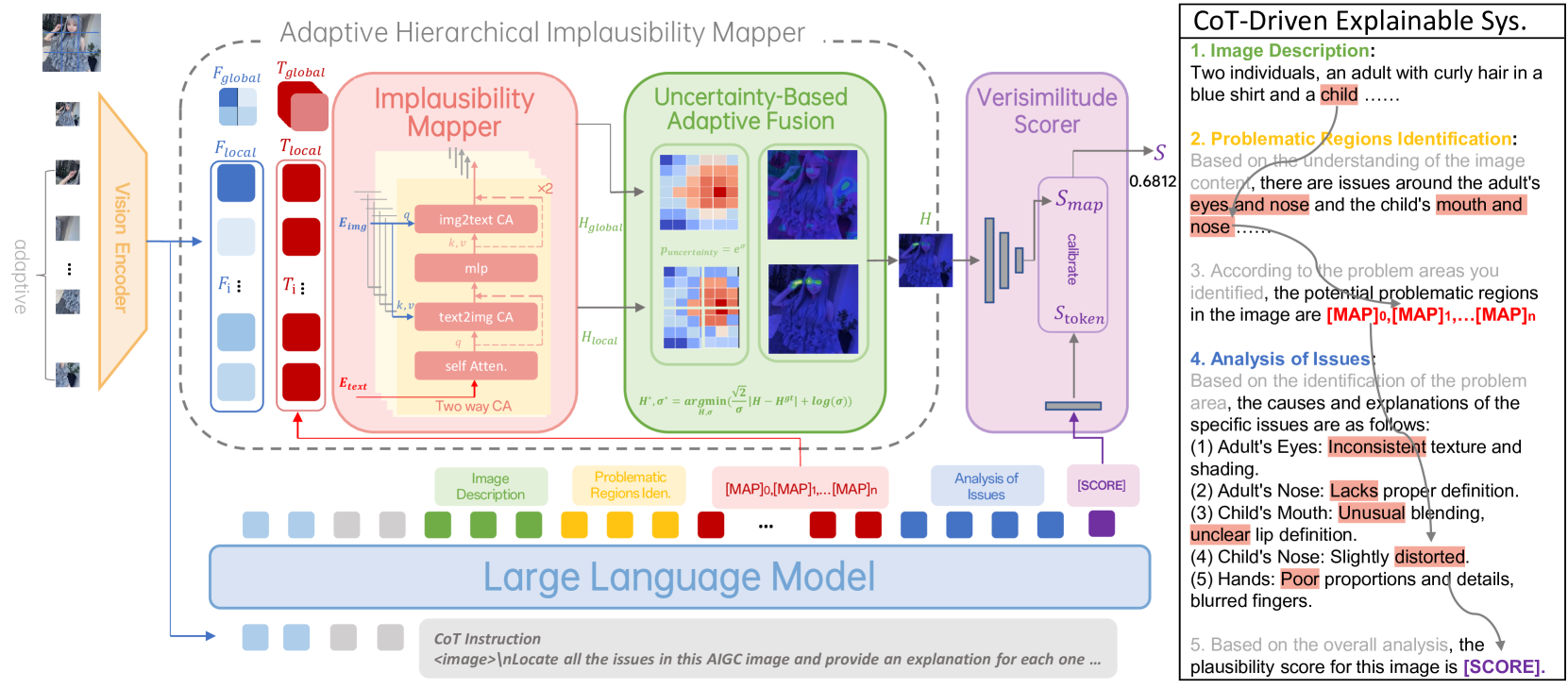

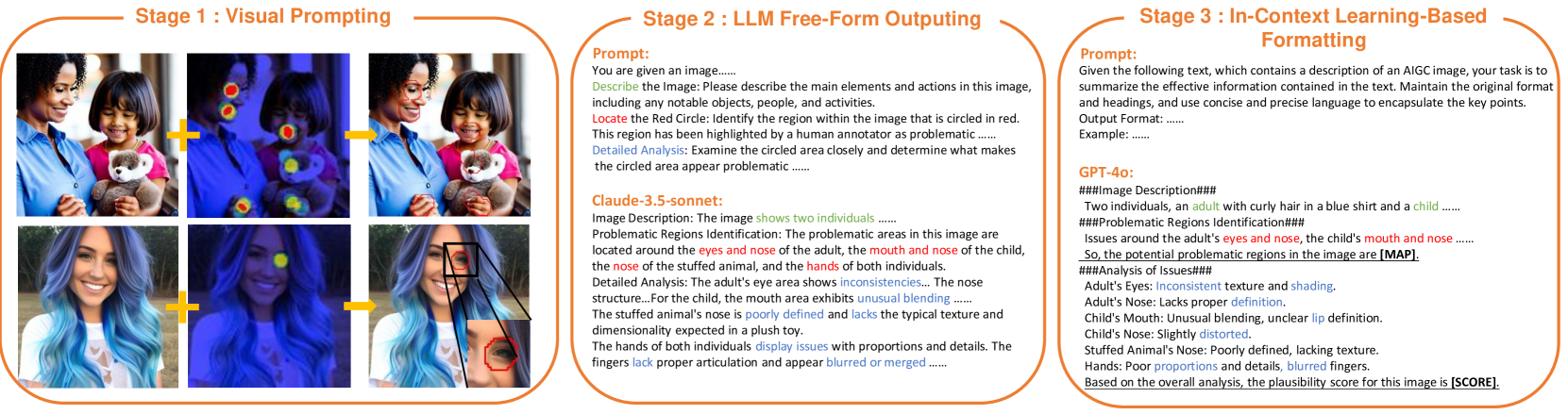

技术框架:HEIE包含两个主要模块:CoT驱动的可解释三位一体评估器和自适应分层不合理性映射器。首先,CoT驱动的评估器利用Chain-of-Thought (CoT) 将复杂的评估任务分解为多个难度递增的子任务,生成热图、分数和解释。然后,自适应分层映射器将低级图像特征与来自LLM的高级映射器token融合,通过基于不确定性的自适应token方法,实现精确的局部到全局分层热图预测。

关键创新:论文的关键创新在于:(1) 提出了CoT驱动的可解释三位一体评估器,将复杂评估任务分解为多个子任务,并生成热图、分数和解释,提升了评估的可解释性。(2) 提出了自适应分层不合理性映射器,将低级图像特征与来自LLM的高级映射器token融合,实现了精确的局部到全局分层热图预测。(3) 构建了新的数据集Expl-AIGI-Eval,专门用于AIGC图像的可解释不合理性评估。

关键设计:CoT驱动的评估器通过精心设计的prompt,引导MLLM逐步分析图像,并给出缺陷的解释。自适应分层映射器使用不确定性估计来动态调整低级图像特征和高级LLM token的权重,从而实现更精确的热图预测。具体参数设置和网络结构细节在论文中进行了详细描述,但此处未知具体数值。

🖼️ 关键图片

📊 实验亮点

HEIE在Expl-AIGI-Eval数据集上取得了state-of-the-art的性能,显著优于现有方法。具体性能数据未知,但论文强调了HEIE在可解释性和准确性方面的显著提升。实验结果表明,HEIE能够有效地定位AIGC图像中的缺陷,并提供合理的解释。

🎯 应用场景

该研究成果可应用于AIGC图像质量评估、内容审核、图像编辑等领域。通过提供可解释的缺陷分析,可以帮助用户更好地理解AIGC图像的质量问题,并采取相应的措施进行改进。未来,该方法有望应用于更广泛的图像质量评估任务,并促进AIGC技术的健康发展。

📄 摘要(原文)

AIGC images are prevalent across various fields, yet they frequently suffer from quality issues like artifacts and unnatural textures. Specialized models aim to predict defect region heatmaps but face two primary challenges: (1) lack of explainability, failing to provide reasons and analyses for subtle defects, and (2) inability to leverage common sense and logical reasoning, leading to poor generalization. Multimodal large language models (MLLMs) promise better comprehension and reasoning but face their own challenges: (1) difficulty in fine-grained defect localization due to the limitations in capturing tiny details, and (2) constraints in providing pixel-wise outputs necessary for precise heatmap generation. To address these challenges, we propose HEIE: a novel MLLM-Based Hierarchical Explainable Image Implausibility Evaluator. We introduce the CoT-Driven Explainable Trinity Evaluator, which integrates heatmaps, scores, and explanation outputs, using CoT to decompose complex tasks into subtasks of increasing difficulty and enhance interpretability. Our Adaptive Hierarchical Implausibility Mapper synergizes low-level image features with high-level mapper tokens from LLMs, enabling precise local-to-global hierarchical heatmap predictions through an uncertainty-based adaptive token approach. Moreover, we propose a new dataset: Expl-AIGI-Eval, designed to facilitate interpretable implausibility evaluation of AIGC images. Our method demonstrates state-of-the-art performance through extensive experiments. Our project is at https://yfthu.github.io/HEIE/.