SplatAD: Real-Time Lidar and Camera Rendering with 3D Gaussian Splatting for Autonomous Driving

作者: Georg Hess, Carl Lindström, Maryam Fatemi, Christoffer Petersson, Lennart Svensson

分类: cs.CV, cs.GR

发布日期: 2024-11-25 (更新: 2025-03-13)

💡 一句话要点

提出SplatAD以解决自动驾驶中实时激光雷达与相机渲染问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 自动驾驶 实时渲染 激光雷达 神经渲染 3D高斯点云 动态场景 数据驱动

📋 核心要点

- 现有的NeRF方法在激光雷达和相机数据的传感器真实感渲染中速度较慢,限制了其在大规模测试中的应用。

- SplatAD是首个基于3D高斯点云的实时渲染方法,能够同时处理相机和激光雷达数据,并优化渲染效率。

- 在多个自动驾驶数据集上的评估中,SplatAD实现了最先进的渲染质量,PSNR提升达+2和+3,同时渲染速度提高了一个数量级。

📝 摘要(中文)

确保自动驾驶车辆的安全需要在多样化的驾驶场景中进行广泛测试。模拟是进行此类测试的关键,神经渲染方法因其数据驱动的特性而受到关注。然而,现有的神经辐射场(NeRF)方法在传感器真实感渲染方面速度较慢,限制了其在大规模测试中的应用。为了解决这一问题,本文提出了SplatAD,这是首个基于3D高斯点云的动态场景实时渲染方法,能够同时处理相机和激光雷达数据。SplatAD准确建模了关键的传感器特性,显著提高了渲染效率。实验结果表明,SplatAD在多个自动驾驶数据集上实现了最先进的渲染质量,渲染速度比基于NeRF的方法提高了一个数量级。

🔬 方法详解

问题定义:本论文旨在解决现有NeRF方法在自动驾驶场景中实时渲染激光雷达和相机数据的速度不足问题。现有方法在处理激光雷达数据时存在显著的性能瓶颈,无法满足实时应用的需求。

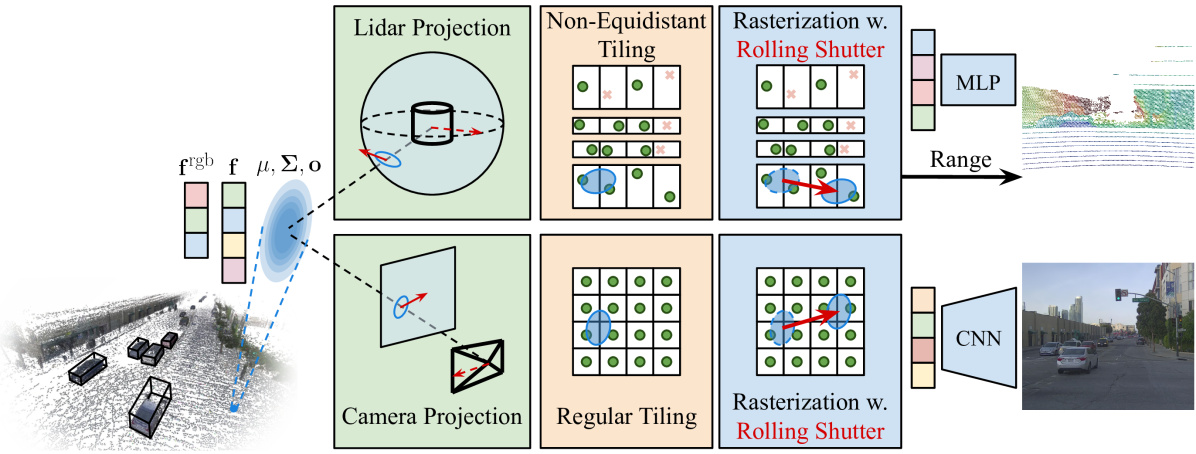

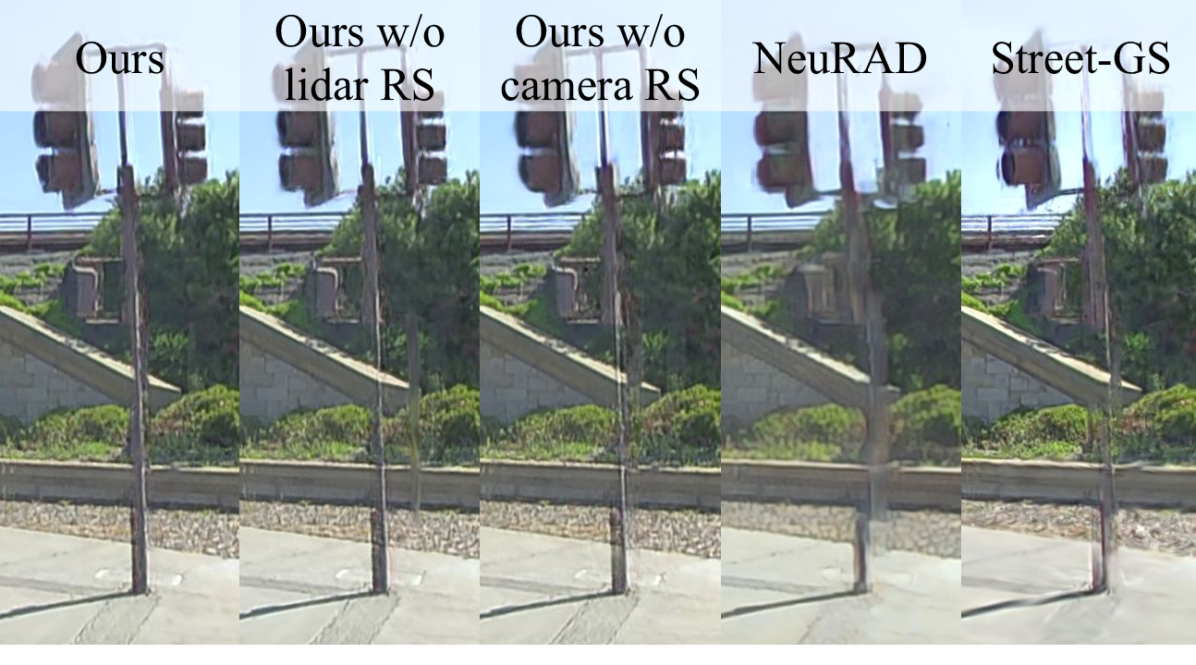

核心思路:SplatAD通过采用3D高斯点云技术,实现了动态场景的实时渲染,能够同时处理相机和激光雷达数据。该方法设计了专门的算法来优化渲染效率,并准确建模了传感器特有的现象,如滚动快门效应和激光雷达强度。

技术框架:SplatAD的整体架构包括数据采集、3D高斯点云建模、渲染优化和结果输出四个主要模块。首先,从传感器收集数据,然后通过3D高斯点云技术进行建模,接着优化渲染过程,最后输出高质量的渲染结果。

关键创新:SplatAD的主要创新在于首次将3D高斯点云技术应用于同时处理相机和激光雷达数据的实时渲染中,显著提升了渲染速度和质量。与现有方法相比,SplatAD在处理动态场景时表现出更高的效率和准确性。

关键设计:在设计中,SplatAD采用了特定的损失函数来优化渲染质量,并在网络结构上进行了调整,以适应激光雷达数据的特性。此外,针对滚动快门效应和激光雷达光线丢失等现象,设计了专门的处理算法。

🖼️ 关键图片

📊 实验亮点

实验结果显示,SplatAD在多个自动驾驶数据集上实现了最先进的渲染质量,PSNR提升达+2和+3,同时渲染速度比传统的NeRF方法提高了一个数量级,展示了其在实时渲染中的显著优势。

🎯 应用场景

SplatAD的研究成果在自动驾驶领域具有广泛的应用潜力,能够为自动驾驶车辆提供更为真实的模拟环境,提升其在复杂场景下的安全性和可靠性。未来,该技术还可以扩展到其他需要实时渲染的领域,如虚拟现实和增强现实等。

📄 摘要(原文)

Ensuring the safety of autonomous robots, such as self-driving vehicles, requires extensive testing across diverse driving scenarios. Simulation is a key ingredient for conducting such testing in a cost-effective and scalable way. Neural rendering methods have gained popularity, as they can build simulation environments from collected logs in a data-driven manner. However, existing neural radiance field (NeRF) methods for sensor-realistic rendering of camera and lidar data suffer from low rendering speeds, limiting their applicability for large-scale testing. While 3D Gaussian Splatting (3DGS) enables real-time rendering, current methods are limited to camera data and are unable to render lidar data essential for autonomous driving. To address these limitations, we propose SplatAD, the first 3DGS-based method for realistic, real-time rendering of dynamic scenes for both camera and lidar data. SplatAD accurately models key sensor-specific phenomena such as rolling shutter effects, lidar intensity, and lidar ray dropouts, using purpose-built algorithms to optimize rendering efficiency. Evaluation across three autonomous driving datasets demonstrates that SplatAD achieves state-of-the-art rendering quality with up to +2 PSNR for NVS and +3 PSNR for reconstruction while increasing rendering speed over NeRF-based methods by an order of magnitude. See https://research.zenseact.com/publications/splatad/ for our project page.