Iris: Integrating Language into Diffusion-based Monocular Depth Estimation

作者: Ziyao Zeng, Jingcheng Ni, Daniel Wang, Patrick Rim, Younjoon Chung, Fengyu Yang, Byung-Woo Hong, Alex Wong

分类: cs.CV, cs.CL, cs.LG, cs.MM

发布日期: 2024-11-24 (更新: 2025-11-18)

💡 一句话要点

Iris:将语言融入扩散模型的单目深度估计,提升小区域深度精度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 单目深度估计 扩散模型 语言引导 多模态融合 深度学习

📋 核心要点

- 单目深度估计受限于内在模糊性和视觉干扰,难以准确推断场景深度。

- 利用语言作为附加条件,约束深度估计的解空间,提升深度估计的准确性。

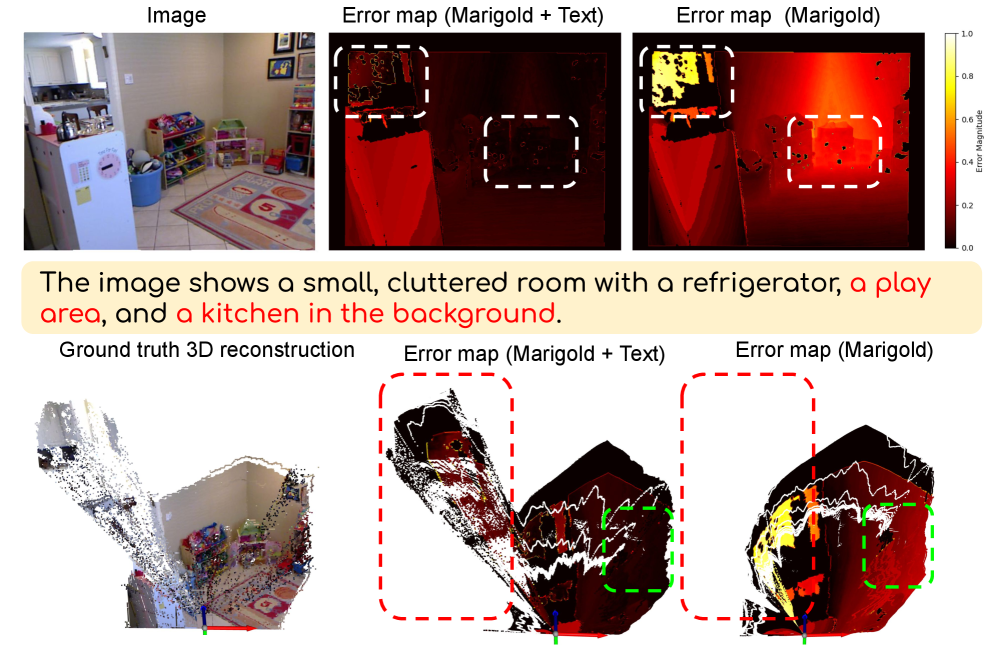

- 实验表明,该方法尤其在小区域深度估计上表现出色,并能根据文本描述迭代优化深度预测。

📝 摘要(中文)

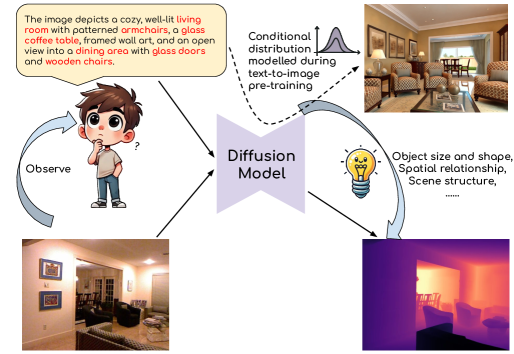

传统的单目深度估计存在固有的模糊性和视觉干扰。本文证明,语言可以通过提供与合理3D场景对齐的附加条件(而不仅仅是图像),来增强单目深度估计,从而减少深度估计的解空间。这种条件分布是在扩散模型的文本到图像预训练期间学习的。为了生成在各种视点和布局下精确反映文本描述的图像,该模型隐式地对对象的大小、形状和比例、它们之间的空间关系以及整体场景结构进行建模。在本文中,Iris,我们研究了将文本描述集成到基于扩散的深度估计模型的训练和推理中的策略的优势。我们使用三种不同的基于扩散的单目深度估计器(Marigold、Lotus 和 E2E-FT)及其变体进行了实验。通过在 HyperSim 和 Virtual KITTI 上进行训练,并在 NYUv2、KITTI、ETH3D、ScanNet 和 DIODE 上进行评估,我们发现我们的策略提高了整体单目深度估计的准确性,尤其是在小区域。它还提高了模型对文本中描述的特定区域的深度感知。我们发现,通过在文本中提供更多细节,可以迭代地细化深度预测。同时,我们发现语言可以作为一种约束,加速训练和推理扩散轨迹的收敛。代码和生成的文本数据将在接收后发布。

🔬 方法详解

问题定义:单目深度估计由于缺乏几何信息,存在固有的模糊性,并且容易受到光照、遮挡等视觉干扰的影响,导致深度估计精度不高,尤其是在细节区域和小物体上表现较差。现有方法主要依赖于图像特征,难以有效利用场景的上下文信息。

核心思路:将语言信息作为额外的条件输入到深度估计模型中,利用语言对场景的描述来约束深度估计的解空间。扩散模型在文本到图像生成任务中已经学习了丰富的场景先验知识,可以隐式地建模对象的大小、形状、空间关系等信息。因此,将语言信息融入扩散模型,可以提高深度估计的准确性和鲁棒性。

技术框架:Iris方法将文本描述融入到基于扩散的单目深度估计模型中。整体流程包括:1) 使用文本描述和图像数据训练扩散模型,使其学习文本和深度之间的对应关系;2) 在推理阶段,将图像和文本描述作为输入,通过扩散模型的逆过程生成深度图。该方法可以应用于不同的基于扩散的单目深度估计器,例如Marigold、Lotus和E2E-FT。

关键创新:该方法的核心创新在于将语言信息融入到基于扩散的单目深度估计中,利用语言对场景的描述来约束深度估计的解空间。与传统的单目深度估计方法相比,该方法可以更好地利用场景的上下文信息,提高深度估计的准确性和鲁棒性。此外,该方法还发现,通过在文本中提供更多细节,可以迭代地细化深度预测。

关键设计:在训练阶段,使用HyperSim和Virtual KITTI等数据集,将图像和对应的文本描述作为输入,训练扩散模型。在推理阶段,将图像和文本描述作为输入,通过扩散模型的逆过程生成深度图。可以使用不同的扩散模型架构,例如DDPM或DDIM。损失函数通常包括深度损失和文本-图像对齐损失。文本编码器可以使用预训练的语言模型,例如BERT或CLIP。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Iris方法在NYUv2、KITTI、ETH3D、ScanNet和DIODE等数据集上都取得了显著的性能提升,尤其是在小区域深度估计方面。通过提供更详细的文本描述,可以迭代地细化深度预测。此外,语言信息还可以加速训练和推理扩散轨迹的收敛。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、虚拟现实、增强现实等领域。通过结合视觉信息和语言描述,可以提高机器人对环境的感知能力,使其能够更好地理解和交互。例如,在自动驾驶中,可以利用语言描述来指导车辆的行驶路线和行为,提高驾驶的安全性和舒适性。在虚拟现实和增强现实中,可以利用语言描述来生成更加逼真的3D场景,提高用户的沉浸感。

📄 摘要(原文)

Traditional monocular depth estimation suffers from inherent ambiguity and visual nuisances. We demonstrate that language can enhance monocular depth estimation by providing an additional condition (rather than images alone) aligned with plausible 3D scenes, thereby reducing the solution space for depth estimation. This conditional distribution is learned during the text-to-image pre-training of diffusion models. To generate images under various viewpoints and layouts that precisely reflect textual descriptions, the model implicitly models object sizes, shapes, and scales, their spatial relationships, and the overall scene structure. In this paper, Iris, we investigate the benefits of our strategy to integrate text descriptions into training and inference of diffusion-based depth estimation models. We experiment with three different diffusion-based monocular depth estimators (Marigold, Lotus, and E2E-FT) and their variants. By training on HyperSim and Virtual KITTI, and evaluating on NYUv2, KITTI, ETH3D, ScanNet, and DIODE, we find that our strategy improves the overall monocular depth estimation accuracy, especially in small areas. It also improves the model's depth perception of specific regions described in the text. We find that by providing more details in the text, the depth prediction can be iteratively refined. Simultaneously, we find that language can act as a constraint to accelerate the convergence of both training and the inference diffusion trajectory. Code and generated text data will be released upon acceptance.