FAST-Splat: Fast, Ambiguity-Free Semantics Transfer in Gaussian Splatting

作者: Ola Shorinwa, Jiankai Sun, Mac Schwager

分类: cs.CV

发布日期: 2024-11-20 (更新: 2025-03-12)

💡 一句话要点

FAST-Splat:快速无歧义的高斯溅射语义迁移方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 语义分割 开放集学习 三维重建 自然语言查询

📋 核心要点

- 现有语义高斯溅射方法存在训练和渲染速度慢、内存占用高以及语义对象定位不明确等问题。

- FAST-Splat通过开放集语义蒸馏,直接用语义代码增强高斯分布,保留了高斯溅射的快速训练和渲染优势。

- 实验结果表明,FAST-Splat在训练速度、渲染速度和内存使用方面均优于现有方法,并保持了良好的语义分割性能。

📝 摘要(中文)

本文提出FAST-Splat,一种快速、无歧义的语义高斯溅射方法,旨在解决现有语义高斯溅射方法的主要局限性,即:训练和渲染速度慢、内存使用量高以及语义对象定位模糊。我们采用自下而上的方法推导FAST-Splat,打破了封闭集语义蒸馏的限制,从而实现开放集(开放词汇)语义蒸馏。这种关键方法使FAST-Splat能够提供精确的语义对象定位结果,即使在用户提供模糊的自然语言查询时也是如此。此外,通过充分利用高斯溅射场景表示的显式形式,FAST-Splat保留了高斯溅射卓越的训练和渲染速度。具体而言,现有语义高斯溅射方法将语义蒸馏到单独的神经场中,或利用神经模型进行降维,而FAST-Splat直接用特定的语义代码增强每个高斯分布,从而保留了高斯溅射在训练、渲染和内存使用方面的优势。这些高斯特定的语义代码与哈希表一起,能够使用开放词汇用户提示来衡量语义相似性,并使FAST-Splat能够响应明确的语义对象标签和3D掩码,这与先前的方法不同。实验表明,与最佳的竞争语义高斯溅射方法相比,FAST-Splat的训练速度快6到8倍,渲染速度快18到51倍,并且所需的GPU内存减少约6倍。此外,与现有方法相比,FAST-Splat实现了相对相似或更好的语义分割性能。在审核期结束后,我们将提供项目网站和代码库的链接。

🔬 方法详解

问题定义:现有语义高斯溅射方法在训练和渲染速度、内存占用以及语义对象定位的准确性方面存在局限性。具体来说,将语义信息融入高斯溅射场景表示时,传统方法要么依赖于额外的神经场进行语义蒸馏,要么使用神经网络进行降维,这导致计算开销增加,训练和渲染速度下降,并且难以处理开放词汇的语义查询。此外,语义对象定位的模糊性也是一个挑战。

核心思路:FAST-Splat的核心思路是直接将语义信息编码到每个高斯分布中,避免使用额外的神经场或神经网络进行语义蒸馏或降维。通过这种方式,可以最大限度地保留高斯溅射的快速训练和渲染优势。此外,采用开放集语义蒸馏,允许模型处理更广泛的语义查询,并使用哈希表来加速语义相似性搜索和对象定位。

技术框架:FAST-Splat的整体框架包括以下几个主要步骤:1) 使用高斯溅射表示场景;2) 利用开放集语义蒸馏获取语义信息;3) 将语义代码直接附加到每个高斯分布;4) 使用哈希表存储语义代码,加速语义相似性搜索;5) 根据用户提供的自然语言查询,检索相关的语义代码,并生成语义对象标签和3D掩码。

关键创新:FAST-Splat最重要的创新点在于直接将语义信息编码到高斯分布中,并采用开放集语义蒸馏。与现有方法相比,这避免了额外的计算开销,提高了训练和渲染速度,并能够处理开放词汇的语义查询。此外,使用哈希表加速语义相似性搜索也是一个关键创新。

关键设计:FAST-Splat的关键设计包括:1) 语义代码的维度选择,需要在语义表达能力和计算效率之间进行权衡;2) 哈希表的设计,包括哈希函数的选择和冲突处理策略;3) 开放集语义蒸馏的实现细节,例如如何选择合适的预训练模型和如何处理未知的语义类别;4) 损失函数的设计,用于优化语义代码的编码,确保语义相似的对象具有相似的语义代码。

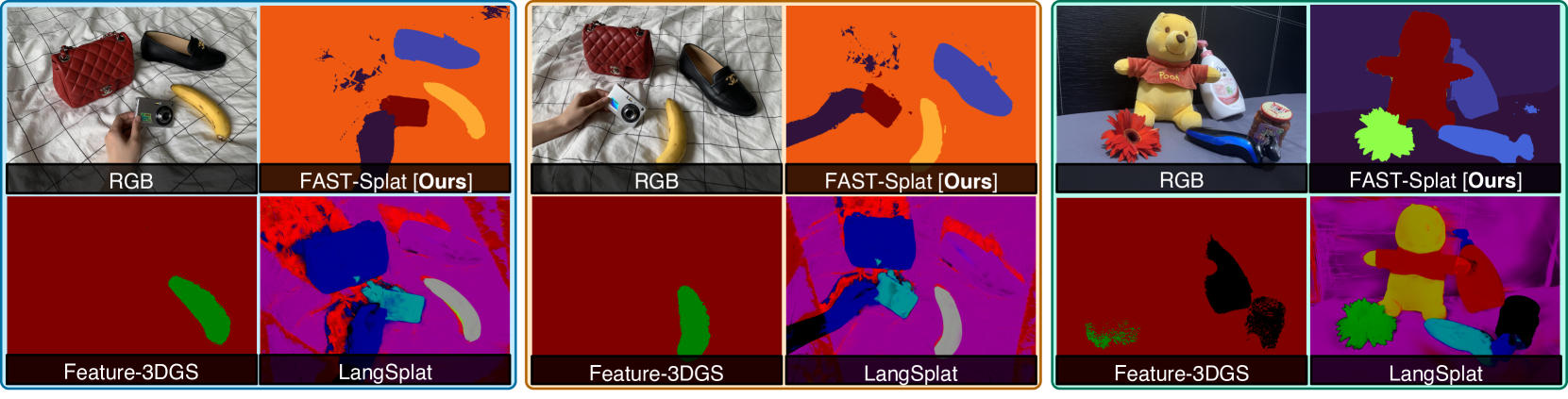

🖼️ 关键图片

📊 实验亮点

实验结果表明,FAST-Splat在训练速度上比现有语义高斯溅射方法快6到8倍,渲染速度快18到51倍,并且所需的GPU内存减少约6倍。此外,FAST-Splat在语义分割性能方面与现有方法相当甚至更好。这些结果表明,FAST-Splat在效率和准确性方面都具有显著优势。

🎯 应用场景

FAST-Splat具有广泛的应用前景,包括:机器人导航、自动驾驶、增强现实、虚拟现实、三维场景编辑等。该方法可以用于快速构建具有语义信息的3D场景地图,并支持基于自然语言的场景交互和对象定位。未来,FAST-Splat可以进一步扩展到动态场景和大规模场景,为各种应用提供更强大的支持。

📄 摘要(原文)

We present FAST-Splat for fast, ambiguity-free semantic Gaussian Splatting, which seeks to address the main limitations of existing semantic Gaussian Splatting methods, namely: slow training and rendering speeds; high memory usage; and ambiguous semantic object localization. We take a bottom-up approach in deriving FAST-Splat, dismantling the limitations of closed-set semantic distillation to enable open-set (open-vocabulary) semantic distillation. Ultimately, this key approach enables FAST-Splat to provide precise semantic object localization results, even when prompted with ambiguous user-provided natural-language queries. Further, by exploiting the explicit form of the Gaussian Splatting scene representation to the fullest extent, FAST-Splat retains the remarkable training and rendering speeds of Gaussian Splatting. Precisely, while existing semantic Gaussian Splatting methods distill semantics into a separate neural field or utilize neural models for dimensionality reduction, FAST-Splat directly augments each Gaussian with specific semantic codes, preserving the training, rendering, and memory-usage advantages of Gaussian Splatting over neural field methods. These Gaussian-specific semantic codes, together with a hash-table, enable semantic similarity to be measured with open-vocabulary user prompts and further enable FAST-Splat to respond with unambiguous semantic object labels and $3$D masks, unlike prior methods. In experiments, we demonstrate that FAST-Splat is 6x to 8x faster to train, achieves between 18x to 51x faster rendering speeds, and requires about 6x smaller GPU memory, compared to the best-competing semantic Gaussian Splatting methods. Further, FAST-Splat achieves relatively similar or better semantic segmentation performance compared to existing methods. After the review period, we will provide links to the project website and the codebase.