Efficient Physics Simulation for 3D Scenes via MLLM-Guided Gaussian Splatting

作者: Haoyu Zhao, Hao Wang, Xingyue Zhao, Hao Fei, Hongqiu Wang, Chengjiang Long, Hua Zou

分类: cs.CV

发布日期: 2024-11-19 (更新: 2025-07-26)

备注: ICCV 2025

💡 一句话要点

提出Sim Anything以解决3D场景物理模拟效率问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D物理模拟 多模态大语言模型 物理属性感知 动态场景生成 计算效率

📋 核心要点

- 现有的3D物理模拟方法往往需要手动设置物理属性,计算复杂且效率低下。

- 本文提出Sim Anything,通过MLLM引导的物理属性感知,自动化物体动态模拟过程。

- 实验结果显示,Sim Anything在单个GPU上实现了更真实的运动,且计算时间仅需2分钟。

📝 摘要(中文)

近年来,3D生成模型的进展为动态3D物体运动模拟和行为定制开辟了新可能,但创建此类内容仍然具有挑战性。现有方法通常需要手动分配精确的物理属性,或依赖视频生成模型进行预测,计算成本高昂。本文重新思考了多模态大语言模型(MLLM)在基于物理的模拟中的应用,提出了一种名为Sim Anything的方法,使静态3D物体具备交互动态。我们通过详细的场景重建和物体级3D开放词汇分割,进而进行多视角图像修补。受人类视觉推理的启发,我们提出了基于MLLM的物理属性感知(MLLM-P3),以零样本方式预测物体的平均物理属性。基于平均值和物体几何形状,材料属性分布预测模型(MPDP)估计完整分布,将问题重新表述为概率分布估计,从而降低计算成本。最后,我们通过物理-几何自适应采样(PGAS)策略在开放世界场景中模拟物体,能够高效捕捉复杂变形并显著降低计算成本。大量实验和用户研究表明,Sim Anything在单个GPU上实现了比最先进方法更真实的运动,时间仅需2分钟。

🔬 方法详解

问题定义:本文旨在解决现有3D物理模拟方法中手动设置物理属性的低效问题,现有方法计算复杂且耗时。

核心思路:通过引入多模态大语言模型(MLLM),实现物体物理属性的自动感知,进而简化物理模拟过程。

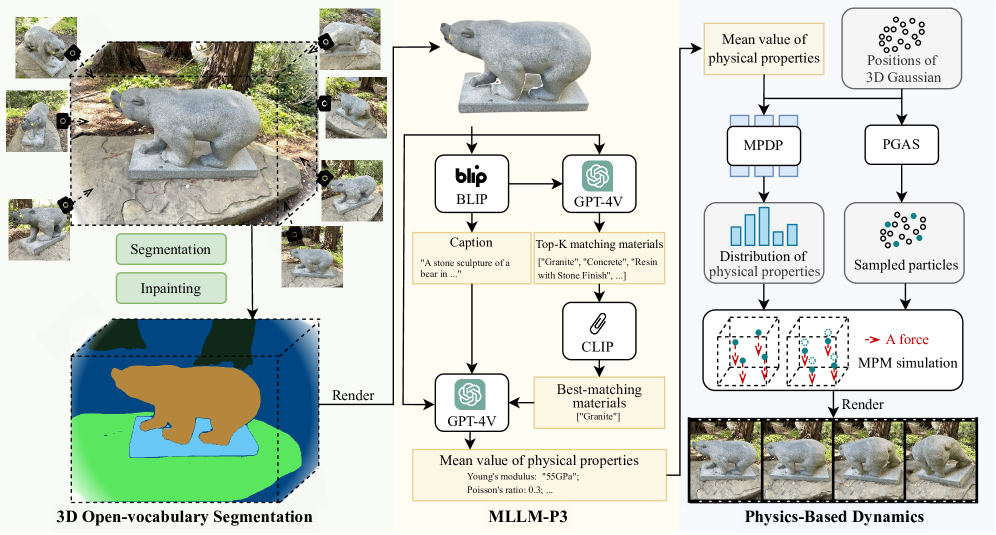

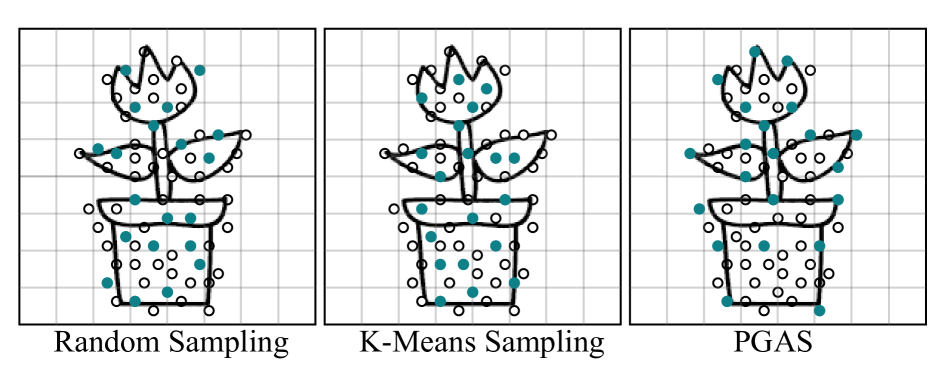

技术框架:整体流程包括场景重建、3D开放词汇分割、多视角图像修补,接着利用MLLM-P3进行物理属性预测,最后通过MPDP模型估计物体的完整物理属性分布,并使用PGAS策略进行物体模拟。

关键创新:最重要的创新在于将MLLM应用于物理属性的零样本预测,显著降低了计算成本,并提高了模拟的真实感。

关键设计:在模型设计中,MLLM-P3用于物理属性感知,MPDP用于分布估计,PGAS策略则用于高效的物体模拟,整体架构优化了计算效率和模拟质量。

🖼️ 关键图片

📊 实验亮点

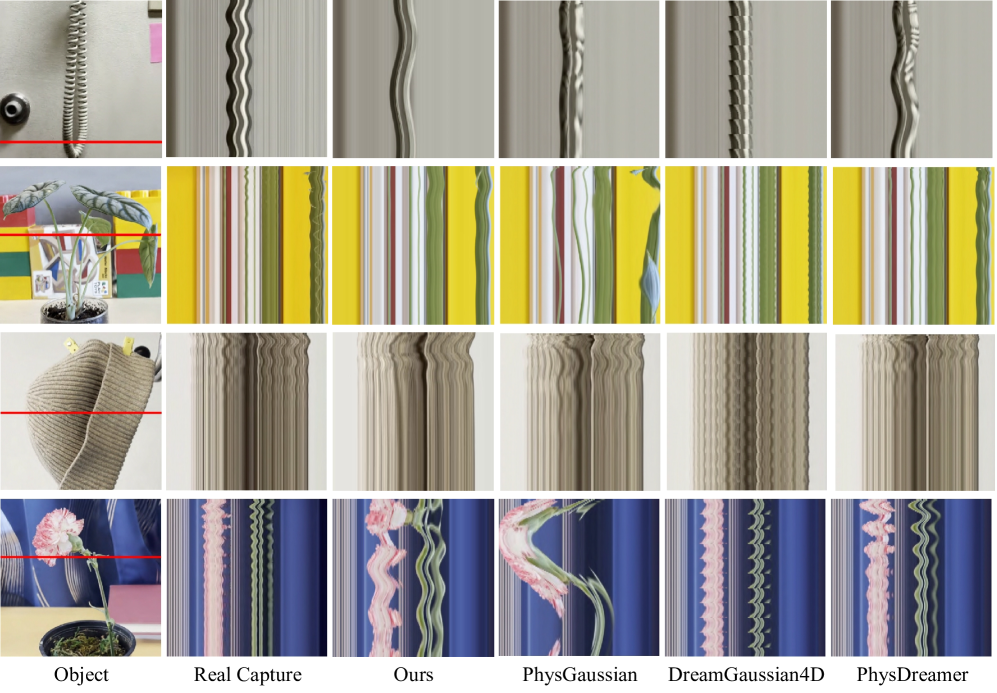

实验结果表明,Sim Anything在单个GPU上实现了比最先进方法更真实的运动,计算时间仅需2分钟,显著提高了模拟效率和真实感,展示了其在3D物理模拟领域的优越性。

🎯 应用场景

该研究的潜在应用领域包括游戏开发、虚拟现实和动画制作等,能够为动态场景生成提供高效的解决方案。通过自动化物理属性的感知与模拟,未来可以大幅提升3D内容创作的效率与质量。

📄 摘要(原文)

Recent advancements in 3D generation models have opened new possibilities for simulating dynamic 3D object movements and customizing behaviors, yet creating this content remains challenging. Current methods often require manual assignment of precise physical properties for simulations or rely on video generation models to predict them, which is computationally intensive. In this paper, we rethink the usage of multi-modal large language model (MLLM) in physics-based simulation, and present Sim Anything, a physics-based approach that endows static 3D objects with interactive dynamics. We begin with detailed scene reconstruction and object-level 3D open-vocabulary segmentation, progressing to multi-view image in-painting. Inspired by human visual reasoning, we propose MLLM-based Physical Property Perception (MLLM-P3) to predict mean physical properties of objects in a zero-shot manner. Based on the mean values and the object's geometry, the Material Property Distribution Prediction model (MPDP) model then estimates the full distribution, reformulating the problem as probability distribution estimation to reduce computational costs. Finally, we simulate objects in an open-world scene with particles sampled via the Physical-Geometric Adaptive Sampling (PGAS) strategy, efficiently capturing complex deformations and significantly reducing computational costs. Extensive experiments and user studies demonstrate our Sim Anything achieves more realistic motion than state-of-the-art methods within 2 minutes on a single GPU.