Sketch-guided Cage-based 3D Gaussian Splatting Deformation

作者: Tianhao Xie, Noam Aigerman, Eugene Belilovsky, Tiberiu Popa

分类: cs.CV, cs.GR

发布日期: 2024-11-19 (更新: 2025-12-01)

备注: 10 pages, 9 figures, accepted at WACV 26, project page: https://tianhaoxie.github.io/project/gs_deform/

💡 一句话要点

提出草图引导的基于笼的3D高斯溅射变形方法,实现精细几何编辑与动画

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 草图引导 变形 神经雅可比场 ControlNet 2D扩散先验 笼型变形

📋 核心要点

- 现有3D高斯溅射编辑方法缺乏对变形的精细控制,难以实现直观的几何修改。

- 提出草图引导的变形系统,结合笼型变形与神经雅可比场,实现精确控制。

- 利用2D扩散先验和ControlNet,确保变形在语义上合理,并可用于3D模型动画。

📝 摘要(中文)

3D高斯溅射(GS)是最有前景的新型3D表示方法之一,受到了计算机图形学和计算机视觉领域的广泛关注。虽然已经有各种系统为3D GS引入了编辑功能,例如由文本提示引导的编辑,但对变形进行细粒度控制仍然是一个开放的挑战。本文提出了一种新的草图引导的3D GS变形系统,允许用户通过绘制单个视角的轮廓草图来直观地修改3D GS模型的几何形状。我们的方法引入了一种新的变形方法,该方法将基于笼的变形与神经雅可比场的一种变体相结合,从而实现精确的细粒度控制。此外,它还利用大规模的2D扩散先验和ControlNet来确保生成的变形在语义上是合理的。通过一系列实验,我们证明了该方法的有效性,并展示了其将静态3D GS模型制作成动画的关键应用能力。

🔬 方法详解

问题定义:现有3D高斯溅射(GS)编辑方法,特别是变形编辑,缺乏足够的精细控制能力。用户难以通过直观的方式,例如草图,来精确地修改3D模型的几何形状。现有的基于文本提示的方法虽然可以进行编辑,但难以实现细粒度的几何控制。因此,如何实现基于用户草图的、精确的3D GS模型变形是一个关键问题。

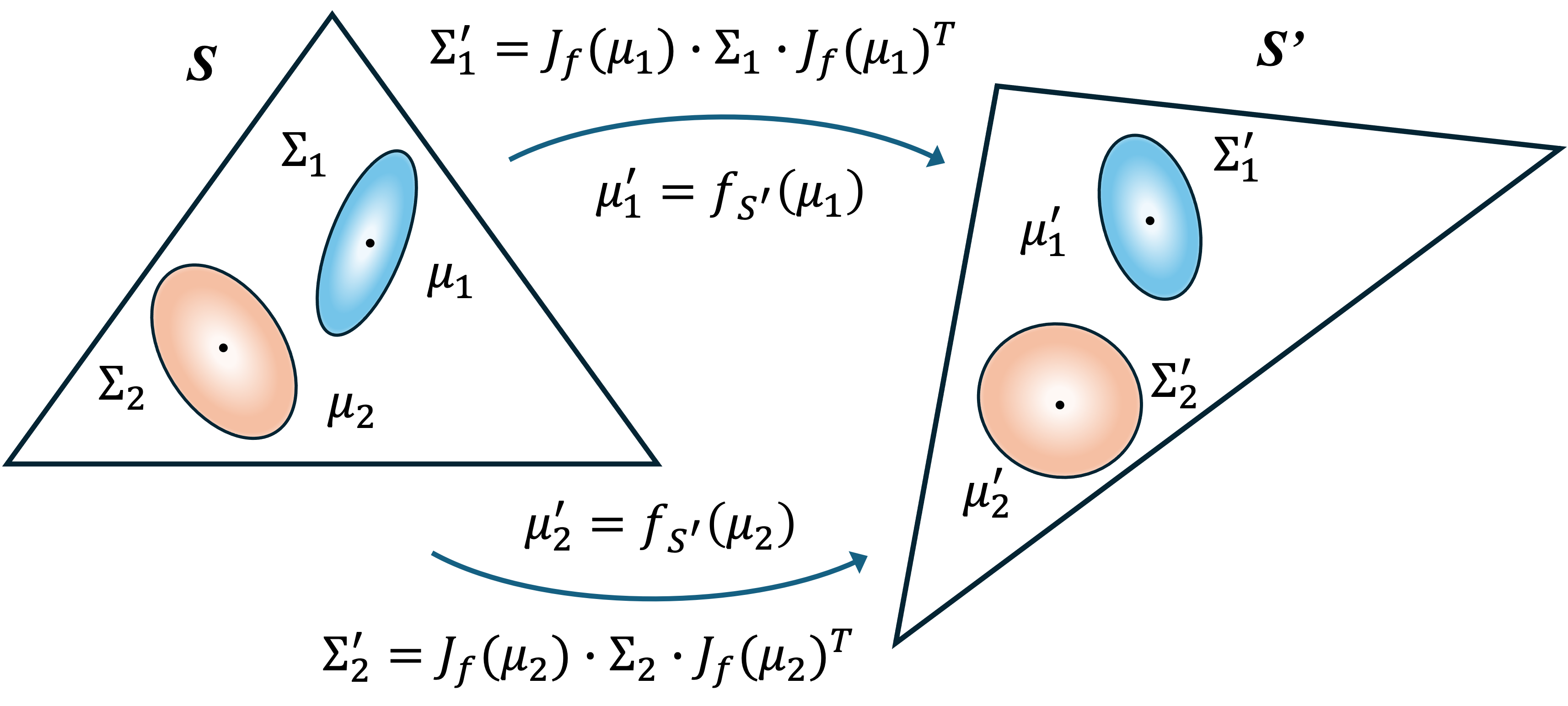

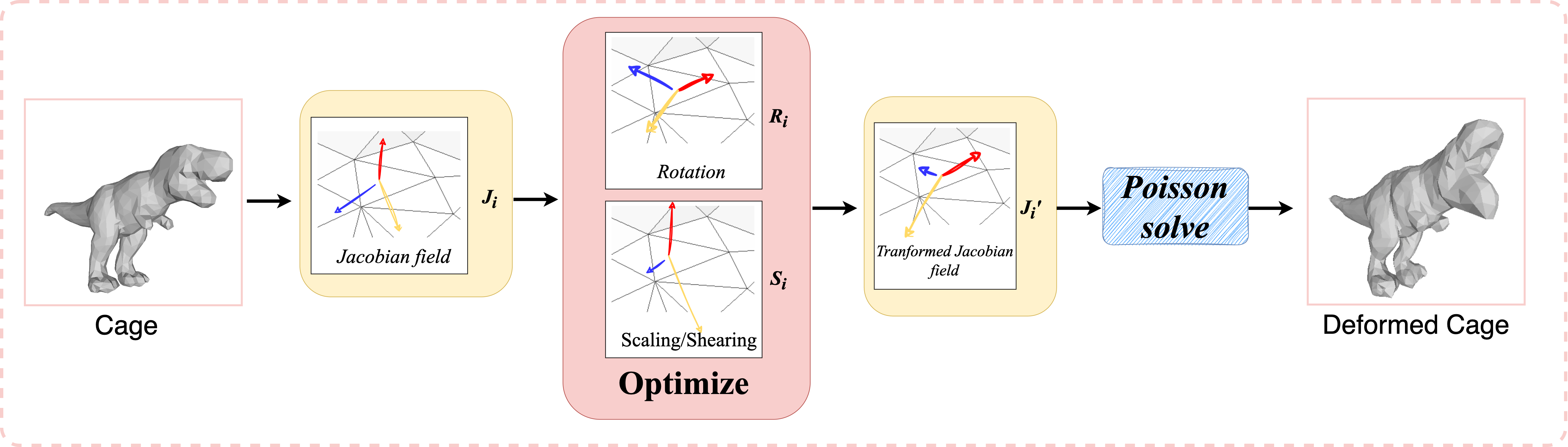

核心思路:本文的核心思路是将基于笼的变形方法与神经雅可比场相结合,并利用2D扩散先验来引导变形过程。基于笼的变形提供了一种相对简单且可控的变形方式,而神经雅可比场则可以学习更复杂的变形模式。通过结合两者,可以实现更精确和细粒度的变形控制。同时,利用2D扩散先验可以确保变形后的模型在语义上是合理的,避免产生不自然的变形结果。

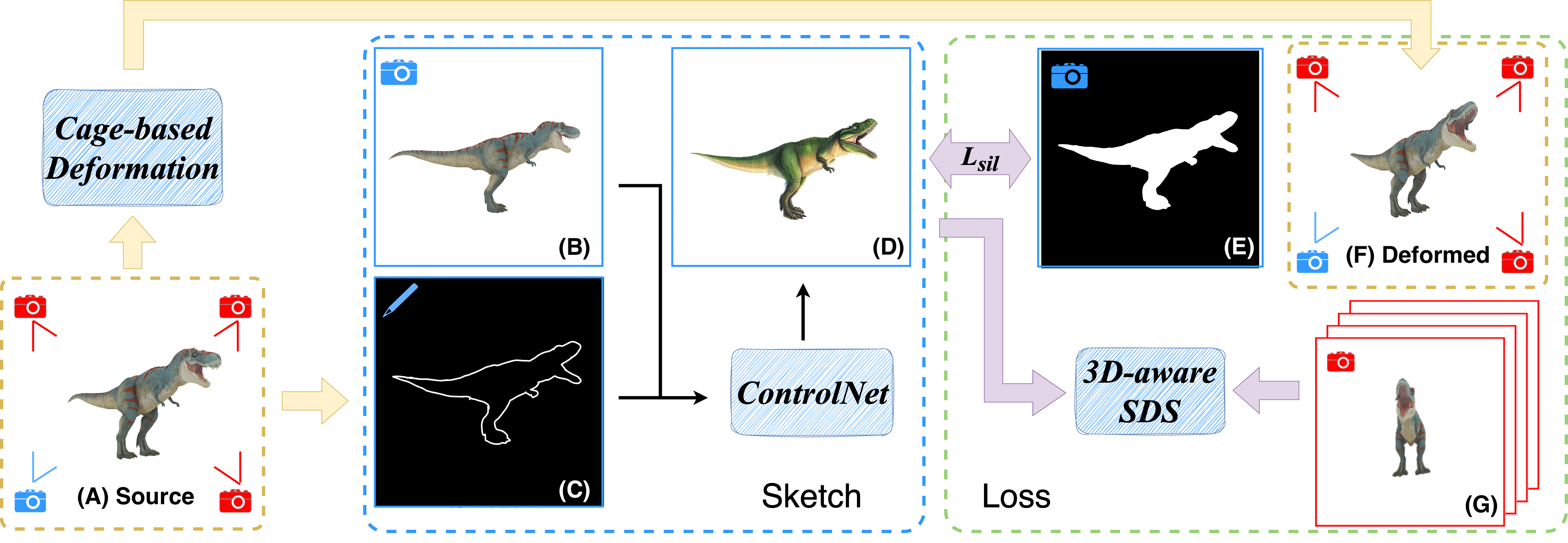

技术框架:该方法的技术框架主要包含以下几个阶段:1) 用户提供一个视角的轮廓草图作为变形指导;2) 使用ControlNet将草图信息融入到变形过程中;3) 利用基于笼的变形方法对3D GS模型进行初步变形;4) 使用神经雅可比场对变形进行精细调整;5) 利用2D扩散先验对变形结果进行约束,确保语义合理性。整个流程以用户草图为输入,最终输出变形后的3D GS模型。

关键创新:该方法最重要的技术创新点在于将基于笼的变形、神经雅可比场和2D扩散先验相结合,实现了一种草图引导的、精确且语义合理的3D GS模型变形方法。与现有方法相比,该方法能够提供更精细的几何控制,并且能够生成语义上更合理的变形结果。此外,利用ControlNet将草图信息融入到变形过程中也是一个重要的创新点。

关键设计:在关键设计方面,神经雅可比场的具体网络结构、损失函数的设计以及2D扩散先验的选择是重要的技术细节。例如,神经雅可比场的损失函数可能包含重建损失、正则化损失等,以确保变形的准确性和平滑性。2D扩散先验的选择需要考虑到与3D GS模型语义的一致性。此外,基于笼的变形的具体实现方式,例如笼的顶点数量和位置,也会影响变形的效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够有效地实现草图引导的3D GS模型变形,并且能够生成语义上合理的变形结果。通过与现有方法的对比,该方法在变形精度和语义合理性方面均取得了显著提升。此外,实验还展示了该方法在3D模型动画制作方面的应用潜力,例如将静态的3D GS模型制作成动态的角色动画。

🎯 应用场景

该研究成果可应用于3D内容创作、游戏开发、动画制作等领域。用户可以通过简单的草图来快速修改3D模型的几何形状,从而提高创作效率。此外,该方法还可以用于3D模型动画制作,例如将静态的3D模型制作成动态的角色动画。未来,该技术有望进一步发展,实现更复杂的3D模型编辑和动画效果。

📄 摘要(原文)

3D Gaussian Splatting (GS) is one of the most promising novel 3D representations that has received great interest in computer graphics and computer vision. While various systems have introduced editing capabilities for 3D GS, such as those guided by text prompts, fine-grained control over deformation remains an open challenge. In this work, we present a novel sketch-guided 3D GS deformation system that allows users to intuitively modify the geometry of a 3D GS model by drawing a silhouette sketch from a single viewpoint. Our approach introduces a new deformation method that combines cage-based deformations with a variant of Neural Jacobian Fields, enabling precise, fine-grained control. Additionally, it leverages large-scale 2D diffusion priors and ControlNet to ensure the generated deformations are semantically plausible. Through a series of experiments, we demonstrate the effectiveness of our method and showcase its ability to animate static 3D GS models as one of its key applications.