AtomThink: Multimodal Slow Thinking with Atomic Step Reasoning

作者: Kun Xiang, Zhili Liu, Terry Jingchen Zhang, Yinya Huang, Yunshuang Nie, Kaixin Cai, Yiyang Yin, Runhui Huang, Hanhui Li, Yihan Zeng, Yu-Jie Yuan, Jianhua Han, Lanqing Hong, Hang Xu, Xiaodan Liang

分类: cs.CV, cs.AI

发布日期: 2024-11-18 (更新: 2026-01-09)

备注: TPAMI accepted

🔗 代码/项目: GITHUB

💡 一句话要点

AtomThink:通过原子步骤推理实现多模态慢思考,提升复杂推理任务性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态推理 慢思考 思维链 原子步骤 自适应推理

📋 核心要点

- 现有方法在多模态推理中,要么依赖固定模板,要么采用自由形式,难以兼顾复杂任务的推理能力和简单任务的效率。

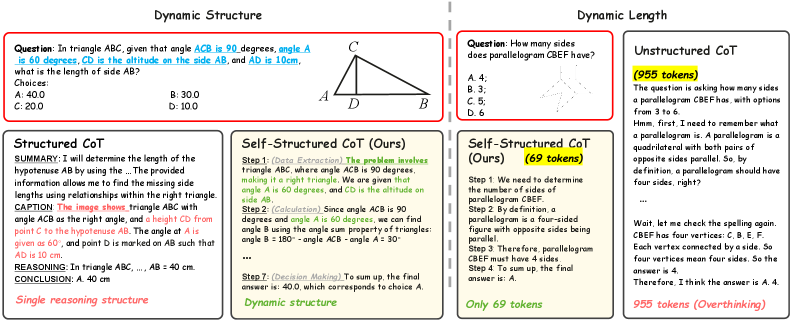

- AtomThink提出自结构化思维链(SCoT),将推理分解为最小语义原子步骤,模型可根据任务复杂度自适应调整推理深度。

- 实验表明,AtomThink在MathVista和MathVerse上平均准确率提升超过10%,数据利用率提升5倍,推理效率提升85.3%。

📝 摘要(中文)

本文旨在通过将“慢思考”概念融入多模态大型语言模型(MLLM)来解决具有挑战性的多模态推理任务。核心思想是模型能够自适应地使用不同层次的推理来处理不同复杂程度的问题。为此,我们提出了一种新颖的自结构化思维链(SCoT)范式,它由最小的语义原子步骤组成。与依赖结构化模板或自由形式范式的现有方法不同,我们的方法不仅为各种复杂任务生成灵活的CoT结构,而且减轻了简单任务的过度思考现象。为了将结构化推理引入视觉认知,我们设计了一个包含四个关键模块的AtomThink框架:(i)用于生成高质量多模态推理路径的数据引擎;(ii)使用序列化推理数据的监督微调(SFT)过程;(iii)策略引导的多轮推理方法;(iv)用于评估单步利用率的原子能力指标。大量实验表明,所提出的AtomThink显著提高了基线MLLM的性能,在MathVista和MathVerse上实现了超过10%的平均准确率提升。与最先进的结构化CoT方法相比,我们的方法不仅实现了更高的准确率,还将数据利用率提高了5倍,并将推理效率提高了85.3%。

🔬 方法详解

问题定义:论文旨在解决多模态推理任务中,现有方法无法根据任务复杂度自适应调整推理深度的问题。现有方法要么采用结构化模板,限制了复杂任务的推理能力;要么采用自由形式,导致简单任务的过度思考,效率低下。

核心思路:论文的核心思路是引入“慢思考”的概念,将推理过程分解为一系列最小语义原子步骤,模型可以根据任务的复杂度,自适应地选择需要执行的原子步骤数量,从而在保证推理能力的同时,提高推理效率。

技术框架:AtomThink框架包含四个主要模块:1) 数据引擎:用于生成高质量的多模态推理路径,作为训练数据;2) 监督微调(SFT):使用序列化的推理数据对模型进行微调,使其具备原子步骤推理的能力;3) 策略引导的多轮推理:在推理过程中,根据策略选择下一步需要执行的原子步骤;4) 原子能力指标:用于评估模型在单步推理中的利用率,指导模型训练。

关键创新:最重要的技术创新点是自结构化思维链(SCoT)范式,它将推理过程分解为最小的语义原子步骤,并允许模型根据任务的复杂度自适应地选择推理深度。与现有方法的本质区别在于,SCoT既能保证复杂任务的推理能力,又能避免简单任务的过度思考。

关键设计:数据引擎的设计至关重要,需要生成高质量的多模态推理路径。策略引导的多轮推理方法需要设计合适的策略,以选择下一步需要执行的原子步骤。原子能力指标的设计需要能够准确评估模型在单步推理中的利用率。

🖼️ 关键图片

📊 实验亮点

AtomThink在MathVista和MathVerse数据集上取得了显著的性能提升,平均准确率提升超过10%。与最先进的结构化CoT方法相比,AtomThink不仅实现了更高的准确率,还将数据利用率提高了5倍,并将推理效率提高了85.3%。这些实验结果表明,AtomThink框架能够有效地提升多模态推理模型的性能。

🎯 应用场景

AtomThink框架可应用于各种需要多模态推理的场景,例如智能问答、视觉导航、机器人控制等。通过提升模型的推理能力和效率,可以提高这些应用场景的智能化水平,并为用户提供更优质的服务。未来,该研究可以进一步扩展到更复杂的推理任务和更广泛的应用领域。

📄 摘要(原文)

In this paper, we address the challenging task of multimodal reasoning by incorporating the notion of ``slow thinking'' into multimodal large language models (MLLMs). Our core idea is that models can learn to adaptively use different levels of reasoning to tackle questions of varying complexity. We propose a novel paradigm of Self-structured Chain of Thought (SCoT), which consists of minimal semantic atomic steps. Unlike existing methods that rely on structured templates or free-form paradigms, our method not only generates flexible CoT structures for various complex tasks but also mitigates the phenomenon of overthinking for easier tasks. To introduce structured reasoning into visual cognition, we design a novel AtomThink framework with four key modules: (i) a data engine to generate high-quality multimodal reasoning paths; (ii) a supervised fine-tuning (SFT) process with serialized inference data; (iii) a policy-guided multi-turn inference method; and (iv) an atomic capability metric to evaluate the single-step utilization rate. Extensive experiments demonstrate that the proposed AtomThink significantly improves the performance of baseline MLLMs, achieving more than 10\% average accuracy gains on MathVista and MathVerse. Compared to state-of-the-art structured CoT approaches, our method not only achieves higher accuracy but also improves data utilization by 5 $\times$ and boosts inference efficiency by 85.3\%. Our code is publicly available at https://github.com/Kun-Xiang/AtomThink.