UniHands: Unifying Various Wild-Collected Keypoints for Personalized Hand Reconstruction

作者: Menghe Zhang, Joonyeoup Kim, Yangwen Liang, Shuangquan Wang, Kee-Bong Song

分类: cs.CV, cs.HC

发布日期: 2024-11-18

💡 一句话要点

UniHands:统一多种野外采集关键点,实现个性化手部重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 手部重建 关键点 参数化模型 MANO NIMBLE 个性化 三维建模

📋 核心要点

- 现有方法难以整合来自不同来源、不一致的关键点数据,导致手部重建质量不高且缺乏表面信息。

- UniHands利用MANO和NIMBLE参数模型,从野外采集的关键点数据中创建标准化且个性化的手部模型。

- 实验表明,UniHands能精确重建手部网格顶点和关键点,有效捕捉高度关节运动,且统一关节优于现有配置。

📝 摘要(中文)

精确的手部动作捕捉和标准化的3D表示对于各种手部相关任务至关重要。仅收集关键点数据虽然高效且经济,但会导致低保真度的表示,并且缺乏表面信息。此外,来自不同来源的数据不一致性给它们的集成和使用带来了挑战。我们提出了UniHands,一种新颖的方法,用于从来自不同来源的野外采集关键点创建标准化但个性化的手部模型。与现有的神经隐式表示方法不同,UniHands使用广泛采用的参数模型MANO和NIMBLE,提供了一种更具可扩展性和通用性的解决方案。它还从网格中导出统一的手部关节,这有助于无缝集成到各种手部相关任务中。在FreiHAND和InterHand2.6M数据集上的实验表明,它能够精确地重建手部网格顶点和关键点,有效地捕捉高度的关节运动。涉及九名参与者的实证研究表明,我们的统一关节在准确性和自然性方面明显优于现有的配置(p值为0.016)。

🔬 方法详解

问题定义:论文旨在解决从各种来源收集的、不一致的关键点数据中重建高质量、个性化的3D手部模型的问题。现有方法,特别是基于关键点的方法,通常会产生低保真度的手部表示,并且缺乏表面信息。此外,不同数据集之间的关键点定义和坐标系差异使得数据集成变得困难。

核心思路:UniHands的核心思路是利用参数化的手部模型(MANO和NIMBLE)作为先验知识,将来自不同来源的关键点数据统一到一个标准化的手部表示空间中。通过优化参数模型,使其生成的网格与输入的关键点对齐,从而实现手部重建。这种方法不仅可以提高重建的准确性,还可以提供表面信息和关节信息。

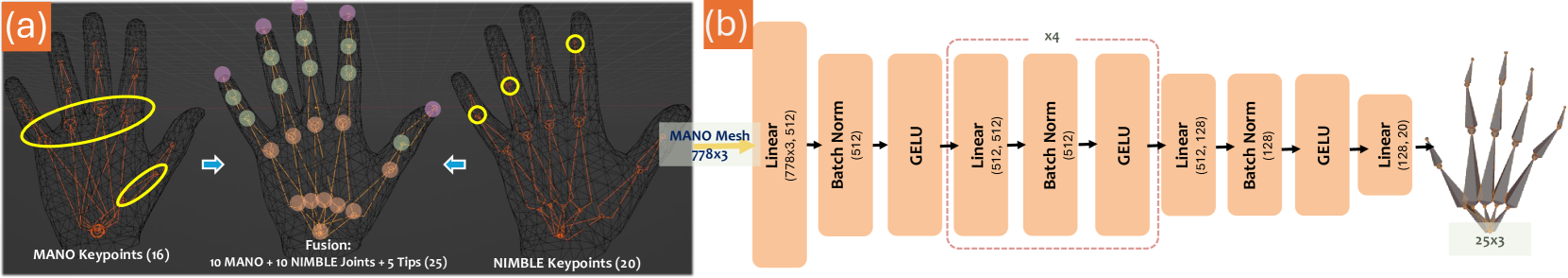

技术框架:UniHands的整体框架包括以下几个主要步骤:1) 数据预处理:将来自不同来源的关键点数据进行坐标系转换和归一化,使其适应参数模型的输入格式。2) 参数模型优化:使用优化算法(例如,梯度下降)调整MANO或NIMBLE模型的参数(例如,形状参数、姿态参数),使得模型生成的网格上的关键点与输入的关键点尽可能匹配。3) 统一关节生成:从优化后的手部网格中提取统一的手部关节位置,以便于后续的手部相关任务。

关键创新:UniHands的关键创新在于它将参数化的手部模型与野外采集的关键点数据相结合,从而实现了个性化的手部重建。与现有的神经隐式表示方法相比,UniHands使用MANO和NIMBLE等广泛采用的参数模型,具有更好的可扩展性和通用性。此外,UniHands还提出了统一的手部关节定义,方便了手部模型在各种任务中的应用。

关键设计:UniHands的关键设计包括:1) 使用MANO和NIMBLE模型作为手部形状和姿态的先验知识。2) 设计损失函数,用于衡量模型生成的关键点与输入关键点之间的差异,以及模型参数的正则化项。3) 使用优化算法(例如,Adam)迭代更新模型参数,直到损失函数收敛。4) 定义统一的手部关节位置,并从优化后的手部网格中提取这些关节。

🖼️ 关键图片

📊 实验亮点

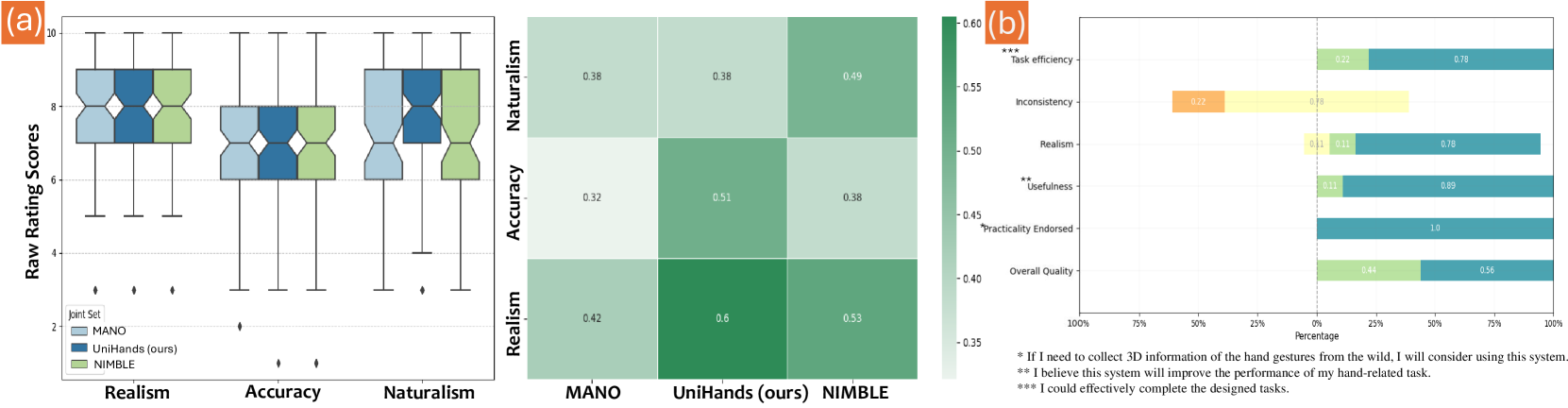

UniHands在FreiHAND和InterHand2.6M数据集上进行了评估,实验结果表明,UniHands能够精确地重建手部网格顶点和关键点,有效地捕捉高度的关节运动。涉及九名参与者的实证研究表明,UniHands的统一关节在准确性和自然性方面明显优于现有的配置(p值为0.016)。这些结果表明,UniHands是一种有效的手部重建方法,具有很高的实用价值。

🎯 应用场景

UniHands具有广泛的应用前景,包括虚拟现实/增强现实(VR/AR)、人机交互、手语识别、远程医疗和游戏等领域。通过提供精确和个性化的手部模型,UniHands可以改善用户在这些应用中的体验,并促进更自然和直观的交互方式。此外,UniHands还可以用于手部动作分析、手部疾病诊断和康复训练等领域。

📄 摘要(原文)

Accurate hand motion capture and standardized 3D representation are essential for various hand-related tasks. Collecting keypoints-only data, while efficient and cost-effective, results in low-fidelity representations and lacks surface information. Furthermore, data inconsistencies across sources challenge their integration and use. We present UniHands, a novel method for creating standardized yet personalized hand models from wild-collected keypoints from diverse sources. Unlike existing neural implicit representation methods, UniHands uses the widely-adopted parametric models MANO and NIMBLE, providing a more scalable and versatile solution. It also derives unified hand joints from the meshes, which facilitates seamless integration into various hand-related tasks. Experiments on the FreiHAND and InterHand2.6M datasets demonstrate its ability to precisely reconstruct hand mesh vertices and keypoints, effectively capturing high-degree articulation motions. Empirical studies involving nine participants show a clear preference for our unified joints over existing configurations for accuracy and naturalism (p-value 0.016).