SignEye: Traffic Sign Interpretation from Vehicle First-Person View

作者: Chuang Yang, Xu Han, Tao Han, Yuejiao SU, Junyu Gao, Hongyuan Zhang, Yi Wang, Lap-Pui Chau

分类: cs.CV

发布日期: 2024-11-18

💡 一句话要点

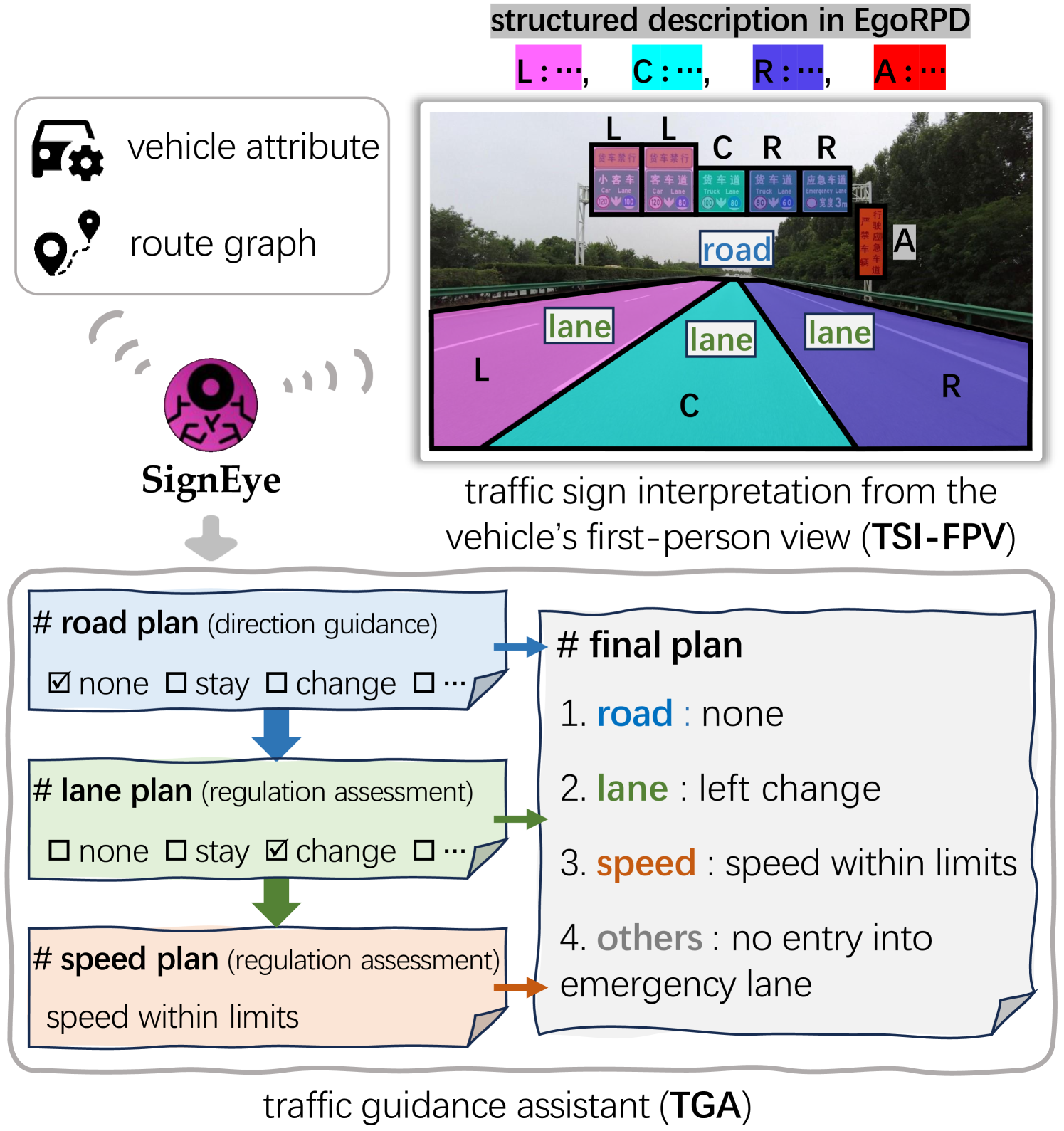

提出SignEye,实现车辆第一人称视角的交通标志理解与交通引导辅助。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 交通标志理解 自动驾驶 第一人称视角 交通引导辅助 空间推理 语义推理 车辆定位

📋 核心要点

- 现有交通标志理解方法缺乏对车辆自身空间位置的考虑,限制了其在法规评估和导航方面的应用。

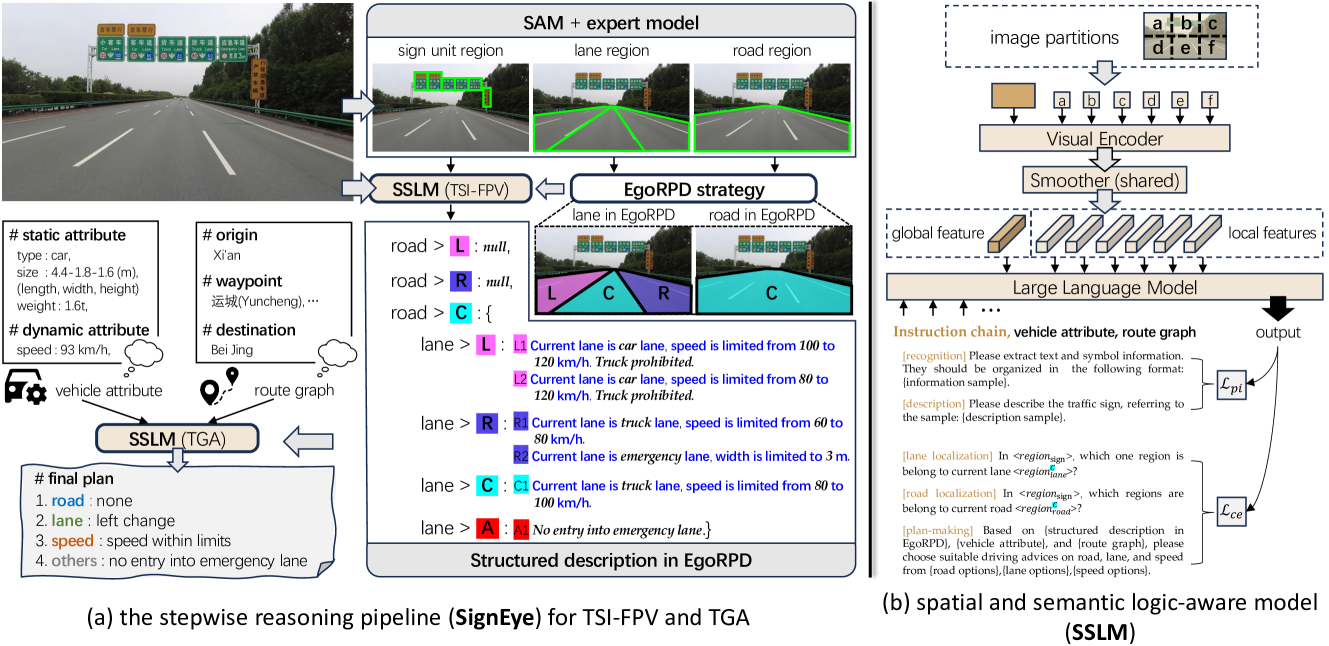

- 论文提出SignEye,一个空间和语义逻辑感知的逐步推理流程,用于实现车辆第一人称视角的交通标志理解和交通引导辅助。

- 实验表明,SignEye在Traffic-CN数据集上训练后,能够有效实现交通标志理解和交通引导辅助,并能为自动驾驶系统提供补充信息。

📝 摘要(中文)

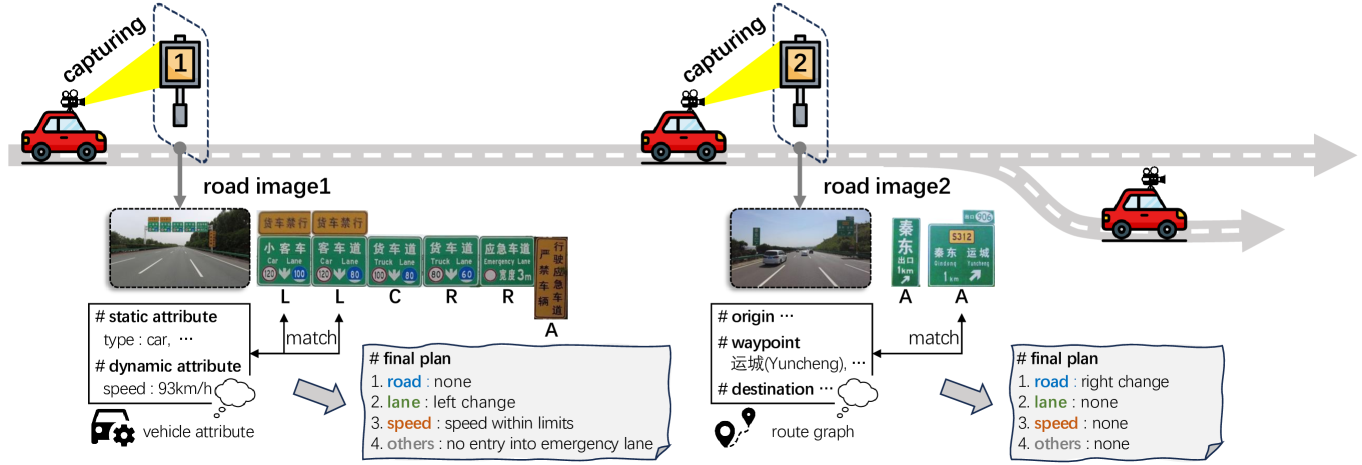

本文提出了一项新任务:从车辆第一人称视角进行交通标志理解(TSI-FPV)。现有工作仅限于基本的标志理解,而忽略了车辆的自我中心空间位置,无法支持进一步的法规评估和方向导航。为此,本文开发了一个交通引导辅助(TGA)场景应用,重新探索交通标志在自动驾驶系统(ADS)中的作用,作为现有自动驾驶技术的补充。TGA并非电子地图导航的替代品,而是一种自动更新和补充工具,适用于离线或临时标志调整等情况。构建了一个空间和语义逻辑感知的逐步推理流程(SignEye)来实现TSI-FPV和TGA,并构建了一个特定于应用程序的数据集(Traffic-CN)。实验表明,通过在Traffic-CN上训练SignEye,可以实现TSI-FPV和TGA。结果还表明,TGA可以为ADS提供超越现有流行自动驾驶技术的补充信息。

🔬 方法详解

问题定义:现有交通标志识别方法主要集中在检测和分类,缺乏对车辆自身位置的感知,无法进行更高级的应用,例如根据交通标志进行导航或评估车辆行为是否符合交通规则。因此,需要一种能够理解交通标志含义,并结合车辆自身位置信息的方法。

核心思路:论文的核心思路是构建一个能够进行空间和语义逻辑推理的系统,该系统能够从车辆第一人称视角理解交通标志,并将其与车辆的行驶行为联系起来。通过逐步推理,系统可以判断车辆是否符合交通规则,并提供相应的导航建议。

技术框架:SignEye包含以下主要模块:1) 交通标志检测模块,用于检测图像中的交通标志;2) 交通标志识别模块,用于识别交通标志的类型和含义;3) 车辆位置估计模块,用于估计车辆在地图上的位置;4) 空间推理模块,用于将交通标志的位置与车辆的位置联系起来;5) 语义推理模块,用于根据交通标志的含义和车辆的位置,判断车辆是否符合交通规则,并提供导航建议。整个流程是一个逐步推理的过程,从图像像素到最终的驾驶决策。

关键创新:论文的关键创新在于提出了一个空间和语义逻辑感知的逐步推理流程,将交通标志理解与车辆自身位置信息相结合,实现了更高级的交通引导辅助功能。与现有方法相比,SignEye不仅能够识别交通标志,还能够理解其含义,并将其应用于实际的驾驶场景中。

关键设计:Traffic-CN数据集是专门为该任务设计的,包含了丰富的交通场景和交通标志信息。SignEye的具体网络结构未知,但强调了空间和语义逻辑推理的重要性,可能使用了图神经网络或类似的结构来建模交通标志之间的关系。损失函数的设计也未知,但推测会包含交通标志识别的损失、车辆位置估计的损失以及驾驶行为预测的损失。

🖼️ 关键图片

📊 实验亮点

论文构建了Traffic-CN数据集,并在此数据集上验证了SignEye的有效性。实验结果表明,SignEye能够有效实现交通标志理解和交通引导辅助,并能为自动驾驶系统提供补充信息。具体的性能数据和对比基线未知,但论文强调了SignEye在提供补充信息方面的优势。

🎯 应用场景

该研究成果可应用于自动驾驶系统,为车辆提供交通引导辅助,尤其是在电子地图数据不完整或离线的情况下。此外,该技术还可用于自动更新电子地图,检测道路上新增或变更的交通标志,提高地图数据的准确性和时效性。该研究具有重要的实际应用价值,有助于提高自动驾驶系统的安全性和可靠性。

📄 摘要(原文)

Traffic signs play a key role in assisting autonomous driving systems (ADS) by enabling the assessment of vehicle behavior in compliance with traffic regulations and providing navigation instructions. However, current works are limited to basic sign understanding without considering the egocentric vehicle's spatial position, which fails to support further regulation assessment and direction navigation. Following the above issues, we introduce a new task: traffic sign interpretation from the vehicle's first-person view, referred to as TSI-FPV. Meanwhile, we develop a traffic guidance assistant (TGA) scenario application to re-explore the role of traffic signs in ADS as a complement to popular autonomous technologies (such as obstacle perception). Notably, TGA is not a replacement for electronic map navigation; rather, TGA can be an automatic tool for updating it and complementing it in situations such as offline conditions or temporary sign adjustments. Lastly, a spatial and semantic logic-aware stepwise reasoning pipeline (SignEye) is constructed to achieve the TSI-FPV and TGA, and an application-specific dataset (Traffic-CN) is built. Experiments show that TSI-FPV and TGA are achievable via our SignEye trained on Traffic-CN. The results also demonstrate that the TGA can provide complementary information to ADS beyond existing popular autonomous technologies.