The Oxford Spires Dataset: Benchmarking Large-Scale LiDAR-Visual Localisation, Reconstruction and Radiance Field Methods

作者: Yifu Tao, Miguel Ángel Muñoz-Bañón, Lintong Zhang, Jiahao Wang, Lanke Frank Tarimo Fu, Maurice Fallon

分类: cs.CV, cs.RO

发布日期: 2024-11-15 (更新: 2025-09-10)

备注: Accepted by IJRR. Website: https://dynamic.robots.ox.ac.uk/datasets/oxford-spires/

💡 一句话要点

发布牛津尖顶数据集,用于大规模激光雷达-视觉定位、重建和辐射场方法评测。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 多模态数据集 激光雷达 视觉定位 三维重建 辐射场 SLAM NeRF

📋 核心要点

- 现有辐射场方法泛化能力弱,易过拟合训练数据,难以适应序列外的位姿。

- 论文核心在于构建大规模多模态数据集,并提供定位、重建和新视角合成的基准。

- 实验表明,辐射场方法在3D重建方面不如MVS系统,数据集将促进二者融合。

📝 摘要(中文)

本文介绍了一个大规模多模态数据集,该数据集在牛津著名地标及其周围区域采集,使用定制的多传感器感知单元以及来自地面激光扫描仪(TLS)的毫米级精度地图。感知单元包括三个同步的全局快门彩色相机、一个车载3D激光雷达扫描仪和一个惯性传感器,所有传感器都经过精确校准。我们还建立了针对定位、重建和新视角合成任务的基准,从而可以评估同步定位与地图构建(SLAM)方法、运动结构恢复(SfM)和多视图立体(MVS)方法以及辐射场方法,例如神经辐射场(NeRF)和3D高斯溅射。为了评估3D重建,TLS 3D模型用作ground truth。定位ground truth是通过将移动激光雷达扫描注册到TLS 3D模型来计算的。辐射场方法不仅使用从输入轨迹采样的姿势进行评估,还使用来自远离训练姿势的轨迹的视点进行评估。我们的评估表明了最先进的辐射场方法的一个关键限制:我们表明它们倾向于过度拟合训练姿势/图像,并且不能很好地推广到序列外的姿势。与使用相同视觉输入的MVS系统相比,它们在3D重建方面的表现也较差。我们的数据集和基准旨在促进辐射场方法和SLAM系统的更好集成。原始和处理后的数据以及用于解析和评估的软件可在https://dynamic.robots.ox.ac.uk/datasets/oxford-spires/上访问。

🔬 方法详解

问题定义:现有辐射场方法在复杂场景下的定位、重建和新视角合成任务中存在泛化能力不足的问题,容易过拟合训练数据,难以适应序列外的位姿,并且在3D重建精度上不如传统的多视图立体方法。

核心思路:通过构建一个大规模、多模态的数据集,并提供相应的评估基准,来促进辐射场方法与SLAM系统的更好集成,从而解决现有方法在泛化性和重建精度上的不足。数据集包含多种传感器数据,并提供了高精度的ground truth,为算法的评估和改进提供了基础。

技术框架:该研究的核心是数据集的构建和基准的建立。数据集包含来自三个同步全局快门彩色相机、一个车载3D激光雷达扫描仪和一个惯性传感器的数据,这些数据都经过精确校准。此外,还使用了地面激光扫描仪(TLS)获取了毫米级精度的地图作为ground truth。基于这些数据,建立了定位、重建和新视角合成的评估基准。

关键创新:该研究的关键创新在于构建了一个大规模、多模态的数据集,并提供了全面的评估基准。该数据集不仅包含多种传感器数据,还提供了高精度的ground truth,这为辐射场方法和SLAM系统的研究提供了重要的资源。此外,该研究还通过实验揭示了现有辐射场方法的局限性,为未来的研究方向提供了指导。

关键设计:数据集采集过程中,使用了定制的多传感器感知单元,保证了数据的同步性和精度。TLS 3D模型被用作3D重建的ground truth,移动激光雷达扫描与TLS 3D模型的配准用于计算定位的ground truth。辐射场方法的评估不仅使用了来自输入轨迹的姿势,还使用了来自远离训练姿势的轨迹的视点,从而更全面地评估了算法的泛化能力。

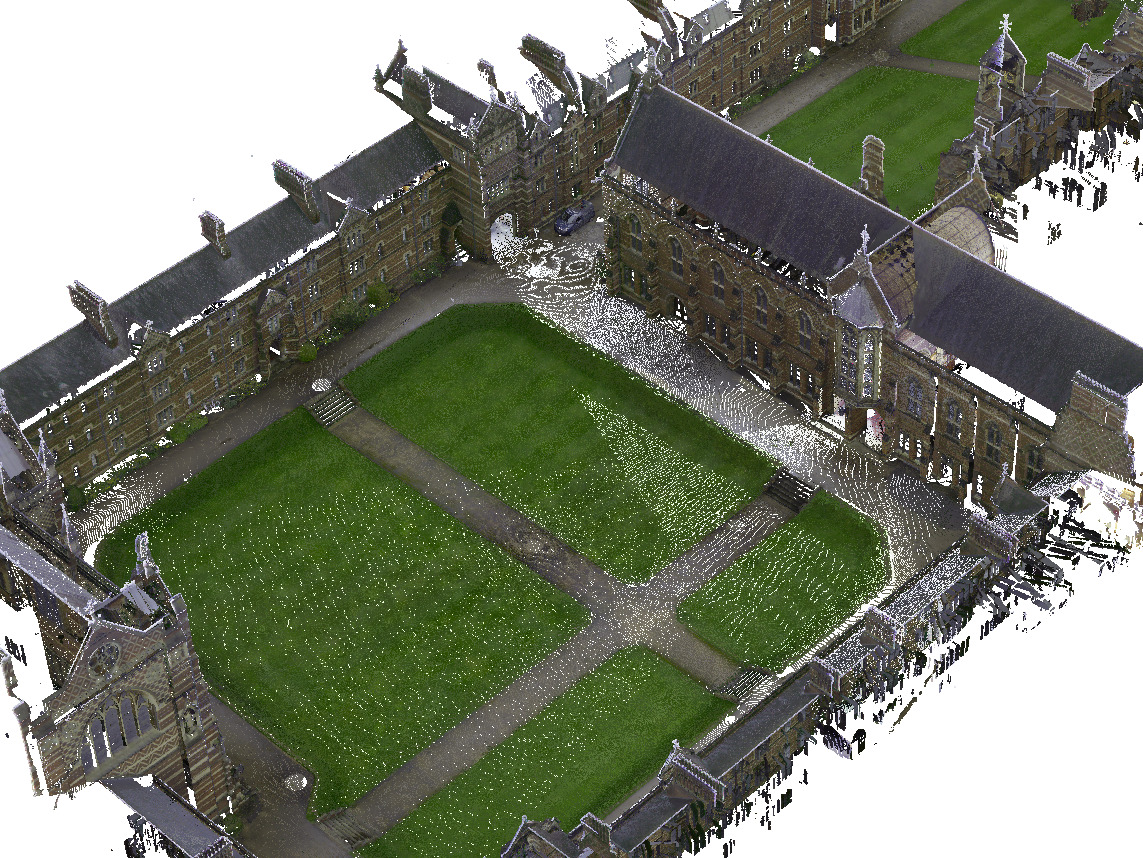

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的辐射场方法在泛化能力方面存在局限性,容易过拟合训练数据,并且在3D重建精度上不如传统的多视图立体方法。该数据集和基准的发布,为后续研究提供了重要的参考,并有望促进辐射场方法与SLAM系统的更好集成。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、三维重建、虚拟现实等领域。高质量数据集和基准测试将促进相关算法的开发和性能提升,推动这些技术在实际场景中的应用,例如在城市环境中进行高精度定位和地图构建。

📄 摘要(原文)

This paper introduces a large-scale multi-modal dataset captured in and around well-known landmarks in Oxford using a custom-built multi-sensor perception unit as well as a millimetre-accurate map from a Terrestrial LiDAR Scanner (TLS). The perception unit includes three synchronised global shutter colour cameras, an automotive 3D LiDAR scanner, and an inertial sensor - all precisely calibrated. We also establish benchmarks for tasks involving localisation, reconstruction, and novel-view synthesis, which enable the evaluation of Simultaneous Localisation and Mapping (SLAM) methods, Structure-from-Motion (SfM) and Multi-view Stereo (MVS) methods as well as radiance field methods such as Neural Radiance Fields (NeRF) and 3D Gaussian Splatting. To evaluate 3D reconstruction the TLS 3D models are used as ground truth. Localisation ground truth is computed by registering the mobile LiDAR scans to the TLS 3D models. Radiance field methods are evaluated not only with poses sampled from the input trajectory, but also from viewpoints that are from trajectories which are distant from the training poses. Our evaluation demonstrates a key limitation of state-of-the-art radiance field methods: we show that they tend to overfit to the training poses/images and do not generalise well to out-of-sequence poses. They also underperform in 3D reconstruction compared to MVS systems using the same visual inputs. Our dataset and benchmarks are intended to facilitate better integration of radiance field methods and SLAM systems. The raw and processed data, along with software for parsing and evaluation, can be accessed at https://dynamic.robots.ox.ac.uk/datasets/oxford-spires/.