Advancing Stroke Risk Prediction Using a Multi-modal Foundation Model

作者: Camille Delgrange, Olga Demler, Samia Mora, Bjoern Menze, Ezequiel de la Rosa, Neda Davoudi

分类: cs.CV, cs.AI

发布日期: 2024-11-14 (更新: 2025-07-08)

备注: Accepted as oral paper at AIM-FM workshop, Neurips 2024

💡 一句话要点

提出多模态自监督框架,融合脑部影像与临床数据,提升卒中风险预测精度。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 卒中风险预测 多模态融合 自监督学习 对比学习 脑部MRI

📋 核心要点

- 现有卒中风险预测方法难以有效整合多源异构数据,限制了预测精度和临床应用价值。

- 提出基于对比学习的多模态自监督框架,通过图像-表格匹配,对齐不同模态数据在共享空间的表示。

- 实验表明,该方法在卒中风险预测任务上显著优于单模态和多模态基线方法,提升了预测准确率。

📝 摘要(中文)

本研究提出了一种自监督多模态框架,旨在整合3D脑部影像、临床数据和图像衍生特征,以提高卒中发病前的风险预测能力。该框架利用大型未标注临床数据集,捕获图像和表格数据模态之间互补和协同的信息。该方法基于对比学习框架,将对比语言-图像预训练与图像-表格匹配模块相结合,从而更好地对齐共享潜在空间中的多模态数据表示。模型在包含结构性脑部MRI和临床数据的UK Biobank上进行训练。研究将该模型的性能与最先进的单模态和多模态方法进行基准测试,使用了表格、图像和图像-表格组合,并在不同的冻结和可训练模型设置下进行评估。结果表明,所提出的模型在ROC-AUC方面优于自监督表格(图像)方法2.6%(2.6%),在平衡准确率方面优于3.3%(5.6%)。此外,与最佳多模态监督模型相比,平衡准确率提高了7.6%。通过可解释工具,该方法展示了表格和图像数据的更好整合,提供了更丰富和更对齐的嵌入。梯度加权类激活映射热图进一步揭示了与脑衰老、卒中风险和临床结果相关的脑区域。这种鲁棒的自监督多模态框架超越了卒中风险预测的最先进方法,并为未来整合多样化数据模态以推进临床预测建模的研究奠定了坚实的基础。

🔬 方法详解

问题定义:现有卒中风险预测方法通常依赖单一数据模态(如临床数据或脑部影像),或简单地将多模态数据进行拼接,无法充分挖掘不同模态数据之间的互补信息和内在关联。这导致预测精度不高,且难以解释模型预测结果,限制了其在临床实践中的应用。

核心思路:本研究的核心思路是利用对比学习,将不同模态的数据(脑部MRI图像和临床表格数据)映射到同一个共享的潜在空间中,使得来自同一患者的不同模态数据在该空间中的表示尽可能接近,而来自不同患者的数据表示尽可能远离。通过这种方式,模型能够学习到不同模态数据之间的关联性,从而实现更准确的卒中风险预测。

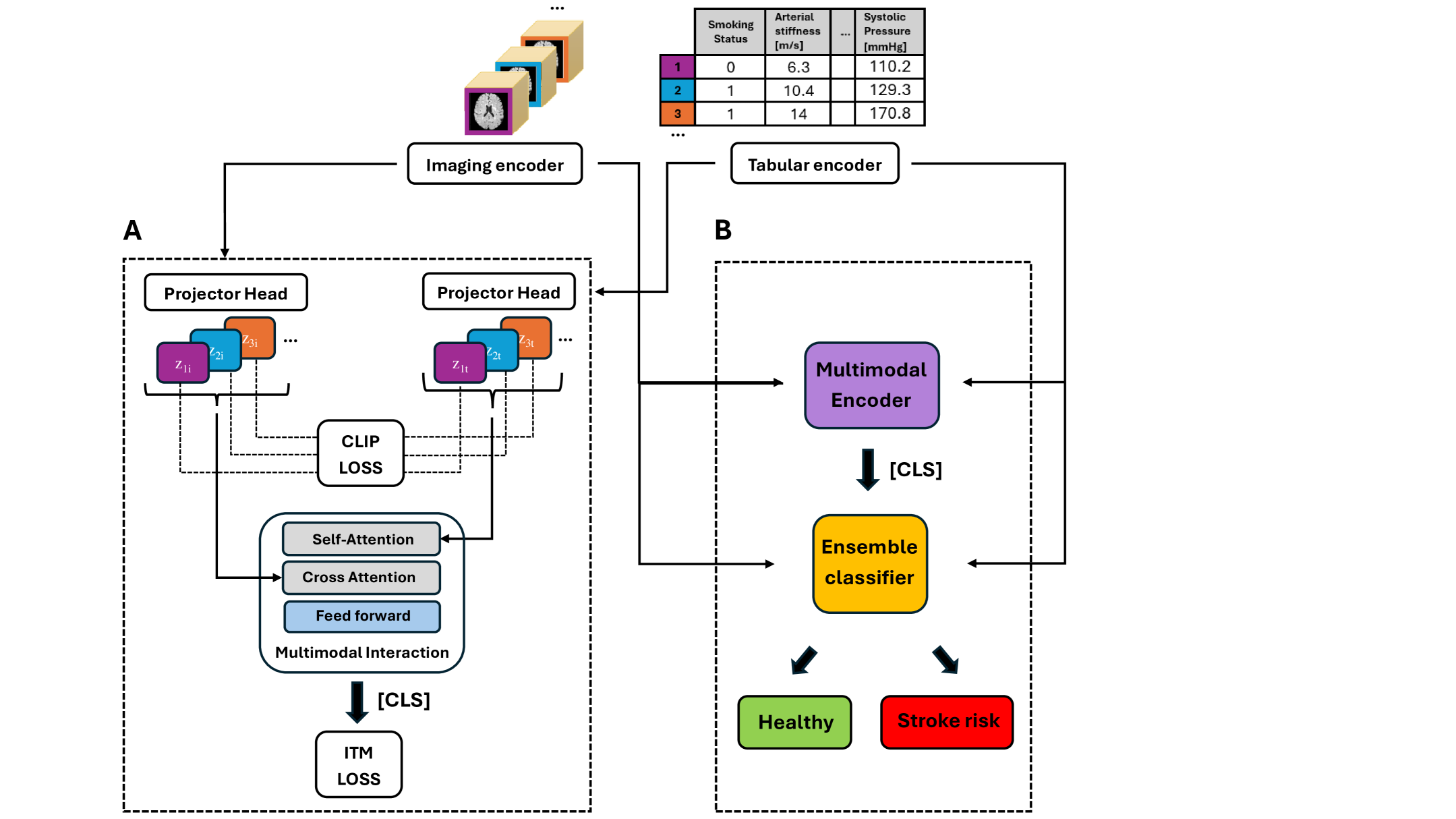

技术框架:该框架包含以下主要模块:1) 图像编码器:用于提取脑部MRI图像的特征表示;2) 表格数据编码器:用于提取临床表格数据的特征表示;3) 对比学习模块:通过对比学习损失函数,促使来自同一患者的图像和表格数据表示在共享潜在空间中对齐;4) 预测模块:利用对齐后的多模态特征表示进行卒中风险预测。框架首先使用对比语言-图像预训练(CLIP)进行初始化,然后通过图像-表格匹配模块进一步对齐多模态数据表示。

关键创新:该研究的关键创新在于提出了一个基于对比学习的多模态自监督框架,能够有效地整合脑部MRI图像和临床表格数据,学习到更鲁棒和更具判别性的多模态特征表示。与传统的监督学习方法相比,该方法能够利用大量的未标注数据进行预训练,从而提高模型的泛化能力。此外,通过可解释性工具,该方法能够揭示模型关注的关键脑区和临床特征,为临床医生提供有价值的参考信息。

关键设计:图像编码器采用3D ResNet架构,表格数据编码器采用多层感知机(MLP)。对比学习损失函数采用InfoNCE损失。图像-表格匹配模块通过计算图像和表格数据表示之间的余弦相似度,并将其作为匹配得分。模型在UK Biobank数据集上进行训练,采用Adam优化器,学习率为1e-4,batch size为64。梯度加权类激活映射(Grad-CAM)用于可视化模型关注的脑区。

🖼️ 关键图片

📊 实验亮点

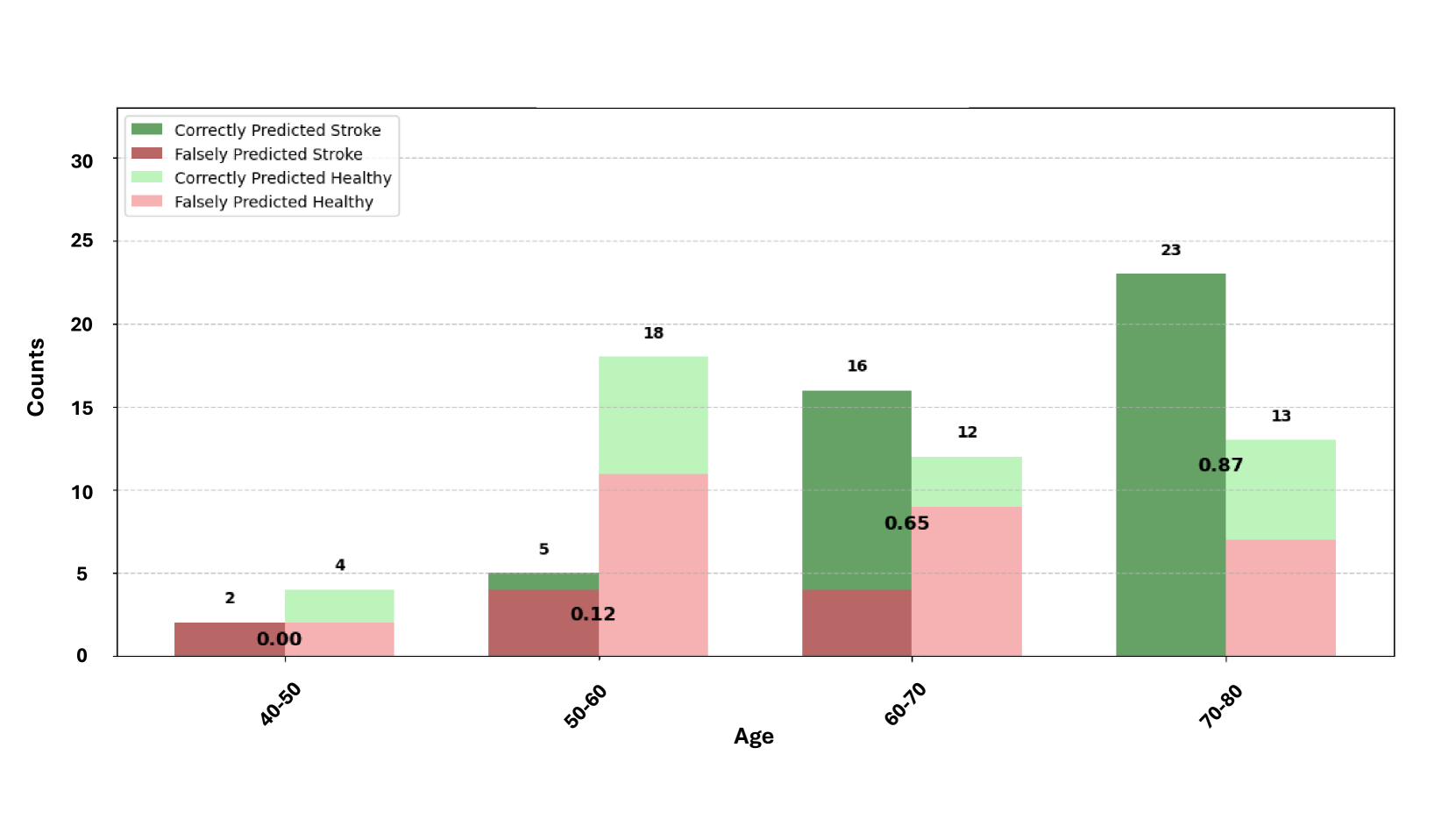

实验结果表明,该模型在ROC-AUC和平衡准确率方面均优于现有的单模态和多模态方法。与自监督表格(图像)方法相比,ROC-AUC分别提升了2.6%,平衡准确率分别提升了3.3%和5.6%。与最佳多模态监督模型相比,平衡准确率提升了7.6%。Grad-CAM可视化结果显示,模型关注的脑区与卒中风险相关的已知区域一致,验证了模型的有效性。

🎯 应用场景

该研究成果可应用于临床卒中风险评估,辅助医生进行早期诊断和干预,降低卒中发病率。此外,该多模态融合框架可推广至其他疾病的风险预测,例如心血管疾病、神经退行性疾病等,具有广阔的应用前景。未来,可进一步探索整合基因组数据、生活方式数据等更多模态信息,提升预测精度和个性化诊疗水平。

📄 摘要(原文)

Predicting stroke risk is a complex challenge that can be enhanced by integrating diverse clinically available data modalities. This study introduces a self-supervised multimodal framework that combines 3D brain imaging, clinical data, and image-derived features to improve stroke risk prediction prior to onset. By leveraging large unannotated clinical datasets, the framework captures complementary and synergistic information across image and tabular data modalities. Our approach is based on a contrastive learning framework that couples contrastive language-image pretraining with an image-tabular matching module, to better align multimodal data representations in a shared latent space. The model is trained on the UK Biobank, which includes structural brain MRI and clinical data. We benchmark its performance against state-of-the-art unimodal and multimodal methods using tabular, image, and image-tabular combinations under diverse frozen and trainable model settings. The proposed model outperformed self-supervised tabular (image) methods by 2.6% (2.6%) in ROC-AUC and by 3.3% (5.6%) in balanced accuracy. Additionally, it showed a 7.6% increase in balanced accuracy compared to the best multimodal supervised model. Through interpretable tools, our approach demonstrated better integration of tabular and image data, providing richer and more aligned embeddings. Gradient-weighted Class Activation Mapping heatmaps further revealed activated brain regions commonly associated in the literature with brain aging, stroke risk, and clinical outcomes. This robust self-supervised multimodal framework surpasses state-of-the-art methods for stroke risk prediction and offers a strong foundation for future studies integrating diverse data modalities to advance clinical predictive modelling.