MFTIQ: Multi-Flow Tracker with Independent Matching Quality Estimation

作者: Jonas Serych, Michal Neoral, Jiri Matas

分类: cs.CV

发布日期: 2024-11-14

备注: accepted to WACV 2025

🔗 代码/项目: GITHUB

💡 一句话要点

MFTIQ:一种具有独立匹配质量估计的多流跟踪器,提升长时跟踪性能。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 长时跟踪 光流 对应质量估计 多流跟踪 视频分析

📋 核心要点

- 现有长时跟踪方法在长时间遮挡和复杂运动场景下,点对应关系的质量评估不够准确,影响跟踪性能。

- MFTIQ通过解耦对应质量估计和光流计算,引入独立质量(IQ)模块,提升了跟踪的准确性和鲁棒性。

- 实验表明,MFTIQ在速度上优于MFT,且在TAP-Vid Davis数据集上,使用RoMa光流时性能可与SOTA跟踪器媲美。

📝 摘要(中文)

本文提出了一种新的密集长时跟踪模型MFTIQ,它改进了多流跟踪器(MFT)框架,以解决视频序列中点级视觉跟踪的挑战。MFTIQ建立在MFT的流链概念之上,集成了一个独立的质量(IQ)模块,该模块将对应质量估计与光流计算分离。这种解耦显著提高了跟踪过程的准确性和灵活性,使MFTIQ即使在长时间遮挡和复杂动态的情况下也能保持可靠的轨迹预测。MFTIQ被设计成“即插即用”的,可以与任何现成的光流方法一起使用,而不需要微调或架构修改。在TAP-Vid Davis数据集上的实验验证表明,使用RoMa光流的MFTIQ不仅超越了MFT,而且性能与最先进的跟踪器相当,同时具有显著更快的处理速度。代码和模型可在https://github.com/serycjon/MFTIQ 获取。

🔬 方法详解

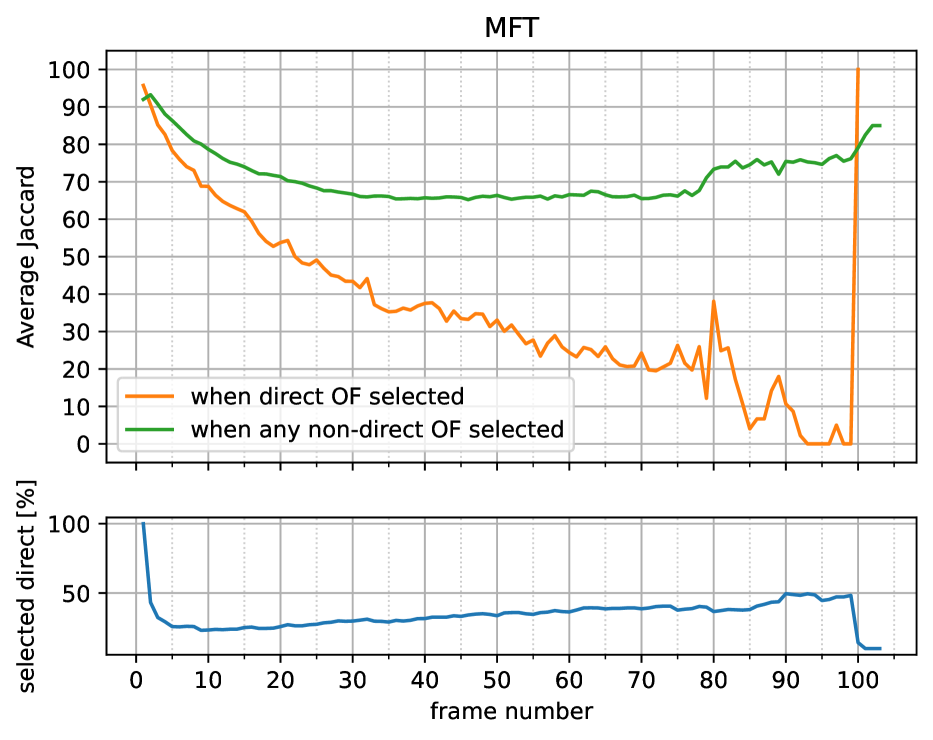

问题定义:现有的长时跟踪方法,尤其是在处理长时间遮挡和复杂运动时,往往难以准确评估点对应关系的质量。这导致跟踪轨迹漂移,最终影响跟踪的准确性和可靠性。MFT方法虽然有效,但其质量评估与光流计算紧密耦合,限制了其灵活性和适应性。

核心思路:MFTIQ的核心思路是将对应质量的估计从光流计算中解耦。通过引入一个独立的质量(IQ)模块,MFTIQ可以更灵活地评估每个对应关系的可靠性,而无需依赖特定的光流算法。这种解耦使得MFTIQ能够更好地处理遮挡和复杂运动,从而提高跟踪的鲁棒性。

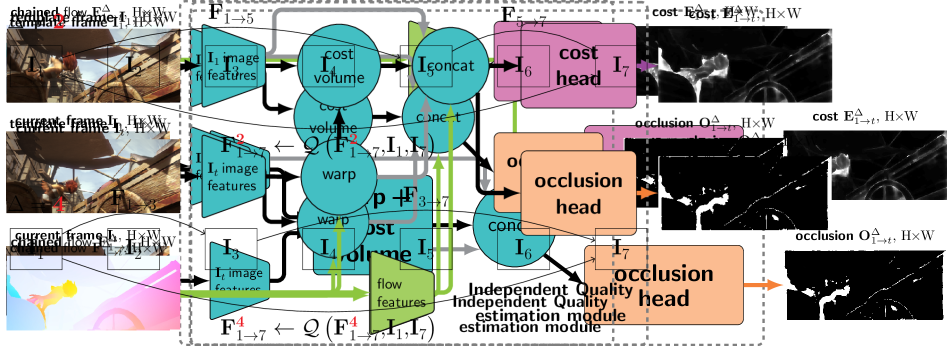

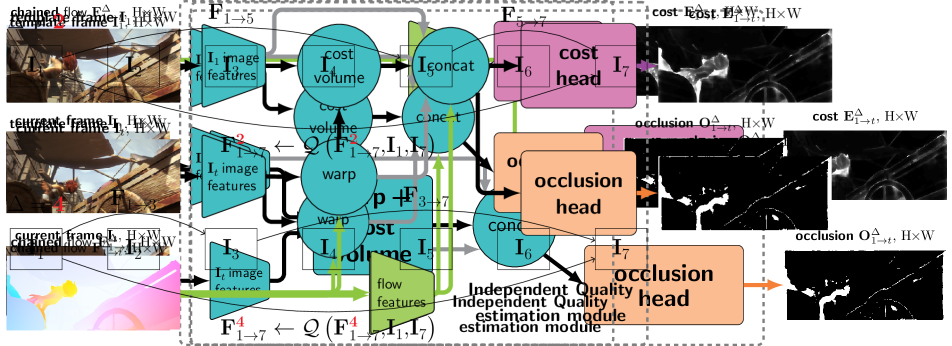

技术框架:MFTIQ建立在MFT框架之上,主要包含以下几个阶段:1) 使用现成的光流算法计算视频帧之间的光流;2) 使用独立的质量(IQ)模块评估每个光流对应关系的质量;3) 利用流链技术,将多个帧之间的光流连接起来,形成轨迹;4) 根据IQ模块的评估结果,对轨迹进行过滤和优化,去除不可靠的对应关系。

关键创新:MFTIQ最重要的技术创新点在于其独立的质量(IQ)模块。该模块将对应质量估计从光流计算中分离出来,使得MFTIQ可以灵活地使用不同的光流算法,并根据场景特点调整质量评估策略。这种解耦是MFTIQ能够有效处理遮挡和复杂运动的关键。

关键设计:IQ模块的具体实现细节未知,论文中可能没有详细描述其网络结构或损失函数。但可以推测,该模块可能使用卷积神经网络(CNN)来提取图像特征,并预测对应关系的质量得分。损失函数可能包括交叉熵损失或均方误差损失,用于训练IQ模块预测准确的质量得分。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MFTIQ在使用RoMa光流时,在TAP-Vid Davis数据集上超越了MFT,并且性能与最先进的跟踪器相当。更重要的是,MFTIQ的处理速度显著快于其他跟踪器,这使其在实时应用中具有优势。代码和模型已开源,方便研究人员复现和改进。

🎯 应用场景

MFTIQ具有广泛的应用前景,包括视频监控、自动驾驶、机器人导航、运动分析等领域。它可以用于跟踪视频中的特定目标,例如行人、车辆或物体,从而实现目标检测、行为识别和场景理解等功能。其高效性和鲁棒性使其特别适用于资源受限的嵌入式系统和实时应用。

📄 摘要(原文)

In this work, we present MFTIQ, a novel dense long-term tracking model that advances the Multi-Flow Tracker (MFT) framework to address challenges in point-level visual tracking in video sequences. MFTIQ builds upon the flow-chaining concepts of MFT, integrating an Independent Quality (IQ) module that separates correspondence quality estimation from optical flow computations. This decoupling significantly enhances the accuracy and flexibility of the tracking process, allowing MFTIQ to maintain reliable trajectory predictions even in scenarios of prolonged occlusions and complex dynamics. Designed to be "plug-and-play", MFTIQ can be employed with any off-the-shelf optical flow method without the need for fine-tuning or architectural modifications. Experimental validations on the TAP-Vid Davis dataset show that MFTIQ with RoMa optical flow not only surpasses MFT but also performs comparably to state-of-the-art trackers while having substantially faster processing speed. Code and models available at https://github.com/serycjon/MFTIQ .