Material Transforms from Disentangled NeRF Representations

作者: Ivan Lopes, Jean-François Lalonde, Raoul de Charette

分类: cs.CV, cs.GR

发布日期: 2024-11-12

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于解耦NeRF表示的材质转换方法,实现跨场景材质编辑

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经辐射场 材质变换 解耦表示 BRDF 计算机图形学

📋 核心要点

- 现有方法难以在不同场景间迁移材质变换,尤其是在光照和几何结构变化时。

- 利用解耦NeRF表示,学习场景对之间的BRDF映射,实现材质变换的迁移。

- 在合成和真实场景中验证,可学习湿度、绘画、涂层等多种材质变换。

📝 摘要(中文)

本文提出了一种新颖的材质转换方法,该方法能够跨不同场景进行材质变换。该方法基于解耦的神经辐射场(NeRF)表示,学习从在不同条件下(例如干燥和潮湿)观察到的场景对中映射双向反射分布函数(BRDF)。然后,可以将学习到的变换应用于具有相似材质的未见场景,从而有效地以任意强度渲染学习到的变换。在合成场景和真实世界对象上的大量实验验证了该方法的有效性,表明它可以学习各种变换,例如湿度、绘画、涂层等。结果不仅突出了该方法的多功能性,还突出了其在计算机图形学中的潜在实际应用。我们发布了该方法的实现,以及我们的合成/真实数据集。

🔬 方法详解

问题定义:现有方法在材质编辑和转换方面存在局限性,尤其是在处理不同场景和光照条件下的材质变换时。直接应用图像处理技术难以保持材质的物理一致性,且泛化能力较差。因此,需要一种能够学习和迁移材质属性,并在新场景中保持真实感的方法。

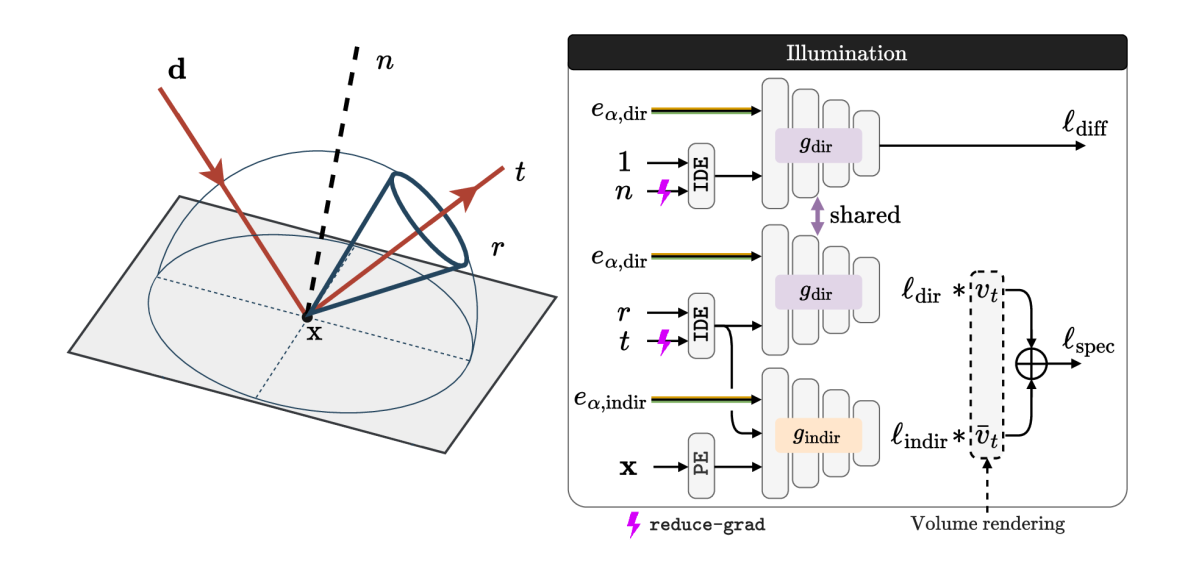

核心思路:本文的核心思路是利用解耦的NeRF表示来分离场景的几何结构和材质属性。通过学习不同场景(例如干燥和潮湿)之间的BRDF映射关系,可以将材质变换从一个场景迁移到另一个场景。这种方法能够有效地解耦光照、几何和材质,从而实现更灵活和真实的材质编辑。

技术框架:该方法的技术框架主要包括以下几个阶段:1) 使用NeRF表示重建场景;2) 解耦NeRF表示,分离几何结构和材质属性;3) 学习场景对之间的BRDF映射关系,建立材质变换模型;4) 将学习到的材质变换应用于新的场景,渲染出变换后的效果。整体流程是从场景重建到材质解耦,再到变换学习和应用。

关键创新:该方法最重要的技术创新点在于利用解耦的NeRF表示来实现材质变换的迁移。与传统的基于图像处理或手工设计的材质编辑方法不同,该方法能够自动学习材质变换的规律,并在新场景中保持材质的物理一致性。此外,该方法还能够处理复杂的光照和几何结构变化,具有较强的泛化能力。

关键设计:在关键设计方面,该方法采用了基于神经网络的BRDF映射模型,通过学习场景对之间的对应关系来实现材质变换。损失函数的设计考虑了材质变换的真实性和一致性,例如,可以使用感知损失来保证变换后的图像质量,并使用正则化项来约束BRDF参数的范围。网络结构的设计也需要考虑材质变换的复杂性,例如,可以使用多层感知机或卷积神经网络来学习复杂的BRDF映射关系。

🖼️ 关键图片

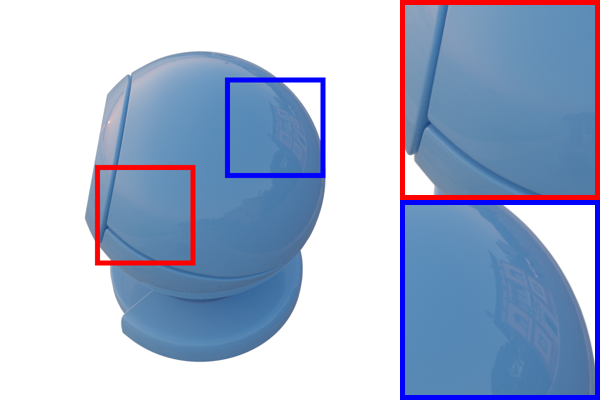

📊 实验亮点

实验结果表明,该方法能够在合成和真实场景中有效地学习和迁移各种材质变换,例如湿度、绘画、涂层等。在视觉效果上,该方法能够生成逼真的材质变换效果,并在新场景中保持材质的物理一致性。与现有的材质编辑方法相比,该方法具有更强的泛化能力和更好的视觉效果。实验结果还表明,该方法能够处理复杂的光照和几何结构变化,具有较强的鲁棒性。

🎯 应用场景

该研究成果可广泛应用于计算机图形学、游戏开发、虚拟现实等领域。例如,可以用于快速创建具有不同材质效果的3D模型,模拟不同环境条件下的物体外观,或者实现虚拟试穿、虚拟装修等应用。该方法还可用于增强现实应用,例如将虚拟物体与真实场景进行无缝融合,并根据环境光照条件调整虚拟物体的材质属性。

📄 摘要(原文)

In this paper, we first propose a novel method for transferring material transformations across different scenes. Building on disentangled Neural Radiance Field (NeRF) representations, our approach learns to map Bidirectional Reflectance Distribution Functions (BRDF) from pairs of scenes observed in varying conditions, such as dry and wet. The learned transformations can then be applied to unseen scenes with similar materials, therefore effectively rendering the transformation learned with an arbitrary level of intensity. Extensive experiments on synthetic scenes and real-world objects validate the effectiveness of our approach, showing that it can learn various transformations such as wetness, painting, coating, etc. Our results highlight not only the versatility of our method but also its potential for practical applications in computer graphics. We publish our method implementation, along with our synthetic/real datasets on https://github.com/astra-vision/BRDFTransform