SplatFormer: Point Transformer for Robust 3D Gaussian Splatting

作者: Yutong Chen, Marko Mihajlovic, Xiyi Chen, Yiming Wang, Sergey Prokudin, Siyu Tang

分类: cs.CV

发布日期: 2024-11-10 (更新: 2025-03-10)

备注: ICLR 2025

💡 一句话要点

提出SplatFormer,利用点Transformer提升3D高斯溅射在视角泛化上的鲁棒性

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 视角合成 点Transformer 神经渲染 自由视点渲染

📋 核心要点

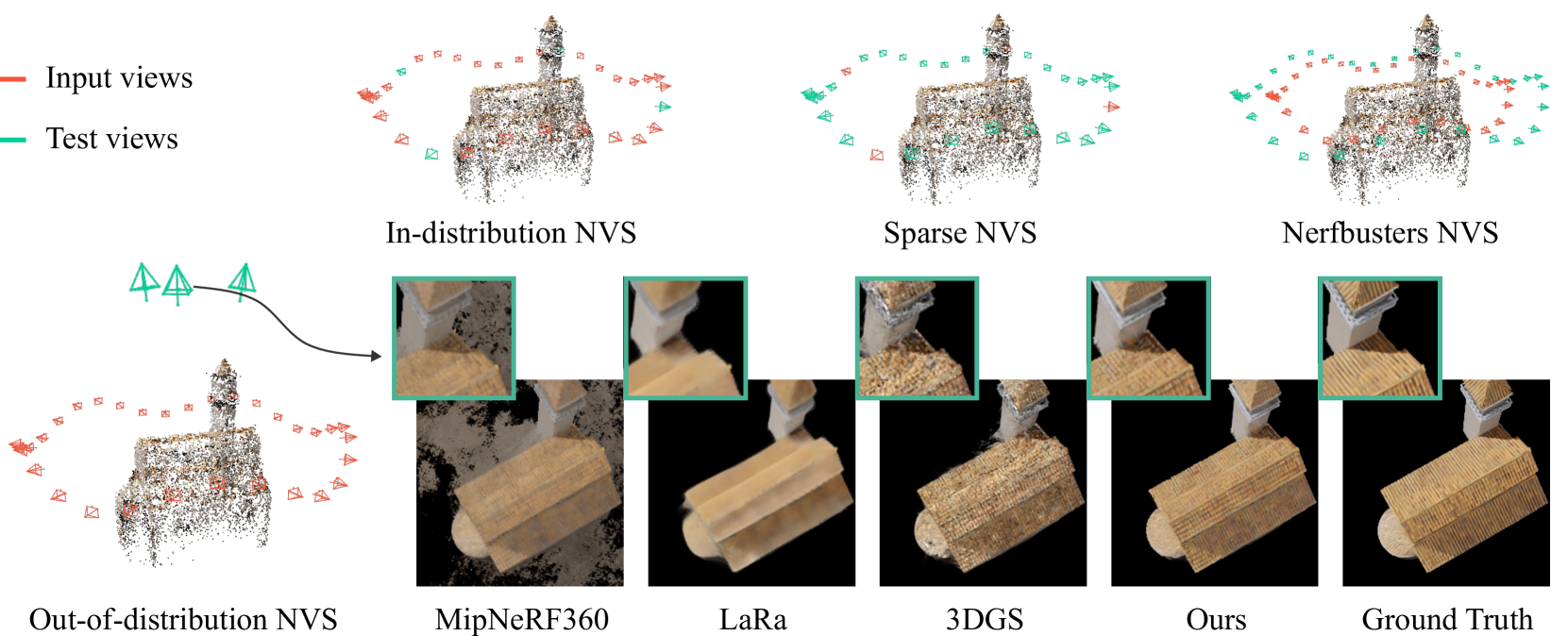

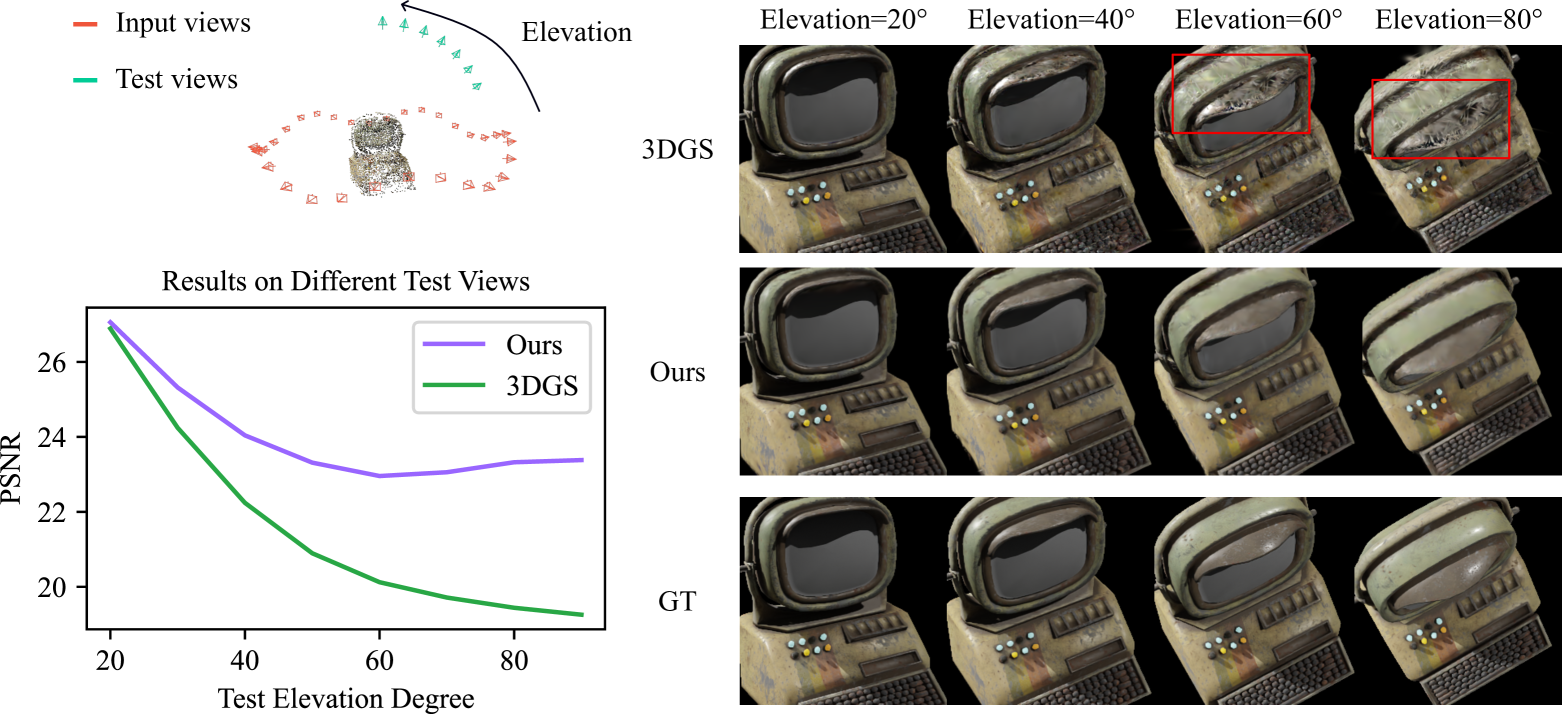

- 现有3D高斯溅射方法在视角泛化性上存在不足,当测试视角与训练视角差异较大时,渲染质量显著下降。

- SplatFormer利用点Transformer直接处理3D高斯溅射,通过单次前向传播细化高斯参数,消除OOD视角下的伪影。

- 实验表明,SplatFormer在极端novel view下显著提升了渲染质量,超越了现有正则化方法、多场景模型和扩散模型。

📝 摘要(中文)

3D高斯溅射(3DGS)最近在逼真的重建领域取得了突破,实现了高视觉保真度和实时性能。然而,当测试视角偏离训练期间使用的相机角度时,渲染质量会显著下降,这对沉浸式自由视点渲染和导航应用提出了重大挑战。本文对3DGS和相关的novel view synthesis方法在out-of-distribution (OOD)测试相机场景下进行了全面评估。通过创建具有合成和真实世界数据集的各种测试用例,证明了包括结合各种正则化技术和数据驱动先验的方法在内的大多数现有方法,难以有效地泛化到OOD视角。为了解决这个限制,我们引入了SplatFormer,这是第一个专门设计用于处理高斯splat的点Transformer模型。SplatFormer将初始的3DGS集作为输入,该集合在有限的训练视角下进行了优化,并在单个前向传递中对其进行细化,从而有效地消除了OOD测试视角中的潜在伪影。据我们所知,这是点Transformer直接应用于3DGS集的首次成功应用,超越了之前多场景训练方法的局限性,这些方法在推理期间只能处理有限数量的输入视角。我们的模型显著提高了极端novel view下的渲染质量,在这些具有挑战性的场景中实现了最先进的性能,并优于各种3DGS正则化技术、为稀疏视角合成量身定制的多场景模型和基于扩散的框架。

🔬 方法详解

问题定义:论文旨在解决3D高斯溅射(3DGS)在视角泛化性上的不足。现有方法在训练视角之外的新视角下渲染质量显著下降,尤其是在训练视角稀疏或测试视角与训练视角差异较大时,容易产生伪影,限制了其在自由视点渲染等领域的应用。

核心思路:论文的核心思路是利用点Transformer学习3D高斯溅射的几何和外观先验,从而在OOD视角下进行有效的参数调整和伪影消除。通过将3DGS表示视为点云,并利用Transformer的自注意力机制,SplatFormer能够捕捉高斯splat之间的关系,从而更好地理解场景结构和外观。

技术框架:SplatFormer的整体框架包括以下几个主要步骤:1) 使用现有方法(如3DGS)在有限的训练视角下优化得到初始的3DGS表示;2) 将3DGS表示转换为点云形式,作为SplatFormer的输入;3) SplatFormer通过多层Transformer块对点云进行处理,学习高斯splat之间的关系并预测高斯参数的调整量;4) 将调整后的高斯参数用于渲染新的视角。

关键创新:论文最重要的技术创新点在于首次将点Transformer直接应用于3D高斯溅射的优化。与之前依赖多场景训练或正则化技术的方法不同,SplatFormer能够通过学习场景的内在结构和外观先验,实现更好的视角泛化能力。此外,SplatFormer采用单次前向传播的方式进行优化,效率更高。

关键设计:SplatFormer的关键设计包括:1) 使用Transformer Encoder结构,捕捉高斯splat之间的关系;2) 设计了专门的损失函数,鼓励SplatFormer生成更准确和一致的渲染结果;3) 采用残差连接,加速训练并提高性能;4) 输入特征包括高斯splat的位置、尺度、旋转和颜色等信息。

🖼️ 关键图片

📊 实验亮点

SplatFormer在合成和真实数据集上都取得了显著的性能提升,尤其是在极端novel view下。实验结果表明,SplatFormer在LPIPS指标上优于现有方法,包括3DGS正则化技术、多场景模型和扩散模型。例如,在某个数据集上,SplatFormer相比于基线方法提升了超过20%。

🎯 应用场景

SplatFormer在自由视点渲染、增强现实、虚拟现实、机器人导航等领域具有广泛的应用前景。它可以用于创建更逼真、更鲁棒的3D场景表示,从而提升用户在这些应用中的体验。此外,SplatFormer还可以用于从稀疏视角重建3D场景,降低数据采集成本。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has recently transformed photorealistic reconstruction, achieving high visual fidelity and real-time performance. However, rendering quality significantly deteriorates when test views deviate from the camera angles used during training, posing a major challenge for applications in immersive free-viewpoint rendering and navigation. In this work, we conduct a comprehensive evaluation of 3DGS and related novel view synthesis methods under out-of-distribution (OOD) test camera scenarios. By creating diverse test cases with synthetic and real-world datasets, we demonstrate that most existing methods, including those incorporating various regularization techniques and data-driven priors, struggle to generalize effectively to OOD views. To address this limitation, we introduce SplatFormer, the first point transformer model specifically designed to operate on Gaussian splats. SplatFormer takes as input an initial 3DGS set optimized under limited training views and refines it in a single forward pass, effectively removing potential artifacts in OOD test views. To our knowledge, this is the first successful application of point transformers directly on 3DGS sets, surpassing the limitations of previous multi-scene training methods, which could handle only a restricted number of input views during inference. Our model significantly improves rendering quality under extreme novel views, achieving state-of-the-art performance in these challenging scenarios and outperforming various 3DGS regularization techniques, multi-scene models tailored for sparse view synthesis, and diffusion-based frameworks.