AI-Driven Stylization of 3D Environments

作者: Yuanbo Chen, Yixiao Kang, Yukun Song, Cyrus Vachha, Sining Huang

分类: cs.CV, cs.GR

发布日期: 2024-11-09

💡 一句话要点

提出基于AI的3D环境风格化系统,利用NeRFs和3D高斯溅射实现高质量场景生成。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D场景风格化 NeRFs 3D高斯溅射 图像风格化 图像到3D生成

📋 核心要点

- 现有3D场景风格化方法在处理复杂场景和保持风格一致性方面存在挑战,难以生成高质量的风格化结果。

- 该方法利用图像风格化和图像到3D生成模型,迭代地对3D对象进行风格化和组合,从而实现场景的整体风格化。

- 实验结果展示了该方法在将生成的对象添加到场景中的有效性,但同时也指出了当前方法的局限性。

📝 摘要(中文)

本文提出了一种将3D原始对象场景风格化为更高质量3D场景的方法,该方法利用了诸如NeRFs和3D高斯溅射等新型3D表示。我们的方法利用现有的图像风格化系统和图像到3D生成模型,创建了一个迭代地对3D对象进行风格化并将其组合到场景中的流程。我们展示了将生成的对象添加到场景中的结果,并讨论了局限性。

🔬 方法详解

问题定义:论文旨在解决如何将由简单3D图元构成的场景,自动风格化为具有更高视觉质量和艺术风格的3D场景的问题。现有方法可能依赖于手动建模或复杂的几何处理,难以自动化且效率较低。此外,保持风格的一致性也是一个挑战。

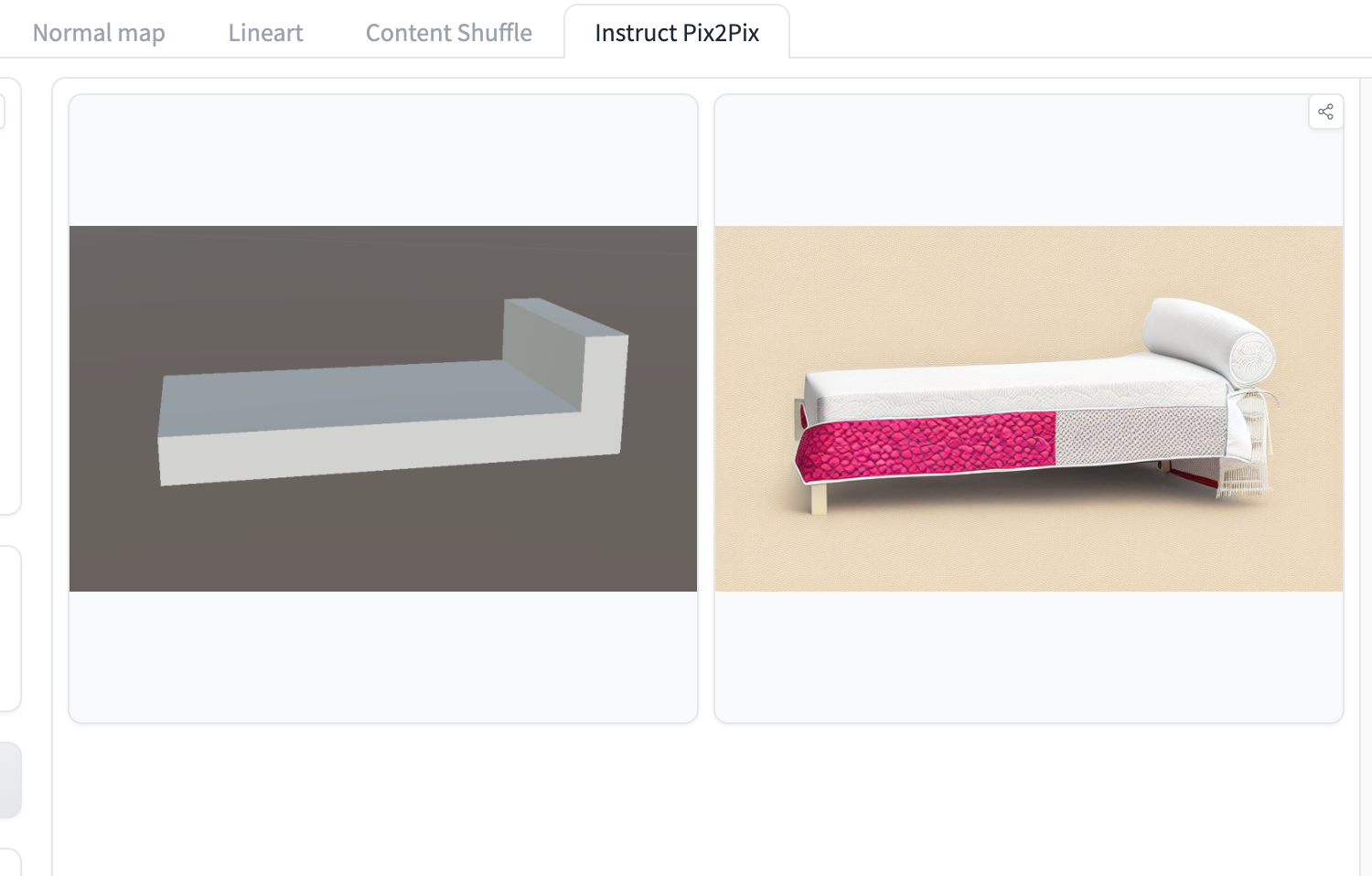

核心思路:论文的核心思路是利用现有的图像风格化技术和图像到3D的生成模型,构建一个迭代的风格化流程。通过将3D场景渲染成图像,然后使用图像风格化方法进行处理,再将风格化的图像转换回3D表示,从而实现3D场景的风格化。这种方法将复杂的3D风格化问题分解为更容易处理的2D图像风格化和图像到3D重建问题。

技术框架:整体框架包含以下几个主要阶段:1) 将3D原始场景渲染成2D图像;2) 使用现有的图像风格化系统对2D图像进行风格化;3) 使用图像到3D的生成模型,将风格化的2D图像重建为3D表示(例如NeRFs或3D高斯溅射);4) 将生成的3D对象组合回原始场景中。这个过程可以迭代进行,以逐步提高风格化的质量。

关键创新:该方法的主要创新在于将图像风格化和图像到3D生成模型结合起来,形成一个端到端的3D场景风格化流程。通过这种方式,可以利用现有的成熟的图像处理技术来解决3D场景风格化的问题,避免了直接在3D空间中进行复杂风格化操作的困难。

关键设计:论文中关键的设计包括:选择合适的图像风格化算法(例如基于神经网络的风格迁移方法),选择合适的图像到3D生成模型(例如NeRFs或3D高斯溅射),以及设计迭代的风格化流程。具体的参数设置和损失函数取决于所选择的图像风格化和图像到3D生成模型。此外,如何有效地将生成的3D对象组合回原始场景中,也是一个需要考虑的关键设计。

🖼️ 关键图片

📊 实验亮点

论文展示了将生成的对象添加到场景中的结果,验证了该方法的可行性。虽然论文中没有提供具体的性能数据或与其他基线的定量比较,但通过视觉效果展示了该方法在3D场景风格化方面的潜力。未来的工作可以集中在提高风格化质量、减少生成伪影以及提高生成效率等方面。

🎯 应用场景

该研究成果可应用于游戏开发、虚拟现实、电影制作等领域,用于快速生成具有特定艺术风格的3D场景。例如,可以根据用户提供的风格图像,自动将简单的3D场景转换为具有特定艺术风格的虚拟环境。此外,该技术还可以用于3D内容的增强和修复,例如将低质量的3D模型转换为高质量的风格化模型。

📄 摘要(原文)

In this system, we discuss methods to stylize a scene of 3D primitive objects into a higher fidelity 3D scene using novel 3D representations like NeRFs and 3D Gaussian Splatting. Our approach leverages existing image stylization systems and image-to-3D generative models to create a pipeline that iteratively stylizes and composites 3D objects into scenes. We show our results on adding generated objects into a scene and discuss limitations.