PEP-GS: Perceptually-Enhanced Precise Structured 3D Gaussians for View-Adaptive Rendering

作者: Junxi Jin, Xiulai Li, Haiping Huang, Lianjun Liu, Yujie Sun, Logan Liu

分类: cs.CV

发布日期: 2024-11-08 (更新: 2025-05-15)

💡 一句话要点

PEP-GS:感知增强的精确结构化3D高斯,用于视角自适应渲染

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 视角自适应渲染 感知增强 分层注意力机制 神经渲染

📋 核心要点

- 现有3D高斯溅射方法在高斯冗余、视角相关效果捕捉和复杂光照处理方面存在不足。

- PEP-GS通过动态预测高斯属性和引入分层粒度结构注意力机制,提升视角相关颜色效果的建模能力。

- 实验结果表明,PEP-GS在视角相关效果和精细尺度细节方面优于现有技术,提升了渲染质量。

📝 摘要(中文)

本文提出了一种感知增强框架PEP-GS,用于解决3D高斯溅射(3D-GS)在实时高质量3D场景渲染中面临的挑战,包括高斯冗余、视角相关效果捕捉能力有限以及处理复杂光照和镜面反射的困难。该框架动态预测高斯属性,包括不透明度、颜色和协方差。通过使用分层粒度结构注意力机制取代传统的球谐函数,更准确地建模复杂的视角相关颜色效果。此外,PEP-GS采用稳定且可解释的不透明度和协方差估计框架,避免过早移除重要的高斯,确保更精确的场景表示。最后,对最终渲染图像应用感知优化,增强不同视角下感知一致性,并确保高质量渲染,改善纹理保真度和精细尺度细节保留。实验结果表明,PEP-GS优于现有方法,尤其是在涉及视角相关效果和精细尺度细节的挑战性场景中。

🔬 方法详解

问题定义:现有3D高斯溅射方法在场景表示上存在冗余,难以有效捕捉视角相关的光照和颜色变化,尤其是在复杂光照条件下,对各向异性分量的建模能力不足,导致渲染结果对比度不足,颜色饱和度不自然。此外,现有方法在不透明度和协方差估计方面不够稳定,容易过早移除重要的Gaussians,影响场景表示的准确性。

核心思路:PEP-GS的核心思路是通过感知增强的方式,动态预测高斯属性,并引入分层粒度结构注意力机制来更精确地建模视角相关的颜色效果。同时,采用稳定且可解释的不透明度和协方差估计框架,避免过早移除重要的高斯,从而提高场景表示的准确性和渲染质量。最后,通过感知优化来增强不同视角下渲染结果的感知一致性。

技术框架:PEP-GS框架主要包含以下几个阶段:1) 高斯属性动态预测:使用神经网络预测每个高斯的不透明度、颜色和协方差。2) 分层粒度结构注意力机制:取代传统的球谐函数,用于建模视角相关的颜色效果。3) 稳定不透明度和协方差估计:采用一种稳定且可解释的框架,避免过早移除重要的高斯。4) 感知优化:对最终渲染图像进行感知优化,增强不同视角下的感知一致性。

关键创新:PEP-GS的关键创新在于:1) 引入了分层粒度结构注意力机制,能够更准确地建模复杂的视角相关颜色效果,克服了传统球谐函数的局限性。2) 提出了稳定且可解释的不透明度和协方差估计框架,避免了过早移除重要高斯的问题,提高了场景表示的准确性。3) 采用了感知优化方法,增强了不同视角下渲染结果的感知一致性。

关键设计:在分层粒度结构注意力机制中,具体实现细节未知,但其核心思想是利用分层结构来捕捉不同尺度的视角相关信息,并使用注意力机制来选择性地关注重要的特征。在不透明度和协方差估计方面,具体实现细节未知,但其目标是设计一种稳定且可解释的框架,避免梯度消失或爆炸等问题。感知优化阶段,具体采用的损失函数未知,但其目标是最小化不同视角下渲染结果的感知差异。

🖼️ 关键图片

📊 实验亮点

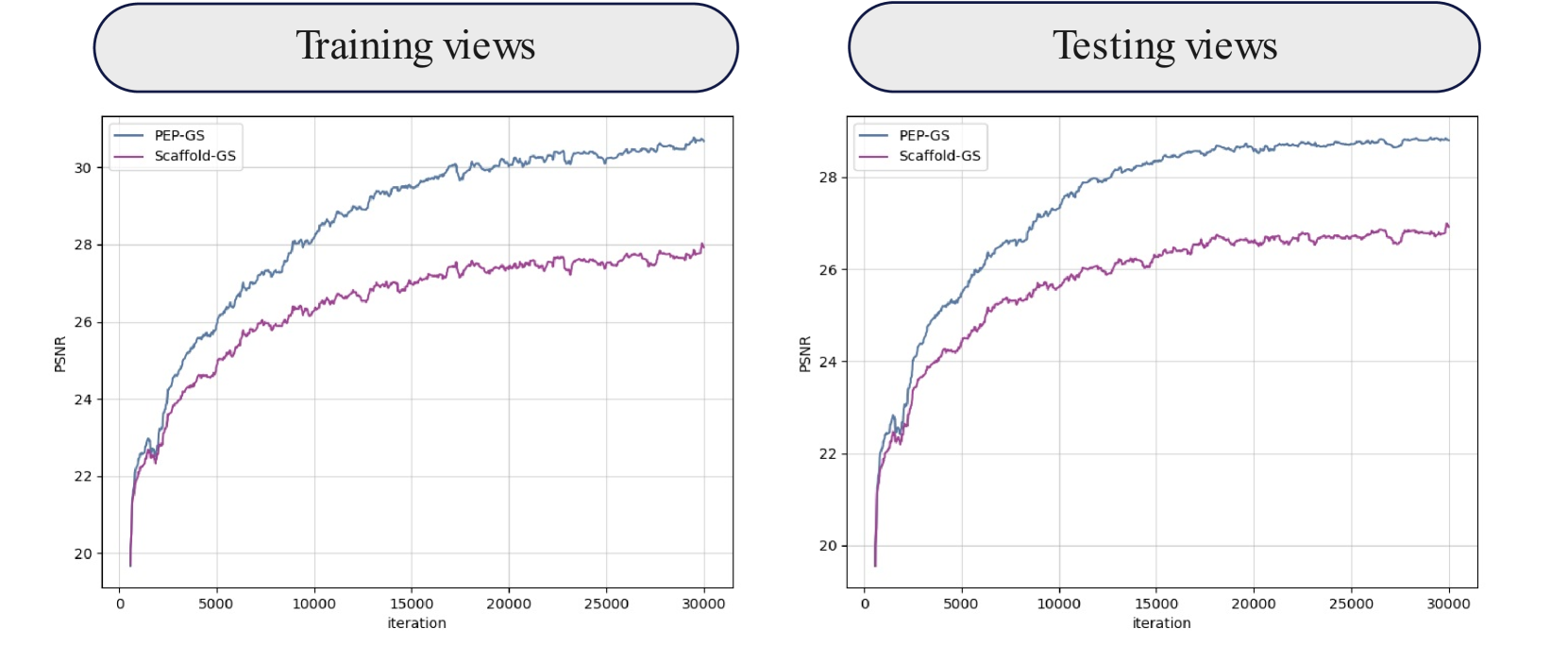

实验结果表明,PEP-GS在视角相关效果和精细尺度细节方面显著优于现有方法。具体性能提升数据未知,但论文强调了在具有挑战性的场景中,PEP-GS能够生成更高质量的渲染结果,具有更好的纹理保真度和精细尺度细节保留能力。与现有技术相比,PEP-GS在主观视觉效果上具有明显优势。

🎯 应用场景

PEP-GS在虚拟现实、增强现实、游戏开发、自动驾驶等领域具有广泛的应用前景。它可以用于创建更逼真、更具沉浸感的3D场景,提高用户体验。此外,该技术还可以应用于机器人导航、三维重建等领域,为相关应用提供更准确、更可靠的场景表示。

📄 摘要(原文)

Recently, 3D Gaussian Splatting (3D-GS) has achieved significant success in real-time, high-quality 3D scene rendering. However, it faces several challenges, including Gaussian redundancy, limited ability to capture view-dependent effects, and difficulties in handling complex lighting and specular reflections. Additionally, methods that use spherical harmonics for color representation often struggle to effectively capture anisotropic components, especially when modeling view-dependent colors under complex lighting conditions, leading to insufficient contrast and unnatural color saturation. To address these limitations, we introduce PEP-GS, a perceptually-enhanced framework that dynamically predicts Gaussian attributes, including opacity, color, and covariance. We replace traditional spherical harmonics with a Hierarchical Granular-Structural Attention mechanism, which enables more accurate modeling of complex view-dependent color effects. By employing a stable and interpretable framework for opacity and covariance estimation, PEP-GS avoids the removal of essential Gaussians prematurely, ensuring a more accurate scene representation. Furthermore, perceptual optimization is applied to the final rendered images, enhancing perceptual consistency across different views and ensuring high-quality renderings with improved texture fidelity and fine-scale detail preservation. Experimental results demonstrate that PEP-GS outperforms state-of-the-art methods, particularly in challenging scenarios involving view-dependent effects and fine-scale details.