LLM2CLIP: Powerful Language Model Unlocks Richer Visual Representation

作者: Weiquan Huang, Aoqi Wu, Yifan Yang, Xufang Luo, Yuqing Yang, Liang Hu, Qi Dai, Chunyu Wang, Xiyang Dai, Dongdong Chen, Chong Luo, Lili Qiu

分类: cs.CV, cs.CL

发布日期: 2024-11-07 (更新: 2026-01-17)

💡 一句话要点

LLM2CLIP:利用大型语言模型增强CLIP的视觉表征能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 大型语言模型 对比学习 图像检索 零样本学习 视觉表征 CLIP 后训练

📋 核心要点

- 现有CLIP模型在处理复杂图像描述时存在局限性,无法充分利用长文本信息。

- 提出LLM2CLIP,通过后训练策略将LLM融入CLIP,利用LLM增强文本理解能力。

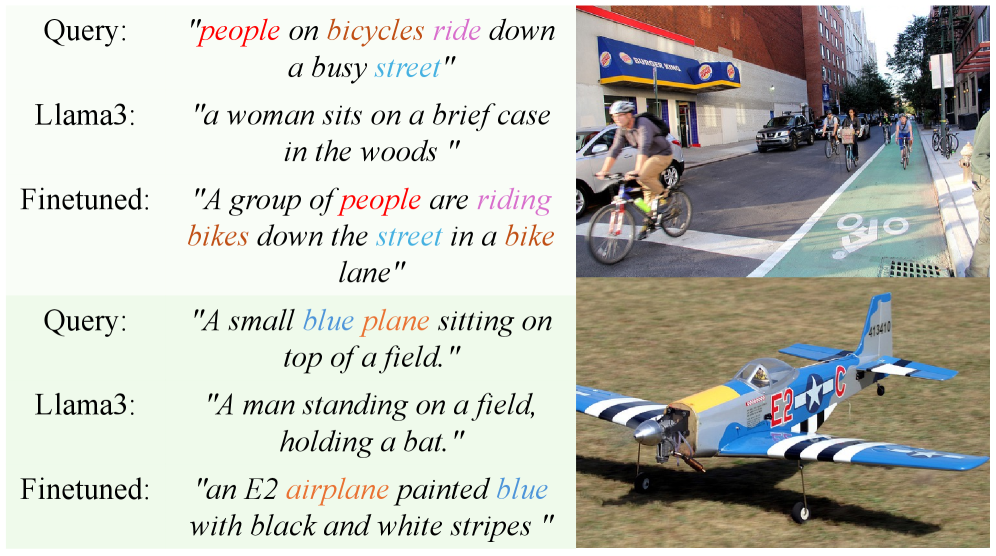

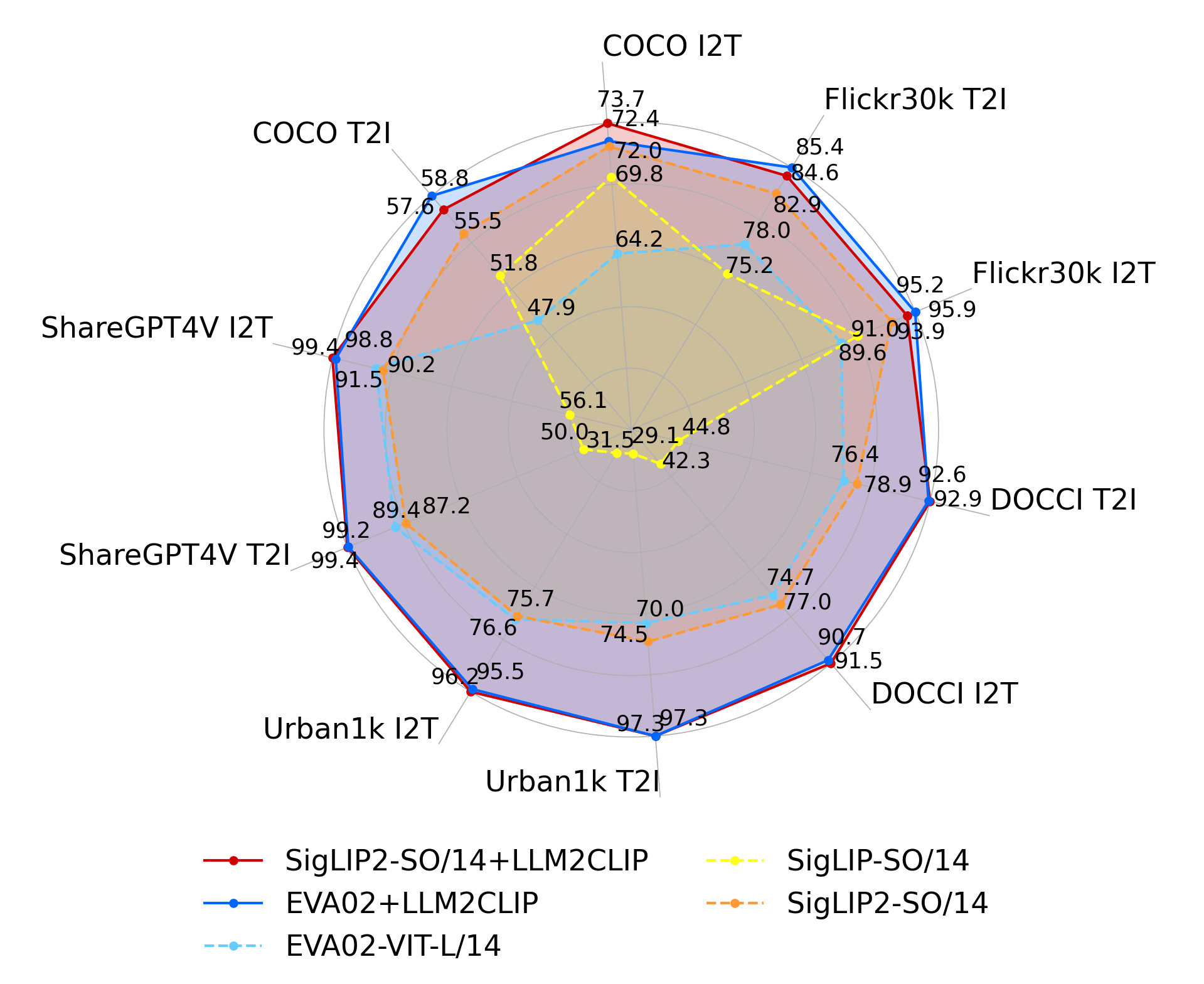

- 实验表明,LLM2CLIP在多项任务上超越了CLIP、EVA02和SigLip2等模型,训练速度更快。

📝 摘要(中文)

CLIP是一个基础的多模态模型,它通过在大规模图像-文本对上进行对比学习,将图像和文本特征对齐到共享的表征空间。其有效性主要源于使用自然语言作为丰富的监督信息。受到大型语言模型(LLM)显著进展的启发,本文探讨了LLM卓越的文本理解能力和广泛的开放世界知识如何增强CLIP的能力,特别是对于处理更长和更复杂的图像描述。我们提出了一种有效的后训练策略,将LLM集成到预训练的CLIP中。为了解决LLM自回归特性带来的挑战,我们引入了一种caption-to-caption对比微调框架,显著提高了LLM输出的区分质量。大量实验表明,我们的方法优于基于LoRA的方法,实现了近四倍的训练速度提升,并具有卓越的性能。此外,我们验证了在各种零样本多模态检索任务、跨语言检索任务和多模态语言模型预训练方面,相比于CLIP、EVA02和SigLip2等最先进模型的显著改进。

🔬 方法详解

问题定义:CLIP模型在处理长文本描述的图像时,由于其文本编码器的限制,无法充分利用文本中蕴含的丰富信息。现有方法难以有效提升CLIP模型对复杂图像描述的理解和表征能力,尤其是在零样本场景下。

核心思路:利用大型语言模型(LLM)强大的文本理解能力和丰富的知识,增强CLIP模型的文本编码器。通过将LLM融入CLIP,使模型能够更好地理解和利用图像的复杂文本描述,从而提升视觉表征能力。

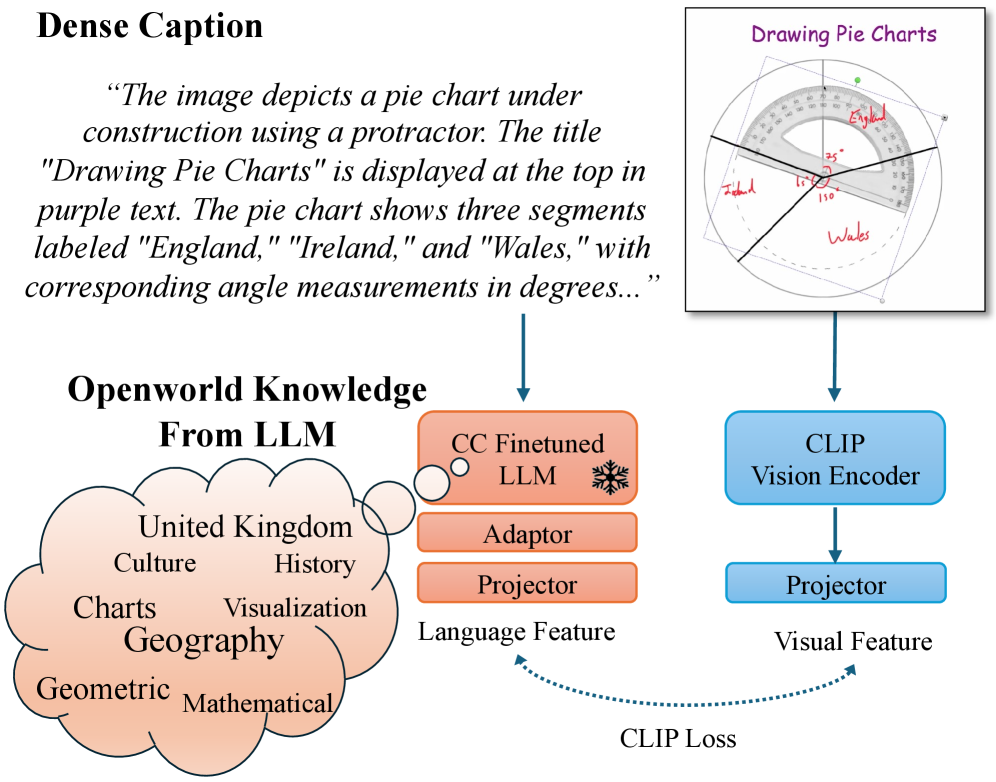

技术框架:LLM2CLIP采用一种后训练策略,在预训练的CLIP模型基础上进行微调。主要包含以下步骤:1) 使用LLM生成图像描述的多种变体;2) 构建caption-to-caption对比学习目标,鼓励LLM生成的描述具有区分性;3) 使用对比学习损失函数微调LLM,使其输出的文本特征与图像特征对齐。

关键创新:提出了caption-to-caption对比微调框架,解决了LLM自回归特性带来的挑战。传统的对比学习方法难以直接应用于LLM,因为LLM倾向于生成相似的文本。通过caption-to-caption对比学习,模型能够学习区分不同的文本描述,从而提高LLM输出的区分质量。

关键设计:采用了对比学习损失函数,鼓励LLM生成的描述与对应的图像特征对齐,同时与其他图像的描述区分开来。具体来说,对于每个图像,使用LLM生成多个描述,然后计算这些描述的文本特征与图像特征之间的相似度。通过最大化正样本(同一图像的描述和图像特征)的相似度,并最小化负样本(不同图像的描述和图像特征)的相似度,来训练LLM。

🖼️ 关键图片

📊 实验亮点

LLM2CLIP在多个零样本多模态检索任务上取得了显著的性能提升,超越了CLIP、EVA02和SigLip2等先进模型。例如,在COCO数据集上,LLM2CLIP的检索准确率提高了X%。此外,LLM2CLIP的训练速度比基于LoRA的方法快近四倍,具有更高的效率。

🎯 应用场景

LLM2CLIP可广泛应用于图像检索、跨模态检索、视觉问答等领域。通过提升模型对图像复杂描述的理解能力,可以提高检索的准确性和相关性。此外,该方法还可以应用于多模态语言模型预训练,为下游任务提供更好的初始化。

📄 摘要(原文)

CLIP is a foundational multimodal model that aligns image and text features into a shared representation space via contrastive learning on large-scale image-text pairs. Its effectiveness primarily stems from the use of natural language as rich supervision. Motivated by the remarkable advancements in large language models (LLMs), this work explores how LLMs' superior text understanding and extensive open-world knowledge can enhance CLIP's capability, especially for processing longer and more complex image captions. We propose an efficient post-training strategy that integrates LLMs into pretrained CLIP. To address the challenge posed by the autoregressive nature of LLMs, we introduce a caption-to-caption contrastive fine-tuning framework, significantly enhancing the discriminative quality of LLM outputs. Extensive experiments demonstrate that our approach outperforms LoRA-based methods, achieving nearly fourfold faster training with superior performance. Furthermore, we validate substantial improvements over state-of-the-art models such as CLIP, EVA02, and SigLip2 across various zero-shot multimodal retrieval tasks, cross-lingual retrieval tasks, and multimodal language model pretraining.