Correlation of Object Detection Performance with Visual Saliency and Depth Estimation

作者: Matthias Bartolo, Dylan Seychell

分类: cs.CV, cs.AI, cs.LG

发布日期: 2024-11-05

备注: Code Available at: https://github.com/mbar0075/Object-Detection-Correlation-Saliency-vs-Depth

💡 一句话要点

研究对象检测性能与视觉显著性和深度估计的相关性,为优化模型架构提供指导。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 对象检测 视觉显著性 深度估计 相关性分析 特征工程

📋 核心要点

- 现有对象检测技术不断发展,但缺乏对其与互补视觉任务之间关系的深入理解,限制了模型优化。

- 本文通过研究对象检测与视觉显著性和深度估计的相关性,探索更有效的特征融合策略。

- 实验表明,视觉显著性与对象检测准确率的相关性高于深度估计,且不同对象类别间存在显著差异。

📝 摘要(中文)

本文研究了对象检测准确率与深度预测和视觉显著性预测这两个基本视觉任务之间的相关性,旨在为优化模型架构和计算资源提供指导。通过在COCO和Pascal VOC数据集上使用最先进的模型(DeepGaze IIE、Depth Anything、DPT-Large和Itti's model)进行综合实验,发现视觉显著性与对象检测准确率的相关性始终强于深度预测(Pascal VOC上的mA$ρ$分别高达0.459和0.283)。分析表明,这些相关性在不同对象类别之间存在显著差异,较大对象的相关值是较小对象的3倍。研究结果表明,将视觉显著性特征整合到对象检测架构中可能比深度信息更有益,特别是对于特定对象类别。观察到的类别特定差异也为有针对性的特征工程和数据集设计改进提供了见解,从而可能产生更高效、更准确的对象检测系统。

🔬 方法详解

问题定义:论文旨在研究对象检测性能与视觉显著性和深度估计之间的关系。现有对象检测模型在特征选择和融合方面存在局限性,未能充分利用视觉场景中的上下文信息,例如哪些区域更吸引注意力,以及场景的深度结构如何影响对象识别。因此,需要深入理解这些视觉线索与对象检测性能之间的关联,从而指导模型设计和优化。

核心思路:论文的核心思路是通过计算视觉显著性和深度估计与对象检测性能之间的相关性,来评估它们对对象检测的贡献。如果某种视觉线索与对象检测性能高度相关,那么将其融入对象检测模型中可能会带来性能提升。此外,通过分析不同对象类别之间的相关性差异,可以为特定类别的对象检测定制更有效的特征。

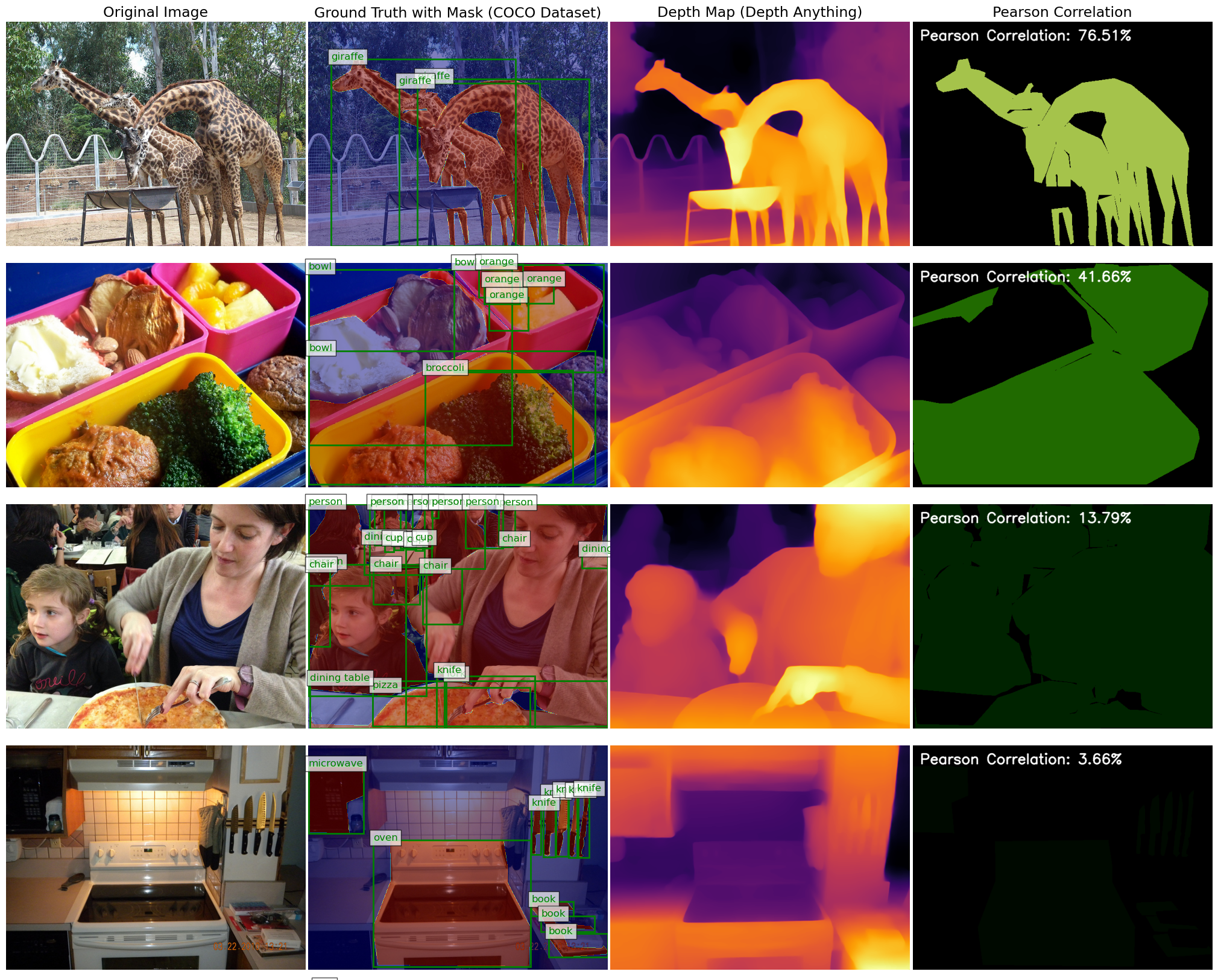

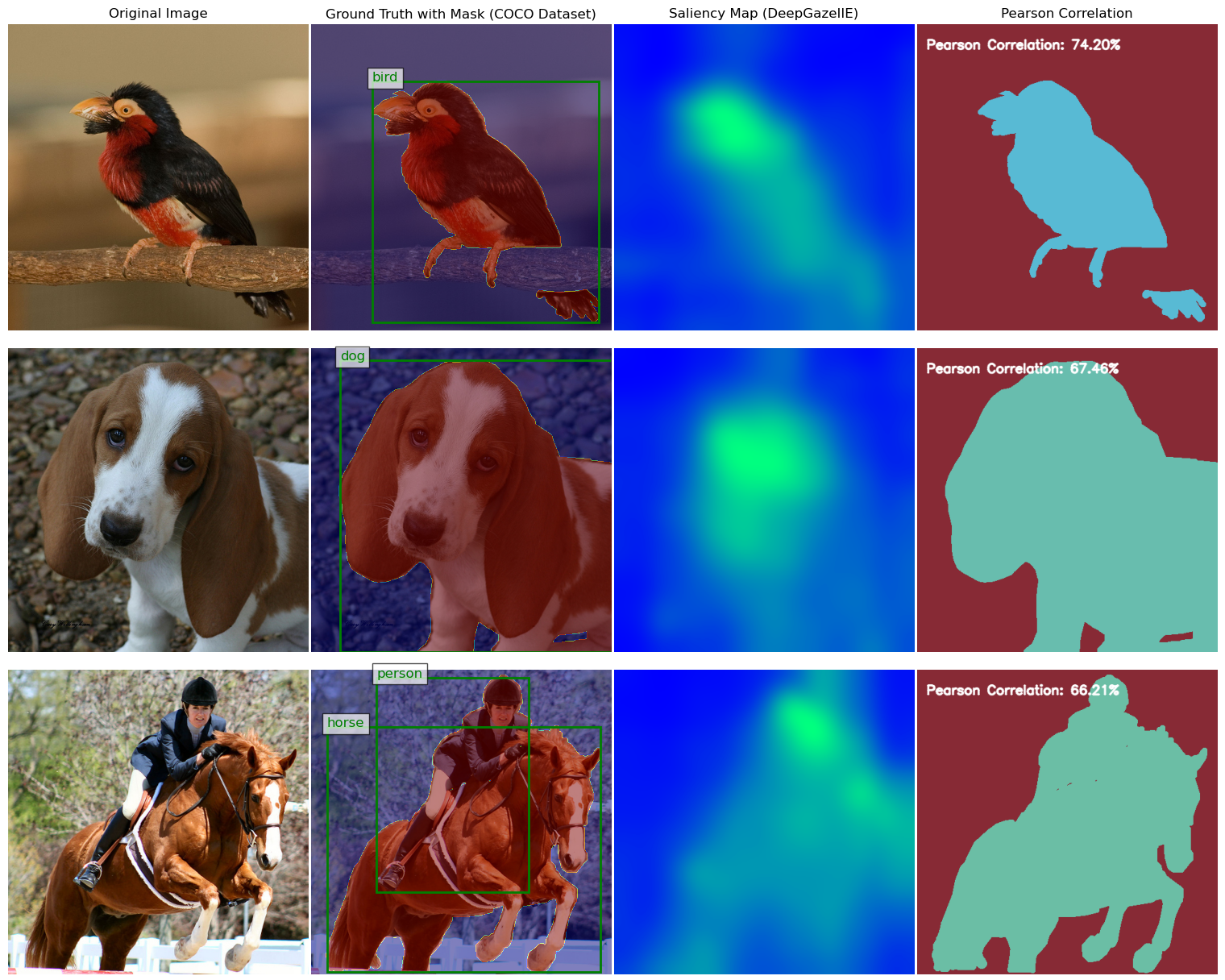

技术框架:论文的技术框架主要包括以下几个步骤:1) 使用现有的视觉显著性模型(如DeepGaze IIE和Itti's model)和深度估计模型(如Depth Anything和DPT-Large)对图像进行处理,提取视觉显著性图和深度图。2) 使用对象检测模型在同一图像上进行对象检测,并评估其准确率。3) 计算视觉显著性图、深度图与对象检测准确率之间的相关性,例如使用Spearman秩相关系数(mA$ρ$)。4) 分析不同对象类别之间的相关性差异。

关键创新:论文的关键创新在于定量分析了视觉显著性和深度估计与对象检测性能之间的相关性,并揭示了视觉显著性在提高对象检测准确率方面可能比深度信息更有效。此外,论文还发现了不同对象类别之间的相关性差异,为有针对性的特征工程提供了依据。

关键设计:论文的关键设计包括:1) 选择了具有代表性的视觉显著性模型(DeepGaze IIE、Itti's model)和深度估计模型(Depth Anything、DPT-Large)。2) 使用了常用的对象检测数据集COCO和Pascal VOC。3) 使用Spearman秩相关系数(mA$ρ$)来衡量相关性。4) 针对不同对象类别进行了细致的分析。

🖼️ 关键图片

📊 实验亮点

实验结果表明,视觉显著性与对象检测准确率的相关性(mA$ρ$高达0.459)显著高于深度预测(mA$ρ$高达0.283)。大型对象类别表现出更高的相关性,其相关值是小型对象类别的三倍。这些发现强调了视觉显著性在对象检测中的重要性,并为未来的模型设计提供了有价值的指导。

🎯 应用场景

该研究成果可应用于改进对象检测系统的设计,例如,通过引入视觉显著性注意力机制,使模型更加关注图像中重要的区域,从而提高检测精度和效率。此外,研究结果还可以指导数据集的构建,例如,针对特定对象类别,可以增加包含更多视觉显著性信息的样本,以提高模型的泛化能力。该研究对自动驾驶、机器人视觉、智能监控等领域具有潜在的应用价值。

📄 摘要(原文)

As object detection techniques continue to evolve, understanding their relationships with complementary visual tasks becomes crucial for optimising model architectures and computational resources. This paper investigates the correlations between object detection accuracy and two fundamental visual tasks: depth prediction and visual saliency prediction. Through comprehensive experiments using state-of-the-art models (DeepGaze IIE, Depth Anything, DPT-Large, and Itti's model) on COCO and Pascal VOC datasets, we find that visual saliency shows consistently stronger correlations with object detection accuracy (mA$ρ$ up to 0.459 on Pascal VOC) compared to depth prediction (mA$ρ$ up to 0.283). Our analysis reveals significant variations in these correlations across object categories, with larger objects showing correlation values up to three times higher than smaller objects. These findings suggest incorporating visual saliency features into object detection architectures could be more beneficial than depth information, particularly for specific object categories. The observed category-specific variations also provide insights for targeted feature engineering and dataset design improvements, potentially leading to more efficient and accurate object detection systems.