NIMBA: Towards Robust and Principled Processing of Point Clouds With SSMs

作者: Nursena Köprücü, Destiny Okpekpe, Antonio Orvieto

分类: cs.CV, cs.LG

发布日期: 2024-10-31

💡 一句话要点

NIMBA:利用SSM实现点云鲁棒且有原则的处理

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 点云处理 状态空间模型 Mamba 三维视觉 深度学习 序列建模 置换不变性

📋 核心要点

- Transformer处理高分辨率点云时,由于注意力机制的二次复杂度,效率受限。

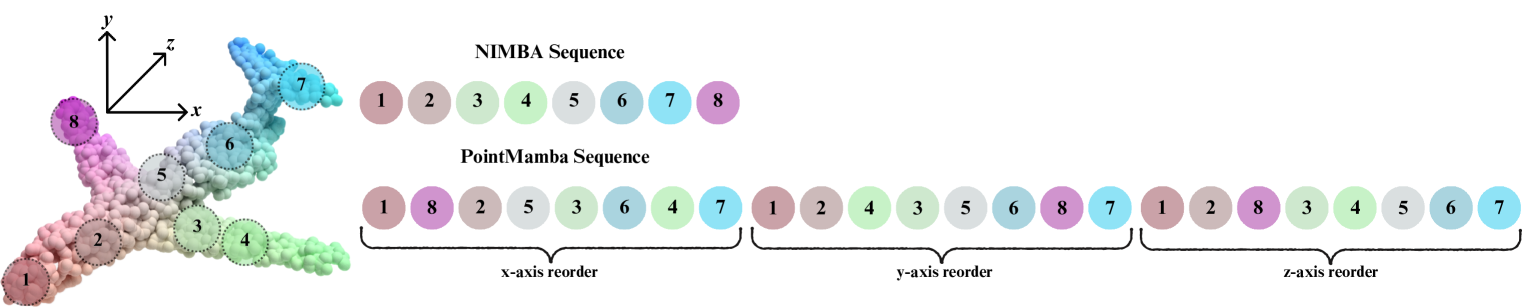

- NIMBA将点云转换为保持3D空间结构的1D序列,无需数据复制,实现Mamba的有效应用。

- 实验表明,NIMBA无需位置嵌入,序列长度更短,在ModelNet40和ScanObjectNN上达到SOTA,超越Transformer。

📝 摘要(中文)

Transformer在包括文本、2D和3D视觉等各个领域的大规模深度学习任务中占据主导地位。然而,其注意力机制的二次复杂度限制了它们在高分辨率3D数据(如点云)中的效率。最近,像Mamba这样的状态空间模型(SSM)作为一种有前途的替代方案出现,它在长序列任务中提供了线性复杂度、可扩展性和高性能。在该领域应用SSM的关键挑战在于,如何协调点云的非序列结构与像Mamba这样的循环模型的固有方向性(或双向性)顺序依赖处理。为了实现这一点,之前的研究提出了沿多个方向或3D空间中的预定路径重组点云,并连接结果以生成捕获不同视角的单个1D序列。在我们的工作中,我们引入了一种将点云转换为1D序列的方法,该方法保持了3D空间结构,无需数据复制,从而允许Mamba顺序处理以几乎置换不变的方式有效应用。与其他工作相比,我们发现我们的方法不需要位置嵌入,并且允许更短的序列长度,同时仍然在ModelNet40和ScanObjectNN数据集上实现最先进的结果,并在准确性和效率方面超越了基于Transformer的模型。

🔬 方法详解

问题定义:现有方法在处理点云时,通常需要将点云数据转换为序列数据,以便利用序列模型(如Transformer或RNN)进行处理。然而,点云本身是无序的,直接转换为序列会引入人为的顺序依赖性,影响模型的性能。此外,Transformer的注意力机制在处理长序列时计算复杂度较高,限制了其在高分辨率点云上的应用。

核心思路:NIMBA的核心思路是将点云转换为一种特殊的1D序列,该序列能够尽可能地保留点云的3D空间结构信息,并且对点云的排列顺序具有一定的鲁棒性(置换不变性)。通过这种转换,可以使用高效的序列模型(如Mamba)来处理点云数据,同时避免了Transformer的计算复杂度问题。

技术框架:NIMBA的整体框架包括以下几个主要步骤:1. 点云预处理:对输入的点云数据进行归一化等预处理操作。2. 空间结构编码:将点云数据转换为一种能够保留3D空间结构的1D序列。具体的转换方法未知,但论文强调了其无需数据复制的特性。3. 序列模型处理:使用Mamba等状态空间模型对1D序列进行处理,提取特征。4. 任务特定层:将提取的特征输入到任务特定的层(如分类层)进行预测。

关键创新:NIMBA的关键创新在于其点云到1D序列的转换方法,该方法能够在保留3D空间结构的同时,实现对点云排列顺序的鲁棒性。此外,NIMBA还发现,在这种转换方法下,可以不需要位置嵌入,并且可以使用更短的序列长度,从而进一步提高了模型的效率。

关键设计:论文中没有详细描述点云到1D序列转换的具体方法,以及Mamba模型的具体参数设置。但是,论文强调了该方法不需要位置嵌入,并且可以使用更短的序列长度。损失函数和网络结构等其他技术细节也未知。

🖼️ 关键图片

📊 实验亮点

NIMBA在ModelNet40和ScanObjectNN数据集上取得了最先进的结果,并在准确性和效率方面超越了基于Transformer的模型。更重要的是,NIMBA无需位置嵌入,并允许使用更短的序列长度,这显著提高了模型的效率。

🎯 应用场景

NIMBA在三维物体识别、场景理解、自动驾驶等领域具有广泛的应用前景。通过高效且鲁棒地处理点云数据,NIMBA可以提升相关任务的性能和效率,例如在自动驾驶中更准确地识别障碍物,在机器人导航中更好地理解周围环境。

📄 摘要(原文)

Transformers have become dominant in large-scale deep learning tasks across various domains, including text, 2D and 3D vision. However, the quadratic complexity of their attention mechanism limits their efficiency as the sequence length increases, particularly in high-resolution 3D data such as point clouds. Recently, state space models (SSMs) like Mamba have emerged as promising alternatives, offering linear complexity, scalability, and high performance in long-sequence tasks. The key challenge in the application of SSMs in this domain lies in reconciling the non-sequential structure of point clouds with the inherently directional (or bi-directional) order-dependent processing of recurrent models like Mamba. To achieve this, previous research proposed reorganizing point clouds along multiple directions or predetermined paths in 3D space, concatenating the results to produce a single 1D sequence capturing different views. In our work, we introduce a method to convert point clouds into 1D sequences that maintain 3D spatial structure with no need for data replication, allowing Mamba sequential processing to be applied effectively in an almost permutation-invariant manner. In contrast to other works, we found that our method does not require positional embeddings and allows for shorter sequence lengths while still achieving state-of-the-art results in ModelNet40 and ScanObjectNN datasets and surpassing Transformer-based models in both accuracy and efficiency.