Enhanced Survival Prediction in Head and Neck Cancer Using Convolutional Block Attention and Multimodal Data Fusion

作者: Aiman Farooq, Utkarsh Sharma, Deepak Mishra

分类: cs.CV

发布日期: 2024-10-29

备注: Accepted to [ACCV 2024 Workshop]

💡 一句话要点

提出基于CBAM和多模态融合的深度学习模型,提升头颈癌生存预测精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 头颈癌 生存预测 深度学习 多模态融合 卷积块注意力机制 CT影像 PET影像

📋 核心要点

- 传统生存预测模型难以有效处理头颈癌复杂的多模态数据,限制了临床决策的优化。

- 利用卷积块注意力机制和多模态数据融合,从CT和PET影像中提取关键特征,提升生存预测的准确性。

- 在HECKTOR和HEAD-NECK-RADIOMICS-HN1数据集上验证,深度学习模型显著优于传统方法。

📝 摘要(中文)

本研究提出了一种基于深度学习的方法,利用CT和PET影像数据预测头颈癌(HNC)患者的生存结果。该方法集成了卷积块注意力模块(CBAM)的特征提取和多模态数据融合层,将影像数据结合生成紧凑的特征表示。最终预测通过全参数离散时间生存模型实现,该模型允许灵活的风险函数,克服了传统生存模型的局限性。在HECKTOR和HEAD-NECK-RADIOMICS-HN1数据集上的评估表明,与传统的统计和机器学习模型相比,该方法表现出更优越的性能。结果表明,该深度学习模型显著提高了生存预测的准确性,为HNC的个性化治疗计划提供了一个强大的工具。

🔬 方法详解

问题定义:头颈癌的生存预测对于临床决策至关重要。传统方法如Cox比例风险模型在处理复杂的多模态数据时存在局限性,无法充分利用CT和PET影像信息,导致预测精度不高。因此,需要一种能够有效融合多模态数据并提取关键特征的方法,以提高生存预测的准确性。

核心思路:论文的核心思路是利用深度学习模型自动学习CT和PET影像中的复杂特征,并通过注意力机制关注重要区域,从而提高生存预测的准确性。多模态数据融合能够整合不同影像模态的信息,提供更全面的肿瘤特征表示。全参数离散时间生存模型能够灵活地建模风险函数,克服传统模型的限制。

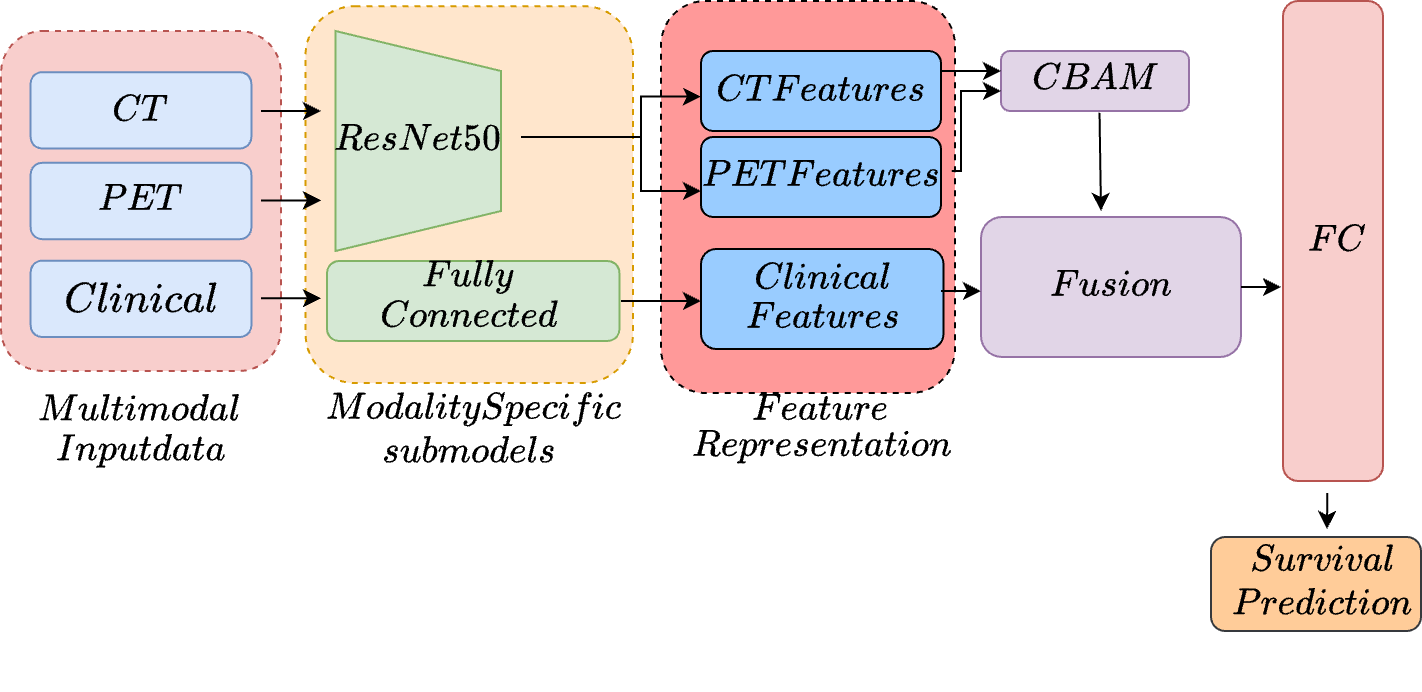

技术框架:整体框架包括以下几个主要模块:1) CT和PET影像数据输入;2) 卷积神经网络(CNN)进行特征提取;3) 卷积块注意力模块(CBAM)关注重要特征;4) 多模态数据融合层整合CT和PET特征;5) 全参数离散时间生存模型进行生存预测。

关键创新:最重要的技术创新点在于结合了卷积块注意力机制(CBAM)和多模态数据融合,能够更有效地提取和整合影像数据中的关键信息。此外,使用全参数离散时间生存模型,克服了传统Cox模型的比例风险假设的限制,能够更灵活地建模风险函数。

关键设计:CBAM模块被用于增强CNN提取的特征表示,通过通道注意力和空间注意力机制,自适应地调整特征权重。多模态数据融合层采用拼接或加权平均等方式整合CT和PET特征。全参数离散时间生存模型使用神经网络来建模每个时间点的风险函数,损失函数通常采用负对数似然函数。

🖼️ 关键图片

📊 实验亮点

该研究在HECKTOR和HEAD-NECK-RADIOMICS-HN1数据集上进行了评估,结果表明,所提出的深度学习模型显著优于传统的统计和机器学习模型。具体的性能提升数据未知,但摘要强调了其在生存预测准确性方面的显著提高,为个性化治疗计划提供了更强大的工具。

🎯 应用场景

该研究成果可应用于头颈癌的个性化治疗方案制定,帮助医生更准确地评估患者的生存风险,从而选择更合适的治疗策略。通过整合影像数据和深度学习模型,可以为临床决策提供更客观、更可靠的依据,提升患者的生存率和生活质量。未来,该方法有望推广到其他癌症类型的生存预测。

📄 摘要(原文)

Accurate survival prediction in head and neck cancer (HNC) is essential for guiding clinical decision-making and optimizing treatment strategies. Traditional models, such as Cox proportional hazards, have been widely used but are limited in their ability to handle complex multi-modal data. This paper proposes a deep learning-based approach leveraging CT and PET imaging modalities to predict survival outcomes in HNC patients. Our method integrates feature extraction with a Convolutional Block Attention Module (CBAM) and a multi-modal data fusion layer that combines imaging data to generate a compact feature representation. The final prediction is achieved through a fully parametric discrete-time survival model, allowing for flexible hazard functions that overcome the limitations of traditional survival models. We evaluated our approach using the HECKTOR and HEAD-NECK-RADIOMICS- HN1 datasets, demonstrating its superior performance compared to conconventional statistical and machine learning models. The results indicate that our deep learning model significantly improves survival prediction accuracy, offering a robust tool for personalized treatment planning in HNC