MVSDet: Multi-View Indoor 3D Object Detection via Efficient Plane Sweeps

作者: Yating Xu, Chen Li, Gim Hee Lee

分类: cs.CV

发布日期: 2024-10-28

备注: Accepted by NeurIPS 2024

🔗 代码/项目: GITHUB

💡 一句话要点

MVSDet:利用高效平面扫描实现多视角室内3D目标检测

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 多视角3D目标检测 平面扫描 概率采样 软加权 室内场景理解 深度预测 高斯溅射

📋 核心要点

- 现有基于NeRF的室内3D目标检测方法,其几何信息提取精度不足,限制了检测性能。

- MVSDet通过平面扫描进行几何感知,并引入概率采样和软加权机制,提升深度预测的准确性。

- 实验表明,MVSDet在ScanNet和ARKitScenes数据集上表现优异,验证了其有效性。

📝 摘要(中文)

多视角室内3D目标检测的关键挑战是从图像中推断精确的几何信息,以实现精确的3D检测。以往的方法依赖于NeRF进行几何推理,但从NeRF提取的几何信息通常不准确,导致次优的检测性能。本文提出MVSDet,它利用平面扫描进行几何感知的3D目标检测。为了避免对大量深度平面进行精确深度预测的需求,我们设计了一种概率采样和软加权机制来确定像素特征在3D体素上的位置。我们为每个像素选择在概率体素中得分最高的多个位置,并使用它们的概率得分来指示置信度。我们进一步应用最近的像素对齐高斯溅射来正则化深度预测,并以很少的计算开销提高检测性能。在ScanNet和ARKitScenes数据集上进行了大量实验,表明了我们模型的优越性。我们的代码可在https://github.com/Pixie8888/MVSDet获得。

🔬 方法详解

问题定义:多视角室内3D目标检测旨在从多个视角的图像中准确地检测出场景中的3D物体。现有方法,特别是基于NeRF的方法,在几何信息提取方面存在精度问题,导致最终的3D目标检测性能受限。NeRF虽然能够重建场景,但其几何细节不够精确,无法满足高精度3D检测的需求。

核心思路:MVSDet的核心思路是利用平面扫描(Plane Sweep)技术,结合概率采样和软加权机制,来更准确地估计场景的几何信息。通过在不同深度平面上扫描,并结合像素特征的概率分布,可以更有效地确定像素在3D空间中的位置,从而提高深度预测的准确性。

技术框架:MVSDet的整体框架包括以下几个主要阶段:1) 特征提取:从多视角图像中提取像素级别的特征。2) 平面扫描:在预定义的深度范围内,进行平面扫描,为每个像素生成一系列候选的3D位置。3) 概率采样和软加权:根据像素特征在不同深度平面上的匹配程度,计算每个候选位置的概率得分,并使用软加权机制融合这些位置的特征。4) 深度预测和3D目标检测:利用融合后的特征进行深度预测,并最终进行3D目标检测。5) 像素对齐高斯溅射:使用像素对齐高斯溅射来正则化深度预测,进一步提升检测性能。

关键创新:MVSDet的关键创新在于其概率采样和软加权机制,以及像素对齐高斯溅射的应用。传统的平面扫描方法需要大量的深度平面才能获得较高的精度,而MVSDet通过概率采样,选择概率最高的几个位置进行特征融合,从而减少了计算量。此外,像素对齐高斯溅射能够有效地正则化深度预测,提高检测的鲁棒性。

关键设计:MVSDet的关键设计包括:1) 概率体素的构建方式,如何根据像素特征计算每个体素的概率得分。2) 软加权机制的具体实现,如何根据概率得分融合不同位置的特征。3) 像素对齐高斯溅射的参数设置,例如高斯核的大小和方差。4) 损失函数的设计,如何结合深度预测和3D目标检测的损失,进行联合优化。

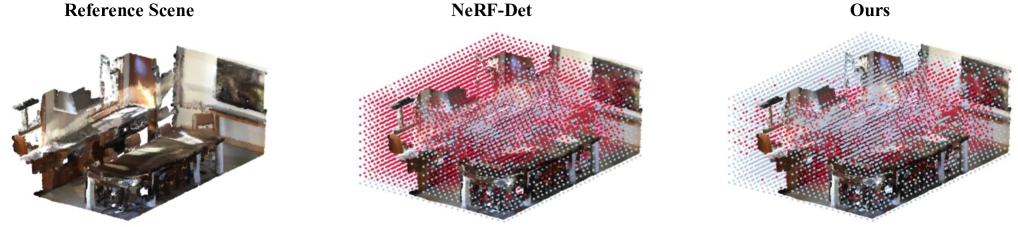

🖼️ 关键图片

📊 实验亮点

MVSDet在ScanNet和ARKitScenes数据集上取得了显著的性能提升。通过引入概率采样和软加权机制,以及像素对齐高斯溅射,MVSDet在3D目标检测精度上超越了以往基于NeRF的方法。实验结果表明,MVSDet能够更准确地提取场景的几何信息,从而实现更精确的3D目标检测。

🎯 应用场景

MVSDet在室内场景理解、机器人导航、增强现实等领域具有广泛的应用前景。精确的3D目标检测可以帮助机器人更好地理解周围环境,从而实现更智能的导航和交互。在增强现实应用中,可以提供更逼真的虚拟物体放置和交互体验。该研究的成果有助于提升相关应用的用户体验和智能化水平。

📄 摘要(原文)

The key challenge of multi-view indoor 3D object detection is to infer accurate geometry information from images for precise 3D detection. Previous method relies on NeRF for geometry reasoning. However, the geometry extracted from NeRF is generally inaccurate, which leads to sub-optimal detection performance. In this paper, we propose MVSDet which utilizes plane sweep for geometry-aware 3D object detection. To circumvent the requirement for a large number of depth planes for accurate depth prediction, we design a probabilistic sampling and soft weighting mechanism to decide the placement of pixel features on the 3D volume. We select multiple locations that score top in the probability volume for each pixel and use their probability score to indicate the confidence. We further apply recent pixel-aligned Gaussian Splatting to regularize depth prediction and improve detection performance with little computation overhead. Extensive experiments on ScanNet and ARKitScenes datasets are conducted to show the superiority of our model. Our code is available at https://github.com/Pixie8888/MVSDet.