Ferret-UI 2: Mastering Universal User Interface Understanding Across Platforms

作者: Zhangheng Li, Keen You, Haotian Zhang, Di Feng, Harsh Agrawal, Xiujun Li, Mohana Prasad Sathya Moorthy, Jeff Nichols, Yinfei Yang, Zhe Gan

分类: cs.CV, cs.CL, cs.LG

发布日期: 2024-10-24 (更新: 2025-02-28)

备注: Accepted to ICLR 2025

💡 一句话要点

Ferret-UI 2:一种用于跨平台通用用户界面理解的多模态大语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 用户界面理解 多模态大语言模型 跨平台 高分辨率感知 GPT-4o 自适应缩放 UI测试

📋 核心要点

- 现有UI理解模型难以应对平台多样性、分辨率差异和数据限制等挑战。

- Ferret-UI 2通过支持多平台、自适应缩放高分辨率感知和GPT-4o辅助数据生成来解决这些问题。

- 实验表明,Ferret-UI 2在多个UI任务上显著优于Ferret-UI,并展现出强大的跨平台迁移能力。

📝 摘要(中文)

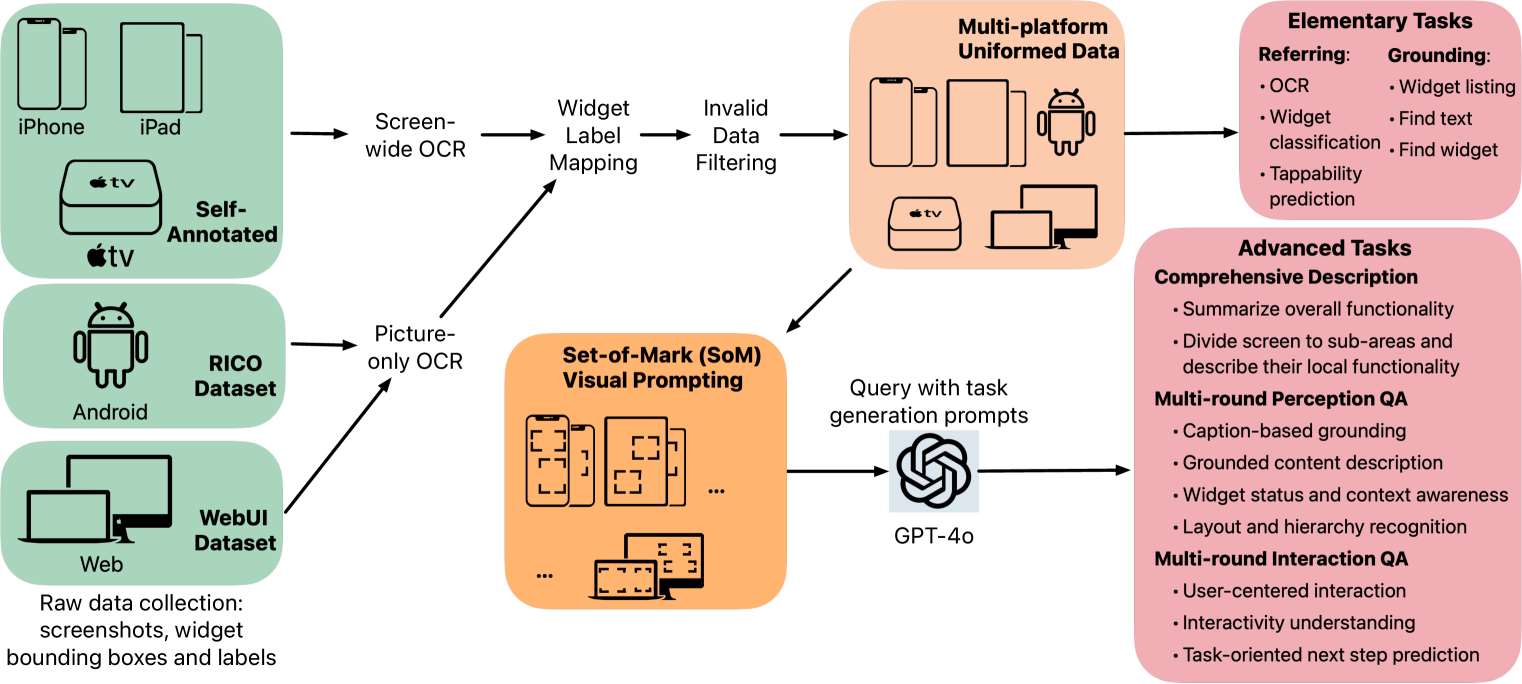

本文介绍了Ferret-UI 2,一种多模态大语言模型(MLLM),旨在实现跨多种平台(包括iPhone、Android、iPad、Webpage和AppleTV)的通用用户界面(UI)理解。Ferret-UI 2建立在Ferret-UI的基础上,引入了三个关键创新:支持多种平台类型、通过自适应缩放实现高分辨率感知,以及由GPT-4o驱动的、带有set-of-mark视觉提示的高级任务训练数据生成。这些进步使Ferret-UI 2能够执行复杂、以用户为中心的交互,使其具有高度的通用性和适应性,能够适应不断扩展的平台生态系统的多样性。在指代、定位、以用户为中心的高级任务(包括9个子任务×5个平台)、GUIDE下一步动作预测数据集和GUI-World多平台基准上的大量经验实验表明,Ferret-UI 2显著优于Ferret-UI,并且表现出强大的跨平台迁移能力。

🔬 方法详解

问题定义:现有UI理解模型在处理不同平台(如iPhone、Android、Webpage等)的UI时,面临着平台差异性、分辨率变化以及训练数据不足等问题。这些问题限制了模型在实际应用中的通用性和性能。现有方法难以有效处理这些挑战,导致模型在跨平台UI理解任务中表现不佳。

核心思路:Ferret-UI 2的核心思路是构建一个通用的多模态大语言模型,使其能够理解和处理来自不同平台的UI。通过引入多平台支持、高分辨率感知和GPT-4o辅助的数据生成,模型能够更好地适应不同平台的UI特性,并提高在复杂UI任务中的性能。这种设计旨在提高模型的通用性和适应性,使其能够应用于更广泛的UI理解场景。

技术框架:Ferret-UI 2的整体架构基于多模态大语言模型,主要包括以下几个关键模块:1) 多平台支持模块:用于处理来自不同平台的UI数据,并将其转换为统一的表示形式。2) 高分辨率感知模块:通过自适应缩放技术,提高模型对UI元素细节的感知能力。3) GPT-4o辅助数据生成模块:利用GPT-4o生成高质量的训练数据,以增强模型的泛化能力。这些模块协同工作,使模型能够有效地理解和处理来自不同平台的UI。

关键创新:Ferret-UI 2最重要的技术创新点在于其通用性和跨平台能力。与以往的UI理解模型相比,Ferret-UI 2能够处理来自多种平台的UI数据,并且在跨平台任务中表现出强大的迁移能力。此外,利用GPT-4o生成训练数据也是一个重要的创新,可以有效缓解数据不足的问题。

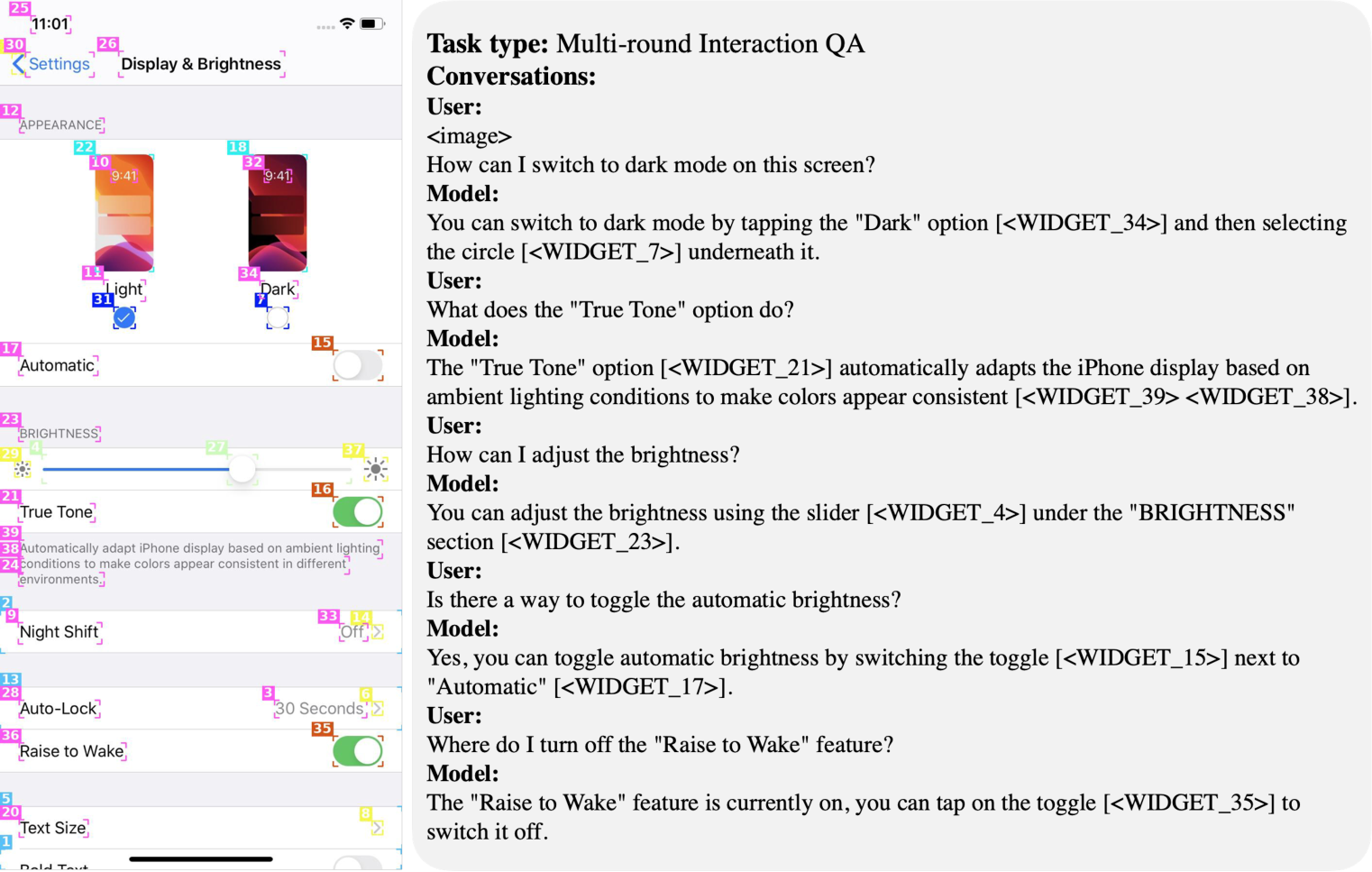

关键设计:Ferret-UI 2的关键设计包括:1) 自适应缩放技术:用于处理不同分辨率的UI图像,提高模型对细节的感知能力。2) Set-of-mark视觉提示:用于指导GPT-4o生成高质量的训练数据。3) 多平台数据融合策略:用于将来自不同平台的数据融合到统一的模型中。具体的参数设置、损失函数和网络结构等细节在论文中进行了详细描述。

🖼️ 关键图片

📊 实验亮点

Ferret-UI 2在多个UI理解任务上取得了显著的性能提升。例如,在GUIDE数据集上,Ferret-UI 2的性能显著优于Ferret-UI。此外,Ferret-UI 2在跨平台任务中表现出强大的迁移能力,表明其具有良好的通用性。实验结果充分证明了Ferret-UI 2的有效性和优越性。

🎯 应用场景

Ferret-UI 2具有广泛的应用前景,可用于自动化UI测试、智能助手、无障碍设计等领域。例如,它可以帮助开发者自动检测UI中的错误和缺陷,提高软件质量;可以为用户提供更智能的UI交互体验;还可以帮助残障人士更方便地使用各种应用程序。未来,Ferret-UI 2有望成为构建通用UI理解系统的关键技术。

📄 摘要(原文)

Building a generalist model for user interface (UI) understanding is challenging due to various foundational issues, such as platform diversity, resolution variation, and data limitation. In this paper, we introduce Ferret-UI 2, a multimodal large language model (MLLM) designed for universal UI understanding across a wide range of platforms, including iPhone, Android, iPad, Webpage, and AppleTV. Building on the foundation of Ferret-UI, Ferret-UI 2 introduces three key innovations: support for multiple platform types, high-resolution perception through adaptive scaling, and advanced task training data generation powered by GPT-4o with set-of-mark visual prompting. These advancements enable Ferret-UI 2 to perform complex, user-centered interactions, making it highly versatile and adaptable for the expanding diversity of platform ecosystems. Extensive empirical experiments on referring, grounding, user-centric advanced tasks (comprising 9 subtasks $\times$ 5 platforms), GUIDE next-action prediction dataset, and GUI-World multi-platform benchmark demonstrate that Ferret-UI 2 significantly outperforms Ferret-UI, and also shows strong cross-platform transfer capabilities.