Enhancing Multimodal Medical Image Classification using Cross-Graph Modal Contrastive Learning

作者: Jun-En Ding, Chien-Chin Hsu, Chi-Hsiang Chu, Shuqiang Wang, Feng Liu

分类: eess.IV, cs.CV

发布日期: 2024-10-23 (更新: 2025-11-10)

💡 一句话要点

提出跨图模态对比学习框架CGMCL,提升多模态医学图像分类性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学图像分类 多模态学习 对比学习 跨模态融合 图神经网络

📋 核心要点

- 现有医学图像分类方法主要依赖单模态数据,忽略了非图像数据的互补信息,限制了诊断性能。

- CGMCL框架通过构建跨模态图,利用对比学习对齐不同模态的特征,实现图像与非图像数据的有效融合。

- 实验结果表明,CGMCL在帕金森病和黑色素瘤数据集上均优于传统方法,提升了准确性、可解释性和预测能力。

📝 摘要(中文)

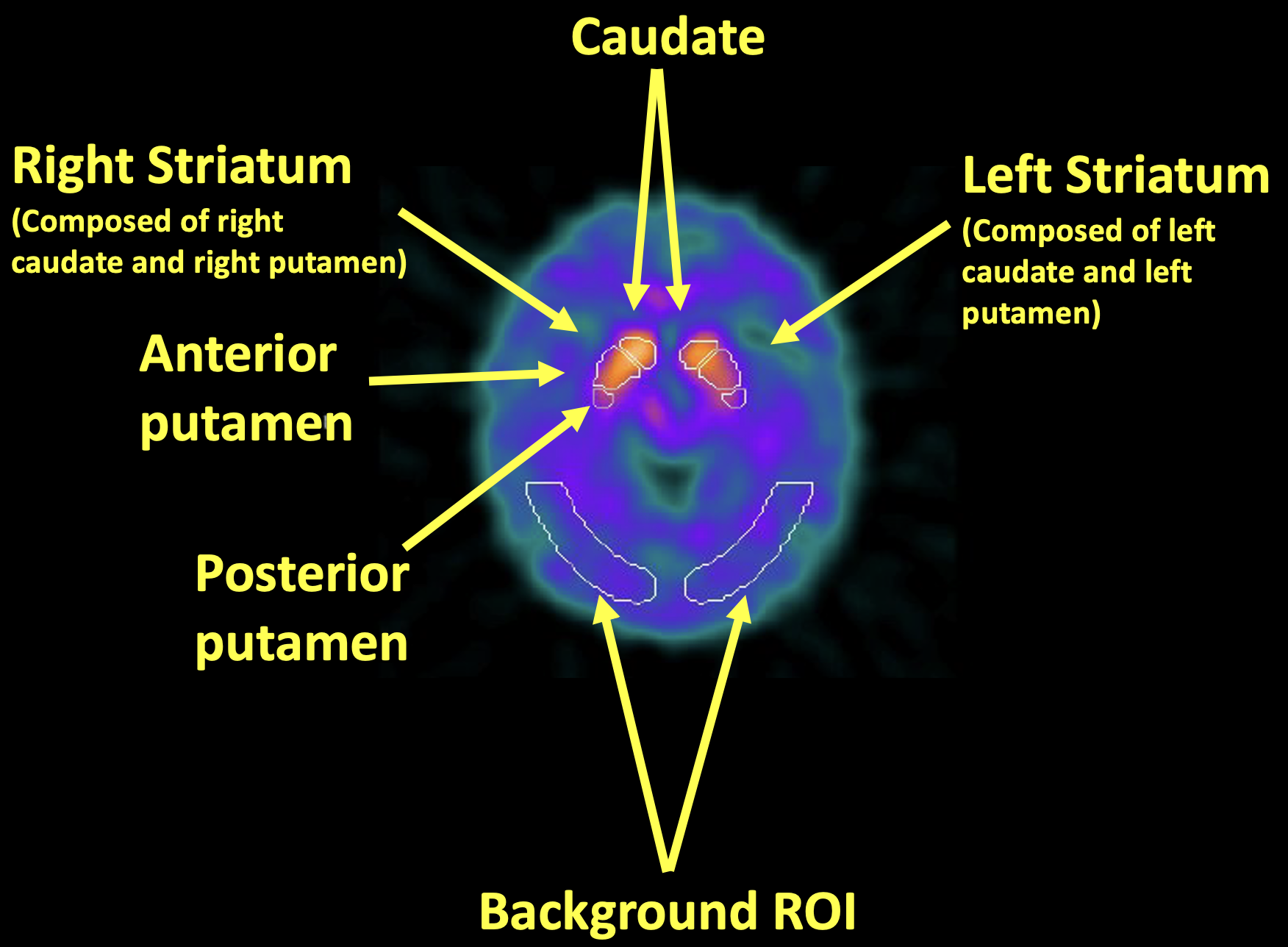

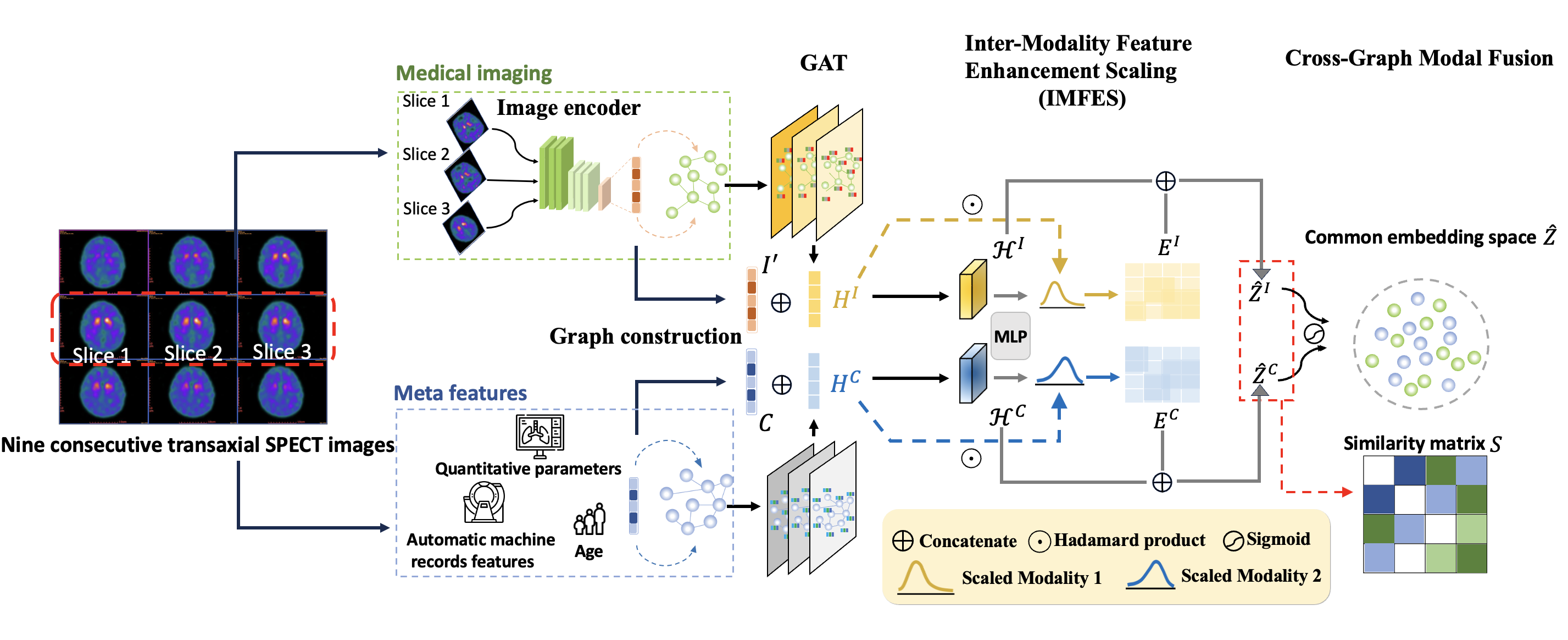

医学图像分类是疾病诊断的关键环节,深度学习技术在其中发挥重要作用。然而,传统方法通常侧重于单模态医学图像数据,忽略了整合多样化的非图像患者数据。本文提出了一种新颖的跨图模态对比学习(CGMCL)框架,用于处理来自不同数据域的多模态结构化数据,以改善医学图像分类效果。该模型通过构建跨模态图并利用对比学习在共享潜在空间中对齐多模态特征,从而有效地整合图像和非图像数据。一个跨模态特征缩放模块通过缩小异构模态之间的差距,进一步优化了表征学习过程。该方法在帕金森病(PD)数据集和一个公开的黑色素瘤数据集上进行了评估。结果表明,CGMCL在准确性、可解释性和早期疾病预测方面优于传统的单模态方法,并且在多类黑色素瘤分类中表现出更优越的性能。CGMCL框架为医学图像分类提供了有价值的见解,同时提供了改进的疾病可解释性和预测能力。

🔬 方法详解

问题定义:现有医学图像分类方法主要依赖于单模态的图像数据,忽略了其他模态的信息,例如患者的临床数据、基因数据等。这些非图像数据往往包含重要的互补信息,可以帮助提升诊断的准确性和可靠性。因此,如何有效地融合多模态数据,充分利用不同模态之间的关联性,是当前医学图像分类面临的一个重要挑战。现有方法难以有效处理异构模态数据之间的差异,导致融合效果不佳。

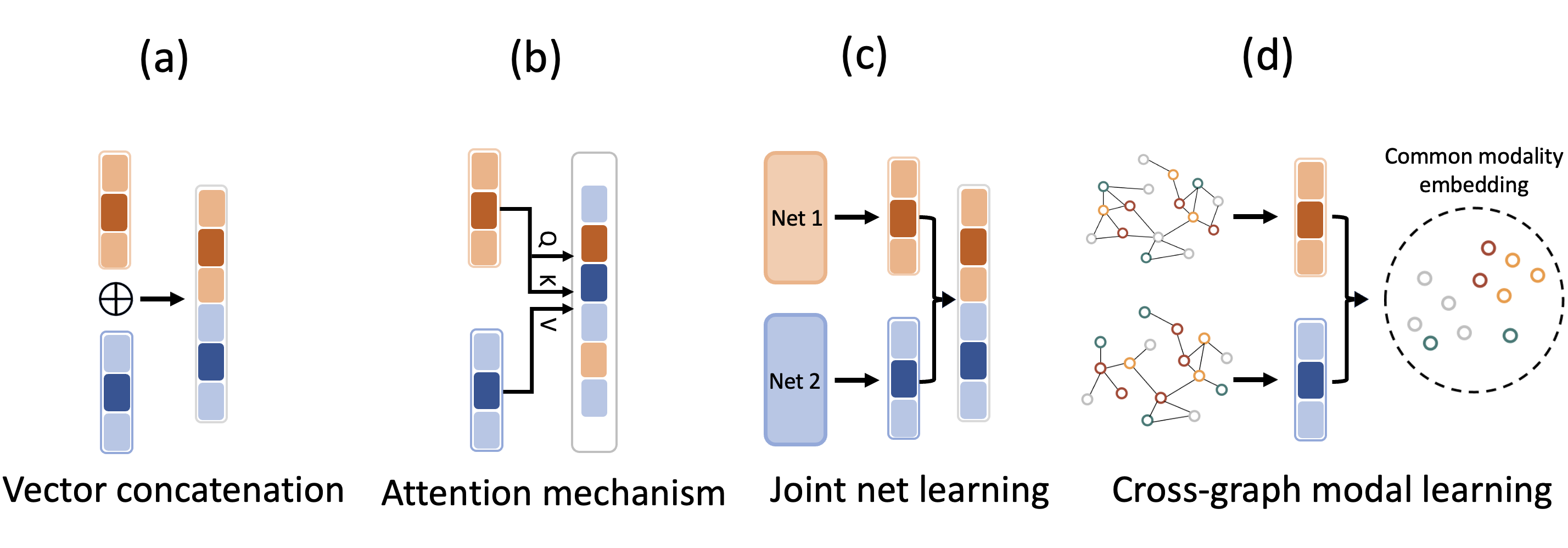

核心思路:论文的核心思路是利用跨图模态对比学习,将不同模态的数据映射到共享的潜在空间中,并通过对比学习的方式,拉近同一患者不同模态数据之间的距离,推开不同患者数据之间的距离。通过这种方式,模型可以学习到更具判别性的多模态特征表示,从而提升分类性能。构建跨模态图能够显式地建模不同模态之间的关系,而对比学习则能够有效地对齐不同模态的特征。

技术框架:CGMCL框架主要包含以下几个模块:1) 特征提取模块:用于提取图像和非图像数据的特征表示。可以使用不同的神经网络结构,例如卷积神经网络(CNN)用于图像特征提取,多层感知机(MLP)用于非图像特征提取。2) 跨模态图构建模块:基于提取的特征,构建跨模态图,用于建模不同模态之间的关系。图的节点表示不同模态的数据,边表示模态之间的相似度或关联性。3) 对比学习模块:利用对比学习损失函数,对齐不同模态的特征表示。通过最小化同一患者不同模态特征之间的距离,最大化不同患者数据之间的距离,学习到更具判别性的多模态特征。4) 跨模态特征缩放模块:用于减小异构模态之间的特征差距,提升融合效果。

关键创新:该论文的关键创新在于提出了跨图模态对比学习框架CGMCL,将跨模态图和对比学习相结合,用于多模态医学图像分类。与传统方法相比,CGMCL能够更有效地融合不同模态的数据,学习到更具判别性的特征表示。此外,跨模态特征缩放模块能够进一步优化特征融合效果。

关键设计:在跨模态图构建中,可以使用不同的相似度度量方法,例如余弦相似度、欧氏距离等。对比学习损失函数可以选择InfoNCE loss或其他对比学习损失函数。跨模态特征缩放模块可以使用线性变换或非线性变换,对不同模态的特征进行缩放。具体的网络结构和参数设置需要根据具体的数据集和任务进行调整。

🖼️ 关键图片

📊 实验亮点

CGMCL在帕金森病数据集和黑色素瘤数据集上进行了评估,实验结果表明,CGMCL在准确性、可解释性和早期疾病预测方面均优于传统的单模态方法。例如,在黑色素瘤数据集上,CGMCL在多类分类任务中取得了显著的性能提升,证明了其在复杂医学图像分类任务中的有效性。具体提升幅度未知,原文未给出明确数据。

🎯 应用场景

该研究成果可应用于多种医学图像分类任务,例如疾病诊断、病情评估、预后预测等。通过整合患者的图像数据和非图像数据,可以提高诊断的准确性和效率,辅助医生进行决策。此外,该方法还可以用于早期疾病的预测,为患者提供更早的干预机会。未来,该方法有望在临床实践中得到广泛应用,改善医疗服务质量。

📄 摘要(原文)

The classification of medical images is a pivotal aspect of disease diagnosis, often enhanced by deep learning techniques. However, traditional approaches typically focus on unimodal medical image data, neglecting the integration of diverse non-image patient data. This paper proposes a novel Cross-Graph Modal Contrastive Learning (CGMCL) framework for multimodal structured data from different data domains to improve medical image classification. The model effectively integrates both image and non-image data by constructing cross-modality graphs and leveraging contrastive learning to align multimodal features in a shared latent space. An inter-modality feature scaling module further optimizes the representation learning process by reducing the gap between heterogeneous modalities. The proposed approach is evaluated on two datasets: a Parkinson's disease (PD) dataset and a public melanoma dataset. Results demonstrate that CGMCL outperforms conventional unimodal methods in accuracy, interpretability, and early disease prediction. Additionally, the method shows superior performance in multi-class melanoma classification. The CGMCL framework provides valuable insights into medical image classification while offering improved disease interpretability and predictive capabilities.