E-3DGS: Gaussian Splatting with Exposure and Motion Events

作者: Xiaoting Yin, Hao Shi, Yuhan Bao, Zhenshan Bing, Yiyi Liao, Kailun Yang, Kaiwei Wang

分类: cs.CV, cs.RO, eess.IV

发布日期: 2024-10-22 (更新: 2025-04-11)

备注: Accepted to Applied Optics (AO). The source code and dataset will be available at https://github.com/MasterHow/E-3DGS

🔗 代码/项目: GITHUB

💡 一句话要点

E-3DGS:利用曝光和运动事件进行高鲁棒性、低成本的3D高斯溅射重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D重建 事件相机 高斯溅射 曝光事件 运动事件 低光照 运动模糊

📋 核心要点

- 传统相机在运动模糊和光照不足等真实场景中难以获取高质量图像,限制了3D重建的性能。

- 通过硬件透射率调节,事件相机可捕获运动和曝光事件,用于训练和优化事件驱动的3D高斯溅射。

- E-3DGS在EventNeRF数据集上优于运动事件和传统相机,并提出了包含曝光事件的真实数据集EME-3D。

📝 摘要(中文)

本文提出了一种基于事件的3D高斯溅射(3DGS)方法,通过结合运动和曝光事件,解决了真实场景中由于运动模糊和光照不足导致传统相机难以获取高质量图像的问题。该方法利用硬件层面的透射率调节装置,使事件相机能够同时捕获运动和曝光事件,适用于不同的3D重建场景。框架支持三种模式:使用曝光事件进行高质量重建,依赖运动事件进行快速重建,以及混合优化,先使用曝光事件初始化,再使用高速运动事件优化。在EventNeRF数据集上,曝光事件显著提高了细节重建质量,优于运动事件,并且在低光照和过度曝光等挑战性条件下优于基于帧的相机。此外,本文还提出了一个真实的3D数据集EME-3D,包含曝光事件、运动事件、相机标定参数和稀疏点云。实验结果表明,该方法比基于事件的NeRF更快、质量更高,并且比结合事件和RGB数据的方法更具成本效益。E-3DGS为基于事件的3D重建设定了新的基准,在具有挑战性的条件下具有鲁棒的性能和更低的硬件需求。

🔬 方法详解

问题定义:论文旨在解决在光照条件差、运动模糊等不利条件下,传统相机难以进行高质量3D重建的问题。现有方法,如基于帧的相机,在这些场景下性能受限。而现有的事件相机方法,通常只利用运动事件,在细节重建方面存在不足。

核心思路:论文的核心思路是结合曝光事件和运动事件的优势,利用曝光事件在光照不足情况下的鲁棒性以及运动事件在快速运动场景下的高时间分辨率。通过控制相机曝光,生成灰度图像,用于高质量的3D高斯溅射训练和优化。

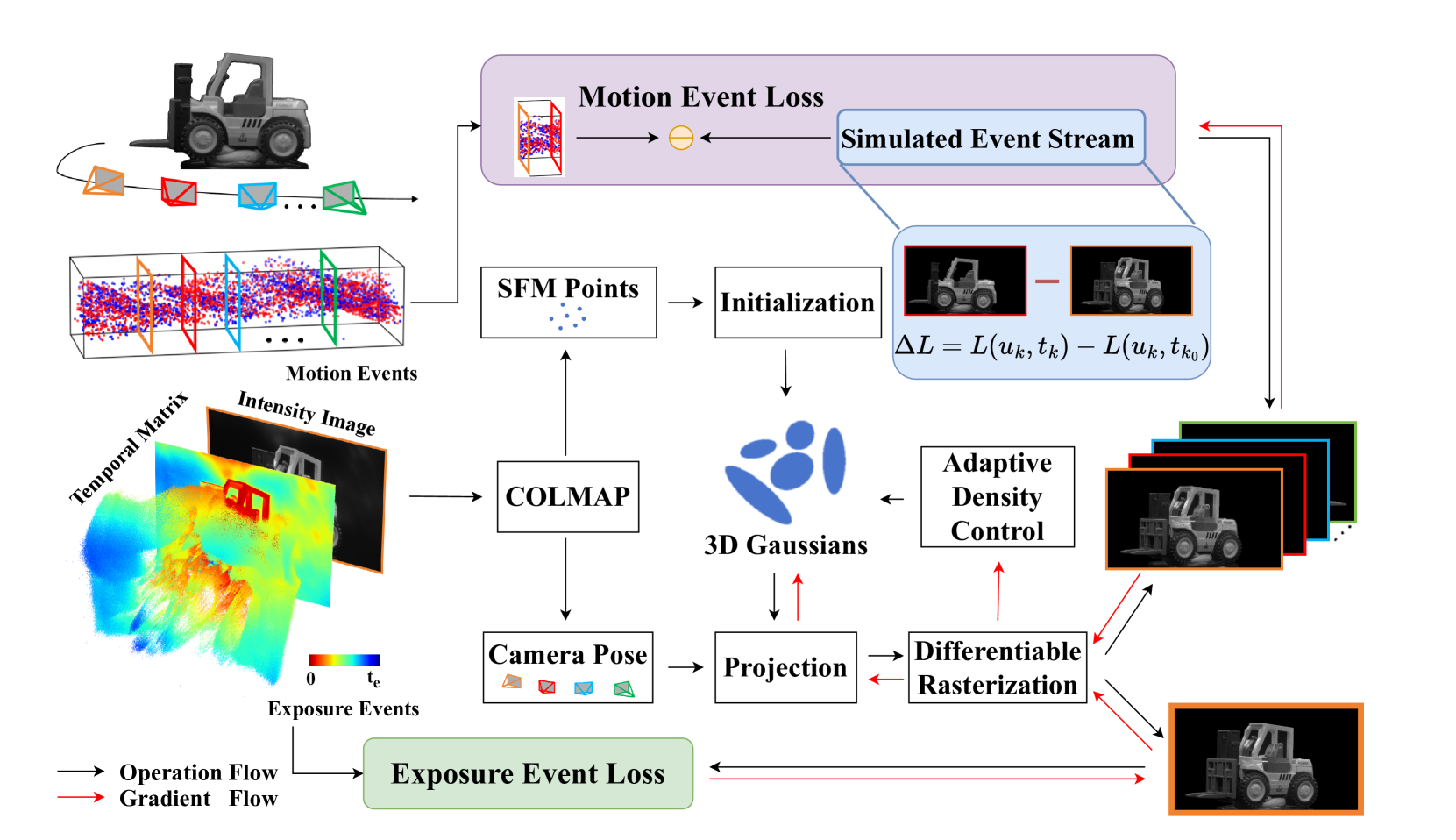

技术框架:E-3DGS框架包含三个主要模式:1) 高质量重建模式:主要依赖曝光事件进行重建,适用于光照不足但运动缓慢的场景;2) 快速重建模式:主要依赖运动事件进行重建,适用于快速运动的场景;3) 混合优化模式:先使用曝光事件进行初始化,然后使用高速运动事件进行优化,以兼顾重建质量和速度。整体流程包括事件数据的预处理、3D高斯溅射的初始化、基于事件的损失函数优化以及最终的3D场景重建。

关键创新:论文的关键创新在于将曝光事件引入到3D高斯溅射框架中,并设计了相应的损失函数来利用曝光事件的信息。与传统的仅使用运动事件的方法相比,E-3DGS能够更好地重建场景的细节,尤其是在光照条件差的情况下。此外,论文还提出了一个包含曝光事件的真实数据集EME-3D,为相关研究提供了数据支持。

关键设计:在损失函数方面,论文可能设计了专门针对曝光事件的损失项,例如基于图像相似性的损失函数,以确保重建的3D高斯能够准确地渲染出与曝光事件对应的灰度图像。具体的网络结构细节未知,但可以推测其高斯参数的更新方式会考虑到曝光事件和运动事件的特性,例如,在曝光事件较多的情况下,更注重颜色和密度的优化,而在运动事件较多的情况下,更注重位置和形状的优化。具体的参数设置细节未知。

🖼️ 关键图片

📊 实验亮点

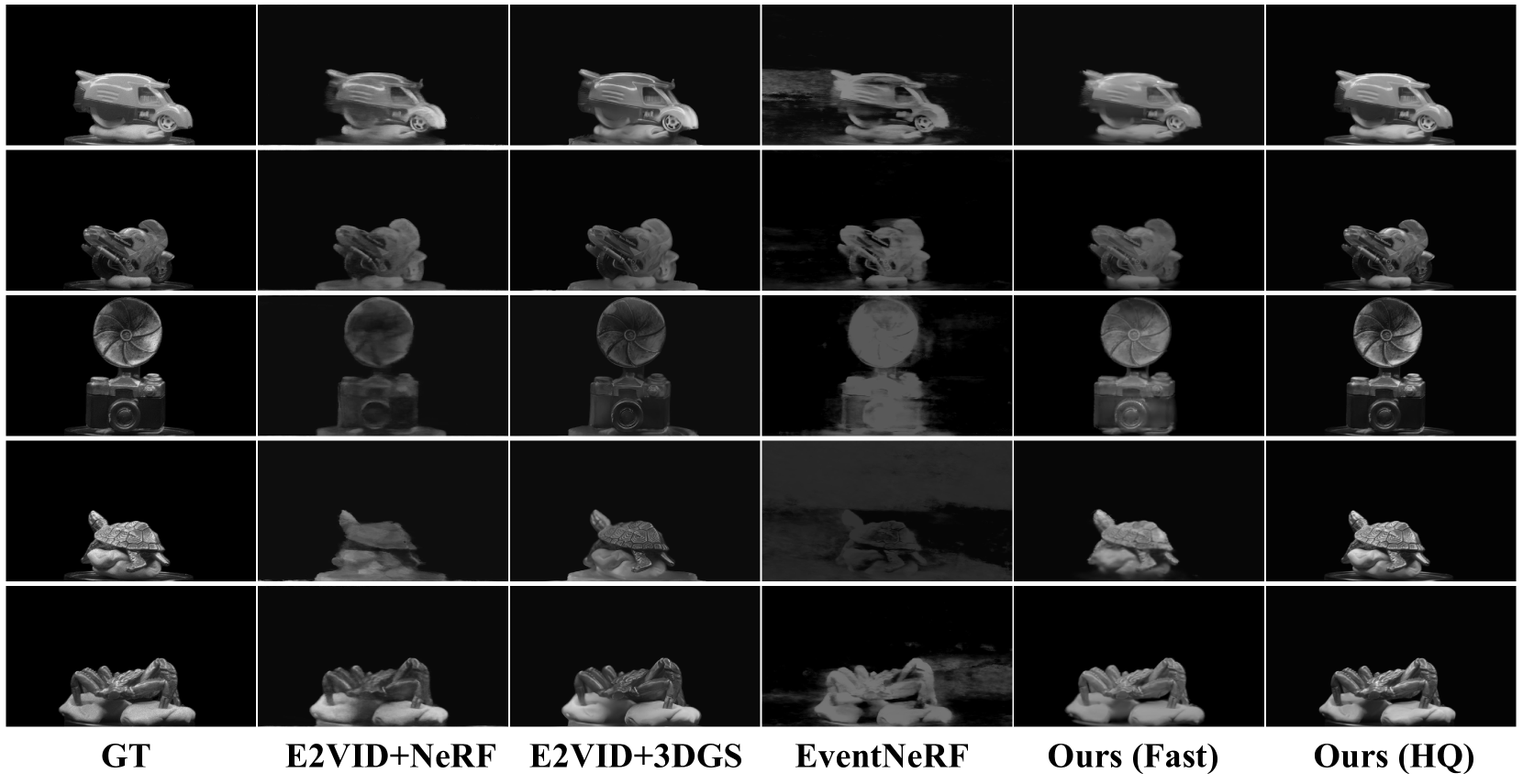

E-3DGS在EventNeRF数据集上,曝光事件显著提高了细节重建质量,优于仅使用运动事件的方法,并在低光照和过度曝光等挑战性条件下优于基于帧的相机。此外,该方法比基于事件的NeRF更快、质量更高,并且比结合事件和RGB数据的方法更具成本效益。EME-3D数据集的发布也为后续研究提供了宝贵资源。

🎯 应用场景

E-3DGS在机器人导航、自动驾驶、虚拟现实和增强现实等领域具有广泛的应用前景。该方法能够在光照条件差、运动模糊等挑战性环境下实现高质量的3D重建,为机器人提供更可靠的环境感知能力。此外,该方法还可以用于文物保护、工业检测等领域,实现对复杂场景的精确建模。

📄 摘要(原文)

Achieving 3D reconstruction from images captured under optimal conditions has been extensively studied in the vision and imaging fields. However, in real-world scenarios, challenges such as motion blur and insufficient illumination often limit the performance of standard frame-based cameras in delivering high-quality images. To address these limitations, we incorporate a transmittance adjustment device at the hardware level, enabling event cameras to capture both motion and exposure events for diverse 3D reconstruction scenarios. Motion events (triggered by camera or object movement) are collected in fast-motion scenarios when the device is inactive, while exposure events (generated through controlled camera exposure) are captured during slower motion to reconstruct grayscale images for high-quality training and optimization of event-based 3D Gaussian Splatting (3DGS). Our framework supports three modes: High-Quality Reconstruction using exposure events, Fast Reconstruction relying on motion events, and Balanced Hybrid optimizing with initial exposure events followed by high-speed motion events. On the EventNeRF dataset, we demonstrate that exposure events significantly improve fine detail reconstruction compared to motion events and outperform frame-based cameras under challenging conditions such as low illumination and overexposure. Furthermore, we introduce EME-3D, a real-world 3D dataset with exposure events, motion events, camera calibration parameters, and sparse point clouds. Our method achieves faster and higher-quality reconstruction than event-based NeRF and is more cost-effective than methods combining event and RGB data. E-3DGS sets a new benchmark for event-based 3D reconstruction with robust performance in challenging conditions and lower hardware demands. The source code and dataset will be available at https://github.com/MasterHow/E-3DGS.