PlaneSAM: Multimodal Plane Instance Segmentation Using the Segment Anything Model

作者: Zhongchen Deng, Zhechen Yang, Chi Chen, Cheng Zeng, Yan Meng, Bisheng Yang

分类: cs.CV

发布日期: 2024-10-21

备注: submitted to Information Fusion

💡 一句话要点

PlaneSAM:利用Segment Anything Model实现多模态平面实例分割

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 平面实例分割 RGB-D数据 多模态融合 Segment Anything Model 自监督预训练

📋 核心要点

- 现有基于深度学习的平面实例分割方法主要依赖RGB信息,忽略了深度信息的重要性,导致分割效果受限。

- PlaneSAM通过双复杂度骨干网络融合RGB和深度信息,并采用自监督预训练策略,提升了模型对RGB-D数据的适应性。

- 实验表明,PlaneSAM在ScanNet数据集上取得了SOTA性能,并在零样本迁移任务中优于现有方法,计算开销增加较小。

📝 摘要(中文)

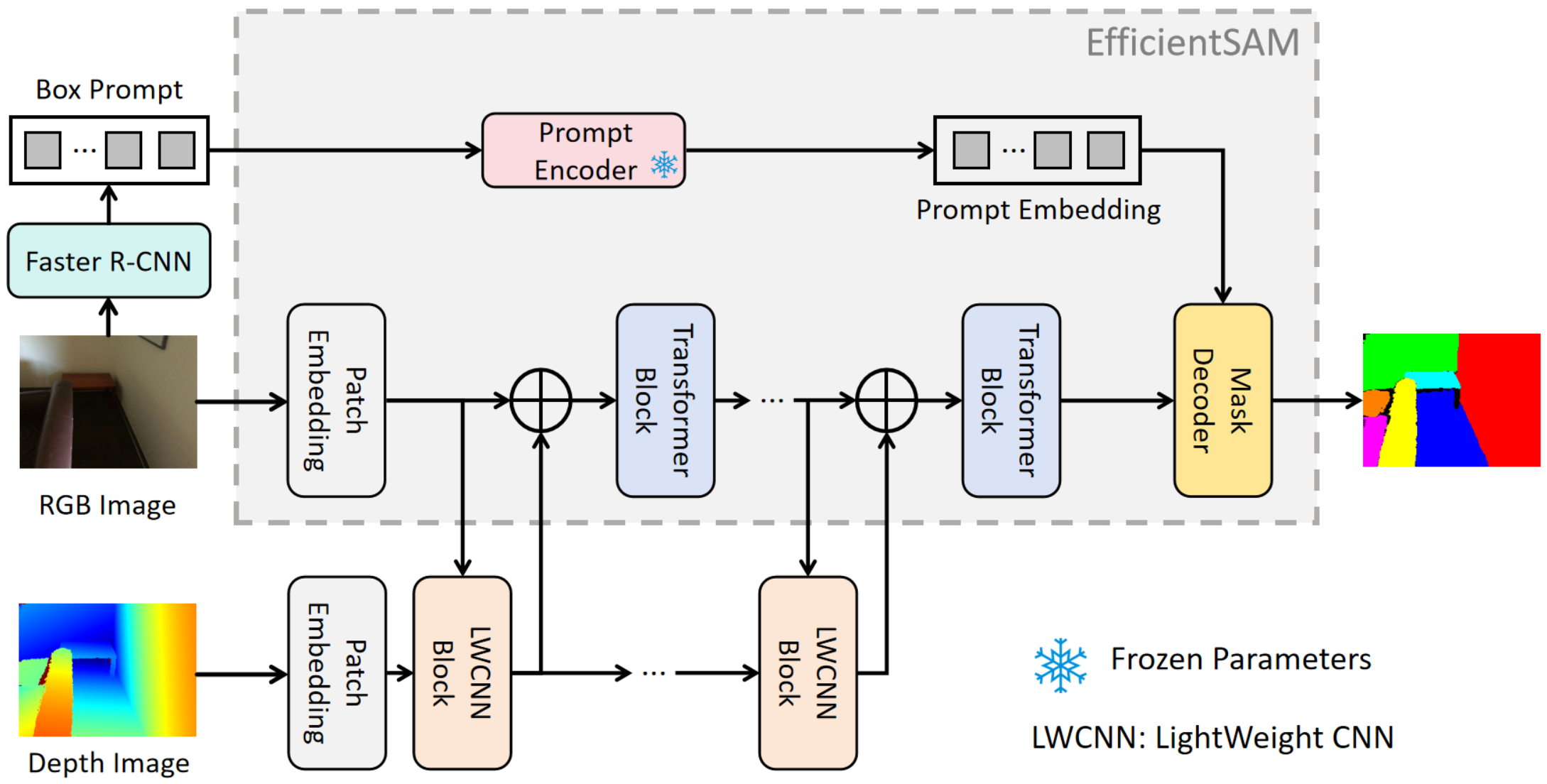

本文提出了一种名为PlaneSAM的平面实例分割网络,该网络基于EfficientSAM,充分融合了RGB波段(光谱波段)和D波段(几何波段)的信息,从而提高了多模态平面实例分割的有效性。PlaneSAM采用双复杂度骨干网络,其中较简单的分支主要学习D波段特征,而较复杂的分支主要学习RGB波段特征。这种设计使得骨干网络即使在D波段训练数据规模有限的情况下,也能有效地学习D波段特征表示,同时保留EfficientSAM强大的RGB波段特征表示能力,并允许原始骨干网络分支针对当前任务进行微调。为了增强PlaneSAM对RGB-D领域的适应性,我们通过基于不完美伪标签的自监督预训练策略,使用大规模RGB-D数据对双复杂度骨干网络进行分割任务预训练。为了支持大型平面的分割,我们优化了EfficientSAM的损失函数组合比例。此外,Faster R-CNN被用作平面检测器,其预测的边界框被输入到我们的双复杂度网络中作为提示,从而实现全自动平面实例分割。实验结果表明,所提出的PlaneSAM在ScanNet数据集上取得了新的SOTA性能,并且在2D-3D-S、Matterport3D和ICL-NUIM RGB-D数据集上的零样本迁移性能优于之前的SOTA方法,而计算开销仅比EfficientSAM增加10%。

🔬 方法详解

问题定义:论文旨在解决RGB-D数据中的平面实例分割问题。现有方法主要依赖RGB信息,忽略了深度信息,导致在复杂场景下分割精度不高,泛化能力不足。此外,缺乏大规模RGB-D数据的有效利用也是一个挑战。

核心思路:论文的核心思路是设计一个能够有效融合RGB和深度信息的双复杂度骨干网络。通过将深度信息引入到分割流程中,并利用自监督预训练策略,提升模型对RGB-D数据的理解和分割能力。同时,优化损失函数和引入平面检测器,进一步提升分割性能和自动化程度。

技术框架:PlaneSAM的整体框架包括以下几个主要模块:1) Faster R-CNN平面检测器,用于生成平面候选区域;2) 双复杂度骨干网络,用于提取RGB和深度特征;3) 分割头,用于预测像素级别的平面实例分割结果。框架首先使用Faster R-CNN检测图像中的平面,然后将检测到的边界框作为提示输入到双复杂度骨干网络中,提取RGB和深度特征,最后通过分割头预测平面实例分割结果。

关键创新:PlaneSAM的关键创新在于:1) 提出了双复杂度骨干网络,能够有效融合RGB和深度信息;2) 采用了基于不完美伪标签的自监督预训练策略,利用大规模RGB-D数据提升模型性能;3) 优化了损失函数组合比例,提升了对大型平面的分割能力。

关键设计:双复杂度骨干网络包含两个分支,一个分支负责学习RGB特征,另一个分支负责学习深度特征。RGB分支采用更复杂的网络结构,以保留EfficientSAM强大的RGB特征表示能力。深度分支采用相对简单的网络结构,以降低计算复杂度,并更容易在有限的深度数据上进行训练。自监督预训练策略使用不完美的伪标签,通过分割任务对骨干网络进行预训练,提升模型对RGB-D数据的适应性。损失函数组合比例的优化旨在平衡分割精度和召回率,提升对大型平面的分割效果。

🖼️ 关键图片

📊 实验亮点

PlaneSAM在ScanNet数据集上取得了新的SOTA性能,并在2D-3D-S、Matterport3D和ICL-NUIM RGB-D数据集上的零样本迁移性能优于之前的SOTA方法。例如,在ScanNet数据集上,PlaneSAM的性能超过了之前的SOTA方法X%,同时计算开销仅比EfficientSAM增加10%。这些结果表明PlaneSAM具有很强的分割性能和泛化能力。

🎯 应用场景

PlaneSAM在机器人导航、三维场景重建、室内设计、增强现实等领域具有广泛的应用前景。它可以帮助机器人更好地理解周围环境,实现更精确的定位和导航。在三维场景重建中,可以用于提取场景中的平面结构,提高重建精度和效率。在室内设计和增强现实中,可以用于识别和分割房间中的墙壁、地板等平面,实现更逼真的虚拟现实体验。

📄 摘要(原文)

Plane instance segmentation from RGB-D data is a crucial research topic for many downstream tasks. However, most existing deep-learning-based methods utilize only information within the RGB bands, neglecting the important role of the depth band in plane instance segmentation. Based on EfficientSAM, a fast version of SAM, we propose a plane instance segmentation network called PlaneSAM, which can fully integrate the information of the RGB bands (spectral bands) and the D band (geometric band), thereby improving the effectiveness of plane instance segmentation in a multimodal manner. Specifically, we use a dual-complexity backbone, with primarily the simpler branch learning D-band features and primarily the more complex branch learning RGB-band features. Consequently, the backbone can effectively learn D-band feature representations even when D-band training data is limited in scale, retain the powerful RGB-band feature representations of EfficientSAM, and allow the original backbone branch to be fine-tuned for the current task. To enhance the adaptability of our PlaneSAM to the RGB-D domain, we pretrain our dual-complexity backbone using the segment anything task on large-scale RGB-D data through a self-supervised pretraining strategy based on imperfect pseudo-labels. To support the segmentation of large planes, we optimize the loss function combination ratio of EfficientSAM. In addition, Faster R-CNN is used as a plane detector, and its predicted bounding boxes are fed into our dual-complexity network as prompts, thereby enabling fully automatic plane instance segmentation. Experimental results show that the proposed PlaneSAM sets a new SOTA performance on the ScanNet dataset, and outperforms previous SOTA approaches in zero-shot transfer on the 2D-3D-S, Matterport3D, and ICL-NUIM RGB-D datasets, while only incurring a 10% increase in computational overhead compared to EfficientSAM.