A Multimodal Vision Foundation Model for Clinical Dermatology

作者: Siyuan Yan, Zhen Yu, Clare Primiero, Cristina Vico-Alonso, Zhonghua Wang, Litao Yang, Philipp Tschandl, Ming Hu, Lie Ju, Gin Tan, Vincent Tang, Aik Beng Ng, David Powell, Paul Bonnington, Simon See, Elisabetta Magnaterra, Peter Ferguson, Jennifer Nguyen, Pascale Guitera, Jose Banuls, Monika Janda, Victoria Mar, Harald Kittler, H. Peter Soyer, Zongyuan Ge

分类: cs.CV, cs.AI

发布日期: 2024-10-19 (更新: 2025-04-13)

备注: 74 pages; Preprint; The code can be found at https://github.com/SiyuanYan1/PanDerm

🔗 代码/项目: GITHUB

💡 一句话要点

PanDerm:用于临床皮肤科的多模态视觉基础模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 皮肤科 基础模型 自监督学习 临床诊断 Transformer 医学影像 皮肤癌

📋 核心要点

- 现有深度学习模型在皮肤科特定任务表现出色,但缺乏处理临床实践中复杂多模态数据的能力。

- PanDerm通过自监督学习,利用来自多种成像方式的大量真实世界皮肤疾病图像进行预训练。

- PanDerm在多项皮肤科任务中达到SOTA,且在临床医生辅助诊断实验中表现出显著的性能提升。

📝 摘要(中文)

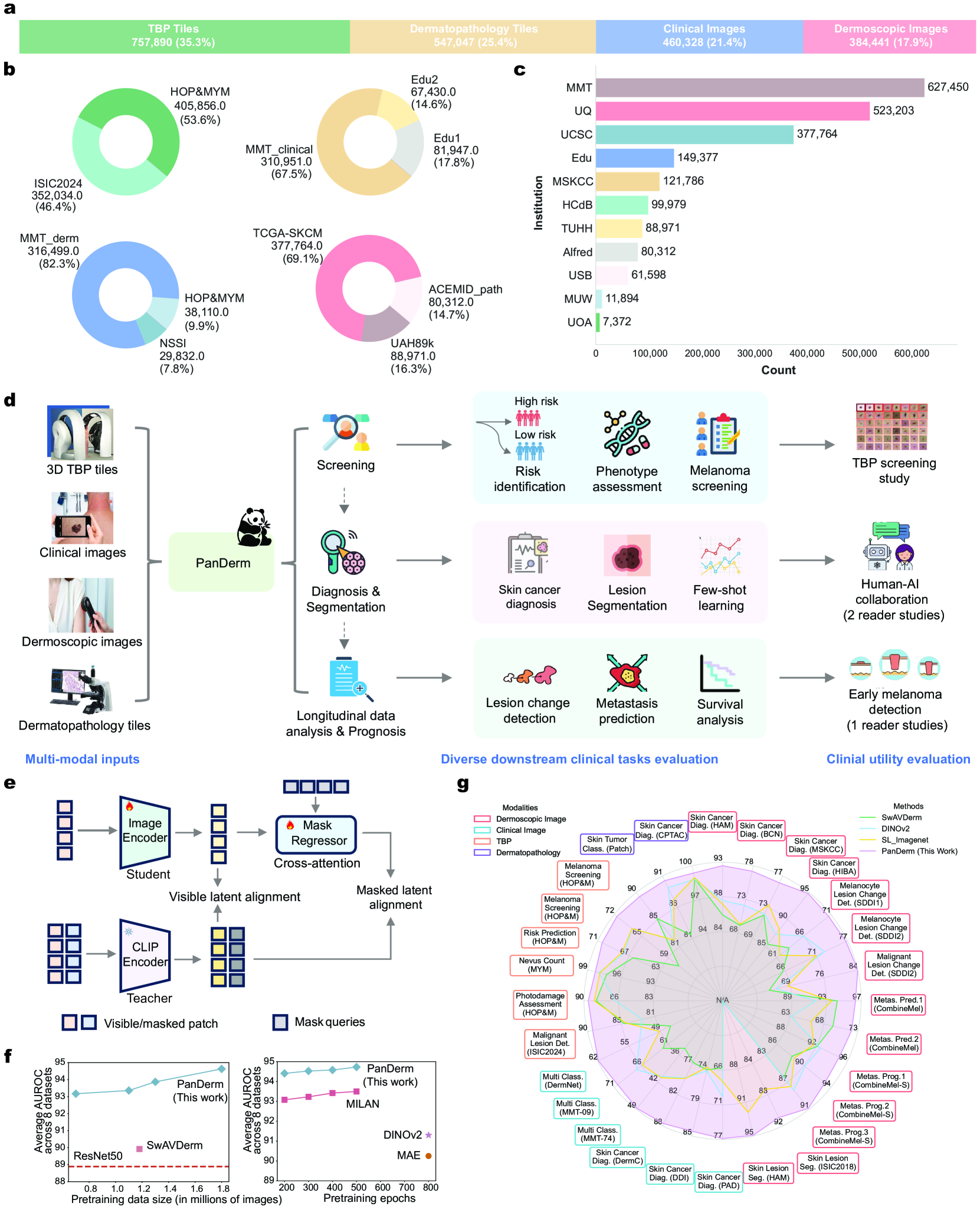

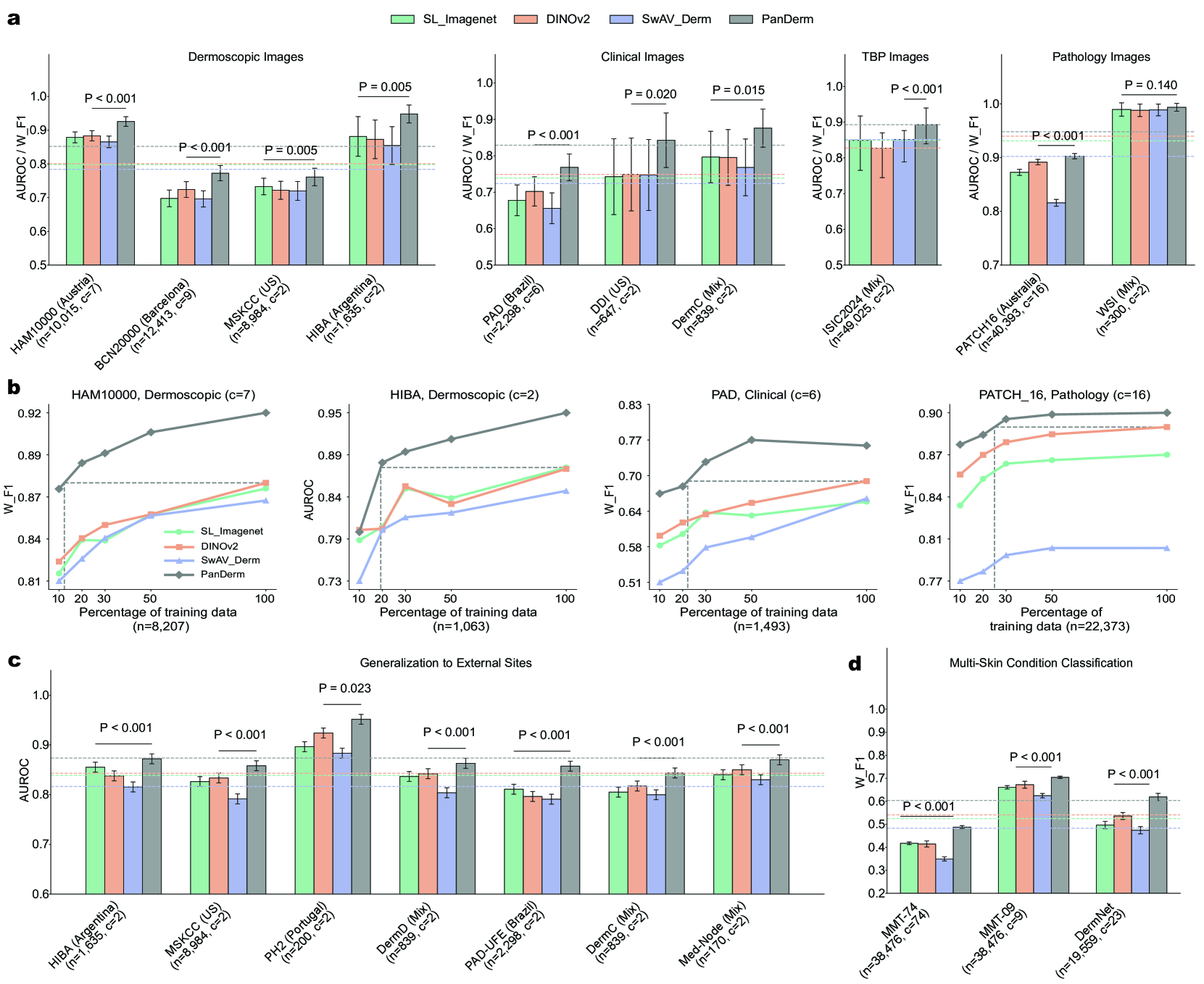

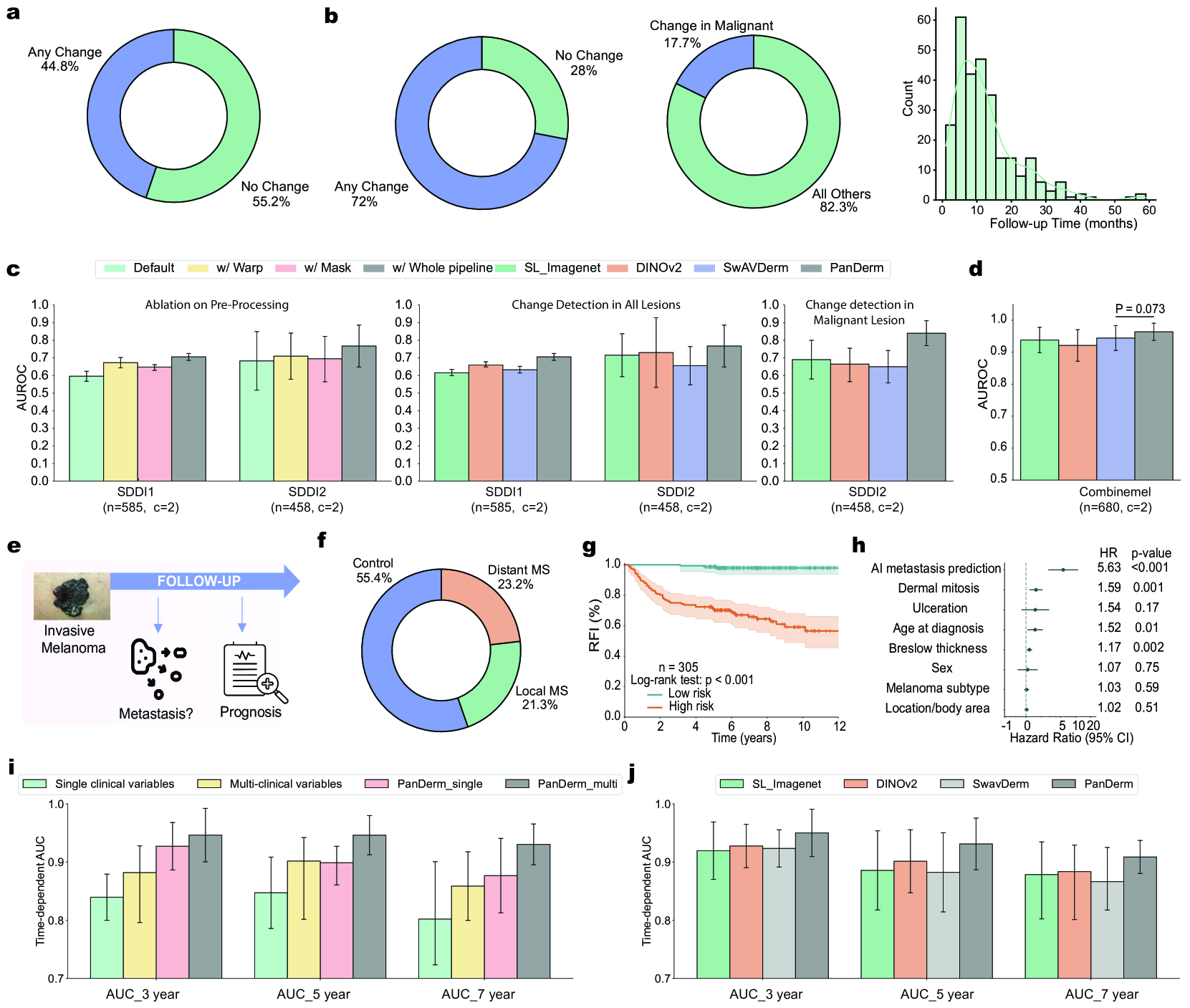

皮肤疾病的诊断和治疗需要在多个领域具备先进的视觉技能,并能够综合来自多种成像方式的信息。虽然目前的深度学习模型擅长于特定任务,例如从皮肤镜图像中诊断皮肤癌,但它们难以满足临床实践中复杂的多模态要求。我们推出了PanDerm,一个多模态皮肤科基础模型,通过自监督学习在来自11个临床机构的超过200万张真实世界皮肤疾病图像上进行预训练,这些图像来自4种成像方式。我们在28个不同的基准上评估了PanDerm,包括皮肤癌筛查、风险分层、常见和罕见皮肤病的鉴别诊断、病灶分割、纵向监测以及转移预测和预后。PanDerm在所有评估任务中都取得了最先进的性能,通常在使用仅10%的标记数据时就优于现有模型。我们进行了三项读者研究,以评估PanDerm的潜在临床效用。PanDerm在通过纵向分析进行早期黑色素瘤检测方面优于临床医生10.2%,在皮肤镜图像上将临床医生的皮肤癌诊断准确率提高了11%,并在临床照片上将非皮肤科医生医疗保健提供者的128种皮肤病的鉴别诊断准确率提高了16.5%。这些结果表明,PanDerm有潜力改善各种临床场景中的患者护理,并可作为在其他医学专业中开发多模态基础模型的范例,从而可能加速人工智能支持在医疗保健领域的整合。代码可在https://github.com/SiyuanYan1/PanDerm找到。

🔬 方法详解

问题定义:现有皮肤科AI模型通常针对单一成像模态和特定任务设计,无法有效整合来自不同模态的信息,难以满足临床实践中对皮肤疾病进行全面诊断和管理的需要。现有方法对标注数据的依赖性强,泛化能力有限,难以适应不同临床环境和罕见病例。

核心思路:PanDerm的核心思路是构建一个多模态的皮肤科基础模型,通过大规模自监督学习,使模型能够学习到皮肤疾病的通用视觉表征,从而能够适应各种不同的下游任务和成像模态。通过多模态融合,模型可以综合利用不同模态的信息,提高诊断的准确性和可靠性。

技术框架:PanDerm的整体框架包括数据收集与预处理、自监督预训练和下游任务微调三个主要阶段。首先,收集来自多个临床机构的多种成像模态的皮肤疾病图像数据,并进行预处理。然后,利用自监督学习方法,在大规模数据集上对模型进行预训练,学习通用的视觉表征。最后,在各种下游任务上对预训练模型进行微调,以适应特定的任务需求。

关键创新:PanDerm的关键创新在于其多模态融合和自监督学习策略。通过融合来自不同成像模态的信息,模型可以更全面地理解皮肤疾病的特征。自监督学习方法可以有效利用大规模无标注数据,提高模型的泛化能力和鲁棒性。此外,PanDerm在多个皮肤科任务上都取得了SOTA性能,证明了其有效性和通用性。

关键设计:PanDerm采用了Transformer架构作为其核心模型,并针对多模态数据进行了优化。具体来说,模型使用不同的编码器处理不同模态的图像,然后通过注意力机制将不同模态的特征进行融合。在自监督学习阶段,模型采用了对比学习和掩码图像建模等技术,以学习高质量的视觉表征。损失函数的设计也考虑了多模态数据的特点,以平衡不同模态的贡献。

🖼️ 关键图片

📊 实验亮点

PanDerm在28个不同的皮肤科基准测试中取得了最先进的性能,并且在使用仅10%的标记数据时通常优于现有模型。在早期黑色素瘤检测中,PanDerm的性能优于临床医生10.2%。在皮肤镜图像上,PanDerm将临床医生的皮肤癌诊断准确率提高了11%。在临床照片上,PanDerm将非皮肤科医生医疗保健提供者的128种皮肤病的鉴别诊断准确率提高了16.5%。

🎯 应用场景

PanDerm具有广泛的应用前景,可用于皮肤癌筛查、风险分层、鉴别诊断、病灶分割、纵向监测以及转移预测和预后等多个方面。该模型可以辅助临床医生进行诊断,提高诊断的准确性和效率,尤其是在早期黑色素瘤检测和罕见皮肤病诊断方面。此外,PanDerm还可以用于远程医疗和移动医疗,为患者提供便捷的皮肤病诊断服务。未来,PanDerm有望成为皮肤科医生不可或缺的AI助手,并推动皮肤科诊疗水平的提升。

📄 摘要(原文)

Diagnosing and treating skin diseases require advanced visual skills across domains and the ability to synthesize information from multiple imaging modalities. While current deep learning models excel at specific tasks like skin cancer diagnosis from dermoscopic images, they struggle to meet the complex, multimodal requirements of clinical practice. Here, we introduce PanDerm, a multimodal dermatology foundation model pretrained through self-supervised learning on over 2 million real-world skin disease images from 11 clinical institutions across 4 imaging modalities. We evaluated PanDerm on 28 diverse benchmarks, including skin cancer screening, risk stratification, differential diagnosis of common and rare skin conditions, lesion segmentation, longitudinal monitoring, and metastasis prediction and prognosis. PanDerm achieved state-of-the-art performance across all evaluated tasks, often outperforming existing models when using only 10% of labeled data. We conducted three reader studies to assess PanDerm's potential clinical utility. PanDerm outperformed clinicians by 10.2% in early-stage melanoma detection through longitudinal analysis, improved clinicians' skin cancer diagnostic accuracy by 11% on dermoscopy images, and enhanced non-dermatologist healthcare providers' differential diagnosis by 16.5% across 128 skin conditions on clinical photographs. These results demonstrate PanDerm's potential to improve patient care across diverse clinical scenarios and serve as a model for developing multimodal foundation models in other medical specialties, potentially accelerating the integration of AI support in healthcare. The code can be found at https://github.com/SiyuanYan1/PanDerm.