Performance of Gaussian Mixture Model Classifiers on Embedded Feature Spaces

作者: Jeremy Chopin, Rozenn Dahyot

分类: cs.CV

发布日期: 2024-10-17

备注: 8 pages

💡 一句话要点

提出一种参数量更少的GMM分类器,并评估其在CLIP和ImageBind嵌入特征空间上的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 高斯混合模型 GMM分类器 CLIP ImageBind 嵌入特征 对比学习 多模态数据

📋 核心要点

- 现有分类方法在处理CLIP和ImageBind等嵌入特征空间时,可能存在参数量大、计算复杂度高的问题。

- 本文提出一种参数量更少的GMM分类器,旨在降低计算成本,同时保持或提升分类性能。

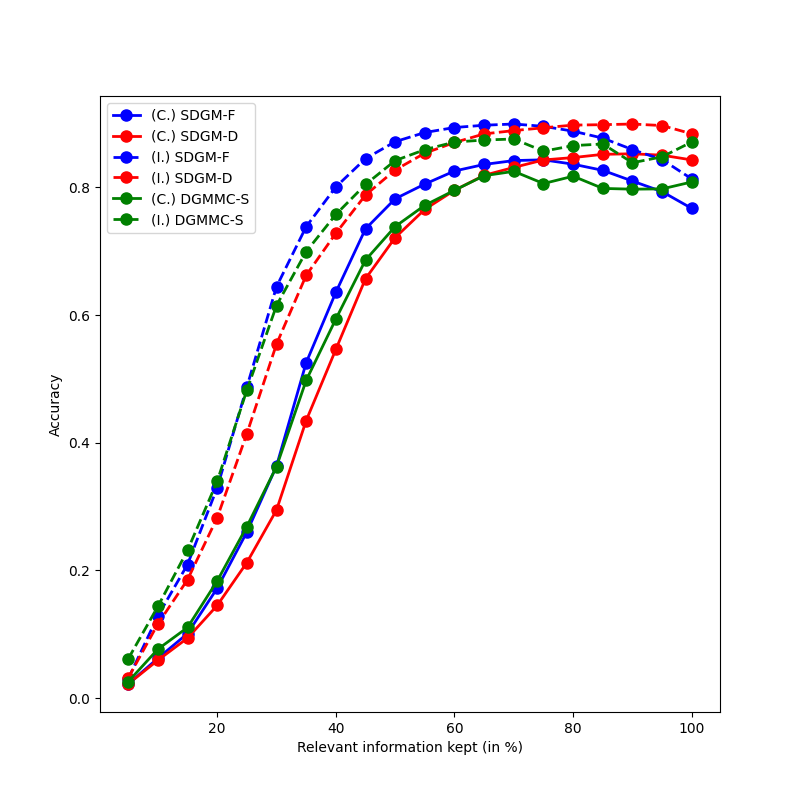

- 实验结果表明,在CLIP和ImageBind嵌入空间中,单个高斯分量通常足以捕获每个类,ImageBind表现优于CLIP。

📝 摘要(中文)

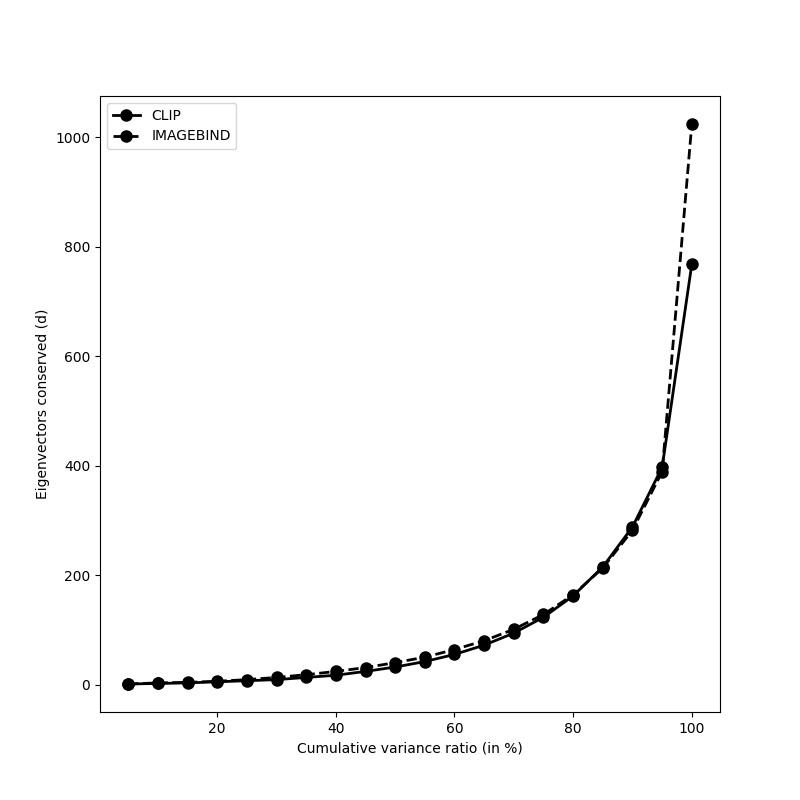

本文评估了CLIP和ImageBind数据嵌入在多媒体和/或多模态数据分析中的分类性能,使用基于高斯混合模型(GMM)的层作为标准Softmax层的替代方案。最近的研究表明,基于GMM的分类器在端到端训练的深度学习流程中表现出有趣的性能。本文的第一个贡献是研究基于GMM的分类性能,利用CLIP和ImageBind的嵌入空间。第二个贡献是提出了一种参数数量比以往提出的GMM分类器更少的GMM分类器。研究结果表明,在这些测试的嵌入空间中,GMM中的一个高斯分量通常足以捕获每个类,我们假设这可能是由于用于训练这些嵌入空间的对比损失自然地将每个类的特征集中在一起。我们还观察到,即使使用PCA压缩这些嵌入空间,ImageBind在图像数据集分类方面通常比CLIP提供更好的性能。

🔬 方法详解

问题定义:论文旨在解决在CLIP和ImageBind等嵌入特征空间上进行高效分类的问题。现有方法,如直接使用Softmax层,可能无法充分利用这些嵌入空间的特性,或者引入过多的参数,导致计算效率降低。因此,需要一种更轻量级、更适应嵌入空间特性的分类方法。

核心思路:论文的核心思路是利用高斯混合模型(GMM)来对嵌入特征空间中的类别进行建模。GMM能够捕捉数据的分布特征,并且可以通过调整高斯分量的数量来控制模型的复杂度。特别地,论文发现对于CLIP和ImageBind等通过对比学习训练得到的嵌入空间,每个类别的数据往往聚集在一起,因此可以使用较少的高斯分量来表示每个类别,从而降低参数量。

技术框架:整体框架包括:1) 使用CLIP或ImageBind等模型提取图像的嵌入特征;2) 使用GMM对每个类别的嵌入特征进行建模,学习每个类别的高斯分布参数(均值、方差);3) 对于新的图像,提取其嵌入特征,并计算其属于每个类别的概率(基于GMM模型);4) 选择概率最高的类别作为预测结果。

关键创新:最重要的创新点在于提出了一种参数量更少的GMM分类器,并验证了其在CLIP和ImageBind嵌入空间上的有效性。与传统的GMM分类器相比,该方法通过减少每个类别所需的高斯分量数量,显著降低了参数量,同时保持了良好的分类性能。此外,论文还观察到对比学习训练的嵌入空间具有类别聚集的特性,并将其与GMM分类器的性能联系起来。

关键设计:关键设计包括:1) GMM中高斯分量的数量:论文发现通常每个类别只需要一个高斯分量就足够了,这大大降低了参数量;2) GMM参数的学习:可以使用期望最大化(EM)算法来学习GMM的参数;3) PCA降维:为了进一步降低计算复杂度,可以使用PCA对嵌入特征进行降维;4) 损失函数:由于GMM本身就是一个概率模型,因此可以直接使用负对数似然作为损失函数进行训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在CLIP和ImageBind嵌入空间上,提出的GMM分类器能够取得与传统方法相当甚至更好的性能,同时显著降低了参数量。特别地,论文发现通常每个类别只需要一个高斯分量就足够了,这大大简化了模型。此外,ImageBind在图像数据集分类方面通常比CLIP提供更好的性能,即使在PCA降维后也是如此。

🎯 应用场景

该研究成果可应用于各种多媒体数据分类任务,例如图像分类、视频分类、音频分类等。特别是在资源受限的设备上,轻量级的GMM分类器可以实现高效的分类,具有重要的实际应用价值。此外,该研究也为理解对比学习训练的嵌入空间的特性提供了新的视角,有助于设计更有效的分类方法。

📄 摘要(原文)

Data embeddings with CLIP and ImageBind provide powerful features for the analysis of multimedia and/or multimodal data. We assess their performance here for classification using a Gaussian Mixture models (GMMs) based layer as an alternative to the standard Softmax layer. GMMs based classifiers have recently been shown to have interesting performances as part of deep learning pipelines trained end-to-end. Our first contribution is to investigate GMM based classification performance taking advantage of the embedded spaces CLIP and ImageBind. Our second contribution is in proposing our own GMM based classifier with a lower parameters count than previously proposed. Our findings are, that in most cases, on these tested embedded spaces, one gaussian component in the GMMs is often enough for capturing each class, and we hypothesize that this may be due to the contrastive loss used for training these embedded spaces that naturally concentrates features together for each class. We also observed that ImageBind often provides better performance than CLIP for classification of image datasets even when these embedded spaces are compressed using PCA.