Performance Evaluation of Deep Learning and Transformer Models Using Multimodal Data for Breast Cancer Classification

作者: Sadam Hussain, Mansoor Ali, Usman Naseem, Beatriz Alejandra Bosques Palomo, Mario Alexis Monsivais Molina, Jorge Alberto Garza Abdala, Daly Betzabeth Avendano Avalos, Servando Cardona-Huerta, T. Aaron Gulliver, Jose Gerardo Tamez Pena

分类: eess.IV, cs.CV

发布日期: 2024-10-14

备注: The paper was accepted and presented in 3rd Workshop on Cancer Prevention, detection, and intervenTion (CaPTion @ MICCAI 2024)

DOI: 10.1007/978-3-031-73376-5_6

💡 一句话要点

提出基于多模态数据融合的深度学习模型,用于提升乳腺癌分类性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 乳腺癌分类 多模态融合 深度学习 图像特征提取 文本特征提取

📋 核心要点

- 现有乳腺癌诊断模型主要依赖单模态的乳腺X线照片,信息来源单一,限制了诊断性能的进一步提升。

- 该论文提出一种多模态深度学习架构,融合乳腺X线照片和放射学报告,提取图像和文本特征进行乳腺癌分类。

- 实验结果表明,VGG19和ANN的组合在准确率和精确率上表现最佳,VGG16+LSTM在灵敏度和AUC上表现最佳。

📝 摘要(中文)

乳腺癌(BC)发病率和死亡率的上升是全球女性面临的主要问题。深度学习(DL)在BC分类中表现出优于人类专家的诊断性能。然而,当前诊断模型主要使用单模态(数字乳腺X线照片)特征,这可能限制了其性能。为了解决这个问题,我们收集了一个包含图像和文本数据的新型多模态数据集。本研究提出了一种用于BC分类的多模态DL架构,利用来自我们内部数据集的图像(乳腺X线照片;四个视图)和文本数据(放射学报告)。应用各种增强技术来增加图像和文本数据的训练数据量。我们探索了11种SOTA DL架构(VGG16、VGG19、ResNet34、ResNet50、MobileNet-v3、EffNet-b0、EffNet-b1、EffNet-b2、EffNet-b3、EffNet-b7和Vision Transformer (ViT))作为图像特征提取器的性能。对于文本特征提取,我们使用了人工神经网络(ANN)或长短期记忆(LSTM)网络。然后,使用晚期融合技术将组合的图像和文本特征输入到ANN分类器中进行BC分类。我们评估了不同的特征提取器和分类器组合。VGG19和ANN的组合获得了最高的0.951的准确率。在精确率方面,VGG19和ANN的组合再次超过了其他基于CNN和LSTM、ANN的架构,达到了0.95的分数。VGG16+LSTM实现了0.903的最佳灵敏度分数。VGG19+LSTM实现了0.931的最高F1分数。只有VGG16+LSTM实现了0.937的最佳曲线下面积(AUC),VGG16+LSTM紧随其后,AUC分数为0.929。

🔬 方法详解

问题定义:该论文旨在提高乳腺癌分类的准确性。现有方法主要依赖于单模态的乳腺X线图像,忽略了放射学报告中包含的丰富文本信息。这种单模态方法限制了诊断模型的性能,无法充分利用可用的信息资源。

核心思路:论文的核心思路是利用多模态数据融合,将乳腺X线图像和放射学报告的文本信息结合起来,从而提高乳腺癌分类的准确性。通过深度学习模型分别提取图像和文本特征,然后将这些特征融合并输入到分类器中,实现更准确的诊断。

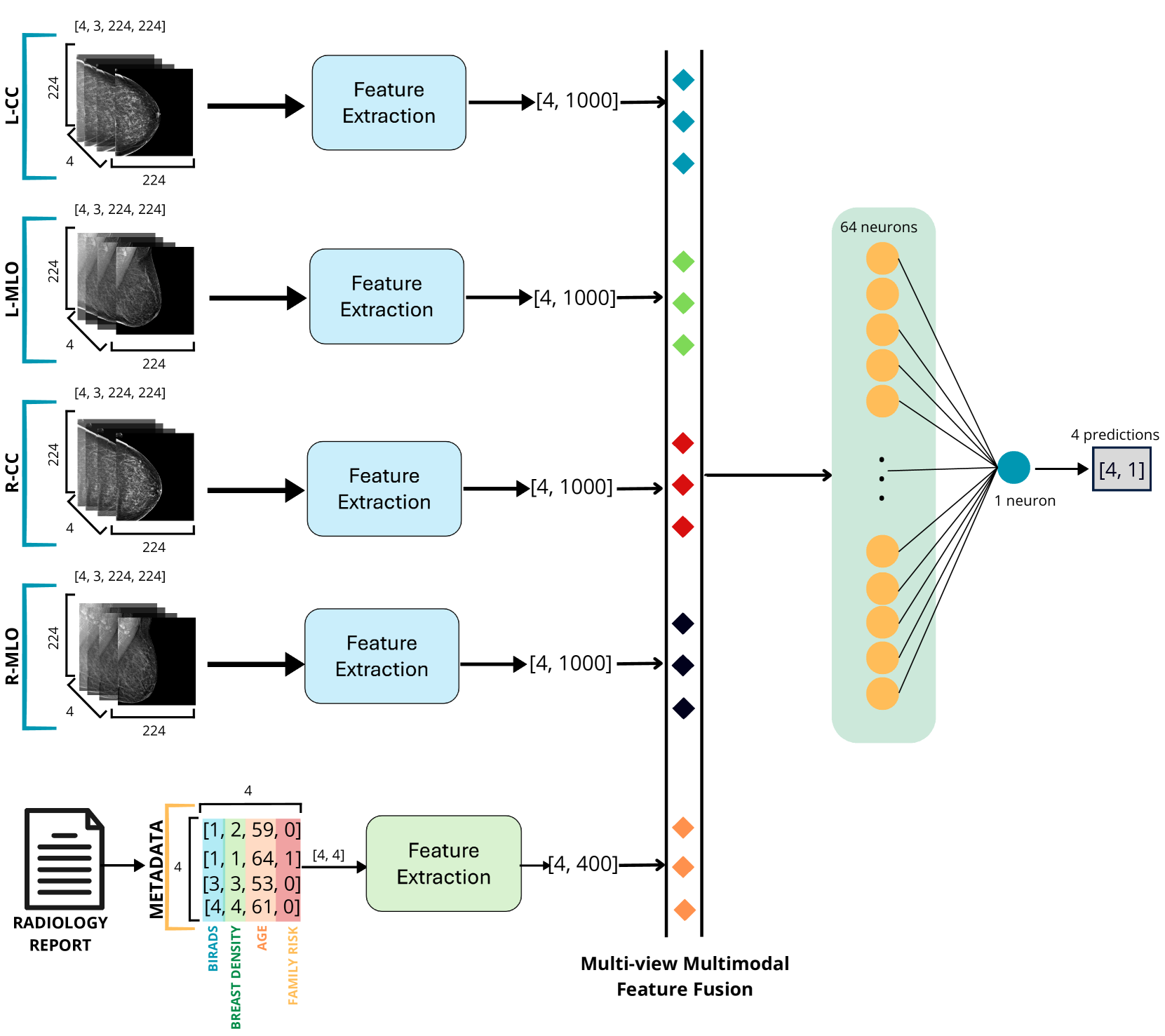

技术框架:整体架构包括以下几个主要模块:1) 图像特征提取:使用预训练的深度学习模型(如VGG16、VGG19、ResNet等)提取乳腺X线图像的特征。2) 文本特征提取:使用人工神经网络(ANN)或长短期记忆网络(LSTM)提取放射学报告的文本特征。3) 特征融合:采用晚期融合技术,将图像和文本特征连接起来。4) 分类器:使用ANN分类器对融合后的特征进行乳腺癌分类。

关键创新:该论文的关键创新在于多模态数据融合策略。与传统的单模态方法相比,该方法能够充分利用图像和文本信息,从而提高分类的准确性。此外,该研究还探索了多种深度学习模型作为图像和文本特征提取器,并比较了它们的性能。

关键设计:在图像特征提取方面,使用了多种预训练的卷积神经网络(CNN),包括VGG16、VGG19、ResNet34、ResNet50、MobileNet-v3、EfficientNet等。在文本特征提取方面,使用了ANN和LSTM网络。特征融合采用晚期融合策略,即将图像和文本特征连接起来。分类器采用ANN,并使用交叉熵损失函数进行训练。数据增强技术也被应用于图像和文本数据,以增加训练数据的多样性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VGG19和ANN的组合在准确率和精确率上表现最佳,分别达到0.951和0.95。VGG16+LSTM在灵敏度上表现最佳,达到0.903,并且在AUC上取得了0.937的最高分。这些结果表明,多模态数据融合能够显著提高乳腺癌分类的性能。

🎯 应用场景

该研究成果可应用于乳腺癌的辅助诊断,帮助医生更准确地识别病灶,提高诊断效率和准确性。通过整合影像和文本信息,可以为患者提供更全面的评估,并为制定个性化治疗方案提供依据。未来,该技术有望推广到其他疾病的诊断中,实现更智能化的医疗服务。

📄 摘要(原文)

Rising breast cancer (BC) occurrence and mortality are major global concerns for women. Deep learning (DL) has demonstrated superior diagnostic performance in BC classification compared to human expert readers. However, the predominant use of unimodal (digital mammography) features may limit the current performance of diagnostic models. To address this, we collected a novel multimodal dataset comprising both imaging and textual data. This study proposes a multimodal DL architecture for BC classification, utilising images (mammograms; four views) and textual data (radiological reports) from our new in-house dataset. Various augmentation techniques were applied to enhance the training data size for both imaging and textual data. We explored the performance of eleven SOTA DL architectures (VGG16, VGG19, ResNet34, ResNet50, MobileNet-v3, EffNet-b0, EffNet-b1, EffNet-b2, EffNet-b3, EffNet-b7, and Vision Transformer (ViT)) as imaging feature extractors. For textual feature extraction, we utilised either artificial neural networks (ANNs) or long short-term memory (LSTM) networks. The combined imaging and textual features were then inputted into an ANN classifier for BC classification, using the late fusion technique. We evaluated different feature extractor and classifier arrangements. The VGG19 and ANN combinations achieved the highest accuracy of 0.951. For precision, the VGG19 and ANN combination again surpassed other CNN and LSTM, ANN based architectures by achieving a score of 0.95. The best sensitivity score of 0.903 was achieved by the VGG16+LSTM. The highest F1 score of 0.931 was achieved by VGG19+LSTM. Only the VGG16+LSTM achieved the best area under the curve (AUC) of 0.937, with VGG16+LSTM closely following with a 0.929 AUC score.