ESVO2: Direct Visual-Inertial Odometry with Stereo Event Cameras

作者: Junkai Niu, Sheng Zhong, Xiuyuan Lu, Shaojie Shen, Guillermo Gallego, Yi Zhou

分类: cs.CV, cs.RO

发布日期: 2024-10-12 (更新: 2025-09-08)

期刊: IEEE Transactions on Robotics, 2025

💡 一句话要点

ESVO2:一种利用立体事件相机和IMU的直接法视觉惯性里程计

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 事件相机 视觉惯性里程计 直接法 立体视觉 IMU预积分

📋 核心要点

- 现有直接法事件相机里程计计算复杂度高,且在旋转的某些自由度上存在姿态跟踪退化问题。

- ESVO2通过动态事件采样加速地图构建,融合时序和静态立体信息提升地图质量,并利用IMU预积分提供运动先验。

- 实验表明,ESVO2在高分辨率事件相机下表现良好,并在大规模户外环境中实现了更高的全局定位精度。

📝 摘要(中文)

本文提出了一种基于直接法的立体事件相机视觉惯性里程计系统ESVO2。针对事件数据在大基线视角变化下难以建立显式数据关联的问题,采用直接法。为加速地图构建,提出了一种根据事件局部动态采样轮廓点的有效策略,并通过融合时序立体和静态立体结果,提高了地图的完整性和局部平滑性。为解决相机姿态跟踪中俯仰角和偏航角自由度的退化问题,引入IMU预积分作为运动先验。为此,提出了一个紧凑的后端,用于持续更新IMU偏差和预测线性速度,从而实现精确的相机姿态跟踪运动预测。该系统能够很好地扩展到现代高分辨率事件相机,并在大规模户外环境中实现更好的全局定位精度。在五个公开数据集上的大量评估表明,所提出的系统优于五种最先进的方法。

🔬 方法详解

问题定义:事件相机视觉里程计旨在利用神经形态相机的特殊工作原理解决跟踪和建图问题。然而,由于事件数据对运动的依赖性,在大基线视角变化下难以建立显式的数据关联,使得直接法成为更合理的选择。现有的直接法受到地图构建子问题的高计算复杂度和相机姿态跟踪在某些旋转自由度上的退化问题的限制。

核心思路:ESVO2的核心思路是结合立体事件相机和IMU,利用直接法构建一个高效且鲁棒的视觉惯性里程计系统。通过动态事件采样加速地图构建,融合时序和静态立体信息提升地图质量,并利用IMU预积分提供运动先验,解决姿态跟踪退化问题。

技术框架:ESVO2系统主要包含以下几个模块:1) 事件预处理:对原始事件数据进行滤波和去噪。2) 动态事件采样:根据事件的局部动态信息,高效地采样轮廓点,用于地图构建。3) 立体匹配与深度估计:利用立体事件相机进行立体匹配,估计场景深度。4) 地图构建:融合时序立体和静态立体结果,构建稠密的三维地图。5) 基于IMU预积分的姿态跟踪:利用IMU预积分提供运动先验,进行相机姿态跟踪。6) 后端优化:采用紧凑的后端,持续更新IMU偏差和预测线性速度,优化相机姿态和地图。

关键创新:ESVO2的关键创新点在于:1) 提出了一种高效的动态事件采样策略,显著加速了地图构建过程。2) 融合了时序立体和静态立体信息,提高了地图的完整性和局部平滑性。3) 利用IMU预积分作为运动先验,有效解决了相机姿态跟踪中俯仰角和偏航角自由度的退化问题。

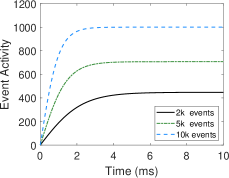

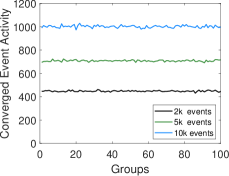

关键设计:动态事件采样策略根据事件的局部动态信息(例如,事件发生的频率和梯度)来确定采样概率。时序立体通过连续帧之间的事件流进行匹配,静态立体则利用同一时刻左右相机的事件进行匹配。IMU预积分采用标准的预积分理论,将IMU测量值积分到两个关键帧之间,作为运动约束。后端优化采用滑动窗口优化,优化窗口内的相机姿态、地图点和IMU偏差。

🖼️ 关键图片

📊 实验亮点

ESVO2在五个公开数据集上进行了广泛的评估,包括不同分辨率和场景。实验结果表明,ESVO2在定位精度和鲁棒性方面均优于五种最先进的方法。例如,在某些数据集上,ESVO2的定位误差降低了20%以上,并且能够处理更具挑战性的场景,例如快速运动和光照变化。

🎯 应用场景

ESVO2可应用于无人机、机器人、增强现实等领域。在无人机自主导航中,可以提供准确的位姿估计,使其能够在复杂环境中安全飞行。在机器人领域,可以用于实时定位和地图构建,支持机器人的自主探索和操作。在增强现实应用中,可以实现精确的场景重建和虚拟物体注册,提升用户体验。

📄 摘要(原文)

Event-based visual odometry is a specific branch of visual Simultaneous Localization and Mapping (SLAM) techniques, which aims at solving tracking and mapping subproblems (typically in parallel), by exploiting the special working principles of neuromorphic (i.e., event-based) cameras. Due to the motion-dependent nature of event data, explicit data association (i.e., feature matching) under large-baseline view-point changes is difficult to establish, making direct methods a more rational choice. However, state-of-the-art direct methods are limited by the high computational complexity of the mapping sub-problem and the degeneracy of camera pose tracking in certain degrees of freedom (DoF) in rotation. In this paper, we tackle these issues by building an event-based stereo visual-inertial odometry system on top of a direct pipeline. Specifically, to speed up the mapping operation, we propose an efficient strategy for sampling contour points according to the local dynamics of events. The mapping performance is also improved in terms of structure completeness and local smoothness by merging the temporal stereo and static stereo results. To circumvent the degeneracy of camera pose tracking in recovering the pitch and yaw components of general 6-DoF motion, we introduce IMU measurements as motion priors via pre-integration. To this end, a compact back-end is proposed for continuously updating the IMU bias and predicting the linear velocity, enabling an accurate motion prediction for camera pose tracking. The resulting system scales well with modern high-resolution event cameras and leads to better global positioning accuracy in large-scale outdoor environments. Extensive evaluations on five publicly available datasets featuring different resolutions and scenarios justify the superior performance of the proposed system against five state-of-the-art methods.