Toward General Object-level Mapping from Sparse Views with 3D Diffusion Priors

作者: Ziwei Liao, Binbin Xu, Steven L. Waslander

分类: cs.CV, cs.AI, cs.RO

发布日期: 2024-10-07

备注: Accepted by CoRL 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出GOM,利用3D扩散先验从稀疏视角实现通用物体级地图构建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 物体级地图构建 3D扩散模型 神经辐射场 多视角重建 稀疏视角 姿态估计 形状估计

📋 核心要点

- 传统物体级地图构建方法在部分遮挡和传感器噪声下难以构建完整形状和估计准确姿态,需要密集的观测。

- GOM系统利用3D扩散模型作为形状先验,支持多类别物体,并结合传感器测量进行概率优化,实现姿态和形状的联合估计。

- GOM在稀疏视角下实现了优异的多类别映射性能,并在真实世界基准测试中超越了现有技术水平。

📝 摘要(中文)

本文提出了一种通用的物体级地图构建系统GOM,该系统利用3D扩散模型作为形状先验,支持多类别物体,并为场景中的所有物体输出神经辐射场(NeRFs),用于表示纹理和几何形状。GOM包含一种有效的公式,用于在不进行微调的情况下,利用来自传感器测量的额外非线性约束来引导预训练的扩散模型。此外,还开发了一种概率优化公式,用于融合多视角传感器观测和扩散先验,以实现联合3D物体姿态和形状估计。实验结果表明,GOM系统在稀疏视角下表现出优异的多类别映射性能,并在真实世界基准测试中实现了比现有技术更准确的映射结果。

🔬 方法详解

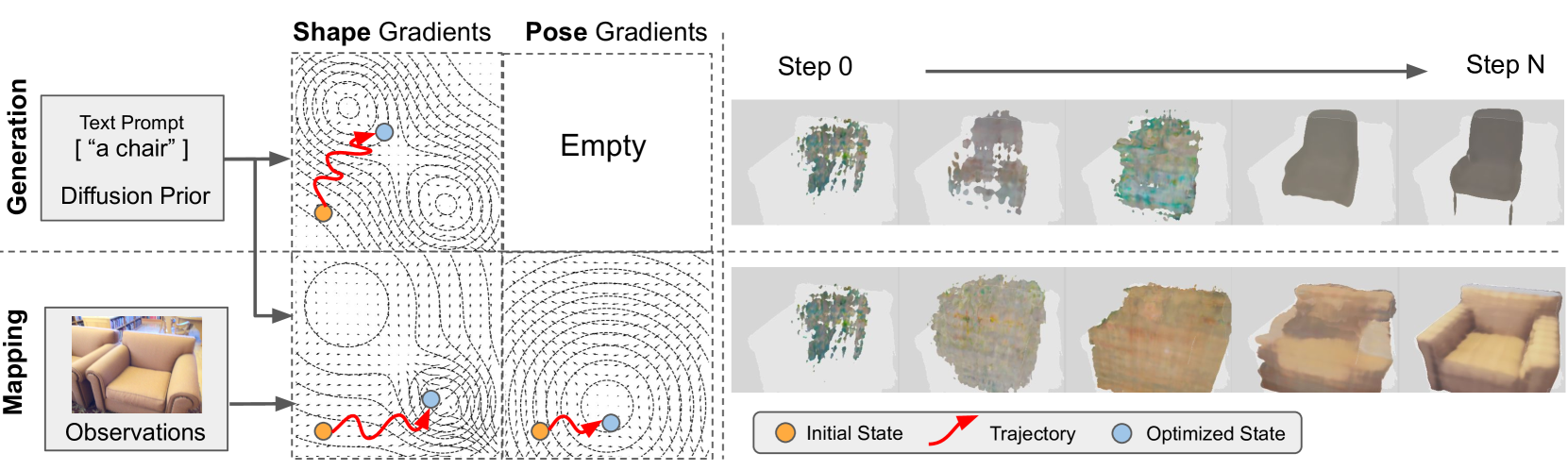

问题定义:物体级地图构建旨在从多视角传感器观测中构建场景中物体的3D地图,包括详细的形状和姿态。现有方法在稀疏视角下,由于部分遮挡和传感器噪声,难以构建完整的形状和估计准确的姿态。它们通常需要密集的观测才能覆盖所有物体,这在机器人轨迹中很难实现。

核心思路:本文的核心思路是利用预训练的3D扩散模型作为形状先验,并将其与多视角传感器观测进行融合,从而在稀疏视角下实现更准确的物体形状和姿态估计。扩散模型能够生成逼真的3D形状,从而弥补稀疏观测带来的信息缺失。

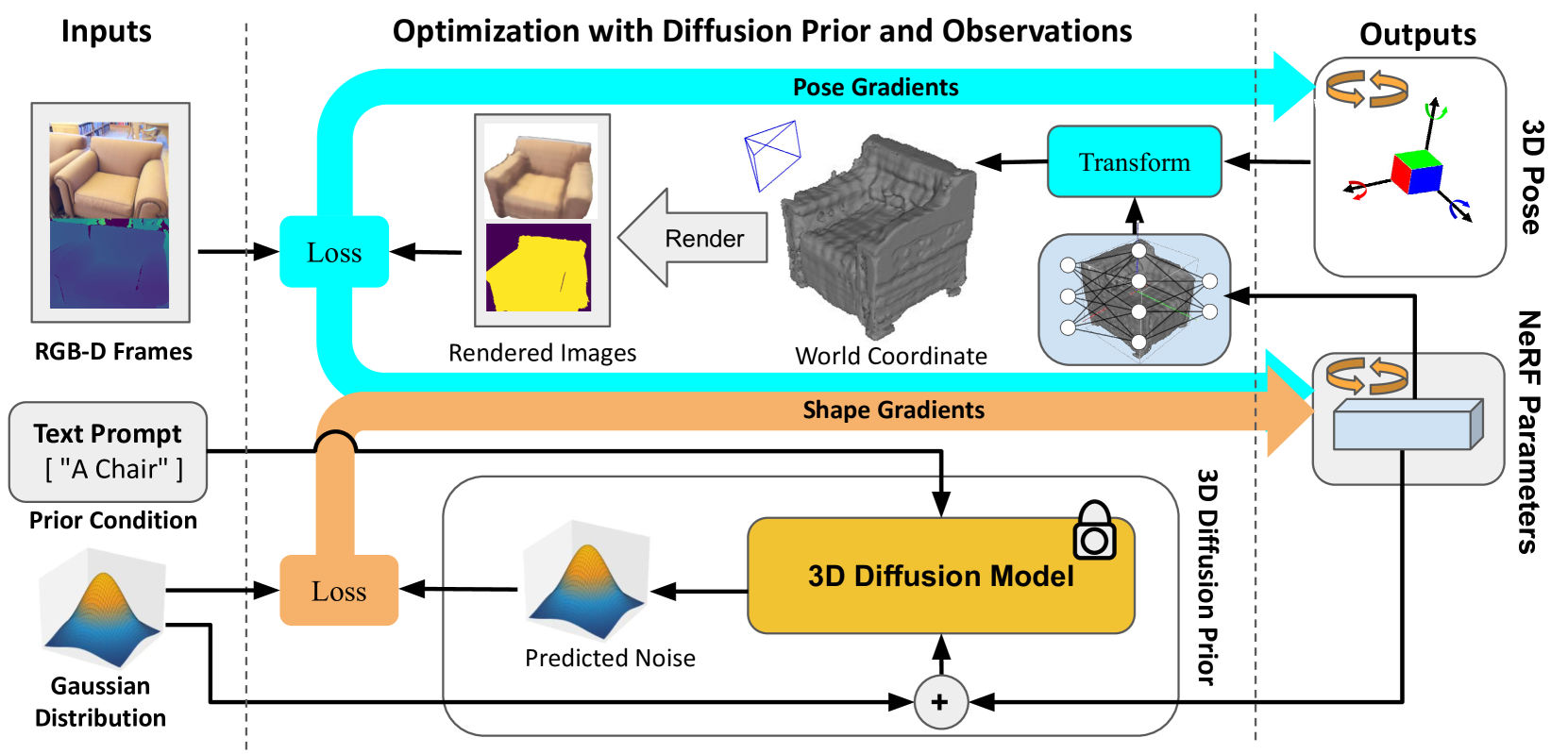

技术框架:GOM系统的整体框架包括以下几个主要模块:1) 传感器数据获取:从多视角传感器获取场景的观测数据。2) 扩散模型引导:利用传感器测量数据,通过一种有效的公式来引导预训练的3D扩散模型,使其生成与观测数据一致的物体形状。3) 概率优化:开发一种概率优化公式,将多视角传感器观测和扩散先验进行融合,从而联合估计物体的3D姿态和形状。4) NeRF重建:利用估计的物体姿态和形状,构建神经辐射场(NeRFs),用于表示物体的纹理和几何形状。

关键创新:GOM的关键创新在于:1) 提出了一种有效的公式,用于在不进行微调的情况下,利用来自传感器测量的额外非线性约束来引导预训练的扩散模型。这使得GOM能够充分利用扩散模型的生成能力,同时保证与观测数据的一致性。2) 开发了一种概率优化公式,将多视角传感器观测和扩散先验进行融合,从而实现联合3D物体姿态和形状估计。这种联合优化能够提高姿态和形状估计的准确性。

关键设计:GOM的关键设计包括:1) 使用预训练的3D扩散模型作为形状先验,该模型能够生成逼真的3D形状。2) 设计了一种非线性约束引导公式,用于将传感器测量数据融入到扩散模型的生成过程中。3) 采用概率优化方法,将多视角传感器观测和扩散先验进行融合,并使用合适的损失函数来优化物体姿态和形状。

🖼️ 关键图片

📊 实验亮点

GOM系统在真实世界基准测试中取得了显著的性能提升。实验结果表明,GOM在稀疏视角下表现出优异的多类别映射性能,并且在物体形状和姿态估计的准确性方面超越了现有技术水平。具体的数据指标和对比结果可以在论文的实验部分找到。

🎯 应用场景

GOM系统在机器人导航、场景理解、增强现实等领域具有广泛的应用前景。例如,在机器人导航中,GOM可以帮助机器人构建场景的3D地图,从而实现更智能的导航。在场景理解中,GOM可以帮助计算机理解场景中的物体及其相互关系。在增强现实中,GOM可以帮助将虚拟物体与真实场景进行融合,从而提供更逼真的增强现实体验。未来,GOM有望推动这些领域的发展。

📄 摘要(原文)

Object-level mapping builds a 3D map of objects in a scene with detailed shapes and poses from multi-view sensor observations. Conventional methods struggle to build complete shapes and estimate accurate poses due to partial occlusions and sensor noise. They require dense observations to cover all objects, which is challenging to achieve in robotics trajectories. Recent work introduces generative shape priors for object-level mapping from sparse views, but is limited to single-category objects. In this work, we propose a General Object-level Mapping system, GOM, which leverages a 3D diffusion model as shape prior with multi-category support and outputs Neural Radiance Fields (NeRFs) for both texture and geometry for all objects in a scene. GOM includes an effective formulation to guide a pre-trained diffusion model with extra nonlinear constraints from sensor measurements without finetuning. We also develop a probabilistic optimization formulation to fuse multi-view sensor observations and diffusion priors for joint 3D object pose and shape estimation. Our GOM system demonstrates superior multi-category mapping performance from sparse views, and achieves more accurate mapping results compared to state-of-the-art methods on the real-world benchmarks. We will release our code: https://github.com/TRAILab/GeneralObjectMapping.