LiDAR-GS:Real-time LiDAR Re-Simulation using Gaussian Splatting

作者: Qifeng Chen, Sheng Yang, Sicong Du, Tao Tang, Rengan Xie, Peng Chen, Yuchi Huo

分类: cs.CV

发布日期: 2024-10-07 (更新: 2025-10-13)

💡 一句话要点

提出LiDAR-GS,利用高斯溅射实现城市道路场景中激光雷达扫描的实时高保真重模拟。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 激光雷达 高斯溅射 实时渲染 三维重建 自动驾驶仿真

📋 核心要点

- 现有方法难以在城市道路场景中实现激光雷达扫描的实时高保真重模拟,尤其是在保持精度和处理激光雷达的独特性方面。

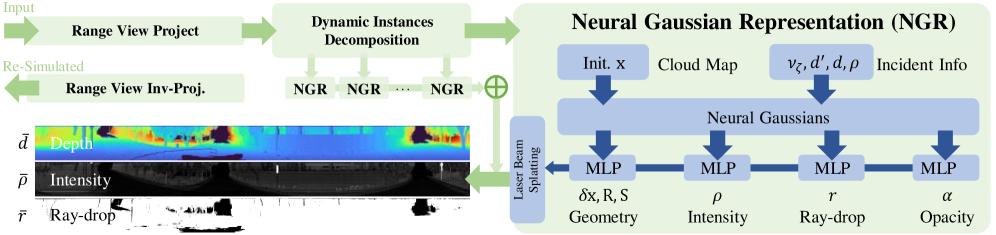

- LiDAR-GS的核心在于设计可微的激光束溅射和利用神经高斯表示,以精确模拟激光雷达的深度、强度和光线丢失等属性。

- 实验结果表明,LiDAR-GS在渲染帧率和质量方面均优于基于显式网格或隐式NeRF的方法,实现了最先进的性能。

📝 摘要(中文)

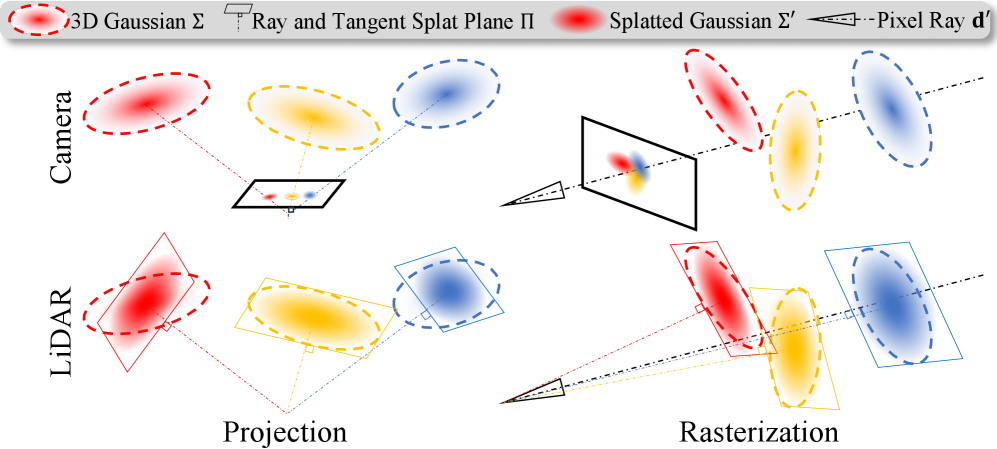

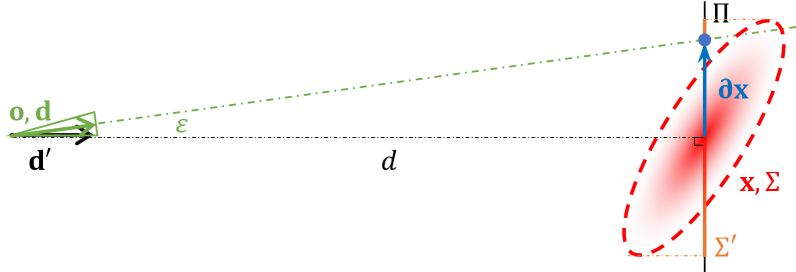

本文提出LiDAR-GS,一种基于高斯溅射(GS)的方法,用于在公共城市道路场景中实时、高保真地重模拟激光雷达扫描。最近针对相机提出的GS方法在实时渲染方面取得了超越神经辐射场(NeRF)的显著进展。然而,将GS表示应用于激光雷达这种主动3D传感器类型,存在一些必须解决的挑战,以保持高精度和独特性。具体来说,LiDAR-GS设计了一种可微的激光束溅射,使用range-view表示通过将激光投射到微横截面上进行精确的表面溅射,有效地消除了与局部仿射近似相关的伪影。此外,LiDAR-GS利用神经高斯表示,进一步整合了视角相关的线索,来表示受入射方向和外部因素影响的关键激光雷达属性。结合这些实践以及一些必要的调整,例如动态实例分解,LiDAR-GS成功地同时重模拟深度、强度和光线丢失通道,与使用显式网格或隐式NeRF的方法相比,在公开的大场景数据集上,在渲染帧率和质量方面都取得了最先进的结果。我们的源代码已在https://www.github.com/cqf7419/LiDAR-GS上公开。

🔬 方法详解

问题定义:论文旨在解决激光雷达数据实时高保真重模拟的问题。现有方法,如基于显式网格或隐式NeRF的方法,在渲染速度或质量上存在瓶颈,难以兼顾实时性和精度,并且难以处理激光雷达数据的特殊性质(例如,光线衰减、反射强度等)。

核心思路:论文的核心思路是将高斯溅射(Gaussian Splatting, GS)技术应用于激光雷达数据的重模拟。GS方法在相机渲染领域已经展现出优异的实时渲染能力和高质量的渲染效果。通过将场景表示为一系列带有属性的高斯球,可以实现快速的渲染和优化。针对激光雷达数据的特点,论文对GS方法进行了改进和适配。

技术框架:LiDAR-GS的整体框架包括以下几个主要步骤:1) 数据预处理:将激光雷达数据转换为range-view表示。2) 高斯初始化:基于预处理后的数据初始化高斯球的参数(位置、协方差、颜色等)。3) 可微激光束溅射:设计可微的激光束溅射操作,将激光束投影到高斯球上,计算每个高斯球对最终渲染结果的贡献。4) 神经高斯表示:利用神经网络学习高斯球的属性,例如反射强度、光线衰减等,以更好地模拟激光雷达数据的特性。5) 渲染:基于高斯球的参数和贡献,渲染出最终的深度、强度和光线丢失图像。6) 优化:通过比较渲染结果和真实数据,优化高斯球的参数和神经网络的权重。

关键创新:论文的关键创新在于:1) 针对激光雷达数据设计了可微的激光束溅射操作,能够精确地模拟激光束与场景表面的交互。2) 提出了神经高斯表示,利用神经网络学习激光雷达数据的特性,例如反射强度、光线衰减等。3) 实现了深度、强度和光线丢失通道的同步重模拟。

关键设计:论文的关键设计包括:1) 使用range-view表示激光雷达数据,方便进行激光束溅射操作。2) 设计了损失函数,用于比较渲染结果和真实数据,包括深度损失、强度损失和光线丢失损失。3) 使用动态实例分解,将场景分解为多个独立的实例,以提高渲染效率。

🖼️ 关键图片

📊 实验亮点

LiDAR-GS在公开数据集上实现了最先进的性能,在渲染帧率和质量方面均优于现有方法。与基于显式网格和隐式NeRF的方法相比,LiDAR-GS能够以更高的帧率生成更高质量的激光雷达扫描重模拟结果,并且能够同时重模拟深度、强度和光线丢失通道。具体性能数据未知。

🎯 应用场景

LiDAR-GS可应用于自动驾驶仿真、机器人导航、三维地图重建等领域。通过实时高保真地重模拟激光雷达扫描,可以为自动驾驶算法的开发和测试提供逼真的环境,降低实际道路测试的成本和风险。此外,该技术还可以用于创建高精度的三维地图,为机器人导航和定位提供支持。

📄 摘要(原文)

We present LiDAR-GS, a Gaussian Splatting (GS) method for real-time, high-fidelity re-simulation of LiDAR scans in public urban road scenes. Recent GS methods proposed for cameras have achieved significant advancements in real-time rendering beyond Neural Radiance Fields (NeRF). However, applying GS representation to LiDAR, an active 3D sensor type, poses several challenges that must be addressed to preserve high accuracy and unique characteristics. Specifically, LiDAR-GS designs a differentiable laser beam splatting, using range-view representation for precise surface splatting by projecting lasers onto micro cross-sections, effectively eliminating artifacts associated with local affine approximations. Furthermore, LiDAR-GS leverages Neural Gaussian Representation, which further integrate view-dependent clues, to represent key LiDAR properties that are influenced by the incident direction and external factors. Combining these practices with some essential adaptations, e.g., dynamic instances decomposition, LiDAR-GS succeeds in simultaneously re-simulating depth, intensity, and ray-drop channels, achieving state-of-the-art results in both rendering frame rate and quality on publically available large scene datasets when compared with the methods using explicit mesh or implicit NeRF. Our source code is publicly available at https://www.github.com/cqf7419/LiDAR-GS.