D-PoSE: Depth as an Intermediate Representation for 3D Human Pose and Shape Estimation

作者: Nikolaos Vasilikopoulos, Drosakis Drosakis, Antonis Argyros

分类: cs.CV

发布日期: 2024-10-07

🔗 代码/项目: GITHUB

💡 一句话要点

D-PoSE:利用深度图作为中间表示进行3D人体姿态和形状估计

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 3D人体姿态估计 3D人体形状估计 深度图 中间表示 深度监督 单阶段方法 SMPL-X 计算机视觉

📋 核心要点

- 现有方法依赖大型Transformer模型提升人体姿态和形状估计精度,但计算成本高昂。

- D-PoSE利用深度图作为中间表示,通过深度监督学习,提升姿态和形状估计的准确性。

- 实验表明,D-PoSE在真实数据集上取得了SOTA性能,且模型参数量远小于ViT模型。

📝 摘要(中文)

本文提出了一种名为D-PoSE(Depth as an Intermediate Representation for 3D Human Pose and Shape Estimation)的单阶段方法,用于从单张RGB图像中估计人体姿态和SMPL-X形状参数。为了提高人体姿态和形状(HPS)基准测试的准确性,最近的研究工作使用了更大的模型,包括Transformer骨干网络和解码器。D-PoSE提出了一种基于视觉的方法,该方法使用估计的人体深度图作为HPS的中间表示,并利用合成数据及其提供的真实深度图进行训练,以实现训练期间的深度监督。尽管D-PoSE是在合成数据集上训练的,但它在真实世界的基准数据集EMDB和3DPW上实现了最先进的性能。尽管其设计简单轻量,并且使用CNN骨干网络,但其性能优于参数数量几乎大一个数量级的基于ViT的模型。D-PoSE代码可在https://github.com/nvasilik/D-PoSE 获取。

🔬 方法详解

问题定义:现有3D人体姿态和形状估计方法通常依赖于大型Transformer模型以获得更高的精度,但这些模型计算成本高,参数量大,难以部署。此外,直接从RGB图像回归3D人体参数是一个具有挑战性的问题,缺乏有效的中间表示来指导学习过程。

核心思路:D-PoSE的核心思想是将深度图作为3D人体姿态和形状估计的中间表示。通过预测深度图,模型可以学习到更丰富的3D几何信息,从而更好地估计人体姿态和形状。利用合成数据提供的深度图进行监督训练,可以有效提升模型在真实场景下的泛化能力。

技术框架:D-PoSE是一个单阶段的框架,输入为单张RGB图像,输出为3D人体姿态和SMPL-X形状参数。该框架主要包含以下几个模块:1) CNN骨干网络:用于提取图像特征。2) 深度图预测模块:将提取的特征映射到深度图。3) 姿态和形状估计模块:从深度图回归SMPL-X参数。整个框架采用端到端的方式进行训练。

关键创新:D-PoSE的关键创新在于将深度图作为中间表示,并利用深度监督进行训练。这种方法有效地利用了合成数据提供的深度信息,提升了模型在真实场景下的性能。此外,D-PoSE采用轻量级的CNN骨干网络,在保证性能的同时,降低了计算成本。

关键设计:D-PoSE使用L1损失函数来监督深度图的预测。对于姿态和形状估计,使用标准的SMPL-X参数回归损失函数。网络结构方面,深度图预测模块采用U-Net结构,以更好地捕捉图像的上下文信息。为了进一步提升性能,D-PoSE还使用了对抗训练,以减小合成数据和真实数据之间的差距。

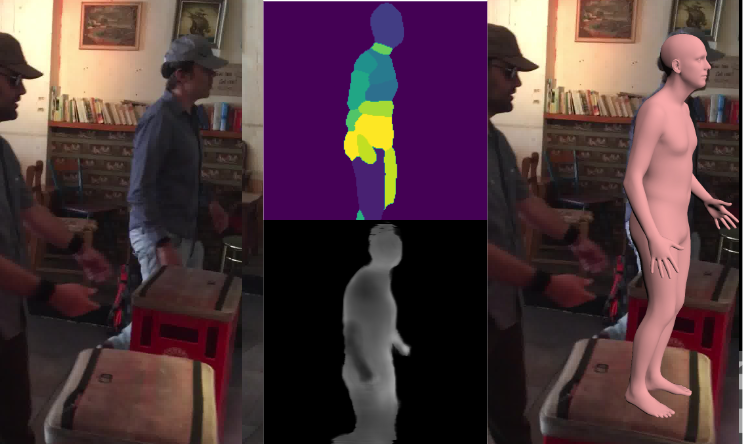

🖼️ 关键图片

📊 实验亮点

D-PoSE在EMDB和3DPW等真实世界数据集上取得了state-of-the-art的性能。值得注意的是,D-PoSE使用轻量级的CNN骨干网络,其参数量远小于基于ViT的模型,但性能却优于这些模型。这表明D-PoSE提出的深度图中间表示方法是有效的,可以在降低计算成本的同时,提升3D人体姿态和形状估计的准确性。

🎯 应用场景

D-PoSE在人机交互、虚拟现实、增强现实、运动分析、游戏等领域具有广泛的应用前景。例如,可以用于实时捕捉用户的3D姿态,实现自然的人机交互;也可以用于虚拟试衣,让用户在虚拟环境中体验服装的穿着效果。此外,D-PoSE还可以应用于运动分析,帮助运动员提高训练效率。

📄 摘要(原文)

We present D-PoSE (Depth as an Intermediate Representation for 3D Human Pose and Shape Estimation), a one-stage method that estimates human pose and SMPL-X shape parameters from a single RGB image. Recent works use larger models with transformer backbones and decoders to improve the accuracy in human pose and shape (HPS) benchmarks. D-PoSE proposes a vision based approach that uses the estimated human depth-maps as an intermediate representation for HPS and leverages training with synthetic data and the ground-truth depth-maps provided with them for depth supervision during training. Although trained on synthetic datasets, D-PoSE achieves state-of-the-art performance on the real-world benchmark datasets, EMDB and 3DPW. Despite its simple lightweight design and the CNN backbone, it outperforms ViT-based models that have a number of parameters that is larger by almost an order of magnitude. D-PoSE code is available at: https://github.com/nvasilik/D-PoSE