CAPEEN: Image Captioning with Early Exits and Knowledge Distillation

作者: Divya Jyoti Bajpai, Manjesh Kumar Hanawal

分类: cs.CV, cs.AI, cs.CL

发布日期: 2024-10-06

备注: To appear in EMNLP (finding) 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出CAPEEN,利用早退机制和知识蒸馏加速图像描述生成并提升鲁棒性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图像描述 早退机制 知识蒸馏 模型加速 自适应阈值

📋 核心要点

- 现有图像描述模型计算量大、推理延迟高,难以满足实际应用需求。

- CAPEEN利用早退机制,在中间层完成推理,并通过知识蒸馏提升早退层的性能。

- A-CAPEEN使用多臂老虎机动态调整早退阈值,增强模型对数据分布变化的适应性。

📝 摘要(中文)

深度神经网络在图像描述任务中取得了显著进展,但在提升性能的同时也增加了计算负担和推理延迟。早退(EE)策略可以提高效率,但将其应用于图像描述任务面临挑战,因为准确的预测需要不同层次的语义信息。为了解决这个问题,我们提出了CAPEEN,利用知识蒸馏来提升EE策略的性能。CAPEEN的推理过程在中间层完成,如果预测置信度超过了从训练数据中学习到的预定义值。为了适应真实世界的部署,其中目标分布可能偏离训练样本,我们引入了一种变体A-CAPEEN,使用多臂老虎机框架动态调整阈值。在MS COCO和Flickr30k数据集上的实验表明,CAPEEN在保持与最终层相比具有竞争力的性能的同时,获得了1.77倍的加速,而A-CAPEEN还提供了针对失真的鲁棒性。源代码可在https://github.com/Div290/CapEEN 获取。

🔬 方法详解

问题定义:图像描述任务中,深度神经网络模型虽然精度高,但计算复杂度也高,推理速度慢,难以满足实时性要求。现有的早退机制在图像描述任务中应用效果不佳,因为不同图像需要不同层次的语义信息才能生成准确的描述,固定阈值难以适应这种变化。

核心思路:CAPEEN的核心思路是利用早退机制加速推理过程,并在早退层引入知识蒸馏,以弥补早退带来的精度损失。通过学习合适的早退阈值,使得模型能够在保证精度的前提下,尽可能早地完成推理。此外,为了应对真实场景中数据分布的变化,引入了自适应阈值调整机制。

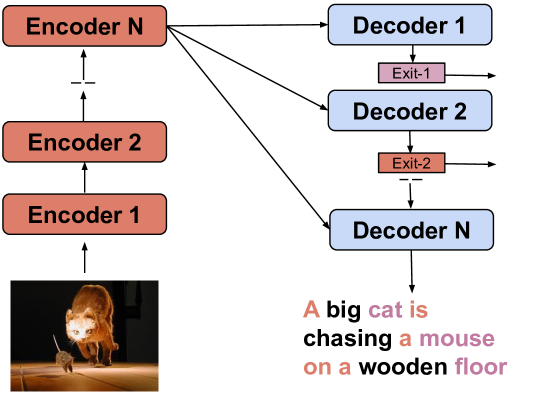

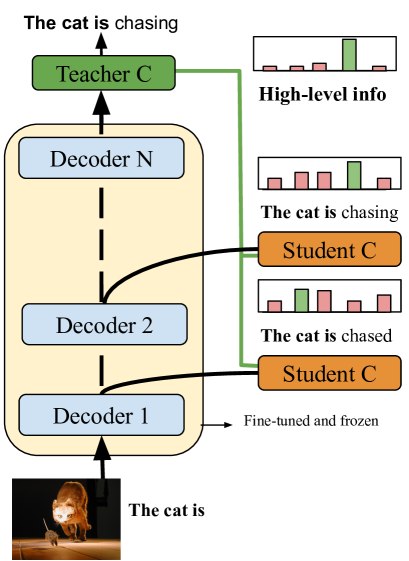

技术框架:CAPEEN的整体框架包括一个图像编码器和一个文本解码器,以及多个中间层。每个中间层都配备一个早退分支,用于预测图像描述。在训练阶段,使用知识蒸馏,将最终层的知识传递给早退层。在推理阶段,如果某个中间层的预测置信度超过了预定义的阈值,则提前退出推理过程。A-CAPEEN在此基础上,使用多臂老虎机框架动态调整早退阈值。

关键创新:CAPEEN的关键创新在于将早退机制、知识蒸馏和自适应阈值调整相结合,应用于图像描述任务。与传统的早退方法相比,CAPEEN能够更好地平衡推理速度和精度。A-CAPEEN通过动态调整阈值,提高了模型对数据分布变化的鲁棒性。

关键设计:CAPEEN的关键设计包括:1) 使用交叉熵损失函数训练图像描述模型;2) 使用KL散度损失函数进行知识蒸馏,将最终层的预测分布作为教师信号,指导早退层的学习;3) 使用多臂老虎机框架动态调整早退阈值,根据模型的性能反馈,选择最优的阈值。

🖼️ 关键图片

📊 实验亮点

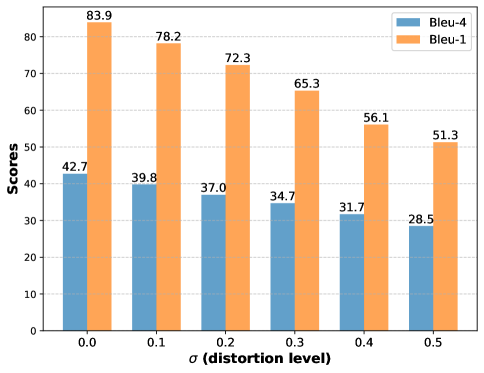

实验结果表明,CAPEEN在MS COCO和Flickr30k数据集上实现了1.77倍的推理加速,同时保持了与最终层相比具有竞争力的性能。A-CAPEEN通过动态调整阈值,进一步提高了模型对图像失真的鲁棒性,在失真图像上的性能优于CAPEEN。

🎯 应用场景

CAPEEN可应用于各种需要实时图像描述的场景,例如智能监控、机器人导航、图像搜索等。通过加速推理过程,CAPEEN可以降低计算成本,提高用户体验。自适应阈值调整机制使得CAPEEN能够更好地适应真实世界的复杂环境,具有广泛的应用前景。

📄 摘要(原文)

Deep neural networks (DNNs) have made significant progress in recognizing visual elements and generating descriptive text in image-captioning tasks. However, their improved performance comes from increased computational burden and inference latency. Early Exit (EE) strategies can be used to enhance their efficiency, but their adaptation presents challenges in image captioning as it requires varying levels of semantic information for accurate predictions. To overcome this, we introduce CAPEEN to improve the performance of EE strategies using knowledge distillation. Inference in CAPEEN is completed at intermediary layers if prediction confidence exceeds a predefined value learned from the training data. To account for real-world deployments, where target distributions could drift from that of training samples, we introduce a variant A-CAPEEN to adapt the thresholds on the fly using Multiarmed bandits framework. Experiments on the MS COCO and Flickr30k datasets show that CAPEEN gains speedup of 1.77x while maintaining competitive performance compared to the final layer, and A-CAPEEN additionally offers robustness against distortions. The source code is available at https://github.com/Div290/CapEEN