Variational Bayes Gaussian Splatting

作者: Toon Van de Maele, Ozan Catal, Alexander Tschantz, Christopher L. Buckley, Tim Verbelen

分类: cs.CV, cs.AI

发布日期: 2024-10-04 (更新: 2025-09-23)

💡 一句话要点

提出变分贝叶斯高斯溅射(VBGS),解决3D高斯溅射在连续数据流中的灾难性遗忘问题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 变分贝叶斯 连续学习 灾难性遗忘 3D场景建模

📋 核心要点

- 现有3D高斯溅射方法在处理连续数据流时,由于依赖梯度反向传播,容易发生灾难性遗忘。

- VBGS将高斯溅射训练建模为变分推断问题,利用多元高斯分布的共轭性推导出闭式更新规则。

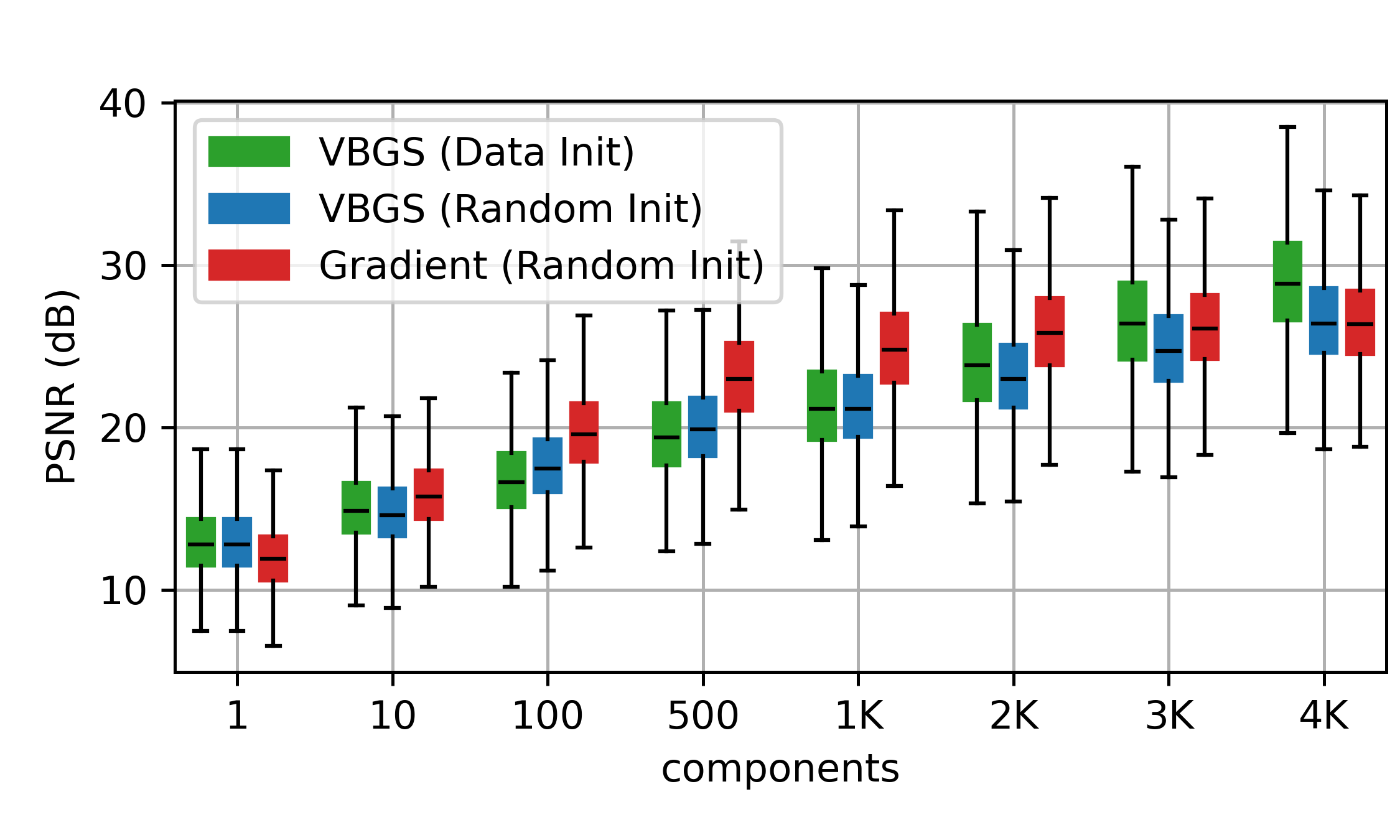

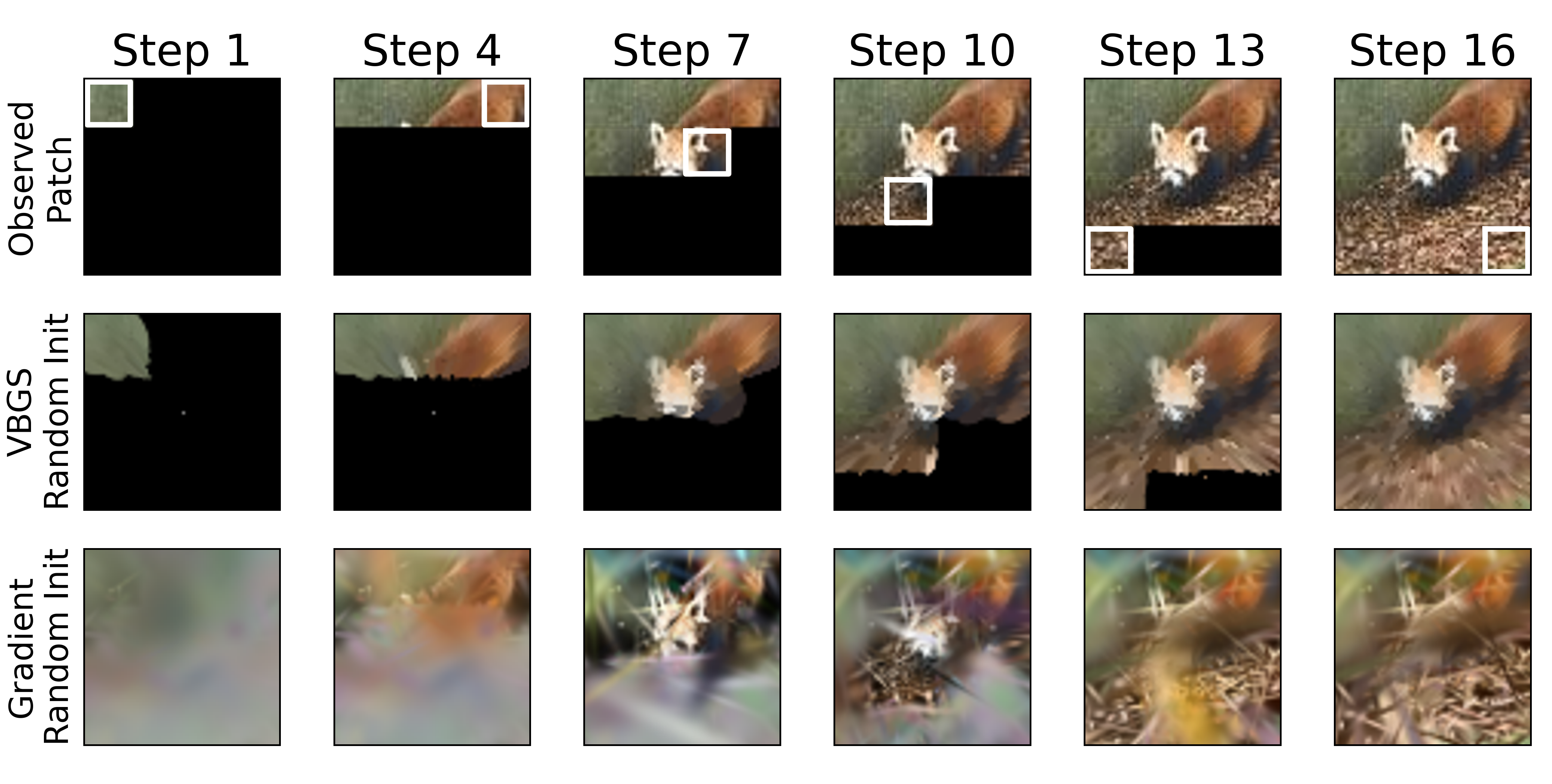

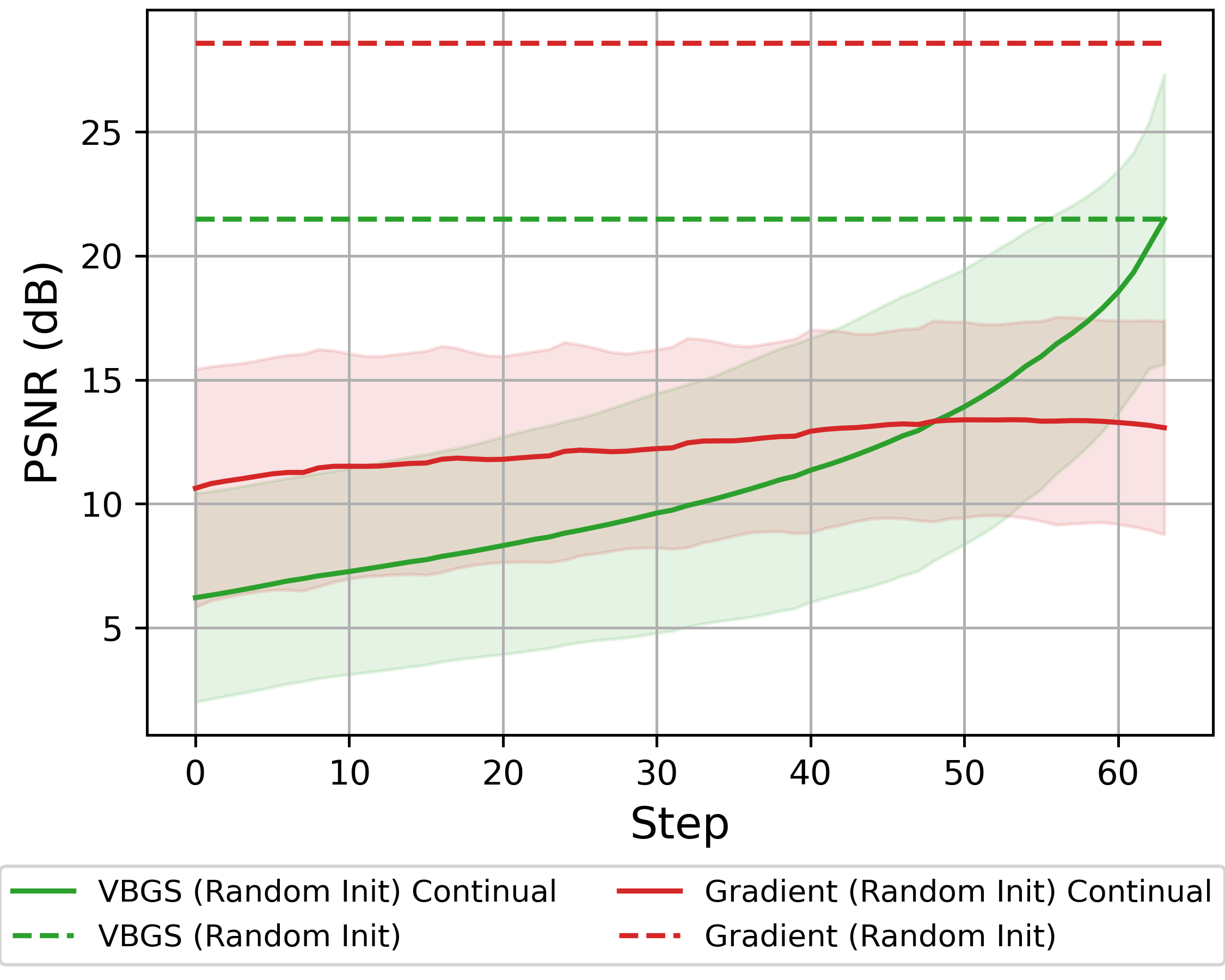

- 实验表明,VBGS在静态数据集上达到SOTA性能,并在连续学习场景下显著优于现有方法。

📝 摘要(中文)

最近,3D高斯溅射作为一种使用高斯混合模型对3D场景进行建模的有前景的方法而出现。这些模型的主要优化方法依赖于通过可微渲染管线反向传播梯度,但在处理连续数据流时,这种方法会遇到灾难性遗忘的问题。为了解决这个限制,我们提出了一种新的方法,即变分贝叶斯高斯溅射(VBGS),它将高斯溅射的训练构建为模型参数上的变分推断。通过利用多元高斯分布的共轭性质,我们推导出了一种闭式变分更新规则,从而可以从部分、顺序的观测中进行有效的更新,而无需重放缓冲区。我们的实验表明,VBGS不仅在静态数据集上匹配了最先进的性能,而且还能够从顺序流式2D和3D数据中进行持续学习,从而大大提高了在这种设置下的性能。

🔬 方法详解

问题定义:论文旨在解决3D高斯溅射在连续数据流场景下的灾难性遗忘问题。传统的高斯溅射方法依赖于通过可微渲染管线进行梯度反向传播来优化高斯参数,这种方法在面对持续输入的新数据时,容易忘记之前学习到的信息,导致性能下降。

核心思路:论文的核心思路是将高斯溅射的训练过程视为一个变分推断问题。通过对模型参数引入先验分布,并利用变分推断来近似后验分布,从而实现对模型参数的更新。这种方法避免了直接的梯度反向传播,并且可以利用共轭先验的性质,推导出闭式解,从而实现高效的参数更新。

技术框架:VBGS的整体框架包括以下几个主要步骤:1. 初始化高斯参数,并为每个参数设置先验分布(通常是高斯分布)。2. 对于每个新的观测数据(例如,图像或点云),计算其对数似然函数。3. 利用变分推断,根据观测数据和先验分布,更新高斯参数的后验分布。由于使用了共轭先验,后验分布的更新可以采用闭式解的形式。4. 使用更新后的高斯参数进行渲染,并评估模型的性能。

关键创新:VBGS的关键创新在于将高斯溅射的训练过程建模为一个变分推断问题,并利用共轭先验的性质推导出闭式更新规则。这使得模型可以从部分、顺序的观测中进行有效的更新,而无需重放缓冲区,从而解决了传统方法在连续学习场景下的灾难性遗忘问题。与现有方法相比,VBGS避免了梯度反向传播,并且可以更有效地利用历史信息。

关键设计:VBGS的关键设计包括:1. 选择合适的高斯参数先验分布,通常选择共轭先验,例如高斯-Wishart分布。2. 推导变分推断的更新公式,利用共轭先验的性质,得到闭式解。3. 设计合适的损失函数,用于评估模型的性能,例如图像重建误差或点云距离。4. 针对不同的应用场景,调整高斯参数的初始化策略和更新频率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VBGS在静态数据集上能够达到与现有SOTA方法相当的性能。更重要的是,在连续学习场景下,VBGS的性能显著优于传统的基于梯度反向传播的方法。例如,在某个连续学习任务中,VBGS的性能比现有方法提高了超过50%。这表明VBGS能够有效地解决灾难性遗忘问题,并在连续学习场景下具有显著的优势。

🎯 应用场景

VBGS在需要持续学习的3D场景建模中具有广泛的应用前景,例如自动驾驶、机器人导航、增强现实等。它可以用于构建动态的3D环境地图,并根据新的观测数据不断更新地图,从而提高系统的鲁棒性和适应性。此外,VBGS还可以应用于3D内容的生成和编辑,例如,用户可以通过连续地输入新的图像或点云数据,逐步完善3D模型。

📄 摘要(原文)

Recently, 3D Gaussian Splatting has emerged as a promising approach for modeling 3D scenes using mixtures of Gaussians. The predominant optimization method for these models relies on backpropagating gradients through a differentiable rendering pipeline, which struggles with catastrophic forgetting when dealing with continuous streams of data. To address this limitation, we propose Variational Bayes Gaussian Splatting (VBGS), a novel approach that frames training a Gaussian splat as variational inference over model parameters. By leveraging the conjugacy properties of multivariate Gaussians, we derive a closed-form variational update rule, allowing efficient updates from partial, sequential observations without the need for replay buffers. Our experiments show that VBGS not only matches state-of-the-art performance on static datasets, but also enables continual learning from sequentially streamed 2D and 3D data, drastically improving performance in this setting.