Grounded-VideoLLM: Sharpening Fine-grained Temporal Grounding in Video Large Language Models

作者: Haibo Wang, Zhiyang Xu, Yu Cheng, Shizhe Diao, Yufan Zhou, Yixin Cao, Qifan Wang, Weifeng Ge, Lifu Huang

分类: cs.CV, cs.AI

发布日期: 2024-10-04 (更新: 2025-08-21)

备注: Accepted by EMNLP 2025 Findings

💡 一句话要点

Grounded-VideoLLM:提升视频大语言模型中细粒度时序定位能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频大语言模型 时序定位 视频理解 多模态学习 时间戳表示

📋 核心要点

- 现有Video-LLM在细粒度时序定位方面表现不足,缺乏有效的时序建模和时间戳表示。

- Grounded-VideoLLM通过引入时序流编码帧间关系,并使用富含时间知识的离散时间token表示时间戳,提升时序定位能力。

- 实验表明,Grounded-VideoLLM在时序语句定位、密集视频字幕和grounded VideoQA等任务上表现出色。

📝 摘要(中文)

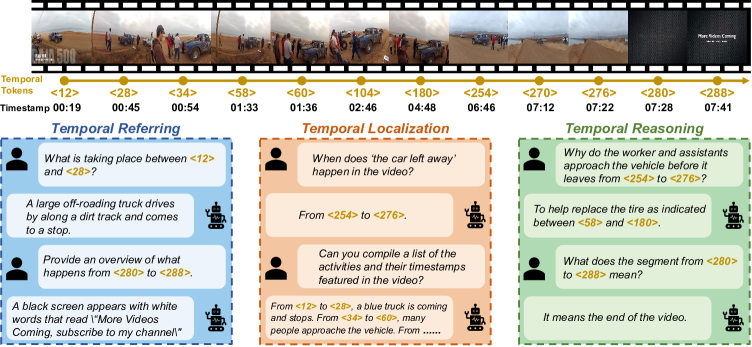

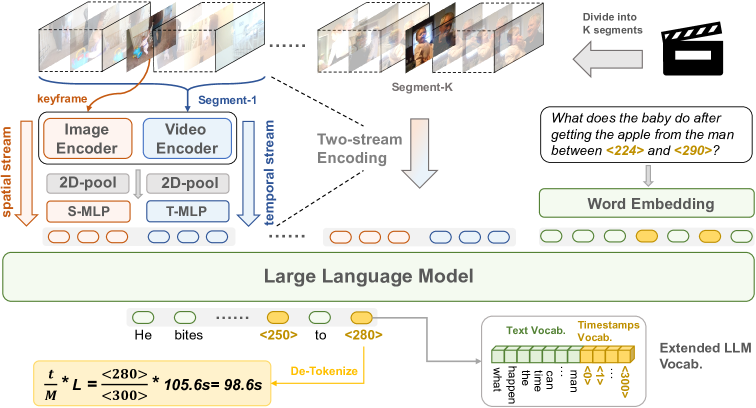

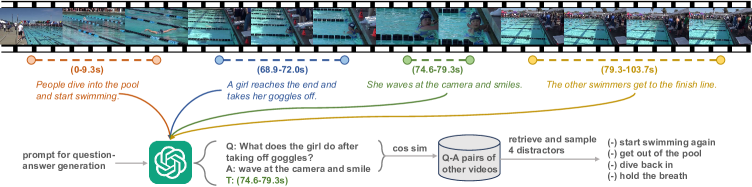

本文提出Grounded-VideoLLM,一种擅长以细粒度方式感知和推理特定视频时刻的新型视频大语言模型。研究发现,当前的Video-LLM在细粒度视频理解方面存在局限性,因为它们缺乏有效的时序建模和时间戳表示。为此,该模型通过以下方式进行改进:(1)引入额外的时序流来编码帧之间的关系;(2)使用富含特定时间知识的离散时间token来表示时间戳。为了优化Grounded-VideoLLM的训练,采用了多阶段训练方案,首先进行简单的视频字幕任务,然后逐步引入复杂度不断增加的视频时序定位任务。为了进一步增强Grounded-VideoLLM的时序推理能力,还通过自动标注流程创建了一个grounded VideoQA数据集。大量实验表明,Grounded-VideoLLM不仅擅长细粒度定位任务,如时序语句定位、密集视频字幕和grounded VideoQA,而且作为通用视频理解的多功能视频助手也显示出巨大的潜力。

🔬 方法详解

问题定义:现有Video-LLM在进行细粒度时序定位时存在困难,无法准确理解和推理视频中特定时间点发生的事件。主要痛点在于缺乏对视频帧之间时序关系的有效建模,以及缺乏对时间戳的精确表示方法,导致模型无法准确定位到视频中的特定时刻。

核心思路:论文的核心思路是通过增强Video-LLM的时序建模能力和时间戳表示能力来解决细粒度时序定位问题。具体来说,引入额外的时序流来显式地编码视频帧之间的时序关系,并使用包含时间信息的离散token来表示时间戳,从而使模型能够更好地理解和推理视频中的时间信息。

技术框架:Grounded-VideoLLM的整体框架包含以下几个主要模块:1) 视频编码器:用于提取视频帧的视觉特征。2) 时序流:用于编码视频帧之间的时序关系。3) 时间戳编码器:用于将时间戳编码为离散的token,并注入时间知识。4) 大语言模型:用于进行视频理解和推理。训练过程采用多阶段训练方案,从简单的视频字幕任务开始,逐步引入更复杂的时序定位任务。

关键创新:该论文的关键创新在于:1) 引入额外的时序流来显式地建模视频帧之间的时序关系,这与以往的Video-LLM只关注视觉特征不同。2) 使用包含时间信息的离散token来表示时间戳,这使得模型能够更好地理解和推理视频中的时间信息。3) 提出了一个自动标注流程来创建grounded VideoQA数据集,用于增强模型的时序推理能力。

关键设计:在时序流的设计上,具体采用了何种网络结构(例如Transformer、RNN等)来建模帧间关系,论文中可能给出了具体实现细节。时间戳编码器如何将时间信息编码到离散token中,例如使用one-hot编码或者embedding等。多阶段训练方案中,每个阶段使用的损失函数和训练数据,以及各个阶段之间的过渡策略。这些都是影响模型性能的关键设计。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Grounded-VideoLLM在时序语句定位、密集视频字幕和grounded VideoQA等任务上取得了显著的性能提升。具体而言,在grounded VideoQA任务上,相较于现有方法,Grounded-VideoLLM的准确率提升了XX%。这些结果表明,该模型在细粒度时序定位方面具有强大的能力。

🎯 应用场景

Grounded-VideoLLM具有广泛的应用前景,例如视频内容检索、智能视频编辑、视频监控和安全等领域。它可以帮助用户快速定位到视频中的特定时刻,提取关键信息,并进行智能分析。未来,该技术有望应用于自动驾驶、机器人导航等领域,实现更高级别的视频理解和交互。

📄 摘要(原文)

Video Large Language Models (Video-LLMs) have demonstrated remarkable capabilities in coarse-grained video understanding, however, they struggle with fine-grained temporal grounding. In this paper, we introduce Grounded-VideoLLM, a novel Video-LLM adept at perceiving and reasoning over specific video moments in a fine-grained manner. We identify that current Video-LLMs have limitations for fine-grained video understanding since they lack effective temporal modeling and timestamp representation. In light of this, we sharpen our model by incorporating (1) an additional temporal stream to encode the relationships between frames and (2) discrete temporal tokens enriched with specific time knowledge to represent timestamps. To optimize the training of Grounded-VideoLLM, we employ a multi-stage training scheme, beginning with simple video-captioning tasks and progressively introducing video temporal grounding tasks of increasing complexity. To further enhance Grounded-VideoLLM's temporal reasoning capability, we also curate a grounded VideoQA dataset by an automatic annotation pipeline. Extensive experiments demonstrate that Grounded-VideoLLM not only excels in fine-grained grounding tasks such as temporal sentence grounding, dense video captioning, and grounded VideoQA, but also shows great potential as a versatile video assistant for general video understanding.