Parameter Competition Balancing for Model Merging

作者: Guodong Du, Junlin Lee, Jing Li, Runhua Jiang, Yifei Guo, Shuyang Yu, Hanting Liu, Sim Kuan Goh, Ho-Kin Tang, Daojing He, Min Zhang

分类: cs.CV, cs.AI, cs.CL, cs.LG

发布日期: 2024-10-03

备注: Accepted by NeurIPS2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出PCB-Merging,通过参数竞争平衡实现高效的模型融合,提升多任务性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 模型融合 参数竞争平衡 多任务学习 跨领域迁移 模型集成

📋 核心要点

- 现有模型融合方法难以有效平衡参数竞争,尤其是在任务间存在冲突和复杂关联时。

- PCB-Merging通过内部和外部平衡策略,评估参数重要性和相似性,从而调整参数系数。

- 实验表明,PCB-Merging在多种场景下显著提升了模型融合性能,优于现有方法。

📝 摘要(中文)

本文提出了一种名为PCB-Merging(参数竞争平衡)的创新技术,用于有效模型融合,无需额外训练。该方法通过调整每个参数的系数来解决模型融合中潜在的冲突和复杂的任务间关联,尤其是在参数层面的调整。PCB-Merging采用内部平衡来评估单个任务中参数的重要性,并采用外部平衡来评估不同任务之间参数的相似性。丢弃低重要性分数的参数,并重新调整剩余参数的尺度,形成最终的融合模型。在包括跨任务、跨领域和跨训练配置以及域外泛化等多种融合场景中评估了该方法。实验结果表明,该方法在多种模态、领域、模型大小、任务数量、微调形式和大型语言模型上实现了显著的性能提升,优于现有的模型融合方法。

🔬 方法详解

问题定义:模型融合旨在将多个在不同任务上微调的模型集成到一个模型中,以实现多任务能力,而无需在原始数据集上重新训练。然而,现有方法在处理任务间的潜在冲突和复杂关联方面存在不足,尤其是在参数层面的调整上,导致参数竞争失衡,影响融合效果。

核心思路:PCB-Merging的核心思路是通过参数竞争平衡来优化模型融合过程。它认为不同任务对模型参数的需求存在差异,直接平均或加权融合可能导致性能下降。因此,PCB-Merging旨在识别并保留对多个任务都重要的参数,同时抑制或消除冲突参数的影响。

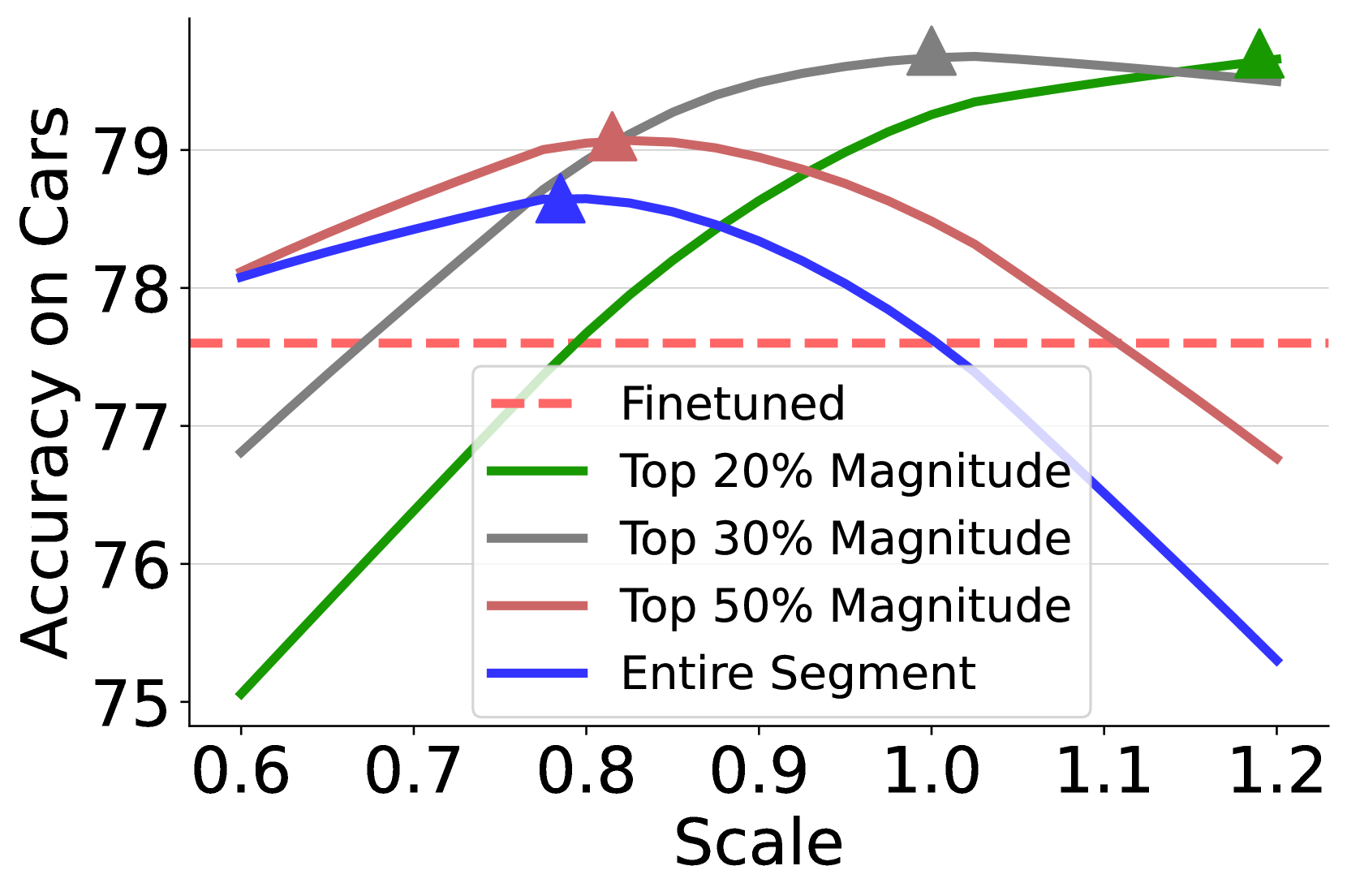

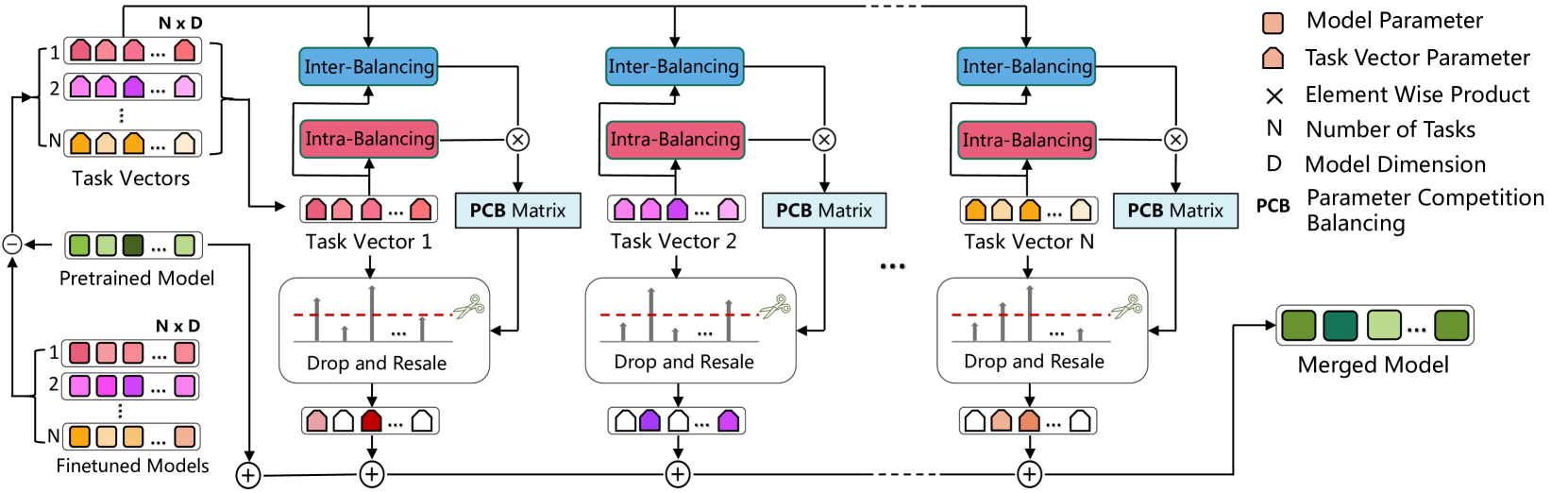

技术框架:PCB-Merging是一个轻量级的、无需训练的技术,主要包含两个阶段:内部平衡(Intra-balancing)和外部平衡(Inter-balancing)。首先,内部平衡评估每个任务中参数的重要性。然后,外部平衡评估不同任务之间参数的相似性。基于这两个评估结果,丢弃低重要性分数的参数,并重新调整剩余参数的尺度,最终得到融合模型。

关键创新:PCB-Merging的关键创新在于其参数竞争平衡机制。与传统的模型融合方法不同,PCB-Merging不是简单地平均或加权融合参数,而是根据参数在不同任务中的重要性和相似性进行自适应调整。这种方法能够更好地处理任务间的冲突和关联,从而提高融合模型的性能。

关键设计:PCB-Merging的关键设计包括:1) 使用某种度量(具体度量方式未知)来评估参数在单个任务中的重要性;2) 使用某种相似性度量(具体度量方式未知)来评估参数在不同任务之间的相似性;3) 基于重要性和相似性得分,设置阈值来丢弃不重要的参数;4) 使用某种重缩放策略(具体策略未知)来调整剩余参数的尺度。这些设计共同作用,实现了参数竞争的有效平衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PCB-Merging在多种融合场景下均取得了显著的性能提升。例如,在跨任务融合场景中,PCB-Merging优于现有的模型融合方法。此外,PCB-Merging还在跨领域融合、跨训练配置以及域外泛化等方面表现出色,证明了其通用性和有效性。具体性能提升数据在论文中给出,此处省略。

🎯 应用场景

PCB-Merging可广泛应用于多任务学习、跨领域知识迁移、以及模型压缩等领域。例如,可以将多个在不同领域数据上微调的模型融合为一个通用模型,提高模型在各种场景下的适应性。此外,该方法还可以用于模型蒸馏,将多个模型的知识融合到一个更小的模型中,实现模型压缩和加速。

📄 摘要(原文)

While fine-tuning pretrained models has become common practice, these models often underperform outside their specific domains. Recently developed model merging techniques enable the direct integration of multiple models, each fine-tuned for distinct tasks, into a single model. This strategy promotes multitasking capabilities without requiring retraining on the original datasets. However, existing methods fall short in addressing potential conflicts and complex correlations between tasks, especially in parameter-level adjustments, posing a challenge in effectively balancing parameter competition across various tasks. This paper introduces an innovative technique named PCB-Merging (Parameter Competition Balancing), a lightweight and training-free technique that adjusts the coefficients of each parameter for effective model merging. PCB-Merging employs intra-balancing to gauge parameter significance within individual tasks and inter-balancing to assess parameter similarities across different tasks. Parameters with low importance scores are dropped, and the remaining ones are rescaled to form the final merged model. We assessed our approach in diverse merging scenarios, including cross-task, cross-domain, and cross-training configurations, as well as out-of-domain generalization. The experimental results reveal that our approach achieves substantial performance enhancements across multiple modalities, domains, model sizes, number of tasks, fine-tuning forms, and large language models, outperforming existing model merging methods. The code is publicly available at: \url{https://github.com/duguodong7/pcb-merging}.