A Comprehensive Survey of Mamba Architectures for Medical Image Analysis: Classification, Segmentation, Restoration and Beyond

作者: Shubhi Bansal, Sreeharish A, Madhava Prasath J, Manikandan S, Sreekanth Madisetty, Mohammad Zia Ur Rehman, Chandravardhan Singh Raghaw, Gaurav Duggal, Nagendra Kumar

分类: cs.CV, cs.AI

发布日期: 2024-10-03 (更新: 2025-10-10)

💡 一句话要点

综述Mamba架构在医学图像分析中的应用:分类、分割、重建及其他

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Mamba架构 医学图像分析 状态空间模型 深度学习 长程依赖 图像分割 图像分类

📋 核心要点

- Transformer在医学图像分析中面临计算复杂度和长程依赖处理的挑战,限制了其在大规模数据集上的应用。

- Mamba通过线性时间复杂度和状态空间模型,有效处理长序列依赖,降低计算成本,提升推理速度。

- Mamba在医学图像分类、分割、重建等任务中表现出潜力,并能有效融合多模态数据,改善诊断效果。

📝 摘要(中文)

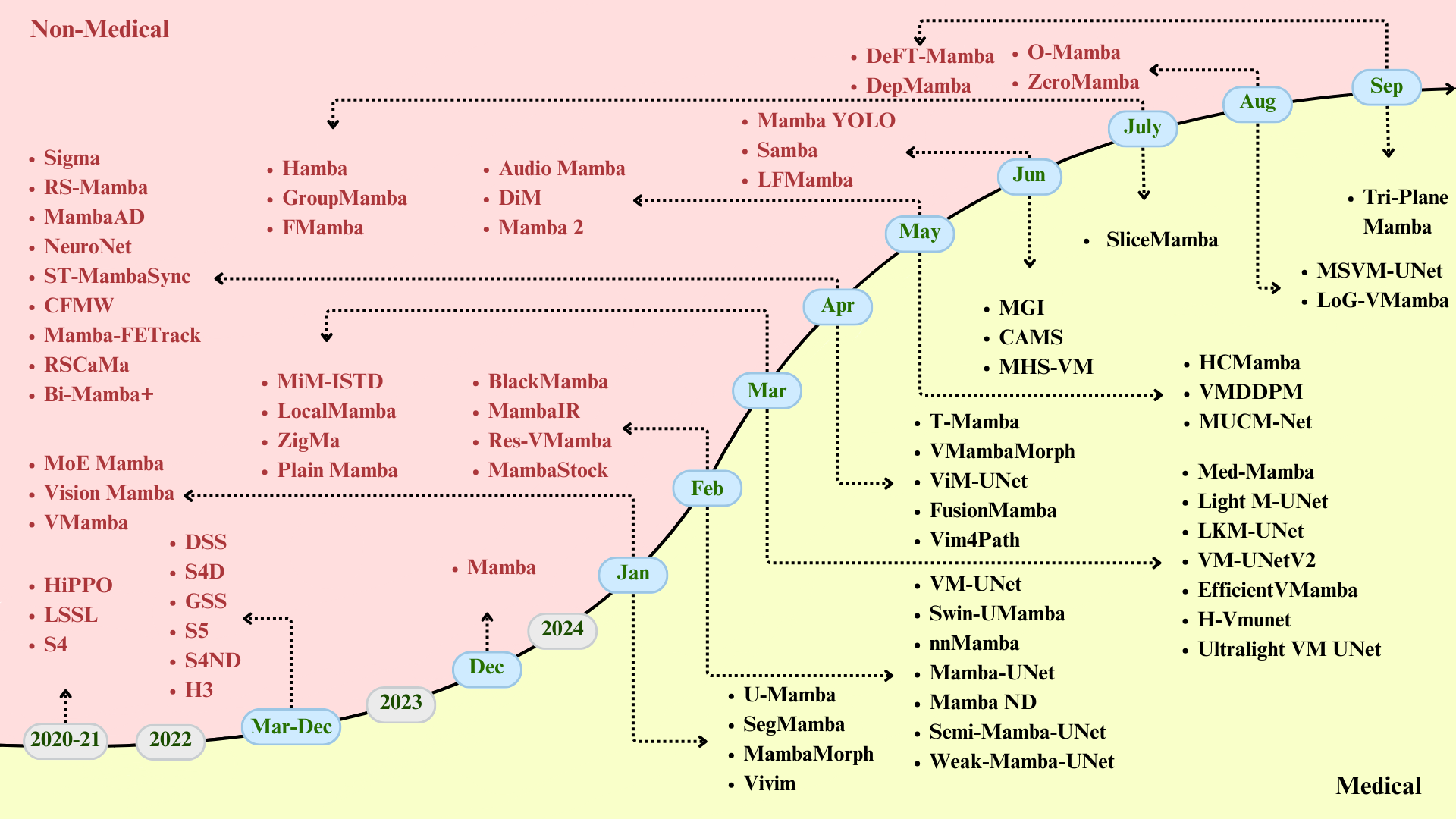

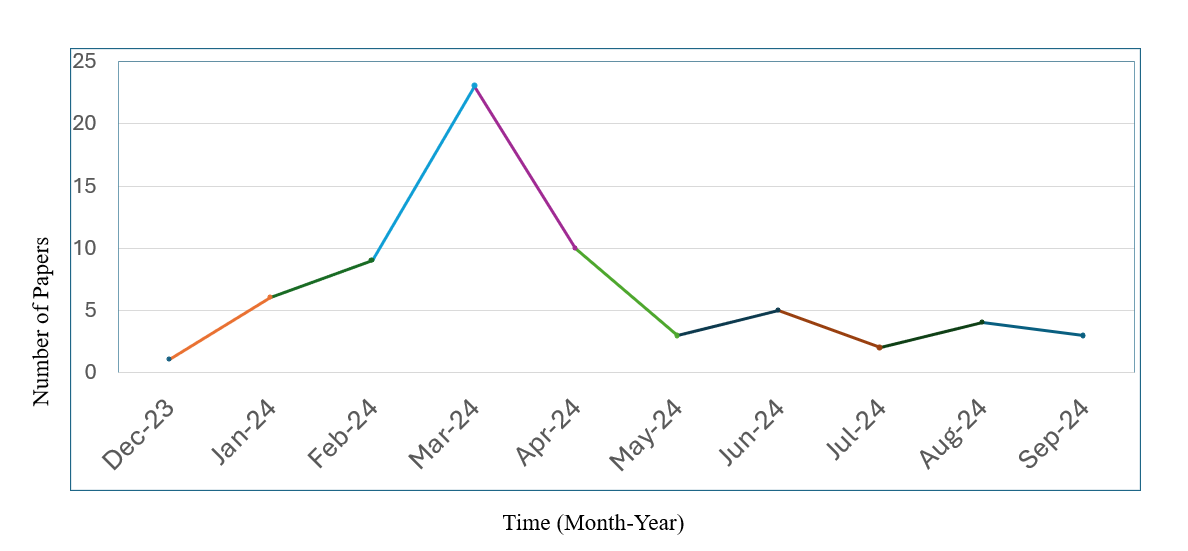

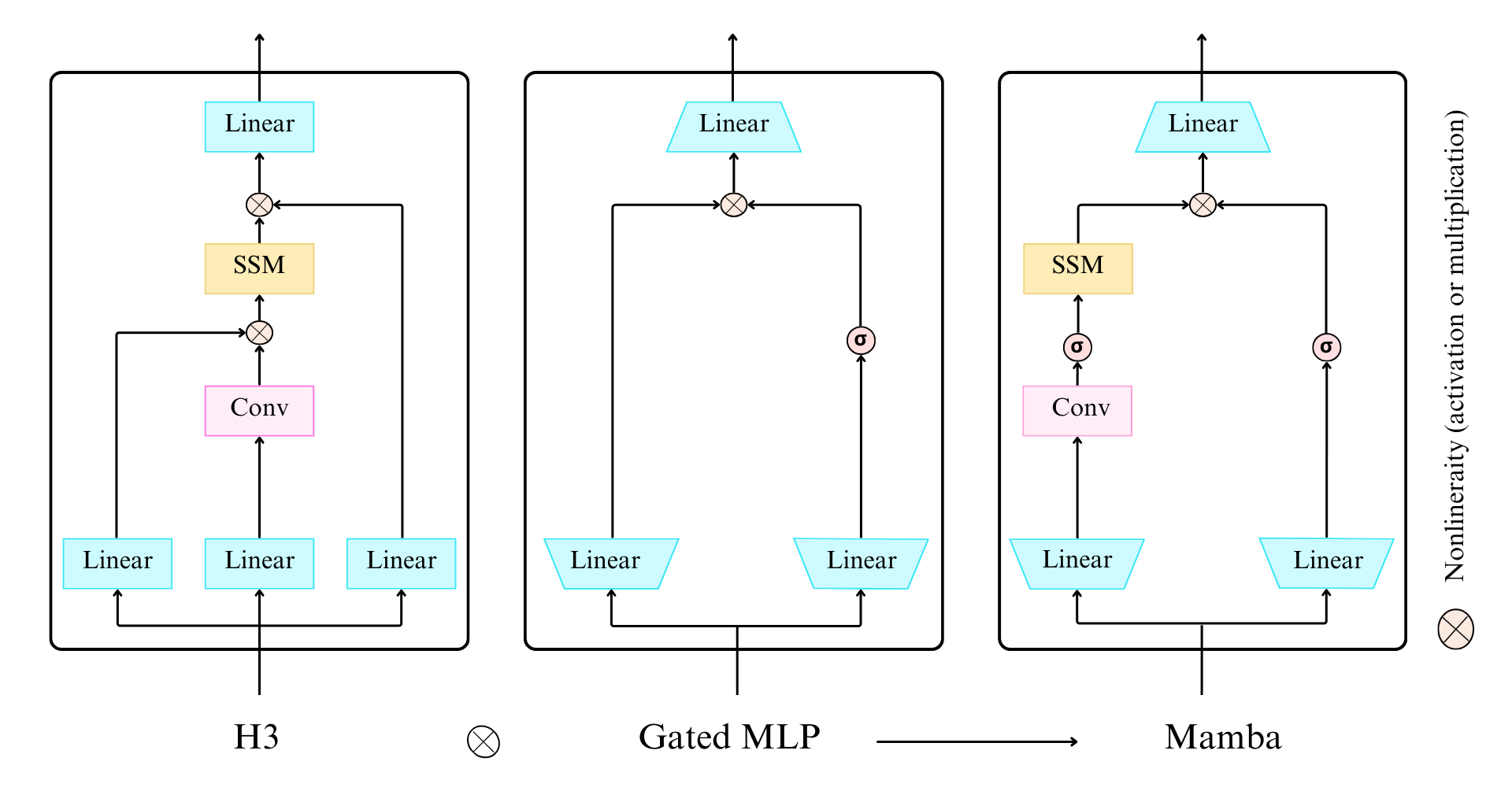

Mamba作为状态空间模型(SSM)的一个特例,在医学图像分析领域作为基于模板的深度学习方法的替代方案越来越受欢迎。虽然Transformer是强大的架构,但它们存在计算复杂度呈二次方增长以及无法有效处理长程依赖等缺点。这些限制影响了医学成像中大型复杂数据集的分析,因为其中存在许多空间和时间关系。相比之下,Mamba具有线性时间复杂度,显著优于Transformer。Mamba无需注意力机制即可处理更长的序列,从而实现更快的推理并减少内存需求。Mamba还在融合多模态数据方面表现出强大的性能,从而提高诊断准确性和改善患者预后。本文逐步介绍了Mamba在医学成像中的能力,首先定义了SSM和模型(包括S4、S5和S6)的核心概念,然后探讨了Mamba架构,如纯Mamba、U-Net变体以及与卷积神经网络、Transformer和图神经网络的混合模型。此外,还涵盖了Mamba的优化、技术和改编、扫描、数据集、应用、实验结果,并总结了其在医学成像中的挑战和未来方向。本综述旨在展示Mamba在克服医学成像领域现有障碍方面的变革潜力,同时为该领域的创新进步铺平道路。本文回顾的医学领域中应用的Mamba架构的综合列表可在Github上找到。

🔬 方法详解

问题定义:医学图像分析任务,如分类、分割和重建,需要处理大量具有复杂空间和时间关系的数据。传统的Transformer架构由于其二次方级别的计算复杂度,难以有效处理长程依赖关系,导致计算成本高昂和推理速度慢。现有方法在处理大规模医学图像数据集时面临效率和性能瓶颈。

核心思路:论文的核心思路是利用Mamba架构作为Transformer的替代方案,解决医学图像分析中的长程依赖和计算效率问题。Mamba基于状态空间模型(SSM),具有线性时间复杂度,能够更有效地处理长序列数据,从而降低计算成本并提高推理速度。

技术框架:该综述首先介绍了状态空间模型(SSM)的核心概念,包括S4、S5和S6等模型。然后,详细探讨了各种Mamba架构在医学图像分析中的应用,包括纯Mamba模型、U-Net变体以及与卷积神经网络(CNN)、Transformer和图神经网络(GNN)的混合模型。此外,还涵盖了Mamba的优化技术、数据扫描方法以及在不同医学图像数据集上的应用。

关键创新:Mamba架构的关键创新在于其选择性状态空间模型(Selective SSM),它允许模型根据输入动态地调整其状态转移矩阵。这种选择性机制使得Mamba能够更有效地捕捉长程依赖关系,并减少不相关信息的干扰。与传统的注意力机制相比,Mamba的计算复杂度更低,更适合处理大规模数据。

关键设计:Mamba架构的关键设计包括其状态空间模型的参数化方式、选择性机制的实现以及与其他神经网络模块的集成方式。具体的参数设置和网络结构取决于具体的应用场景和数据集。例如,在U-Net变体中,Mamba模块可以替代传统的卷积层或Transformer层,以提高模型的性能和效率。损失函数通常采用交叉熵损失或Dice损失,以优化模型的分类或分割性能。

🖼️ 关键图片

📊 实验亮点

该综述全面总结了Mamba架构在医学图像分析中的应用,涵盖了多种模型变体和优化技术。通过对比分析,展示了Mamba在处理长程依赖和提高计算效率方面的优势。此外,该综述还提供了Mamba在不同医学图像数据集上的实验结果,为研究人员提供了宝贵的参考。

🎯 应用场景

该研究成果可广泛应用于医学图像分析领域,包括疾病诊断、病灶检测、手术规划和疗效评估等。Mamba架构的引入有望提高医学图像分析的效率和准确性,从而改善患者的诊断和治疗效果。未来,Mamba还可能应用于医学影像组学、个性化医疗等新兴领域,为精准医疗提供更强大的技术支持。

📄 摘要(原文)

Mamba, a special case of the State Space Model, is gaining popularity as an alternative to template-based deep learning approaches in medical image analysis. While transformers are powerful architectures, they have drawbacks, including quadratic computational complexity and an inability to address long-range dependencies efficiently. This limitation affects the analysis of large and complex datasets in medical imaging, where there are many spatial and temporal relationships. In contrast, Mamba offers benefits that make it well-suited for medical image analysis. It has linear time complexity, which is a significant improvement over transformers. Mamba processes longer sequences without attention mechanisms, enabling faster inference and requiring less memory. Mamba also demonstrates strong performance in merging multimodal data, improving diagnosis accuracy and patient outcomes. The organization of this paper allows readers to appreciate the capabilities of Mamba in medical imaging step by step. We begin by defining core concepts of SSMs and models, including S4, S5, and S6, followed by an exploration of Mamba architectures such as pure Mamba, U-Net variants, and hybrid models with convolutional neural networks, transformers, and Graph Neural Networks. We also cover Mamba optimizations, techniques and adaptations, scanning, datasets, applications, experimental results, and conclude with its challenges and future directions in medical imaging. This review aims to demonstrate the transformative potential of Mamba in overcoming existing barriers within medical imaging while paving the way for innovative advancements in the field. A comprehensive list of Mamba architectures applied in the medical field, reviewed in this work, is available at Github.