Capturing complex hand movements and object interactions using machine learning-powered stretchable smart textile gloves

作者: Arvin Tashakori, Zenan Jiang, Amir Servati, Saeid Soltanian, Harishkumar Narayana, Katherine Le, Caroline Nakayama, Chieh-ling Yang, Z. Jane Wang, Janice J. Eng, Peyman Servati

分类: cs.HC, cs.CV, cs.LG, cs.RO, eess.SP

发布日期: 2024-10-03

期刊: Nature Machine Intelligence 6 (2024) 106-118

DOI: 10.1038/s42256-023-00780-9

💡 一句话要点

提出基于机器学习的可伸缩智能纺织手套以解决手部动作捕捉问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 智能手套 手部动作捕捉 机器学习 动态跟踪 人机交互 数据增强 传感器技术

📋 核心要点

- 现有手部动作捕捉方法难以准确捕捉复杂的手部动作,尤其是在动态交互场景中。

- 本文提出了一种基于可伸缩智能手套的解决方案,结合了高动态范围传感器和多阶段机器学习技术。

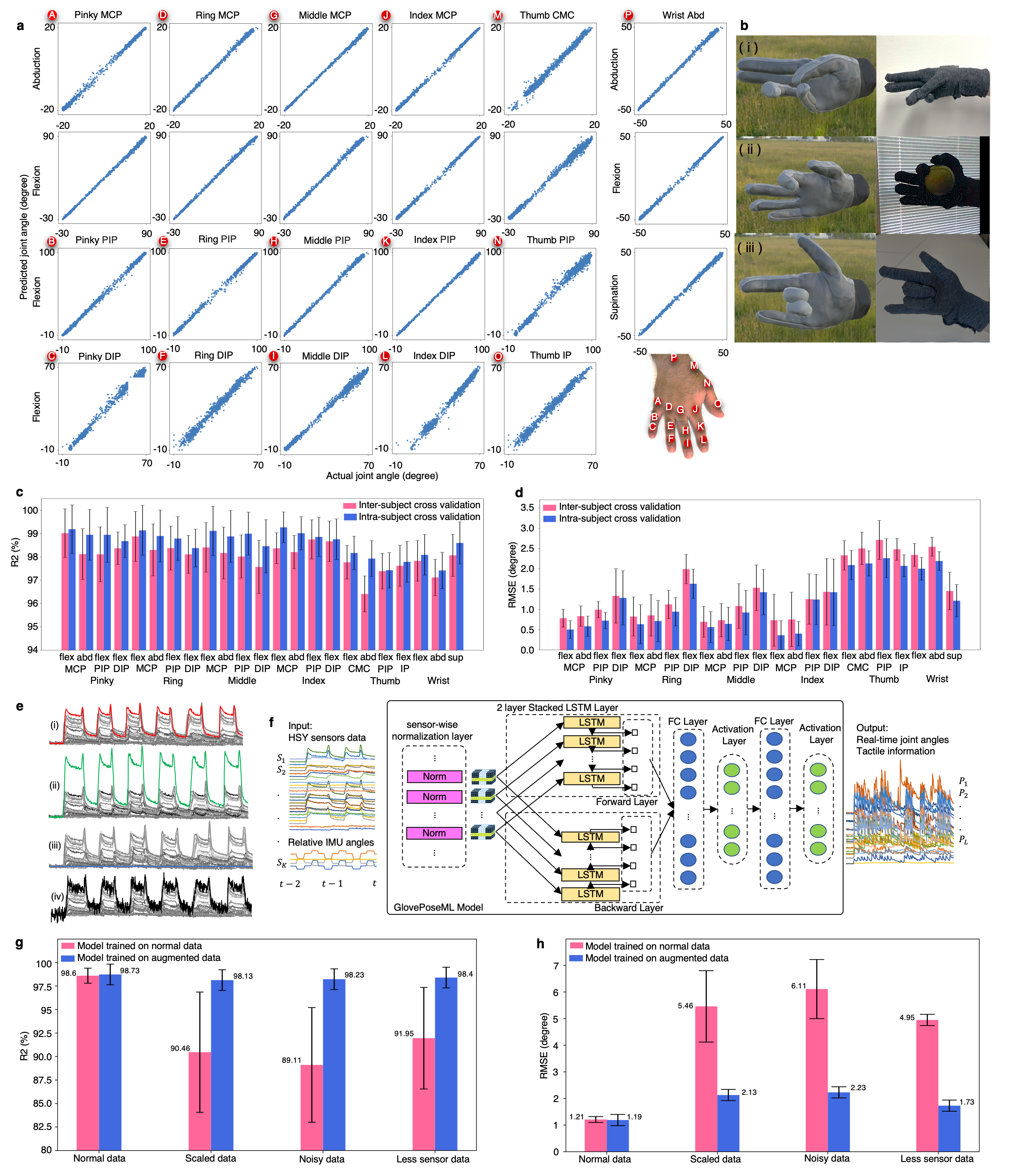

- 实验结果表明,该方法在关节角度估计上达到了1.21和1.45度的均方根误差,性能接近传统高成本的动作捕捉系统。

📝 摘要(中文)

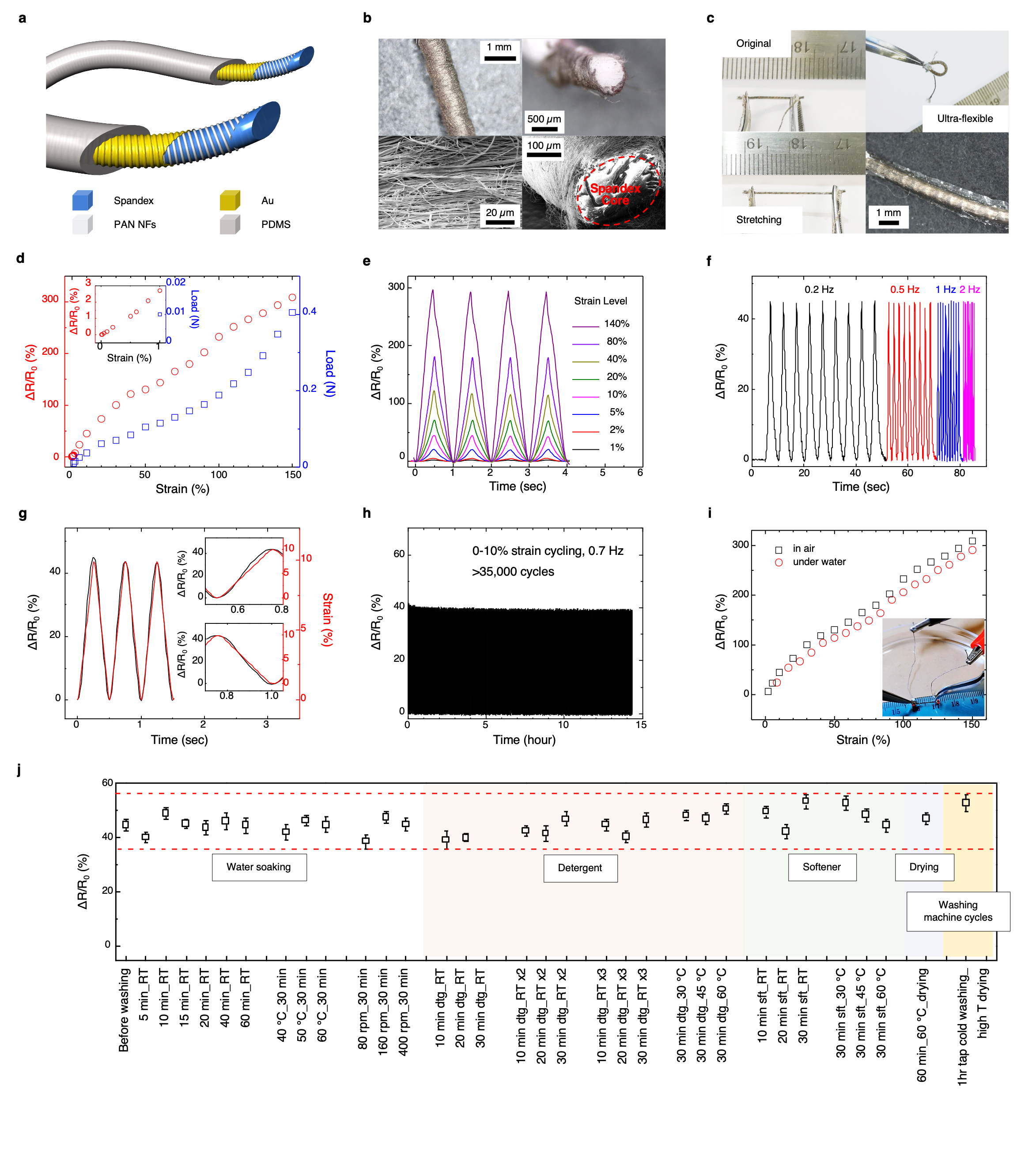

准确的实时手部动作和交互跟踪在人机交互、元宇宙、机器人和远程医疗等领域具有广泛应用。捕捉真实的手部动作面临许多挑战,尤其是关节数量和自由度的复杂性。本文报告了一种使用嵌入螺旋传感器纱线和惯性测量单元的可伸缩、可洗智能手套,能够准确动态地跟踪手部和手指的动作。传感器纱线具有高动态范围,能够响应从0.005%到155%的低高应变,并在长时间使用和洗涤周期中保持稳定。通过多阶段机器学习,我们在交叉验证中报告了平均关节角度估计的均方根误差为1.21和1.45度,匹配昂贵的动作捕捉相机的准确性,且没有遮挡或视野限制。我们还提出了一种数据增强技术,提高了对噪声和传感器变化的鲁棒性。

🔬 方法详解

问题定义:本文旨在解决复杂手部动作和物体交互的实时跟踪问题。现有方法在捕捉手部动作时面临关节数量多、自由度高等挑战,导致准确性不足。

核心思路:论文提出了一种基于可伸缩智能手套的解决方案,通过嵌入高动态范围的传感器纱线和惯性测量单元,实现对手部动作的准确跟踪。设计的核心在于利用机器学习技术提高动作捕捉的精度和鲁棒性。

技术框架:整体架构包括传感器数据采集模块、数据预处理模块和多阶段机器学习模块。传感器数据通过智能手套实时采集,经过预处理后输入到机器学习模型进行关节角度估计。

关键创新:最重要的技术创新在于结合了可伸缩的智能纺织材料与高动态范围传感器,能够在多种使用场景下保持稳定性和准确性。这一设计突破了传统手套在动态交互中的局限性。

关键设计:在参数设置上,采用了适应性损失函数以优化模型性能,网络结构方面使用了多阶段的深度学习架构,增强了对传感器噪声和变化的鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,所提方法在关节角度估计上达到了1.21和1.45度的均方根误差,分别对应于同一受试者和不同受试者的交叉验证。这一性能与高成本的动作捕捉系统相当,且在使用过程中没有遮挡或视野限制,显示出显著的优势。

🎯 应用场景

该研究的潜在应用领域包括人机交互、虚拟现实、机器人控制和远程医疗等。通过准确捕捉手部动作,能够提升用户体验,促进新型交互方式的发展,尤其是在需要精细操作的场景中,如虚拟键盘输入和手势识别等。

📄 摘要(原文)

Accurate real-time tracking of dexterous hand movements and interactions has numerous applications in human-computer interaction, metaverse, robotics, and tele-health. Capturing realistic hand movements is challenging because of the large number of articulations and degrees of freedom. Here, we report accurate and dynamic tracking of articulated hand and finger movements using stretchable, washable smart gloves with embedded helical sensor yarns and inertial measurement units. The sensor yarns have a high dynamic range, responding to low 0.005 % to high 155 % strains, and show stability during extensive use and washing cycles. We use multi-stage machine learning to report average joint angle estimation root mean square errors of 1.21 and 1.45 degrees for intra- and inter-subjects cross-validation, respectively, matching accuracy of costly motion capture cameras without occlusion or field of view limitations. We report a data augmentation technique that enhances robustness to noise and variations of sensors. We demonstrate accurate tracking of dexterous hand movements during object interactions, opening new avenues of applications including accurate typing on a mock paper keyboard, recognition of complex dynamic and static gestures adapted from American Sign Language and object identification.