Multi-viewregulated gaussian splatting for novel view synthesis

作者: Xiaobiao Du, Yida Wang, Xin Yu

分类: cs.CV

发布日期: 2024-10-02 (更新: 2025-09-20)

备注: Project Page:https://xiaobiaodu.github.io/mvgs-project/

💡 一句话要点

提出多视角约束高斯溅射方法,提升新视角合成质量和几何精度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 新视角合成 3D高斯溅射 多视角学习 三维重建 神经渲染

📋 核心要点

- 现有3DGS方法采用单视角监督,易过拟合特定视角,导致新视角合成效果不佳,几何精度不足。

- 论文提出多视角约束训练策略,并结合跨视角内参引导、跨射线稠密化和多视角增强稠密化等方法,优化3D高斯。

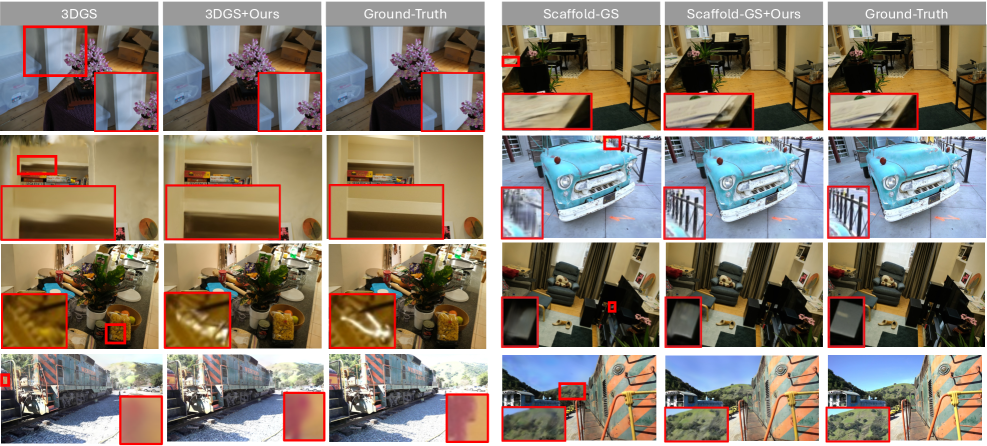

- 实验表明,该方法在多种场景和不同高斯变体中均能提升整体精度,改善新视角合成效果。

📝 摘要(中文)

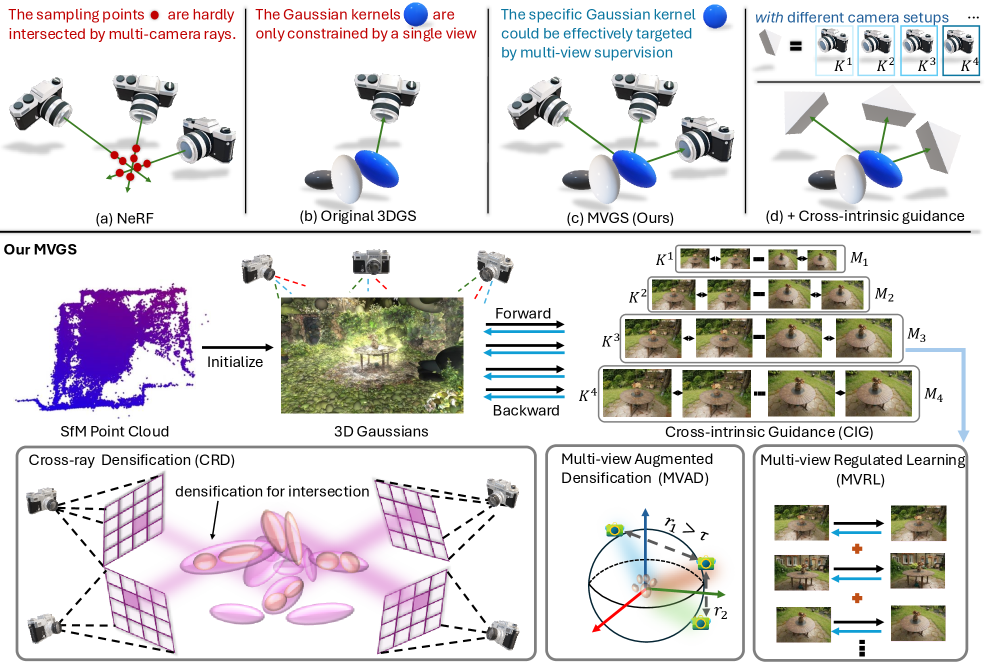

本文提出了一种新的3D高斯溅射(3DGS)优化方法,旨在解决现有方法中由于单视角监督导致的过拟合问题,从而提升新视角合成的质量和3D几何的精确性。该方法包含四个关键创新点:1) 将传统的单视角训练范式转变为多视角训练策略,通过多视角约束优化3D高斯属性,避免过拟合特定视角。2) 引入跨视角内参引导机制,实现由粗到精的不同分辨率训练过程。3) 在多视角约束训练的基础上,提出跨射线稠密化策略,从多个视角的射线相交区域中稠密化更多高斯核。4) 提出多视角增强稠密化策略,鼓励在差异显著的视角中充分稠密化3D高斯,从而提高重建精度。

🔬 方法详解

问题定义:现有基于3D高斯溅射的新视角合成方法,在训练过程中通常采用单视角监督的方式优化高斯参数。这种方式容易导致模型过拟合训练集中特定视角,从而在新视角合成时出现伪影,并且重建的3D几何形状不够精确。因此,需要一种方法来避免单视角过拟合,提高泛化能力。

核心思路:论文的核心思路是将单视角训练范式转变为多视角训练范式。通过引入来自多个视角的监督信息,可以更全面地约束3D高斯参数的优化过程,从而避免模型过度拟合特定视角。此外,论文还结合了跨视角内参引导、跨射线稠密化和多视角增强稠密化等策略,进一步提升模型的性能。

技术框架:该方法主要包含以下几个阶段:1) 多视角约束训练:利用多个视角的图像信息来优化3D高斯参数,避免单视角过拟合。2) 跨视角内参引导:利用不同视角的内参信息,引导模型进行由粗到精的训练。3) 跨射线稠密化:在多个视角的射线相交区域中,增加高斯核的数量,提高几何细节的重建能力。4) 多视角增强稠密化:针对差异显著的视角,进一步增加高斯核的数量,提高重建精度。

关键创新:该论文最重要的技术创新点在于提出了多视角约束训练策略,将传统的单视角训练范式转变为多视角训练范式。这种方法可以有效地避免单视角过拟合,提高模型的泛化能力。此外,论文还提出了跨视角内参引导、跨射线稠密化和多视角增强稠密化等策略,进一步提升了模型的性能。

关键设计:论文中涉及的关键设计包括:1) 多视角约束的损失函数设计,需要平衡不同视角的监督信息。2) 跨视角内参引导的具体实现方式,例如如何利用内参信息来调整训练分辨率。3) 跨射线稠密化的策略,例如如何选择射线相交区域以及如何增加高斯核的数量。4) 多视角增强稠密化的策略,例如如何判断视角差异显著以及如何根据差异程度调整稠密化程度。

🖼️ 关键图片

📊 实验亮点

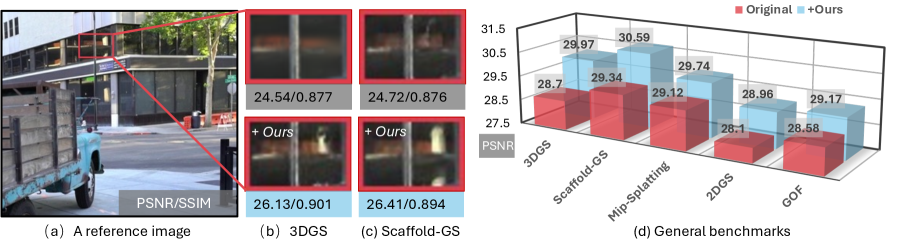

论文提出的多视角约束高斯溅射方法在多个数据集上取得了显著的性能提升。具体而言,与现有方法相比,该方法能够显著降低新视角合成的误差,提高重建的3D几何精度。实验结果表明,该方法在复杂场景和不同视角下均能保持良好的性能,具有较强的鲁棒性。

🎯 应用场景

该研究成果可广泛应用于新视角合成、三维重建、虚拟现实、增强现实等领域。例如,可以用于创建高质量的虚拟场景,实现沉浸式的VR/AR体验,或者用于重建真实世界的3D模型,为机器人导航、自动驾驶等应用提供支持。该方法能够提升新视角合成的质量和几何精度,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

Recent works in volume rendering, \textit{e.g.} NeRF and 3D Gaussian Splatting (3DGS), significantly advance the rendering quality and efficiency with the help of the learned implicit neural radiance field or 3D Gaussians. Rendering on top of an explicit representation, the vanilla 3DGS and its variants deliver real-time efficiency by optimizing the parametric model with single-view supervision per iteration during training which is adopted from NeRF. Consequently, certain views are overfitted, leading to unsatisfying appearance in novel-view synthesis and imprecise 3D geometries. To solve aforementioned problems, we propose a new 3DGS optimization method embodying four key novel contributions: 1) We transform the conventional single-view training paradigm into a multi-view training strategy. With our proposed multi-view regulation, 3D Gaussian attributes are further optimized without overfitting certain training views. As a general solution, we improve the overall accuracy in a variety of scenarios and different Gaussian variants. 2) Inspired by the benefit introduced by additional views, we further propose a cross-intrinsic guidance scheme, leading to a coarse-to-fine training procedure concerning different resolutions. 3) Built on top of our multi-view regulated training, we further propose a cross-ray densification strategy, densifying more Gaussian kernels in the ray-intersect regions from a selection of views. 4) By further investigating the densification strategy, we found that the effect of densification should be enhanced when certain views are distinct dramatically. As a solution, we propose a novel multi-view augmented densification strategy, where 3D Gaussians are encouraged to get densified to a sufficient number accordingly, resulting in improved reconstruction accuracy.