EVER: Exact Volumetric Ellipsoid Rendering for Real-time View Synthesis

作者: Alexander Mai, Peter Hedman, George Kopanas, Dor Verbin, David Futschik, Qiangeng Xu, Falko Kuester, Jonathan T. Barron, Yinda Zhang

分类: cs.CV

发布日期: 2024-10-02 (更新: 2025-07-24)

备注: Project page: https://half-potato.gitlab.io/posts/ever

💡 一句话要点

提出EVER:一种用于实时视角合成的精确体积椭球渲染方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 体渲染 视角合成 椭球渲染 光线追踪 实时渲染

📋 核心要点

- 现有3D高斯溅射(3DGS)方法在视角合成中存在跳跃伪影和视角相关密度问题,影响渲染质量。

- EVER通过使用基于图元的表示进行精确体积渲染,避免了alpha合成,从而消除了上述问题。

- 实验表明,EVER在Zip-NeRF等大规模场景中,相比3DGS及其改进方法,实现了更清晰的结果,且帧率达到实时水平。

📝 摘要(中文)

本文提出了一种名为精确体积椭球渲染(EVER)的方法,用于实现实时的、仅发射的、可微的体渲染。与最近基于光栅化的3D高斯溅射(3DGS)方法不同,我们基于图元的表示允许精确的体渲染,而不是对3D高斯广告牌进行alpha合成。因此,与3DGS不同,我们的公式不会受到跳跃伪影和视角相关的密度问题的影响,并且仍然可以在NVIDIA RTX4090上以720p的分辨率实现约30 FPS的帧率。由于我们的方法是建立在光线追踪的基础上的,因此它可以实现诸如散焦模糊和相机畸变(例如来自鱼眼相机)等效果,而这些效果很难通过光栅化来实现。我们表明,我们的方法比3DGS及其后续的视角一致性渲染工作更准确,混合问题更少,尤其是在Zip-NeRF数据集中具有挑战性的大规模场景中,它在实时技术中实现了最清晰的结果。

🔬 方法详解

问题定义:现有基于光栅化的3D高斯溅射(3DGS)方法,虽然实现了快速渲染,但在视角合成中存在跳跃伪影和视角相关的密度问题,尤其是在处理大规模场景时,渲染质量会受到影响。此外,基于光栅化的方法难以实现散焦模糊和相机畸变等效果。

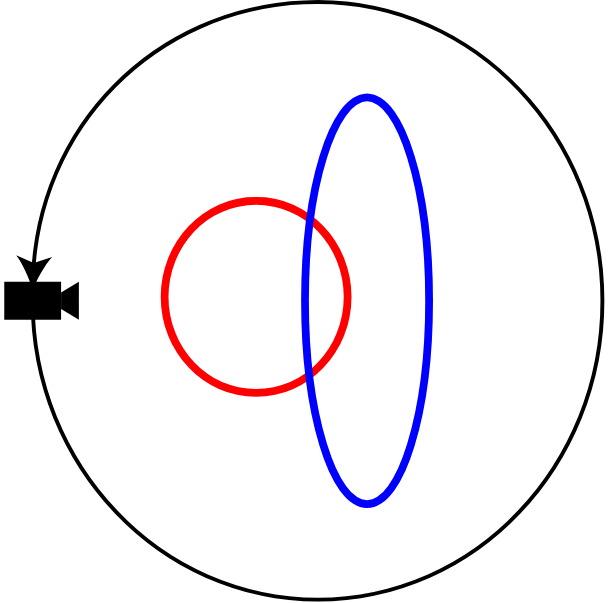

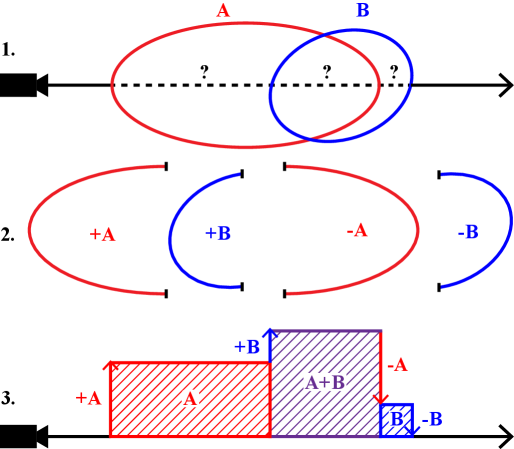

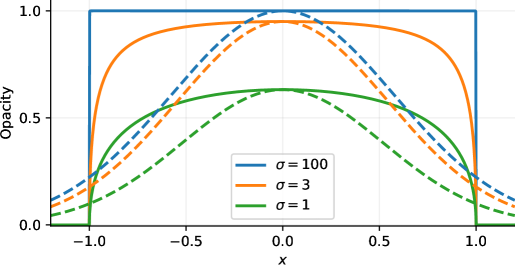

核心思路:EVER的核心思路是使用精确的体积椭球渲染,避免使用alpha合成。通过将场景表示为椭球体的集合,并使用光线追踪技术,可以对每个像素的颜色进行精确计算,从而消除跳跃伪影和视角相关的密度问题。

技术框架:EVER的整体框架包括以下几个主要步骤:1)场景表示:将场景表示为一组椭球体,每个椭球体具有位置、大小、旋转和颜色等属性。2)光线追踪:对于每个像素,从相机发出一条光线,并计算光线与场景中椭球体的交点。3)体积渲染:根据光线与椭球体的交点,计算该像素的颜色值。4)优化:使用可微分渲染技术,优化椭球体的属性,以最小化渲染图像与真实图像之间的差异。

关键创新:EVER的关键创新在于使用精确的体积椭球渲染,而不是基于alpha合成的近似渲染。这种方法可以避免跳跃伪影和视角相关的密度问题,并实现更真实的渲染效果。此外,EVER基于光线追踪,可以自然地支持散焦模糊和相机畸变等效果。

关键设计:EVER的关键设计包括:1)椭球体的表示方法:使用位置、大小、旋转和颜色等属性来表示每个椭球体。2)光线与椭球体的交点计算方法:使用解析方法计算光线与椭球体的交点,以提高计算效率。3)体积渲染方法:使用积分方法计算光线穿过椭球体时的颜色贡献。4)损失函数:使用L1损失或L2损失来衡量渲染图像与真实图像之间的差异。

🖼️ 关键图片

📊 实验亮点

EVER在Zip-NeRF数据集上进行了实验,结果表明,与3DGS及其后续的视角一致性渲染工作相比,EVER在实时技术中实现了最清晰的结果。在NVIDIA RTX4090上,EVER可以以720p的分辨率实现约30 FPS的帧率,达到了实时渲染的要求。这表明EVER在渲染质量和效率方面都具有显著优势。

🎯 应用场景

EVER具有广泛的应用前景,包括虚拟现实、增强现实、游戏开发、电影制作等领域。它可以用于创建更逼真、更沉浸式的虚拟环境,并支持各种高级渲染效果,例如散焦模糊和相机畸变。此外,EVER还可以用于三维重建和场景理解等任务。

📄 摘要(原文)

We present Exact Volumetric Ellipsoid Rendering (EVER), a method for real-time differentiable emission-only volume rendering. Unlike recent rasterization based approach by 3D Gaussian Splatting (3DGS), our primitive based representation allows for exact volume rendering, rather than alpha compositing 3D Gaussian billboards. As such, unlike 3DGS our formulation does not suffer from popping artifacts and view dependent density, but still achieves frame rates of $\sim!30$ FPS at 720p on an NVIDIA RTX4090. Since our approach is built upon ray tracing it enables effects such as defocus blur and camera distortion (e.g. such as from fisheye cameras), which are difficult to achieve by rasterization. We show that our method is more accurate with fewer blending issues than 3DGS and follow-up work on view-consistent rendering, especially on the challenging large-scale scenes from the Zip-NeRF dataset where it achieves sharpest results among real-time techniques.